Como todo el mundo, me sentí cautivado cuando empecé a explorar las imágenes generadas por IA. Sin embargo, la conversación cambió por completo cuando tuve que integrar la generación de imágenes en un producto real.

La mayoría de los usuarios ven un cuadro de texto. Yo veo un endpoint de API, un presupuesto de latencia y una factura mensual.

Elegir la mejor API de imágenes con IA para un flujo de producción no tiene nada que ver con elegir una interfaz web favorita. De repente, las preguntas que importan son:

- ¿Cómo se mantiene la calidad de la imagen a escala?

- ¿Cómo es la tarifa de la API tras 10,000 solicitudes?

- ¿Existen herramientas para desarrolladores fiables para monitorización y reintentos?

La explosión de alternativas a la API de Midjourney ha hecho que esta decisión sea más difícil —y más interesante. Cada proveedor hace promesas audaces, pero las promesas no sobreviven al contacto con un código base real.

Mi objetivo es simple: ofrecer a los desarrolladores el análisis honesto y comparativo que me hubiera gustado tener antes de construir mi producto.

Vamos a ello.

Análisis profundo: una comparativa directa

A. GPT Image 2.0: El líder en lógica inteligente

De todas las alternativas a la API de Midjourney que he probado, GPT Image 2.0 destaca por una razón por encima de todas las demás: realmente piensa en lo que le pides.

Qué lo hace diferente

Mientras que la mayoría de los modelos ajustan tu prompt a una estética visual, GPT Image 2.0 procesa instrucciones complejas y relacionales con una precisión notable. Pídele que coloque un objeto detrás de otro, o a la izquierda de un tercer elemento, y en gran medida lo logra. Ese tipo de razonamiento espacial ha sido históricamente un punto débil en todos los generadores de imágenes.

El renderizado de texto es otra fortaleza genuina. Logos, etiquetas, señales, prototipos de UI... aquí es donde mi evaluación de calidad de imagen le otorgó consistentemente la puntuación más alta entre los cinco contendientes.

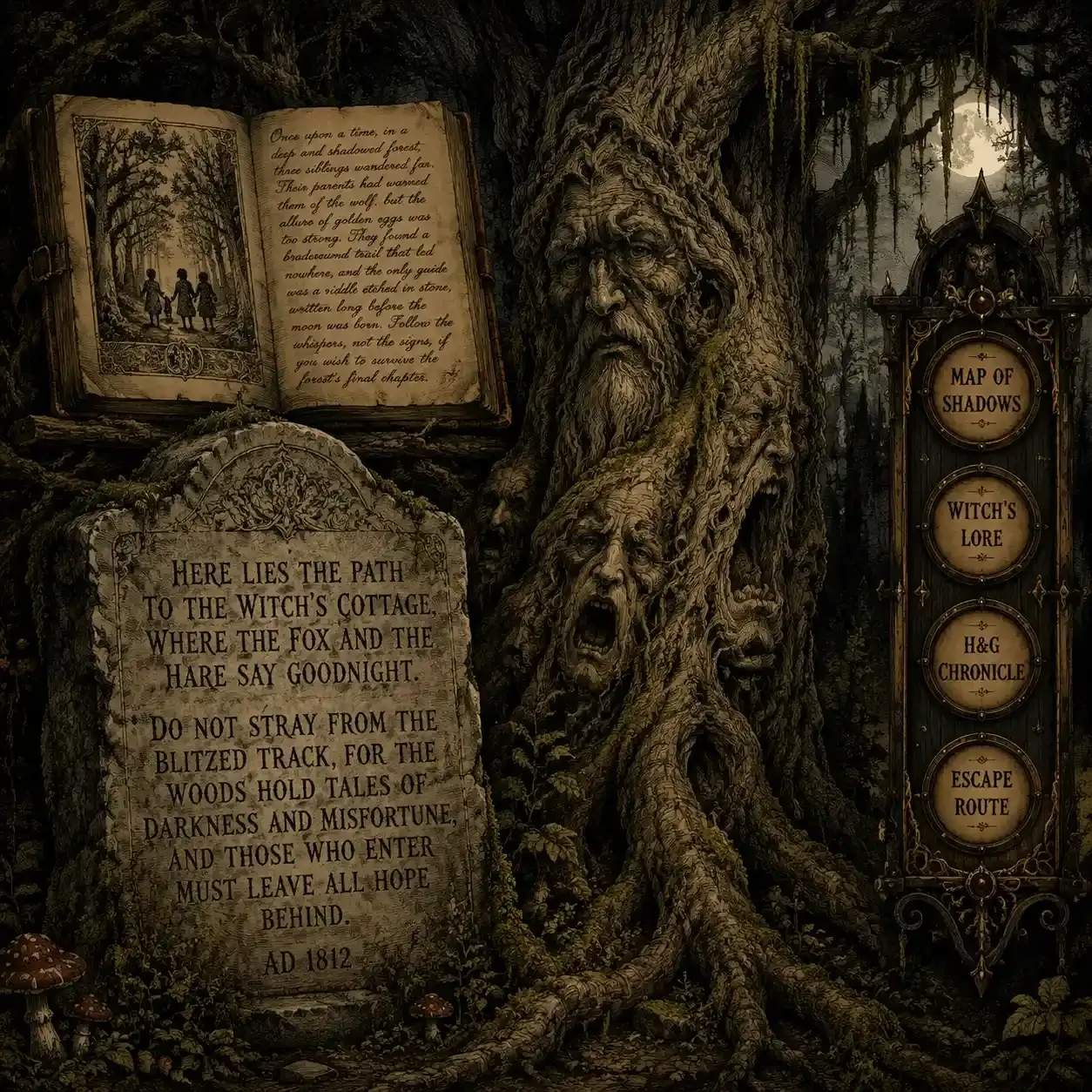

Para poner a prueba a GPT Image 2.0, creé un prompt enfocado en tres objetivos principales. Comprobé la lógica espacial con objetos en capas, probé la calidad del texto con historias largas en diferentes fuentes y combiné diseños de apps modernas con arte de grabado en madera antiguo.

Fortalezas de un vistazo

| Capacidad | Rendimiento |

| Razonamiento espacial/relacional | ★★★★★ |

| Renderizado de texto en imagen | ★★★★★ |

| Diseños complejos multi-elemento | ★★★★☆ |

| Flexibilidad estilística | ★★★☆☆ |

Los inconvenientes que noté

No está exento de fricciones. Como parte de mi comparativa de tarifas de API, descubrí que las salidas de alta resolución se encuentran bajo niveles de uso más estrictos, lo que significa que los costes escalan más rápido que en otras herramientas de desarrollo para IA competidoras. La latencia a 1024×1024 también es notablemente más alta que en alternativas más ligeras.

Ideal para

- Herramientas de diagramación e ilustración técnica.

- Cualquier producto donde la precisión del texto dentro de las imágenes sea innegociable.

- Generadores de prototipos de UI o aplicaciones de asistencia al diseño.

Si el control preciso del diseño es tu prioridad, es un candidato serio a ser la mejor API de imágenes con IA en tu stack.

B. Stable Diffusion / Stability AI: El sueño del personalizador

Si GPT Image 2.0 es el modelo que entiende tu prompt, Stable Diffusion es el modelo que tú diseñas. Para los desarrolladores que desean un control granular sobre cada variable de salida, este ecosistema no tiene rival entre las alternativas a la API de Midjourney.

Qué lo hace diferente

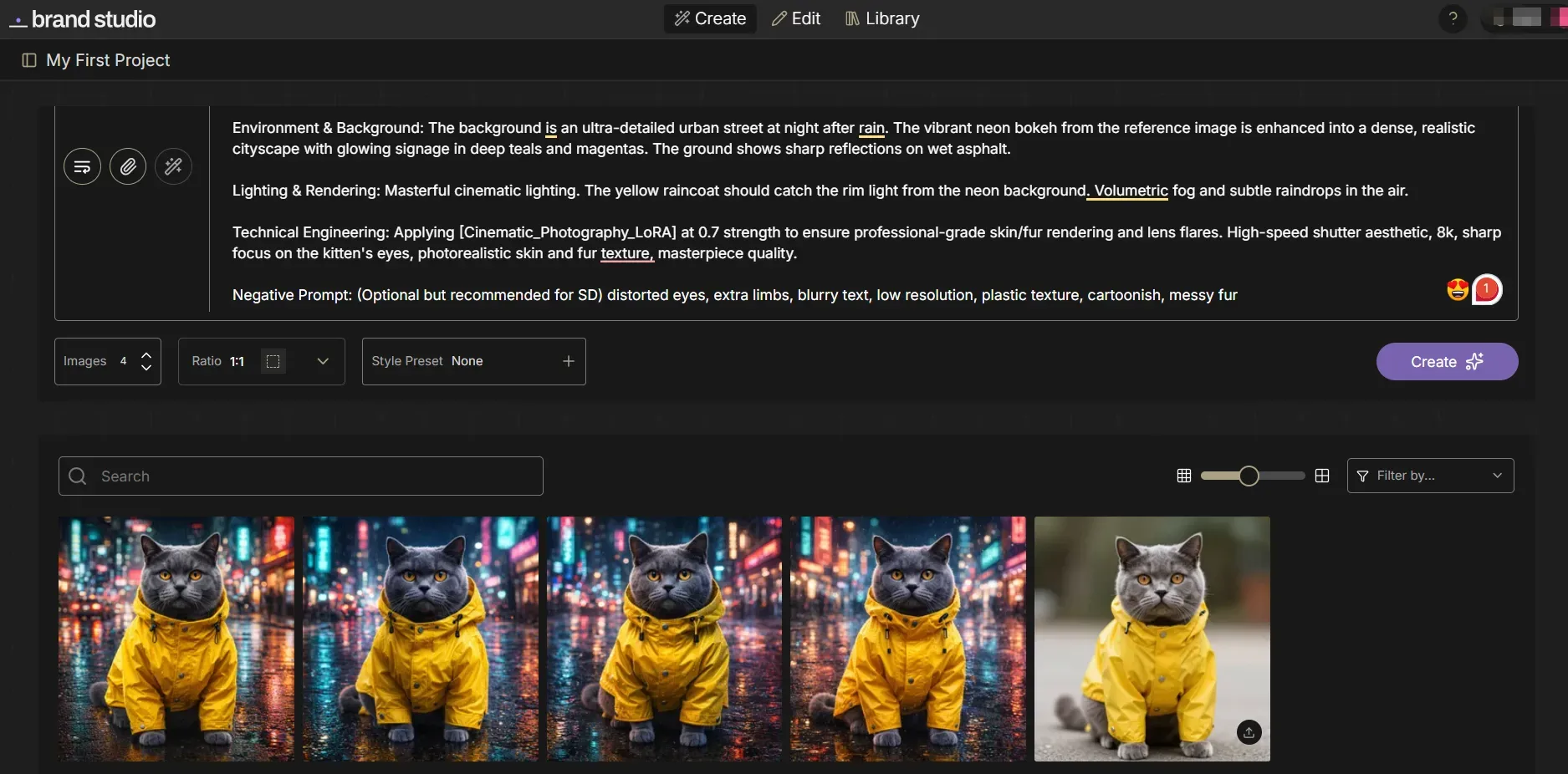

El verdadero poder aquí no es el modelo base, sino las herramientas que lo rodean. Dos características en particular han dado forma a cómo abordo las herramientas de desarrollo para IA:

- ControlNet — Bloquea la composición mediante poses de referencia, mapas de profundidad o líneas de contorno. La consistencia entre imágenes generadas se vuelve realmente alcanzable.

- LoRAs (Low-Rank Adaptation) — Permite ajustar el modelo a estilos, personajes o estéticas de producto específicas sin necesidad de un reentrenamiento completo. Para resultados consistentes con la marca, no hay nada igual.

Este resultado demuestra la precisión del flujo de trabajo de ingeniería de Stable Diffusion. Al utilizar ControlNet para fijar la composición original y LoRA para mejorar la estética cinematográfica, transformamos una simple referencia en una serie estilísticamente consistente y de alta fidelidad, demostrando por qué es la herramienta definitiva para un control creativo granular.

Resumen de capacidades

| Característica | SD XL | SD 3 |

| Soporte ControlNet | ✅ Maduro | ✅ En expansión |

| Ajuste fino LoRA | ✅ Extenso | ✅ Compatible |

| Estabilidad de API | ★★★★☆ | ★★★☆☆ |

| Calidad documentación | ★★★☆☆ | ★★★☆☆ |

El inconveniente real

Mi opinión honesta después de hacer esta evaluación de calidad de imagen: el límite de los resultados es alto, pero también lo es el coste de aprendizaje. La documentación está fragmentada: SDXL y SD3 se comportan de forma tan distinta que las guías rara vez se pueden transferir fácilmente. Reserva más tiempo de incorporación (onboarding) del que esperas.

Al analizar los precios de la API, ejecutar tus propios servidores puede reducir realmente el coste de cada imagen. Ahorra dinero, pero tu equipo tendrá más trabajo para mantener todo en funcionamiento.

Ideal para

- Imágenes de productos de comercio electrónico a gran escala.

- Flujos de trabajo de visualización arquitectónica.

- Cualquier app que requiera una estética de marca bloqueada en miles de resultados.

Para equipos con profundidad técnica, sigue siendo uno de los candidatos más potentes a mejor API de imágenes con IA en un flujo de trabajo personalizado.

C. Flux.1 (vía FAL.ai / Replicate): El nuevo rey del realismo

Cuando realizo una evaluación pura de calidad de imagen centrada en el fotorrealismo, Flux.1 se sitúa constantemente en la cima de mis resultados. Desarrollado por Black Forest Labs y accesible a través de plataformas como FAL.ai y Replicate, ha emergido como una de las alternativas a la API de Midjourney más comentadas para uso profesional.

Donde destaca realmente

Dos áreas sobresalen claramente en mis pruebas:

- Fotorrealismo — Textura de la piel, degradados de iluminación, superficies de materiales. Flux.1 Pro produce resultados que engañan rutinariamente al ojo no experto.

- Renderizado de texto en imagen — Aquí es donde se separa de casi todos sus competidores. El texto legible y colocado con precisión dentro de una imagen generada es notoriamente difícil. Flux.1 lo maneja mejor que cualquier otra cosa que haya probado.

La versión Pro (derecha) demuestra una adherencia al prompt superior, renderizando con precisión texto complejo y texturas de piel realistas con bokeh cinematográfico. Por el contrario, Schnell (izquierda) muestra errores ortográficos menores y una estética más procesada y "estilo IA".

Comparativa de variantes del modelo

| Variante | Velocidad | Calidad | Mejor caso de uso |

| Flux.1 Pro | Lento | ★★★★★ | Activos de marketing, imágenes hero |

| Flux.1 Dev | Moderado | ★★★★☆ | Prototipado, iteración |

| Flux.1 Schnell | Rápido | ★★★☆☆ | Flujos de gran volumen, velocidad |

Los inconvenientes honestos

Desde la perspectiva de la comparativa de precios de API, Flux.1 Pro es computacionalmente caro por imagen en comparación con las opciones basadas en SD. Además, al ser un ecosistema más nuevo, carece de la profundidad de LoRAs, flujos de trabajo y "recetas" de la comunidad que hacen que Stable Diffusion sea tan fácil de usar para equipos experimentados.

Las herramientas de desarrollo para IA que lo rodean están mejorando rápidamente, pero la madurez aún va por detrás de otros ecosistemas más antiguos.

Ideal para

- Automatización de redes sociales que requiere activos de alta fidelidad visual.

- Flujos de marketing donde la precisión del texto en las imágenes impacta directamente en la calidad del resultado.

- Equipos que priorizan la mejor API de imágenes con IA por su realismo sobre la flexibilidad de ajuste fino.

D. Google Imagen (Vertex AI): El caballo de batalla empresarial

Cuando la conversación pasa de la experimentación creativa al despliegue regulado a gran escala, Google Imagen en Vertex AI entra en escena de forma distinta al resto. Lo describiría no tanto como una herramienta creativa, sino como una decisión de infraestructura lista para el cumplimiento normativo.

Qué lo define

Imagen no intenta ganar un concurso de talento artístico. Está construido para organizaciones donde la capacidad de auditoría, la seguridad y la integración en la plataforma pesan más que el rango estilístico. Dos características lo posicionan de forma única en esta comparativa:

- SynthID — La tecnología de marca de agua digital propietaria de Google, incrustada de forma invisible en las imágenes generadas para el seguimiento de procedencia. Para los equipos legales y de cumplimiento, este es un factor diferenciador serio.

- Controles de seguridad empresariales — Filtrado de contenido, aplicación de políticas de uso y controles de acceso que cumplen con los estándares que las industrias reguladas realmente exigen.

Esta imagen de referencia integrada muestra la precisión de grado empresarial de Google Imagen. Encaja fácilmente tres mundos distintos —ley, laboratorios médicos y anuncios de coches— en un diseño organizado. El aspecto final se centra en un ambiente de trabajo estable, colores planos y sensaciones realistas. Esto lo convierte en una opción sólida y segura para industrias que necesitan cumplir reglas estrictas y pasar auditorías.

Tabla de preparación empresarial

| Criterio | Google Imagen | Media industrial |

| Marca de agua (SynthID) | ✅ Nativo | ❌ Raro |

| Integración GCP IAM | ✅ Completa | ❌ Limitada |

| Controles de seguridad | ★★★★★ | ★★★☆☆ |

| Rango de estilo artístico | ★★★☆☆ | ★★★★☆ |

La limitación real

Desde el punto de vista de las herramientas de desarrollo para IA, Imagen vive casi en su totalidad dentro del ecosistema de Google Cloud Platform. Si tu stack no está ya alineado con GCP, la fricción de entrada es real. Tampoco es donde enviaría a nadie que realice una evaluación de calidad de imagen pura para casos de uso estéticos o orientados al marketing.

Ideal para

- Herramientas internas en empresas Fortune 500 que requieran procedencia de imagen.

- Plataformas de salud, finanzas y legal que necesiten salidas de IA auditables.

- Equipos que ya están en GCP y buscan alternativas a la API de Midjourney con gobernanza incorporada.

Para industrias reguladas, puede ser simplemente la mejor API de imágenes con IA — no porque sea la más bonita, sino porque es la más defendible.

E. DALL-E 3 (OpenAI): La opción "configurar y olvidar"

De todas las opciones, DALL-E 3 es la que entregaría con más confianza a un equipo de producto no técnico. No es un cumplido con doble sentido; en ciertos contextos de despliegue, la fiabilidad de bajo mantenimiento es exactamente lo que necesitas.

La función que lo cambia todo

DALL-E 3 destaca porque utiliza GPT-4 para reescribir prompts sobre la marcha. Toma tus ideas básicas y las limpia automáticamente antes de crear la imagen. Corrige frases desordenadas, aclara confusiones y añade los detalles que faltan. Para aplicaciones donde los prompts del usuario final son impredecibles y muy inconsistentes, esta es una ayuda real que ninguna otra alternativa a la API de Midjourney replica de forma nativa a este nivel.

Esta prueba confirma eficazmente la posición de DALL-E 3 como la opción "configurar y olvidar". Incluso con entradas poco estructuradas, optimiza la lógica para producir una imagen bien compuesta, detallada y comercialmente atractiva, lo que la hace ideal para aplicaciones dirigidas al consumidor donde la calidad del prompt es impredecible.

Resumen de fiabilidad

| Factor | DALL-E 3 | Notas |

| Robustez de prompt | ★★★★★ | La reescritura de GPT-4 suaviza entradas malas |

| Filtro de seguridad | ★★★★★ | A veces demasiado sensible |

| Coste por imagen | ★★☆☆☆ | Más alto que la mayoría |

| Flexibilidad estilo | ★★★☆☆ | Sólido, no excepcional |

Donde se queda corto

Mi evaluación de calidad de imagen encuentra que DALL-E 3 es consistentemente bueno, pero rara vez impresionante. El punto de fricción más importante es su filtrado de contenido: puede bloquearse con prompts que son totalmente inofensivos, lo que crea fallos incómodos de cara al usuario en producción. Es un problema de ingeniería real para diseñar una solución.

Desde el punto de vista de herramientas de desarrollo para IA, la API de OpenAI es madura, está bien documentada y se integra limpiamente en la mayoría de los stacks.

Ideal para

- Chatbots y asistentes creativos conversacionales.

- Aplicaciones de consumo donde la calidad del prompt de los usuarios finales es impredecible.

- Equipos que quieren la mejor API de imágenes con IA con la menor necesidad de supervisión operativa.

Si tu prioridad es la fiabilidad sobre el límite de resultados, DALL-E 3 se gana su lugar en el stack.

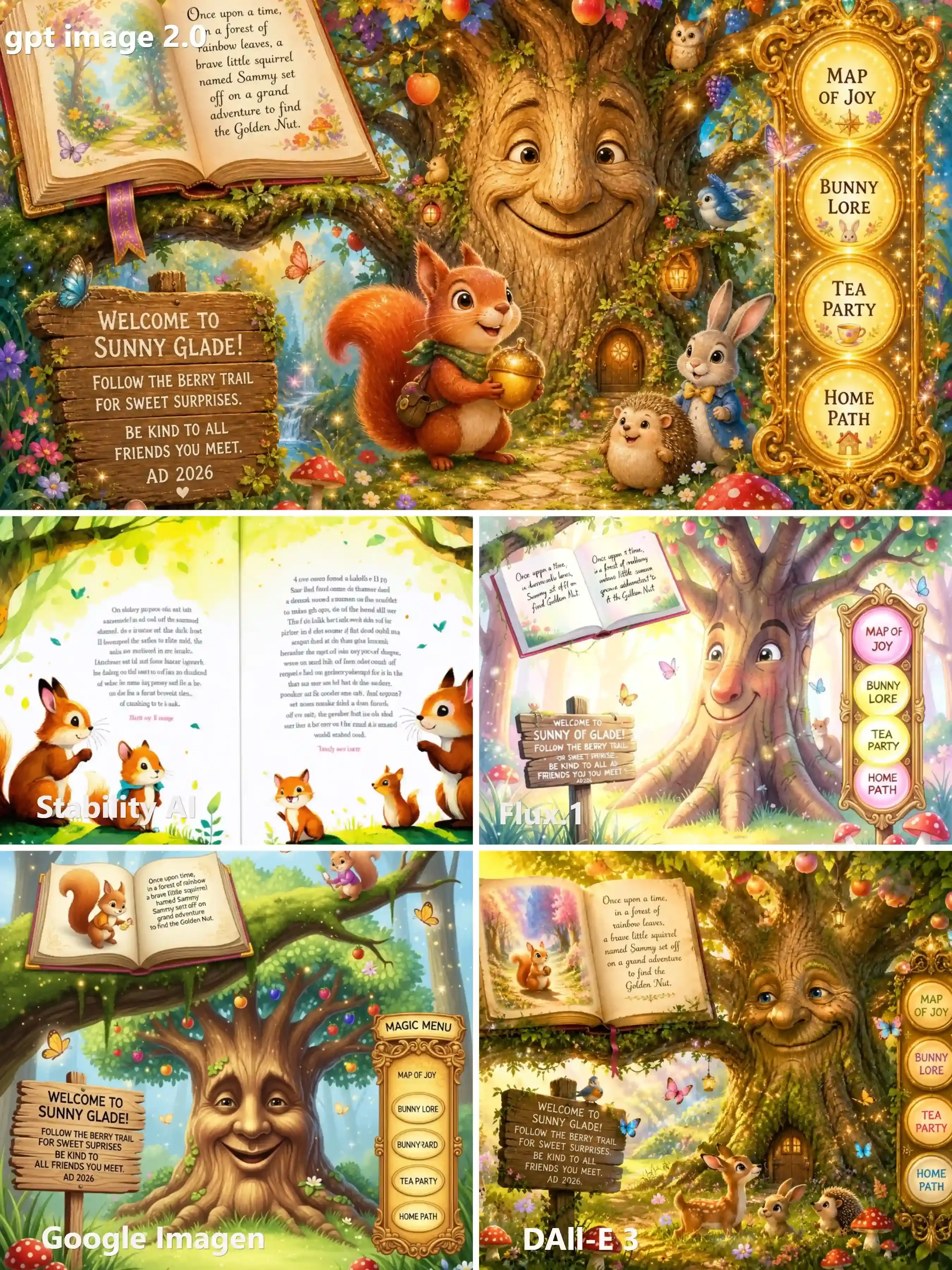

El test de estrés: mismo prompt, cinco modelos

Leer especificaciones solo cuenta la mitad de la historia. La verdadera evaluación de calidad de imagen ocurre cuando ejecutas prompts idénticos en cada modelo y dejas que los resultados hablen por sí mismos. Eso es exactamente lo que hice: dos veces, con dos tipos de prompts muy diferentes.

Prueba 1: El desafío de fotorrealismo + razonamiento espacial

Tema del prompt: Una escena de laboratorio médico futurista con un médico, brazos robóticos, pantallas de diagnóstico y texto de interfaz de usuario legible.

Esta prueba evaluó la composición espacial, el realismo de la iluminación y la precisión del texto en la imagen simultáneamente.

| Modelo | Fotorrealismo | Composición | Legibilidad texto |

| GPT Image 2.0 | ★★★★★ | ★★★★★ | ★★★★★ |

| Stability AI | ★★★★☆ | ★★★★☆ | ★★★☆☆ |

| Flux.1 | ★★★★★ | ★★★★☆ | ★★★★☆ |

| Google Imagen | ★★★★☆ | ★★★☆☆ | ★★★☆☆ |

| DALL-E 3 | ★★★★☆ | ★★★★☆ | ★★★★☆ |

GPT Image 2.0 renderizó "SYSTEM-DIAGNOSTICS v0.2" y "SMART CLINIC" con una claridad casi perfecta. El fotorrealismo de Stability AI impresionó, pero el texto en la pantalla de diagnóstico se veía borroso bajo escrutinio.

Prueba 2: El desafío de renderizado de texto

Tema del prompt: Una escena de libro de cuentos fantástico infantil con un cartel de madera que contiene cuatro líneas específicas de texto y un menú de navegación.

Aquí es donde la mayoría divergen visiblemente.

| Modelo | Precisión texto | Labels menú | Legibilidad total |

| GPT Image 2.0 | ✅ 4 líneas correctas | ✅ 4 correctas | ★★★★★ |

| Stability AI | ❌ Texto distorsionado | ⚠️ Parcial | ★★☆☆☆ |

| Flux.1 | ⚠️ Errores menores | ⚠️ Parcial | ★★★☆☆ |

| Google Imagen | ⚠️ Algunos errores | ⚠️ Parcial | ★★★☆☆ |

| DALL-E 3 | ✅ Mayoría precisa | ✅ Mayoría correcta | ★★★★☆ |

La diferencia es clara. GPT Image 2.0 acertó cada línea —incluyendo "AD 2026"— mientras que la página de cuentos de Stability AI se convirtió en un galimatías de aspecto convincente. Para cualquier flujo de trabajo con herramientas de desarrollo para IA donde importe el texto legible, estos resultados son decisivos.

Mi conclusión: El renderizado de texto sigue siendo el diferenciador más fiable al realizar una comparativa de API real frente a la calidad del resultado. Pagar más por imagen no significa nada si el texto es ilegible.

Matriz de decisión: ¿Con cuál deberías construir?

Tras someter a cada modelo a los mismos prompts y analizar los resultados, quiero ir directo a la pregunta práctica: ¿qué API de imágenes con IA deberías integrar realmente?

La respuesta honesta es que no hay un ganador universal, solo el que mejor encaja en un caso de uso específico. Así es como los clasificaría:

Matriz de decisión rápida:

| Caso de uso | Prioridad | API recomendada | Por qué |

| Alto volumen, sensible a costes | Precio/imagen | Stable Diffusion | El alojamiento propio reduce el coste marginal |

| App de consumo con prompts impredecibles | UX sin fricción | DALL-E 3 | GPT-4 reescribe prompts y limpia errores automáticamente |

| Anuncios fotorrealistas con texto legible | Fidelidad visual | Flux.1 | Realismo y precisión de texto líder en su clase |

| Diseños complejos, diagramas, texto preciso | Razonamiento esp. | GPT Image 2.0 | Seguimiento de instrucciones y renderizado imbatible |

| Industria regulada o stack empresarial GCP | Cumplimiento | Google Imagen | Marca de agua SynthID, controles de seguridad |

Caso de uso A: Máximo volumen, mínimo coste

Si generas miles de imágenes diarias, el coste por imagen se acumula rápido. Stable Diffusion —especialmente autohospedado mediante Replicate o tu propia infraestructura GPU— es la única API de imágenes con IA en esta lista donde el coste marginal puede acercarse a casi cero a escala.

Caso de uso B: Arte hermoso, cero esfuerzo del usuario

Para herramientas creativas orientadas al consumidor donde tus usuarios no son ingenieros de prompts, la mejora automática de prompts de DALL-E 3 elimina el mayor modo de fallo: "basura entra, basura sale".

Caso de uso C: Anuncios fotorrealistas con texto

Los flujos de marketing dependen de la calidad visual y de un copy preciso para la marca. Flux.1 Pro es la respuesta aquí: es simplemente el modelo más fiable que probé para combinar realismo con texto legible y ortográficamente correcto dentro de la imagen.

No hay una sola API de imágenes con IA que domine en cada dimensión. Elige la que sea más débil donde puedas permitirte debilidad, y más fuerte donde tu producto realmente se rompa sin ella.

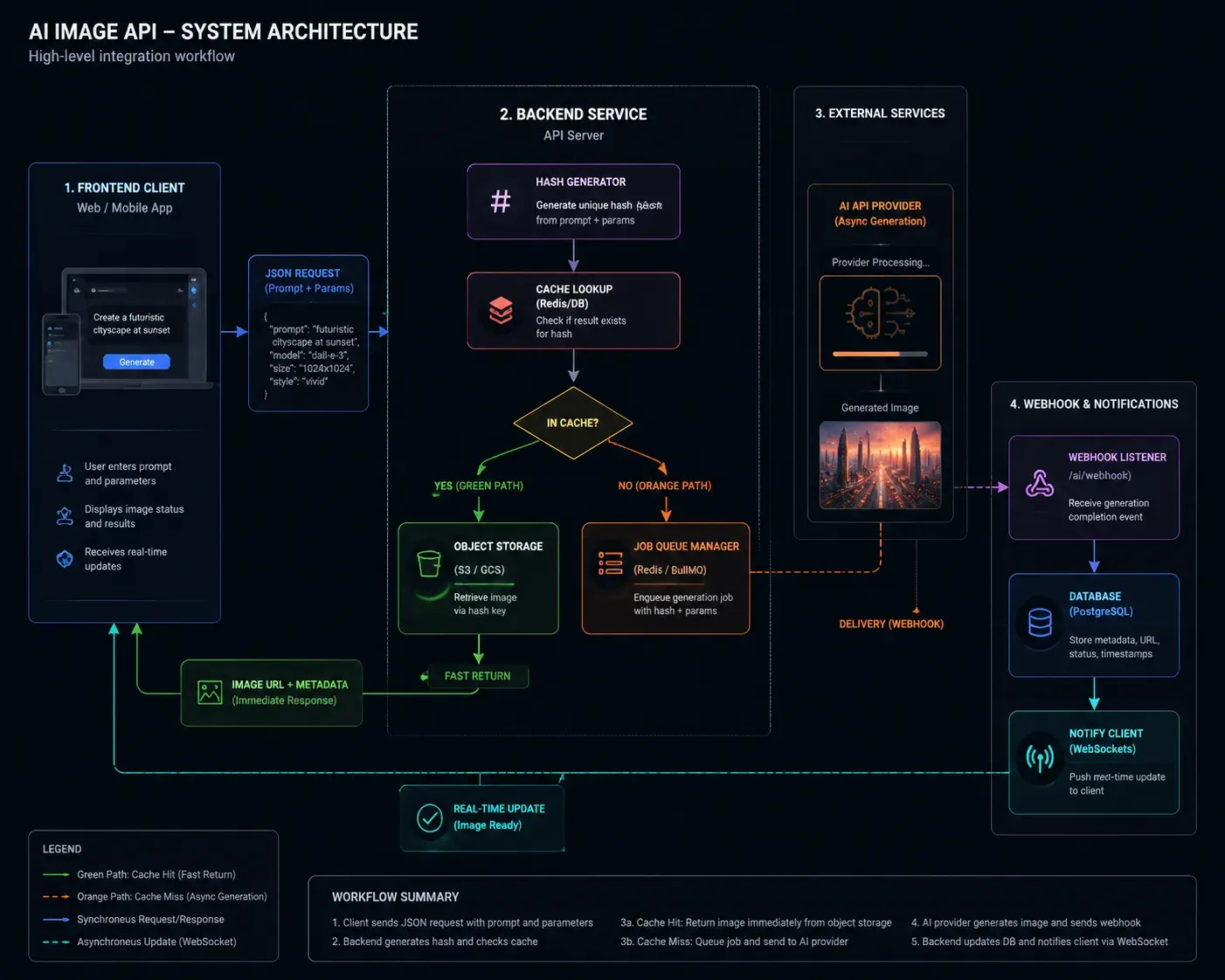

Consejos de integración para desarrolladores

Elegir la API de imágenes con IA correcta es solo la mitad del trabajo. Cómo la integres determina si tu flujo es robusto o un informe de incidentes a las 3 a.m. esperando ocurrir. Esto es lo que aprendí por las malas.

Estrategia de caché: deja de pagar dos veces por la misma imagen

La generación de imágenes es cara y a menudo repetitiva. Si tu app genera visuales de productos, avatares o activos basados en plantillas, un porcentaje significativo de las solicitudes serán semánticamente idénticas.

Mi enfoque recomendado:

- Hash del prompt + parámetros (modelo, resolución, semilla) como clave de caché.

- Almacena resultados en almacenamiento de objetos (S3, GCS) con el hash como nombre de archivo.

- Verifica el caché antes de cada llamada a la API: tasas de acierto de caché del 30–40% son comunes en flujos de producción.

- Configura TTLs basados en el tipo de contenido: activos perennes (más largos), contenido dependiente de tendencias (más cortos).

Este patrón puede reducir tu factura mensual considerablemente sin tocar la calidad del resultado.

Manejo de webhooks: no bloquees por generación asíncrona

La mayoría de los modelos de alta calidad —especialmente Flux.1 Pro y Stable Diffusion en alta resolución— son asíncronos. La generación puede tardar entre 10 y 30 segundos. Bloquear un hilo orientado al usuario en una consulta síncrona es un antipatrón de fiabilidad.

Mejor arquitectura:

- Enviar solicitud de generación → recibir un ID de trabajo.

- Almacenar el ID de trabajo junto a la sesión del usuario en tu BD.

- Manejar la devolución de llamada del webhook para actualizar el estado.

- Notificar al frontend vía WebSocket o SSE cuando esté listo.

Gestión de costes: límites estrictos antes de necesitarlos

Los bucles recursivos —donde una generación fallida reintenta infinitamente— son la fuente más común de facturas inesperadas. He visto entornos de staging acumular cargos de cuatro cifras durante la noche.

Implementa esto antes de salir a producción:

- Límites diarios de generación por usuario impuestos en el lado del servidor.

- Backoff exponencial con un límite máximo de reintentos (3 intentos, no infinito).

- Alertas de gasto al 50%, 80% y 100% de los umbrales del presupuesto mensual.

El framework de evaluación para desarrolladores

Al evaluar cualquier API de imágenes con IA, puntúo cinco dimensiones, no solo la estética del resultado:

| Dimensión | Lo que mido realmente |

| Latencia y throughput | Tiempo hasta el primer byte para una imagen 1024×1024 bajo carga |

| Adherencia al prompt | ¿Sigue instrucciones relacionales de múltiples cláusulas? |

| Facilidad operativa | Calidad del SDK, complejidad de auth, documentación completa |

| Superficie funcional | Inpainting, outpainting, image-to-image, soporte ControlNet |

| Eficiencia de costes | Coste mixto por 1,000 imágenes utilizables (no rechazadas) |

La última métrica es la que más desarrolladores pasan por alto. Una API barata con una tasa de rechazo del 15% por filtros de contenido es más cara en la práctica que una API más cara con rechazos casi nulos, porque estás pagando por generaciones que nunca llegan a tus usuarios.

Construye tu evaluación en torno a realidades de producción, no capturas de pantalla de benchmarks.

Conclusión: el futuro de la API de imágenes

Tras probar cada modelo con prompts idénticos, hojas de cálculo de precios y escenarios de producción, una conclusión sigue apareciendo: ninguna API de imágenes con IA lo gana todo.

La arquitectura más inteligente que estoy viendo en flujos de trabajo maduros no es un compromiso con un solo modelo, sino una capa de enrutamiento multimodelo:

- Flux.1 para activos de marketing fotorrealistas.

- DALL-E 3 para prompts impredecibles de consumidores.

- Stable Diffusion para flujos de alto volumen y sensibles a costes.

- GPT Image 2.0 para diseños de precisión y textos críticos.

- Google Imagen cuando el cumplimiento normativo es innegociable.

Esto no es sobreingeniería. Es tratar la generación de imágenes como los equipos maduros tratan a las bases de datos: la herramienta adecuada para el trabajo adecuado, abstraída detrás de una API interna limpia.

Los modelos seguirán mejorando. Los precios seguirán cambiando. Lo que no cambiará es el valor de haber probado esto tú mismo en lugar de confiar en la página de benchmarks de un proveedor.

Es exactamente por eso que existen las pruebas de estrés en este artículo: prompts reales, resultados reales, diferencias reales. Úsalas para tomar una mejor decisión de construcción que la que tomé yo en mi primer intento.