Seedream4 Models

Seedream v4, a cutting-edge image generation model by ByteDance, redefines creative workflows by combining lightning-fast inference speeds with breathtaking 4K high-definition output. Beyond its raw performance, the model leverages advanced knowledge and reasoning to interpret complex prompts with precision, enabling seamless prompt-based editing and a vast spectrum of versatile artistic styles that make it the ultimate solution for professional design, content creation, and digital marketing.

Explorar Modelos Líderes

Atlas Cloud le proporciona los últimos modelos creativos líderes en la industria.

Qué Hace Destacar a Seedream4 Models

Atlas Cloud le proporciona los modelos creativos líderes en la industria más recientes.

Síntesis de imágenes

Genera imágenes a partir de prompts de texto utilizando los modelos Seedream v3–v4.

Ediciones directas

Refina imágenes mediante el endpoint Seedream v4/edit.

Ediciones secuenciales

Applies step-by-step changes with edit-sequential model.

Salida secuencial

Produce resultados de varios pasos mediante generación secuencial.

Opciones de versión

Ofrece variantes v3, v3.1 y v4 para adaptarse a diferentes necesidades.

Entradas de imagen

Los modelos de edición pueden tomar una imagen existente como entrada y refinarla mediante prompts.

Velocidad máxima

Costo más bajo

| Modalidad | Descripción |

|---|---|

| Seedream v4 API(Text To Image) | La API Seedream v4 permite a los desarrolladores convertir descripciones textuales en impresionantes imágenes de alta fidelidad. Aprovechando una arquitectura de difusión avanzada, genera una única imagen de alta resolución caracterizada por detalles intrincados y precisión artística, ideal para la generación rápida de arte conceptual y activos digitales premium. |

| Seedream v4 Edit API(Image To Image) | Esta API proporciona un control granular sobre la transformación visual, permitiendo a los desarrolladores modificar o reimaginar imágenes existentes mediante guía textual. Produce un resultado único y refinado que equilibra la integridad estructural original con nuevas direcciones creativas, optimizado para el retoque fotográfico profesional y los flujos de trabajo de diseño iterativo. |

| Seedream v4 Sequential API(Text To Image) | La API Secuencial Seedream v4 permite a los creadores generar una serie cohesiva de 1 a 14 imágenes a partir de un único prompt o secuencia narrativa. Al garantizar una estricta continuidad estilística y de personajes en múltiples fotogramas, es la solución principal para el storyboarding rápido, las hojas de diseño de personajes y las colecciones visuales temáticas. |

| Seedream v4 Edit Sequential API(Image To Image) | Diseñada para flujos de trabajo iterativos avanzados, esta API procesa imágenes de referencia para generar una secuencia de 1 a 14 variaciones o evoluciones distintas. Al aplicar ediciones progresivas y cambios estilísticos en todo el lote, proporciona un conjunto versátil de activos optimizados para fotogramas clave de animación cuadro por cuadro y narración visual compleja. |

Nuevas funciones de Seedream4 Models + Showcase

La combinación de modelos avanzados con la plataforma acelerada por GPU de Atlas Cloud ofrece velocidad, escalabilidad y control creativo inigualables para la generación de imágenes y videos.

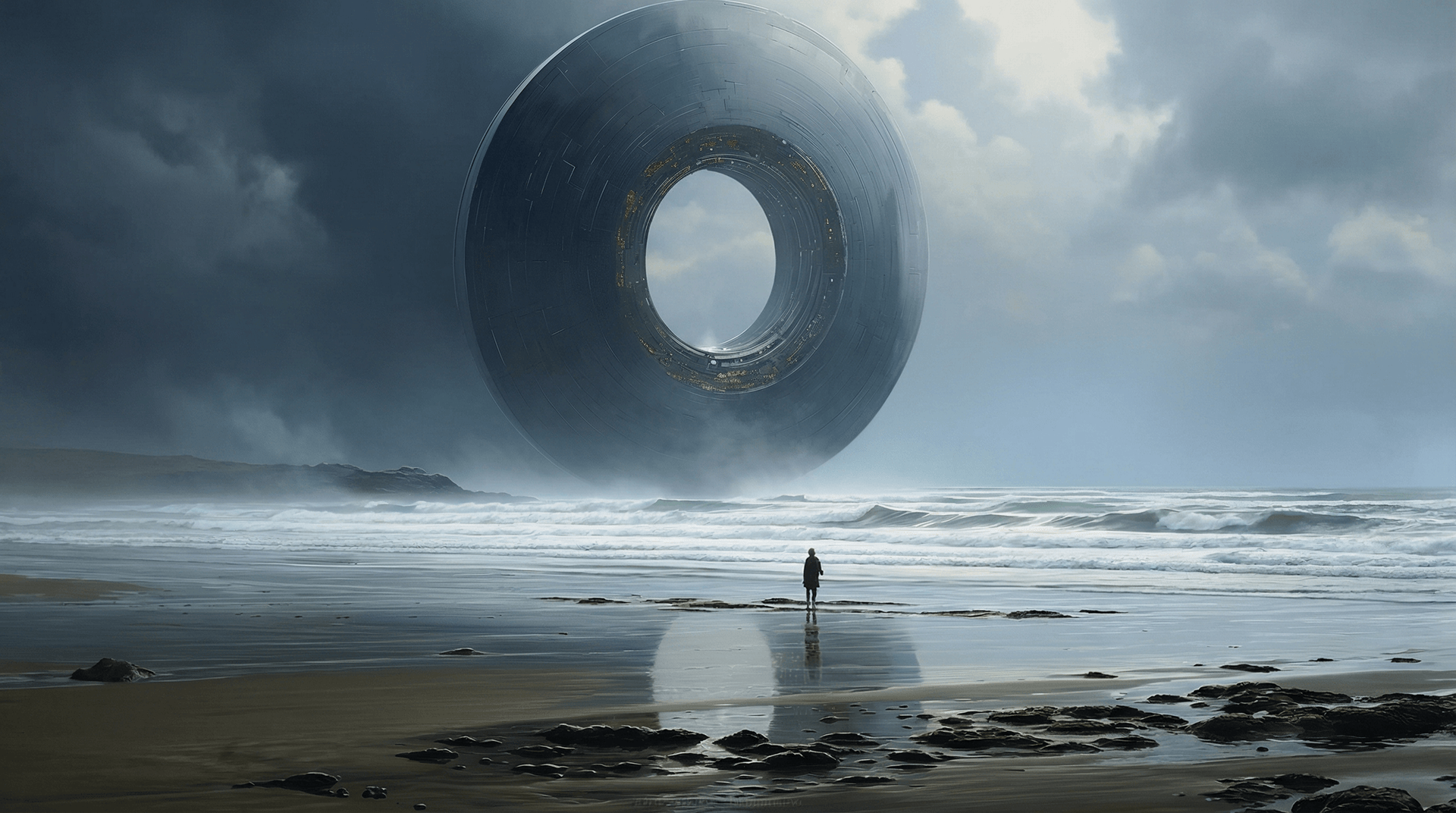

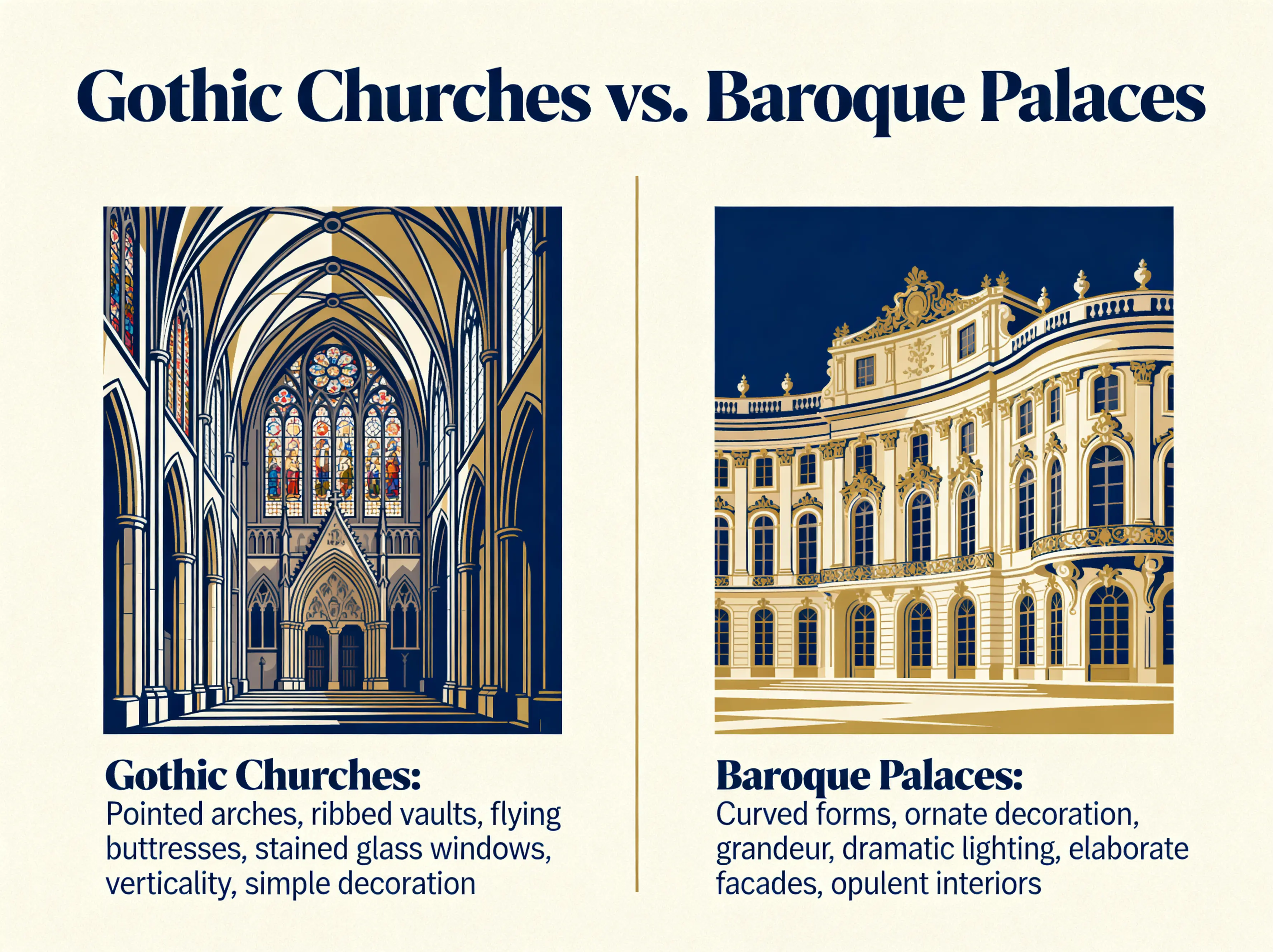

Conocimiento profundo y razonamiento lógico mediante la API Seedream v4

Seedream v4 integra vastos conjuntos de datos semánticos para interpretar prompts complejos con un razonamiento similar al humano y conciencia espacial. Al comprender intrincados matices culturales y leyes físicas, el modelo asegura que cada elemento generado sea contextualmente preciso y lógicamente sólido. Es la solución definitiva para la narración visual, la reconstrucción histórica y los briefs creativos conceptualmente complejos.

Edición de precisión basada en prompts con Seedream v4 API

Seedream v4 permite un control granular sobre los atributos de la imagen mediante comandos de texto intuitivos sin comprometer la composición original. Los usuarios pueden modificar con precisión texturas, iluminación o sujetos específicos, garantizando una consistencia perfecta píxel a píxel en múltiples iteraciones. Es la solución definitiva para el prototipado visual rápido, el retoque comercial profesional y la exploración de diseño dinámico.

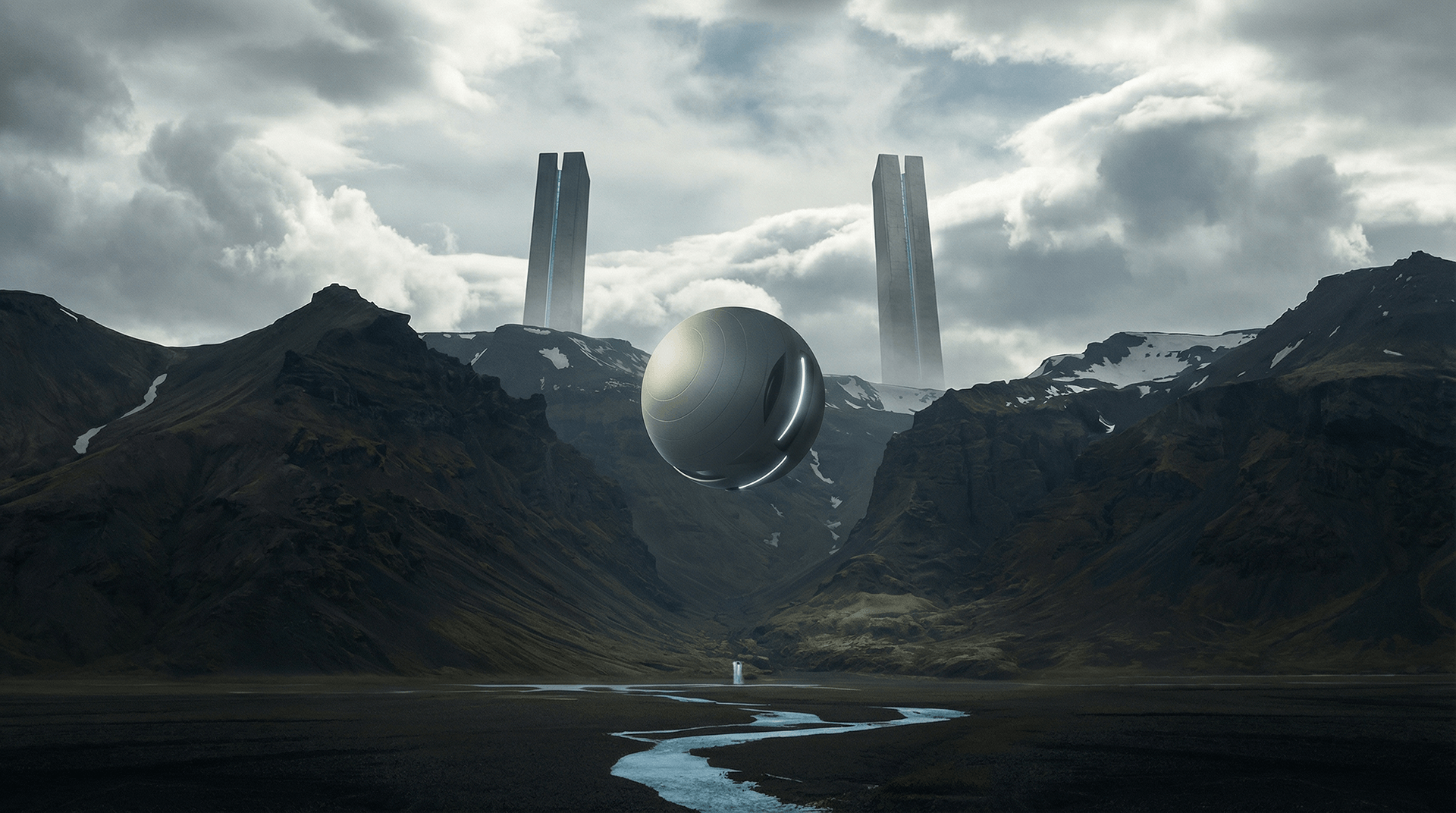

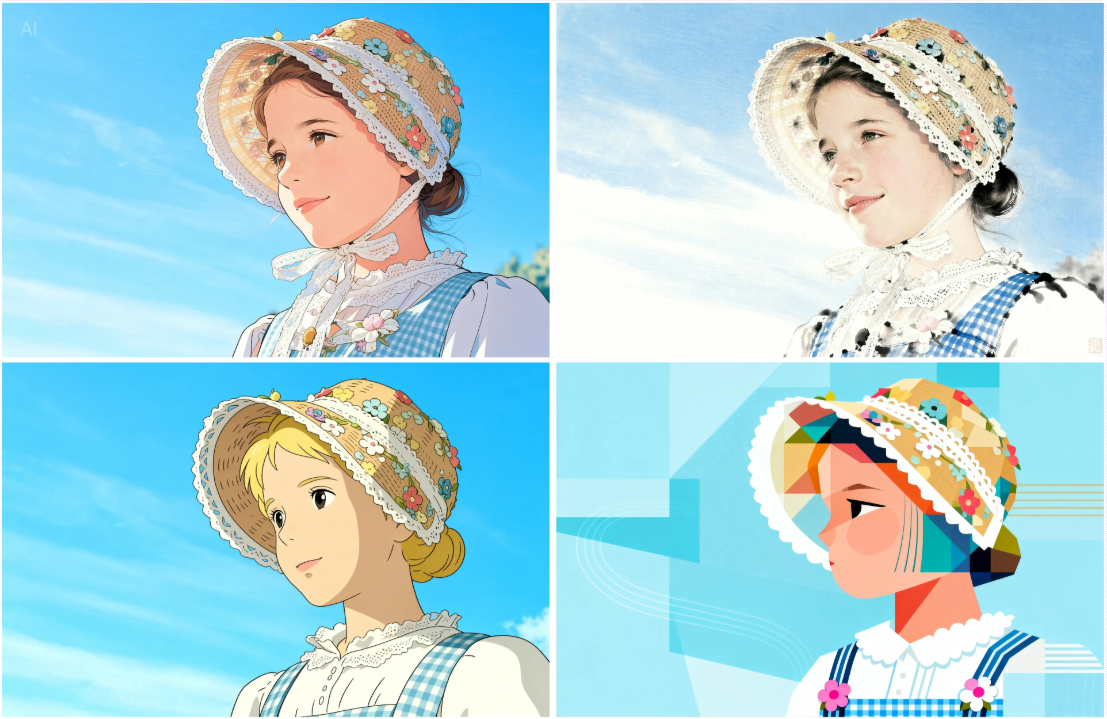

Versatilidad artística infinita con Seedream v4 API

Seedream v4 ofrece una amplia biblioteca de expresiones estéticas, que van desde la cinematografía hiperrealista hasta las ilustraciones digitales de vanguardia. Su arquitectura adaptativa captura el alma de cualquier medio artístico, ofreciendo texturas de alta fidelidad y una gradación de color auténtica para cualquier visión. Es la solución definitiva para diversas campañas de marca, activos de juegos inmersivos y producción de contenido multiplataforma de alta gama.

Qué Puedes Hacer con Seedream4 Models

Descubra casos de uso prácticos y flujos de trabajo que puede crear con esta familia de modelos — desde creación de contenido y automatización hasta aplicaciones de nivel producción.

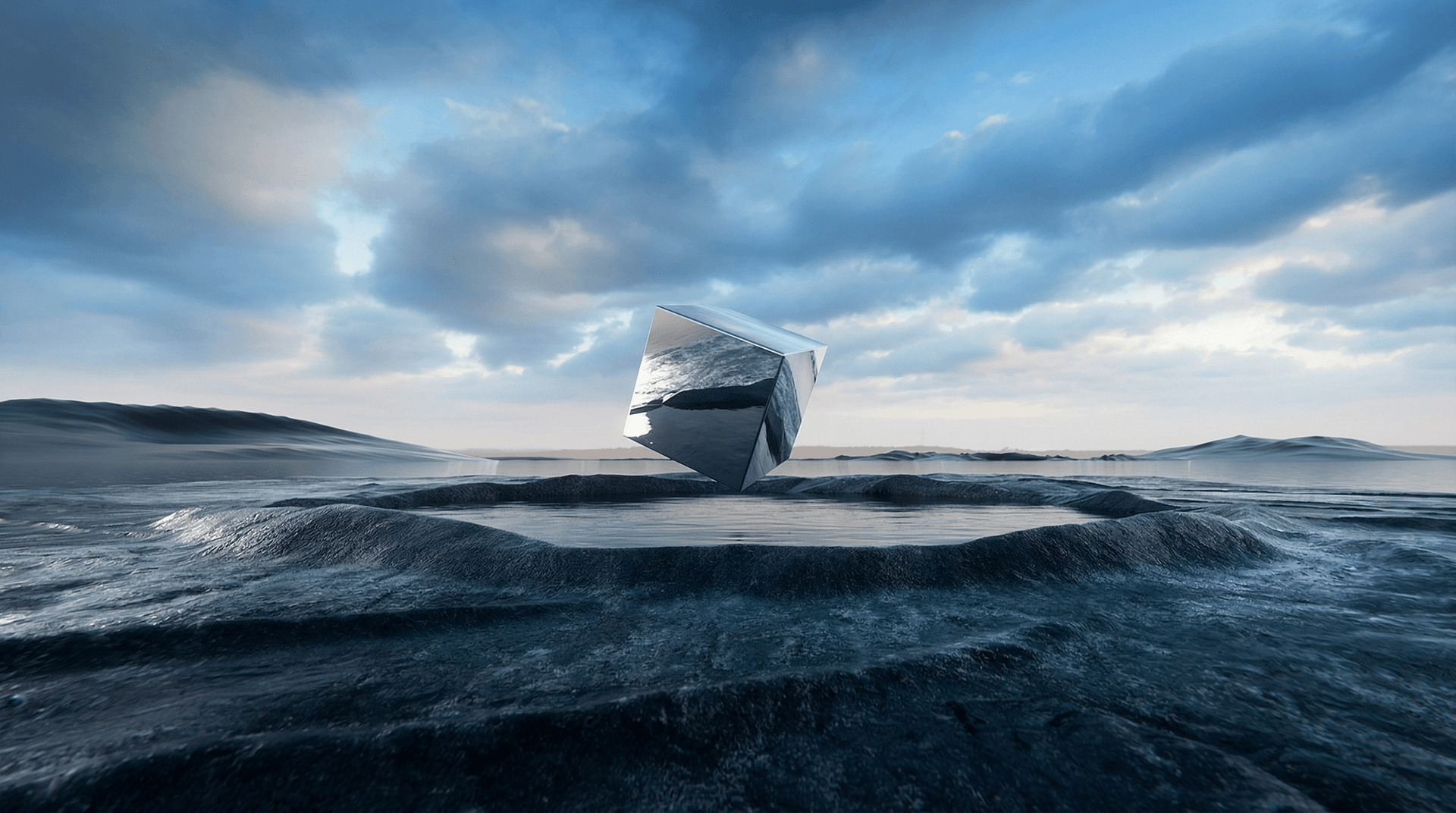

Imágenes de comercio electrónico de alta gama con la API Seedream v4

Seedream v4 permite a las marcas generar instantáneamente imágenes de productos de alta textura, renderizando meticulosamente materiales complejos como metal cepillado, cuero granulado o salpicaduras de líquidos dinámicas. Con una salida nativa en ultra alta definición 4K, el modelo mantiene exquisitas transiciones de luz a sombra y control de profundidad de campo. Es la solución ideal para el marketing de lujo y páginas de detalles de comercio electrónico, logrando resultados de calidad de estudio sin configuraciones de iluminación física.

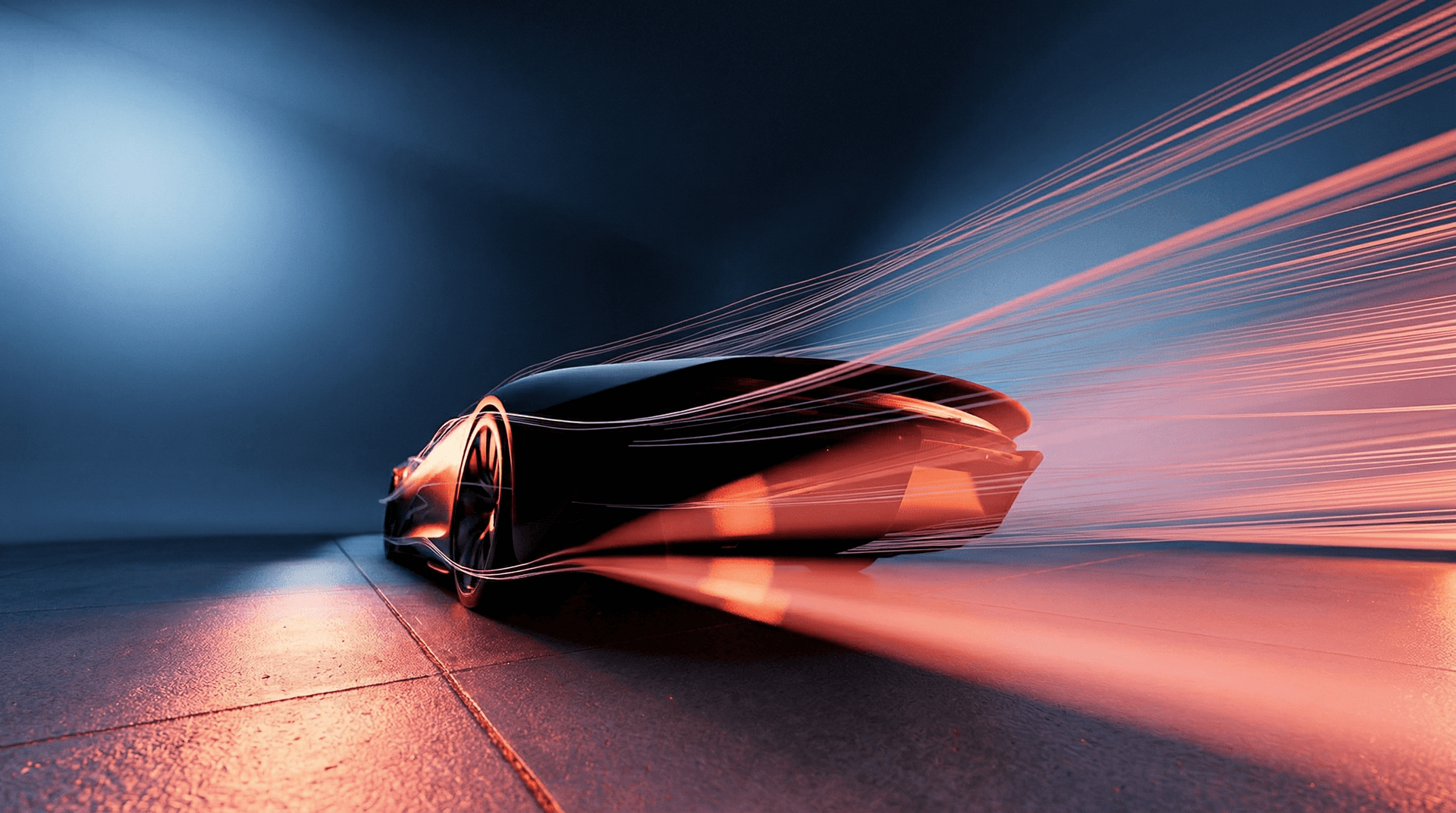

Conceptuación creativa rápida mediante la API Seedream v4

Para las agencias creativas de ritmo acelerado, Seedream v4 aprovecha velocidades de inferencia líderes en la industria para transformar ideas de lluvia de ideas en borradores visuales de alta fidelidad en segundos. Esta generación acelerada acorta significativamente el ciclo de retroalimentación desde el guion hasta el arte conceptual, haciéndolo perfecto para presentaciones publicitarias, tendencias en redes sociales y cualquier campaña de marketing urgente donde la velocidad de entrega es tan crítica como el impacto visual.

Imágenes de impresión de gran formato Ultra-HD con la API Seedream v4

Los visuales generados por Seedream v4 conservan una claridad de píxeles asombrosa incluso cuando se escalan para vallas publicitarias al aire libre, marquesinas de autobús o exhibiciones en galerías físicas. Desde intrincados elementos tipográficos hasta amplios detalles panorámicos, el modelo asegura que cada textura resista una inspección minuciosa. Esto se adapta a cualquier escenario que requiera una resolución inquebrantable para medios visuales offline premium, carteles a gran escala y decoración de interiores.

Comparación de Modelos

Vea cómo se comparan los modelos de diferentes proveedores — compare rendimiento, precios y fortalezas únicas para tomar una decisión informada.

| Modelo | Límite de imágenes de referencia | Número de salidas | Resolución | Relación de aspecto |

|---|---|---|---|---|

| Seedream v4 | 10 | 1~14 | 1024P~4K+ | Width[1024, 4096]px; Height[1024, 4096]px |

| Seedream 4.5 | 10 | 1~15 | 1080P~4K+ | Width[1440, 4096]px; Height[1440, 4096]px |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Wan 2.6 I2I(Image To Image) | 4 | 1 | 580P~1080P+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 9:21 |

How to Use Seedream4 Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Por Qué Usar Seedream4 Models en Atlas Cloud

Combina modelos avanzados de Seedream4 Models con la plataforma acelerada por GPU de Atlas Cloud, proporcionando rendimiento, escalabilidad y experiencia de desarrollo incomparables.

Rendimiento y Flexibilidad

Baja Latencia:

Inferencia optimizada por GPU para respuestas en tiempo real.

API Unificada:

Una sola integración para acceder a Seedream4 Models, GPT, Gemini y DeepSeek.

Precios Transparentes:

Facturación por Token, soporta modo Serverless.

Empresa y Escala

Experiencia del Desarrollador:

SDK, análisis de datos, herramientas de ajuste fino y plantillas todo en uno.

Confiabilidad:

99.99% de disponibilidad, control de permisos RBAC, registros de cumplimiento.

Seguridad y Cumplimiento:

Certificación SOC 2 Type II, cumplimiento HIPAA, soberanía de datos en EE.UU.

Preguntas Frecuentes sobre Seedream4 Models

Admite una salida de hasta 4K ultra HD (4096*4096), lo que garantiza detalles impresionantes para la impresión de gran formato y tareas de diseño de alta precisión.

Seedream v4 ofrece velocidades de inferencia significativamente más rápidas y un razonamiento lógico mejorado, lo que permite una interpretación más precisa de las relaciones espaciales en prompts complejos.

Sí. Seedream v4 cuenta con una potente edición basada en prompts, lo que permite a los usuarios ajustar texturas, iluminación o sujetos específicos mediante simples comandos de texto.

Explorar Más Series

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.