Qu'est-ce que GLM-5.1 ? Le modèle de codage autonome de Zhipu AI

Le modèle GLM 5.1 arrive bientôt sur Atlas Cloud !

- Qu'est-ce que GLM-5.1 : GLM 5.1 est le modèle open source le plus avancé de Zhipu AI, bénéficiant des capacités de programmation les plus solides parmi les modèles ouverts, rivalisant avec Opus 4.6 !

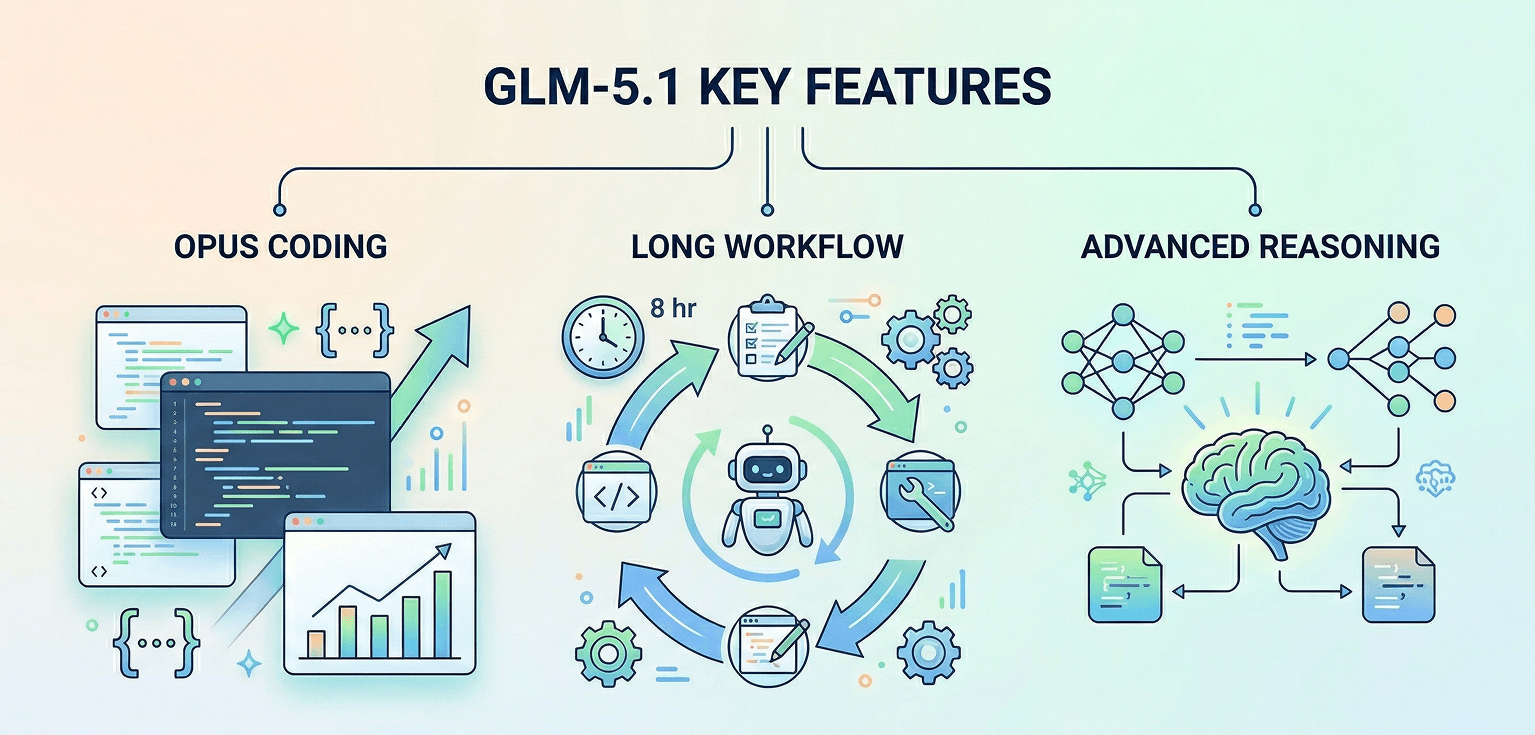

- Fonctionnalités clés : GLM 5.1 offre des capacités de codage de premier ordre. Il automatise les tâches jusqu'à huit heures, avec une résolution de problèmes adaptative pour garantir des flux de travail fluides et des résultats entièrement fonctionnels.

- Date de lancement : Ce mois-ci.

Fonctionnalités principales de GLM-5.1

Performances de codage : Niveau Opus 4.6

GLM-5.1 obtient les meilleurs résultats aux tests de référence (benchmarks) dans les tâches de codage, égalant les performances de Claude Opus 4.6. Il se classe au sommet parmi les modèles open source sur les principaux benchmarks publics.

Comparaison avec Claude 3.5 Sonnet :

- Claude 3.5 Sonnet : Capacités de codage solides, largement adopté pour le développement

- GLM-5.1 : Égale les performances au niveau d'Opus 4.6, prix compétitif

Comparaison avec DeepSeek V3.2:

- DeepSeek V3.2 : Excellent modèle de codage open source avec de larges capacités

- GLM-5.1 : Supérieur sur les benchmarks de codage spécialisés, exécution longue durée unique

Exécution de tâches longue durée : 8 heures d'autonomie

GLM-5.1 va bien au-delà du dialogue classique. Confiez-lui un véritable projet d'ingénierie, et il planifiera le flux de travail, écrira le code, lancera des tests, changera de stratégie en cas de blocage, corrigera les problèmes rencontrés — et continuera de travailler jusqu'à 8 heures pour fournir un résultat complet. Peu de modèles possèdent cette capacité.

Comparaison avec GPT-4o :

- GPT-4o : Excellent pour les conversations multi-tours et les tâches courtes

- GLM-5.1 : Conçu pour une exécution autonome étendue avec gestion d'état

Comparaison avec Qwen2.5:

- Qwen2.5 : Solides performances sur des tâches diverses

- GLM-5.1 : Spécialisé pour les flux de travail d'ingénierie complexes et de longue durée

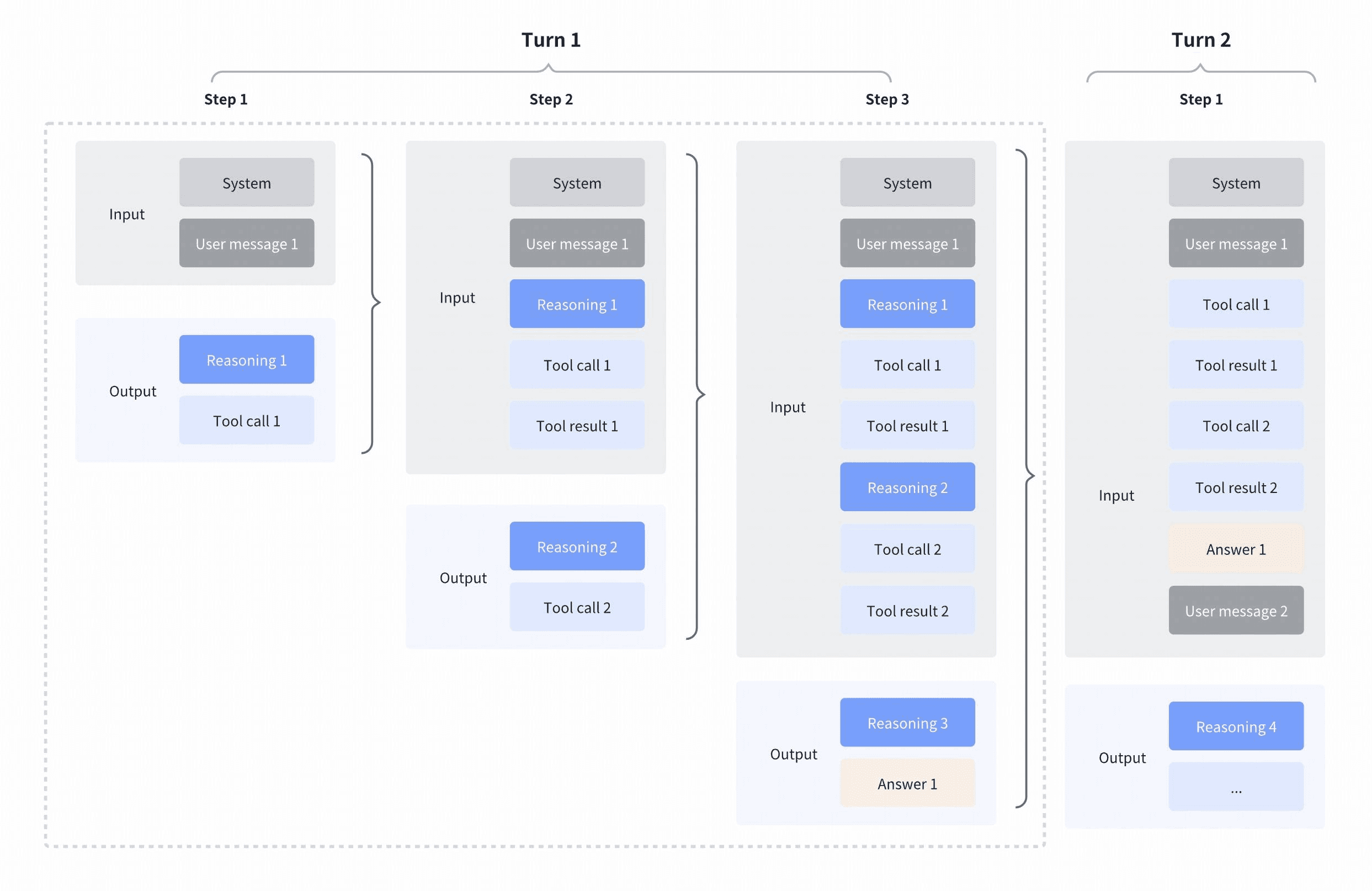

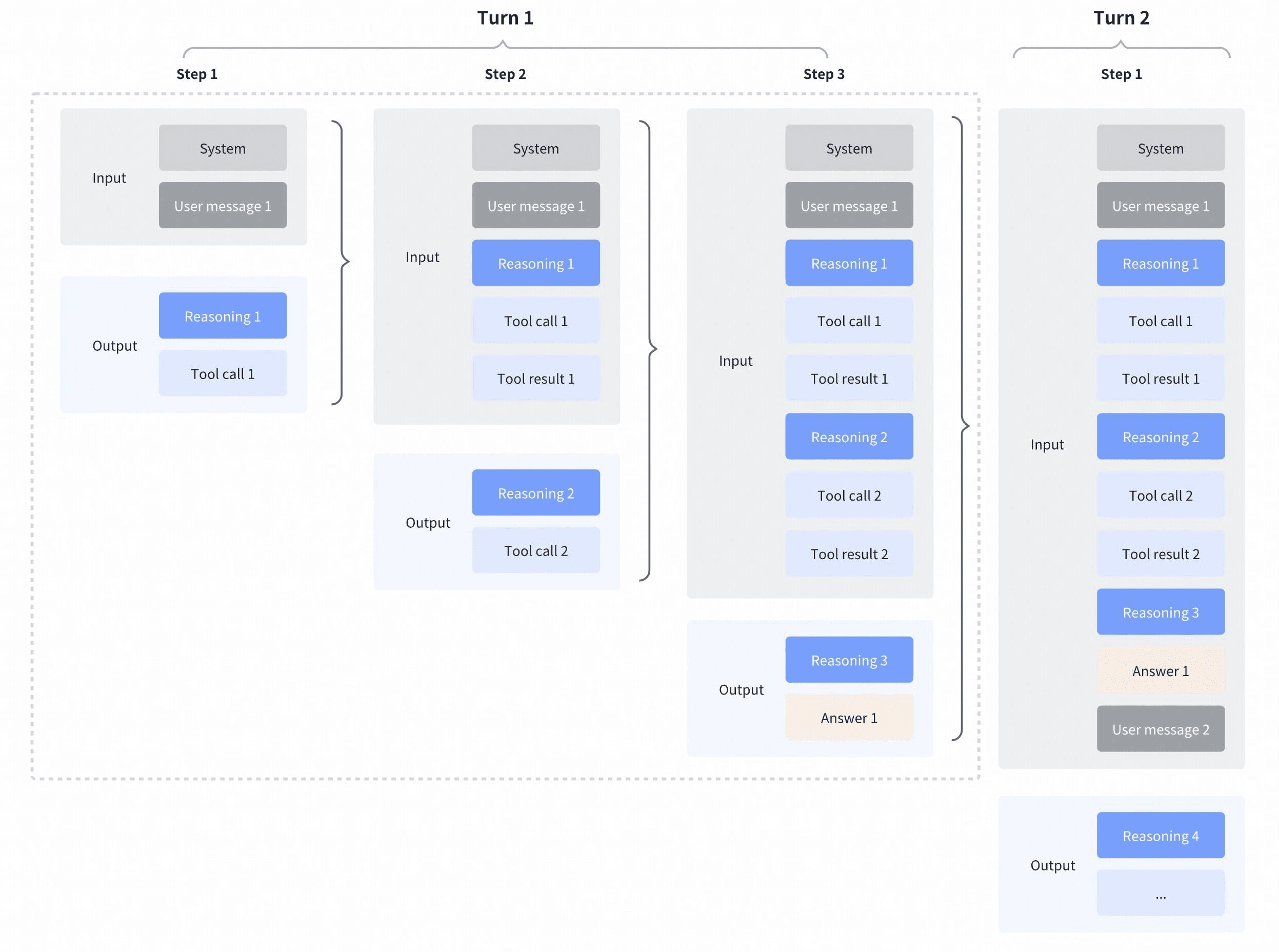

Pensée entrelacée et préservée

- Pensée entrelacée

Permettre à GLM de raisonner entre et après les appels d'outils favorise une réflexion étape par étape : interprétation des sorties, enchaînement des appels et prises de décision précises basées sur les résultats intermédiaires.

- Pensée préservée

GLM-5.1 conserve le raisonnement des tours précédents, assurant la continuité, améliorant les performances, augmentant les taux de mise en cache et économisant des jetons lors de tâches réelles.

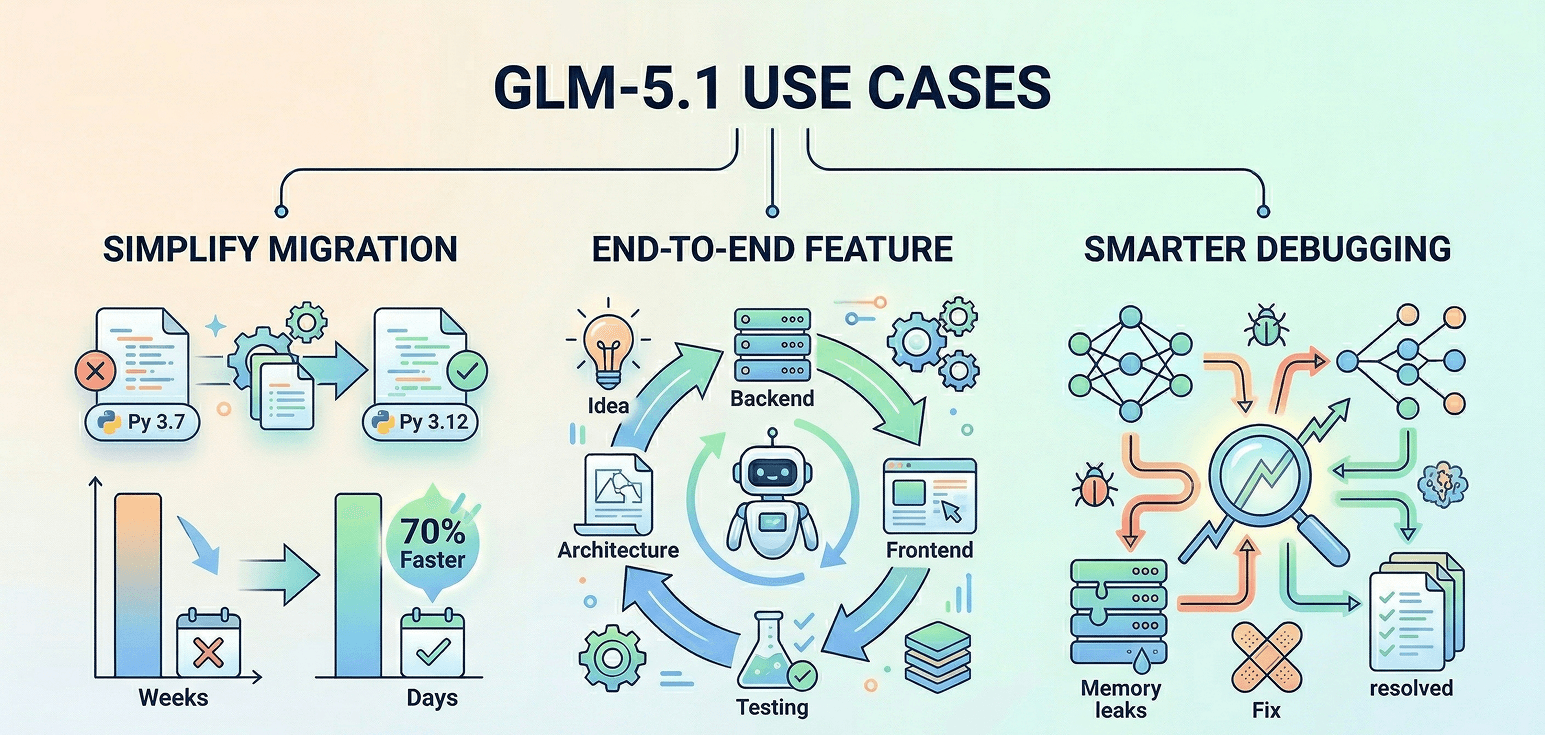

Cas d'utilisation de GLM-5.1 : Migration de code, développement de fonctionnalités, débogage

Simplification de la migration de code

GLM-5.1 prend en charge les tâches de migration de code chronophages, transformant des semaines d'effort en quelques jours seulement. Il examine la base de code, crée une stratégie, modifie les fichiers à grande échelle et effectue des tests approfondis. Cela a rendu les projets courants, comme la mise à jour des versions de Python ou la modernisation des frameworks, jusqu'à 70 % plus rapides et plus faciles.

Développement de fonctionnalités de bout en bout

Des idées initiales aux applications entièrement construites, GLM-5.1 gère l'ensemble du processus. Il planifie l'architecture, construit les systèmes backend et frontend, rédige les tests et gère même la documentation. Sans nécessiter une surveillance constante, il fournit des solutions complètes prêtes à être déployées, incluant la sécurité, les bases de données et les configurations de production.

Débogage plus intelligent

Lorsque des bugs complexes apparaissent dans de grands systèmes, GLM-5.1 effectue le travail difficile. Il trace les problèmes de manière persistante, qu'il s'agisse de conditions de concurrence ou de fuites de mémoire, et applique des correctifs basés sur des tests minutieux. Chaque étape est documentée, laissant aux développeurs des solutions sur lesquelles ils peuvent s'appuyer.

Pourquoi utiliser GLM-5.1 sur Atlas Cloud ?

Qu'est-ce qu'Atlas Cloud ?

C'est une plateforme qui simplifie l'IA en vous donnant accès à plus de 300 modèles de premier plan au même endroit : texte, images, vidéo, et plus encore.

À qui s'adresse-t-elle ?

• Développeurs souhaitant un accès facile et abordable à l'IA. • Équipes gérant des projets nécessitant de l'IA dans plusieurs domaines. • Entreprises ayant besoin d'une IA fiable pour des travaux importants. • Utilisateurs d'outils comme ComfyUI et n8n.

Pourquoi la choisir ?

• Une seule API vous permet de tout utiliser avec une seule clé. • Tarification claire, sans surprises et à faible coût. • Conçue pour l'entreprise : stable, sécurisée et soutenue par des experts. • Fonctionne avec les outils que vous utilisez déjà. • Vos données restent sécurisées et répondent aux exigences de conformité.

Comment se compare-t-elle ?

• Fal.ai : Atlas dispose de plus de modèles et de meilleurs prix. • Wavespeed : Atlas coûte moins cher et inclut un support entreprise. • Kie.ai : Atlas est plus claire sur les tarifs et offre une sélection plus large. • Replicate : Bibliothèque plus petite et coûts plus élevés. • Autres fournisseurs (comme OpenAI) : Atlas combine tout sur une plateforme simple.

Comment utiliser GLM-5.1 sur Atlas Cloud

Atlas Cloud vous permet d'utiliser les modèles côte à côte — d'abord dans un environnement de test (playground), puis via une API unique.

Méthode 1 : Utiliser directement dans le playground Atlas Cloud

Méthode 2 : Accès via API

Étape 1 : Obtenez votre clé API

Créez une clé API dans votre console et copiez-la pour une utilisation ultérieure.

Étape 2 : Consultez la documentation API

Examinez le point de terminaison (endpoint), les paramètres de requête et la méthode d'authentification dans notre documentation API.

Étape 3 : Effectuez votre première requête (exemple en Python)

Exemple : générer une vidéo avec GLM-5-Turbo

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ : Questions fréquemment posées sur GLM-5.1

Q : Comment GLM-5.1 se compare-t-il à Claude 3.5 Sonnet pour le codage ?

R : GLM-5.1 égale Claude Opus 4.6 sur les benchmarks de codage, surpassant Claude 3.5 Sonnet. Sa capacité à gérer des tâches étendues le distingue.

Q : Qu'est-ce qui est différent dans « l'exécution de tâches longue durée » ?

R : Les modèles de chat classiques répondent à des invites individuelles. GLM-5.1, cependant, peut rester concentré sur une tâche jusqu'à 8 heures, en s'adaptant et en s'auto-corrigeant tout au long du processus.

Q : GLM-5.1 est-il open source ?

R : Oui, il est entièrement open source. Développé par Zhipu AI, vous pouvez trouver les détails de licence dans la documentation officielle.

Q : Est-il prêt pour une utilisation en production ?

R : Absolument ! GLM-5.1 offre une fenêtre de contexte de 128K et fonctionne sur l'infrastructure fiable d'Atlas Cloud, le rendant prêt pour la production.

Q : Comment intégrer sa capacité d'exécution de 8 heures ?

R : Pour les tâches longues, utilisez un webhook ou une configuration de polling. Atlas Cloud gère le backend, et votre application reçoit le résultat final une fois terminé.

Q : À quelles tâches GLM-5.1 est-il le mieux adapté ?

R : Il est idéal pour des projets exigeants tels que la migration de code, le débogage de systèmes complexes et le développement logiciel full-stack.