DeepSeek v4 : Tout ce que nous savons jusqu’à présent – Fonctionnalités, date de sortie et comment y accéder sur Atlas Cloud

Introduction : Qu’est-ce que DeepSeek v4 ?

AtlasCloud enrichit son arsenal d'IA générative avec l'arrivée prochaine de DeepSeek v4.

- De quoi s'agit-il : Le tout dernier modèle phare de l'équipe DeepSeek. Si DeepSeek v3.2 définit la norme pour les modèles de codage open-source économiques, la v4 repousse les limites de la logique et de la mémoire grâce aux technologies propriétaires Manifold-Constrained Hyper-Connections (mHC) et Engram Memory.

- Avantage clé : Au-delà de la simple génération d'extraits de code, la v4 agit comme un architecte senior, comprenant des structures de dépôts entières pour un raisonnement inter-fichiers et une correction de bugs complexe.

- Statut : Lancement prochain (prévu mi-février 2026).

Pourquoi sommes-nous convaincus que DeepSeek v4 va changer la donne ? Parce qu'il résout le plus grand problème du secteur : l'IA doit pouvoir retenir et comprendre la logique d'un projet.

📣 Mise à jour — 24 avril 2026 : DeepSeek-V4 est officiellement disponible. Découvrez notre analyse complète de ce qui a été réellement déployé, incluant la nouvelle architecture d'attention creuse (sparse attention), le contexte de 1M de jetons et les résultats des benchmarks sur les agents — dans DeepSeek-V4 Preview Launch.

Analyse technique approfondie : Fonctionnalités clés

Pour défier Claude Opus 4.5, DeepSeek a reconstruit son modèle de zéro. Les documents ayant fuité indiquent un changement fondamental dans la manière dont le modèle gère la mémoire et la stabilité logique. Analysons les quatre piliers de cette mise à jour.

Architecture : Un raisonnement logique supérieur

-

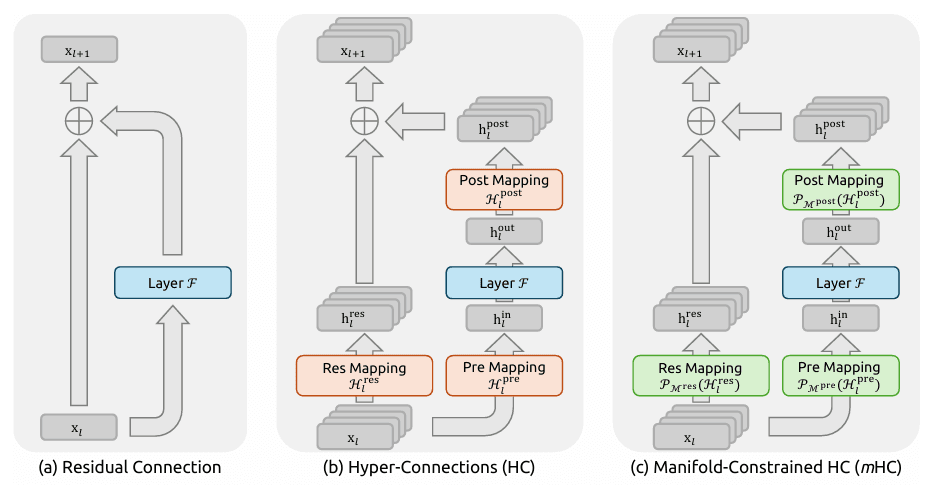

Manifold-Constrained Hyper-Connections (mHC)

- Le concept : DeepSeek v4 invente une nouvelle méthode de « câblage neuronal ». Les connexions traditionnelles perdent souvent des informations dans les réseaux profonds, mais le mHC agit comme une « autoroute logique » pour le cerveau de l'IA.

- Le résultat : Lors du traitement de logiques massives et complexes (comme le refactoring de milliers de lignes de code), le modèle apprend plus vite et conserve mieux la logique. Cela élimine les « hallucinations logiques » et les incohérences fréquentes lors de générations à long contexte.

Efficacité : Réduction des coûts d'inférence

-

Mixture-of-Experts (MoE) 2.0

- Le concept : Bien que la v4 soit un géant en termes de paramètres (centaines de milliards), elle utilise une architecture MoE optimisée pour n'activer que les « experts » les plus pertinents pour chaque jeton.

- Le résultat : Elle trouve un équilibre parfait entre haute capacité (base de connaissances massive) et mise à l'échelle efficace (fonctionnement aussi fluide qu'un modèle plus petit).

-

Sparse Attention

- Le concept : En abandonnant la méthode de force brute consistant à scanner tout le texte, le modèle se concentre désormais intelligemment uniquement sur les informations clés. Cela réduit considérablement les coûts de calcul et accélère le traitement des contextes longs.

Mémoire : Gestion intelligente du contexte

-

Engram Memory (Stockage et rappel sélectifs)

- Le concept : L'IA arrête le simple apprentissage par cœur pour commencer à « comprendre ». Elle reconnaît les structures de projet, suit les conventions de nommage (snake_case vs camelCase) et identifie les modèles de codage (imitant les structures spécifiques de votre équipe).

- Le résultat : Elle code comme un développeur expérimenté.

-

Multi-Head Latent Attention (MLA)

- Le concept : Considérez cela comme une « sténographie avancée ». Là où d'autres modèles ont besoin de 100 jetons pour stocker une information, le MLA la compresse en 10 symboles clés.

- Le résultat : Lorsque le rappel est nécessaire, le modèle reconstruit mathématiquement le sens original sans perte. Cela permet de conserver une précision incroyable avec une utilisation de la VRAM nettement inférieure.

Application : Ingénierie réelle

- Compréhension au niveau du dépôt & Correction de bugs

- L'objectif n'est pas seulement d'écrire une fonction, mais de maîtriser le code source. Dans les tests SWE-bench, DeepSeek v4 vise à résoudre plus de 80,9 % des problèmes complexes du monde réel en comprenant les dépendances inter-fichiers.

Cas d'usage : Réduire les coûts et booster l'efficacité

DeepSeek v4 est conçu pour une ingénierie exigeante. Voici comment il se compare à la concurrence :

Refactoring de code hérité (Legacy)

Pour les systèmes hérités chaotiques et sans documentation, l'architecture mHC est une bénédiction. Elle retrace les dépendances logiques à longue distance pour un refactoring sécurisé.

- VS GPT-4o : GPT-4o souffre souvent d'« hallucinations logiques » (invention d'appels de fonctions inexistants) lorsque le contexte dépasse 10 000 jetons. DeepSeek v4 maintient une cohérence logique totale sur des contextes longs.

- VS Claude 3.5 Sonnet : Bien que Sonnet soit de haute qualité, il est lent et coûteux pour des tâches de refactoring massives. L'architecture MoE de DeepSeek v4 offre des vitesses d'inférence ~40 % plus rapides à un coût inférieur sur Atlas Cloud.

Développement de fonctionnalités au niveau du dépôt

Lors de l'ajout d'une nouvelle API à un projet mature, la v4 utilise la « Engram Memory » pour saisir instantanément le contexte.

- VS Autocomplete traditionnel : Les outils standards ignorent souvent les normes spécifiques au projet, introduisant des incohérences de style. DeepSeek v4 imite votre base de code existante si bien qu'on dirait un copier-coller de votre meilleur développeur.

Suivi de bugs sur toute la chaîne

Viser un taux de réussite de 80,9 % sur SWE-bench signifie gérer des bugs qui s'étendent du frontend au backend en passant par les bases de données.

- VS Claude Opus 4.5 (attendu) : Opus 4.5 sera probablement puissant mais facturé au prix fort. DeepSeek v4 offre des performances quasi-SOTA à un prix permettant des boucles itératives de « réflexion et correction » sans exploser le budget.

📉 Le bilan : ROI pour les équipes

Pour les startups et les équipes de développement, le duo DeepSeek v4 + AtlasCloud offre un ROI tangible :

- Productivité : Réduction du temps de codage des développeurs seniors de 30 à 50 %.

- Coût : Comparé à la location de serveurs doubles RTX 4090 ou au paiement d'API propriétaires, l'API intégrée d'AtlasCloud peut permettre aux équipes d'économiser plus de 60 % sur les coûts de calcul globaux.

La limite matérielle : Héberger localement ? Réfléchissez à deux fois.

Vous pourriez être tenté d'exécuter ce « dieu du codage » sur votre machine locale. Mais une mise en garde s'impose : la performance a un prix.

- Entrée de gamme minimale : doubles RTX 4090

- Traduction : Vous achetez deux des GPU grand public les plus chers du marché pour les coupler. Le coût des GPU seuls équivaut environ à 3x iPhone 17 Pro Max (ou une bonne voiture d'occasion).

- Recommandé : RTX 5090 simple (Flagship 2026)

- Traduction : C'est la « Ferrari » des GPU. Non seulement le prix sera exorbitant à cause des revendeurs, mais la disponibilité sera limitée.

Avec des prix de GPU qui restent élevés, posez-vous la question : vaut-il la peine de dépenser des milliers d'euros et de gérer le bruit des ventilateurs, la chaleur et la configuration de l'environnement juste pour exécuter un seul modèle ?

La solution intelligente : Accès Jour 0 sur Atlas Cloud

Vous n'avez pas besoin d'être riche pour utiliser DeepSeek v4 ; vous devez être malin. Plutôt que d'acheter des « briques électroniques » qui se déprécient, choisissez le cloud.

AtlasCloud est prêt pour le lancement :

-

Notre promesse : Profitez de vos vacances. Laissez-nous faire le sale boulot du déploiement. Nous surveillons les canaux de sortie officiels 24h/24 et 7j/7.

-

Avantages principaux :

- Accès instantané : Dès que les poids open-source sont publiés, notre intégration API est activée.

- Zéro barrière : Pas de matériel coûteux, pas d'enfer de dépendances CUDA. Apportez simplement votre prompt.

- Expérience sans compromis : Nous offrons une prise en charge complète du contexte, garantissant que le mécanisme de mémoire « Engram » fonctionne à 100 % de sa capacité sans perte due à la quantification.

Comment l'utiliser sur Atlas Cloud

Atlas Cloud vous permet d'utiliser les modèles côte à côte — d'abord dans un playground, puis via une API unique.

Méthode 1 : Utilisation directe dans le playground Atlas Cloud

Méthode 2 : Accès via API

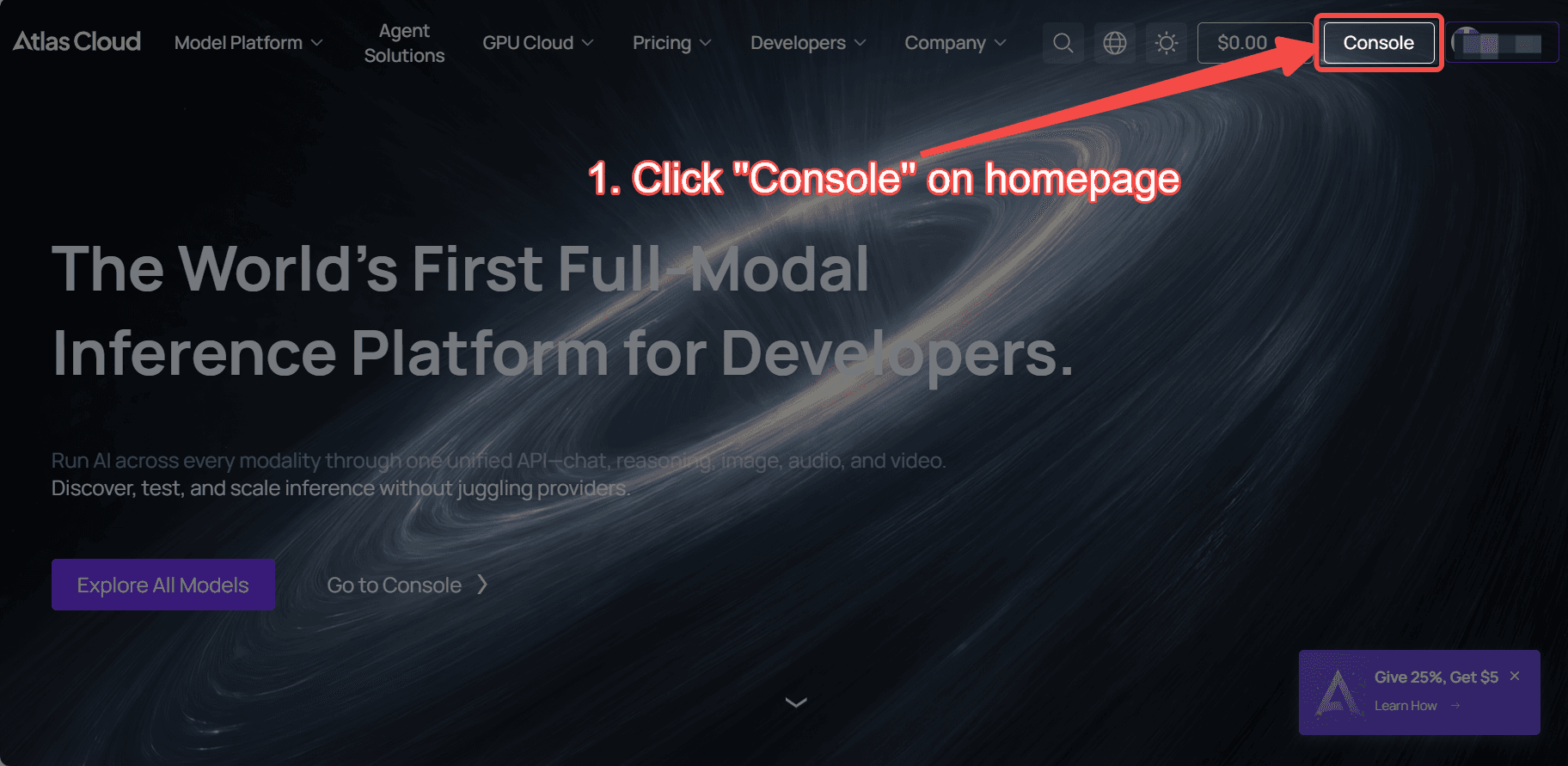

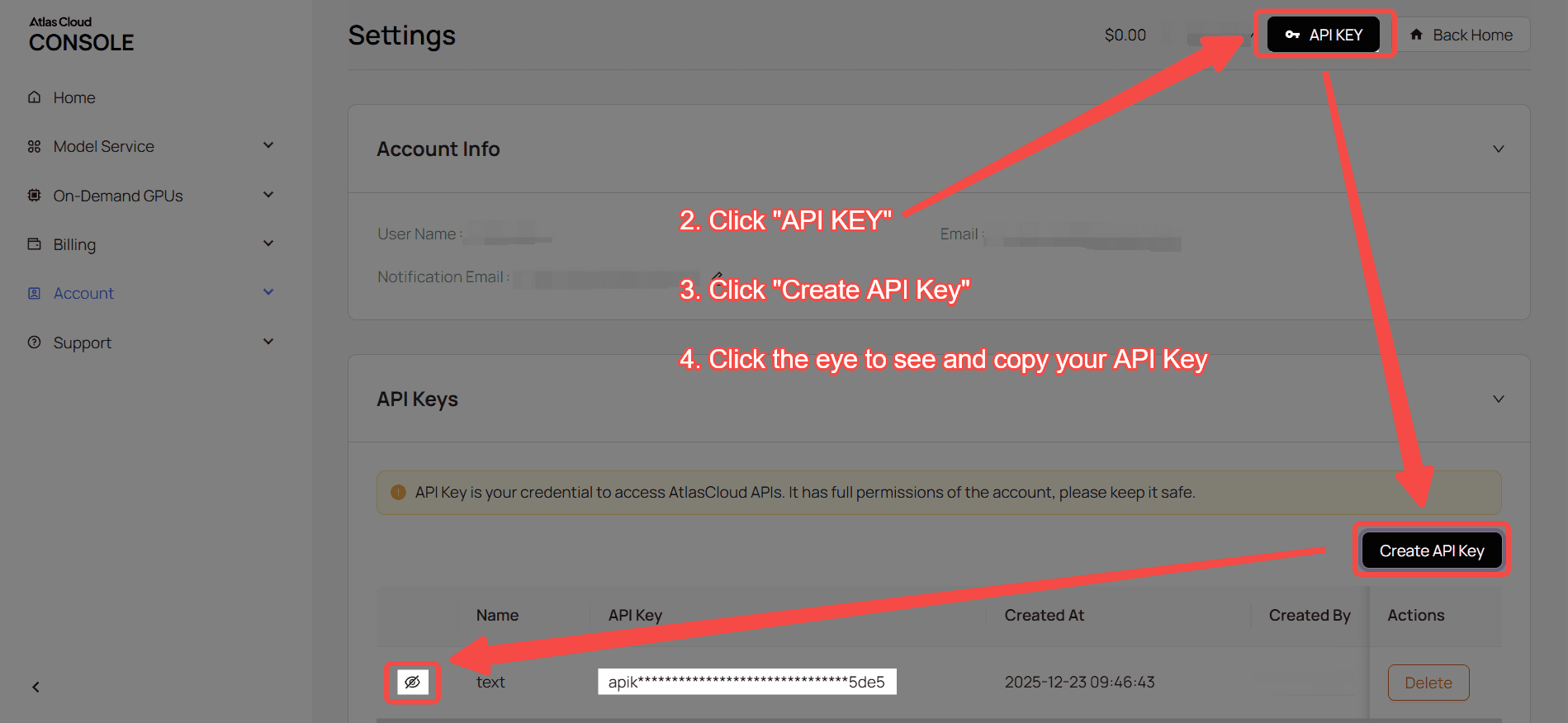

Étape 1 : Obtenez votre clé API

Créez une clé API dans votre console et copiez-la pour une utilisation ultérieure.

Étape 2 : Consultez la documentation API

Examinez le point de terminaison (endpoint), les paramètres de requête et la méthode d'authentification dans notre documentation API.

Étape 3 : Effectuez votre première requête (exemple en Python)

Exemple : générer une réponse avec DeepSeek v3.2 :

python1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "deepseek-ai/deepseek-v3.2", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "quelle est la différence entre http et https" 14 } 15 ], 16 "max_tokens": 32768, 17 "temperature": 1, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())