概要: Zhipu AI (Z.ai) が開発したGLM-5-Turboは、OpenClawユースケース向けに設計された大規模言語モデルであり、同社初のクローズドソースリリース(以前はコードネーム「Pony-Alpha-2」としてテストされていたもの)です。まもなくAtlas Cloudで提供開始予定です。

このモデルは、ツール利用、命令実行、マルチステップワークフロー、および長期間のタスク処理において大幅な改善を実現し、最大200Kトークンのコンテキストウィンドウをサポートしています。データ分析能力はClaude Opus 4.6に匹敵し、自動化や情報処理タスクにおいてはGLM-5を上回ります。Atlas Cloudの統合APIとマルチモデルエコシステムを活用することで、GLM-5-Turboは複雑な業務自動化、長文ドキュメント分析、ソフトウェア開発全般にわたる効率的なデプロイを可能にし、開発者や企業向けに費用対効果が高く容易に統合できるAIソリューションを提供します。

GLM-5-TurboがAtlas Cloudに登場することをお知らせいたします!

- GLM-5-Turboとは:Zhipu AI (Z.ai) が開発したGLM-5-Turboは、OpenClawユースケースに特化した大規模言語モデルです。同チーム初のクローズドソースリリースであり、GLM-5と比較してランタイム効率が高く、1コールあたりのコストを抑えられます。これに先立ち、Zhipu AIは次世代モデルをコードネーム「Pony-Alpha-2」として試験運用していました。

- 主な機能:GLM-5-Turboは、ツール利用、指示への追従、マルチステップワークフロー、持続的なタスク実行において大幅な改善を実現しました。さまざまなシナリオにわたる動的な推論モード、リアルタイムストリーミング出力、ツール連携の強化、最大200Kトークンの長文コンテキスト処理をサポートしています。

- リリース日:2026年3月24日

GLM-5は以前、Artificial Analysis Intelligence IndexにおいてGemini 3 Proを凌駕する最高性能のオープンソースモデルとして注目を集めました。その次世代モデルであるGLM-5-Turboでは、以下の通り一連のアップグレードが導入されています。

中心となる位置付け:ClawBenchに最適化されたモデル

強力なベンチマーク性能

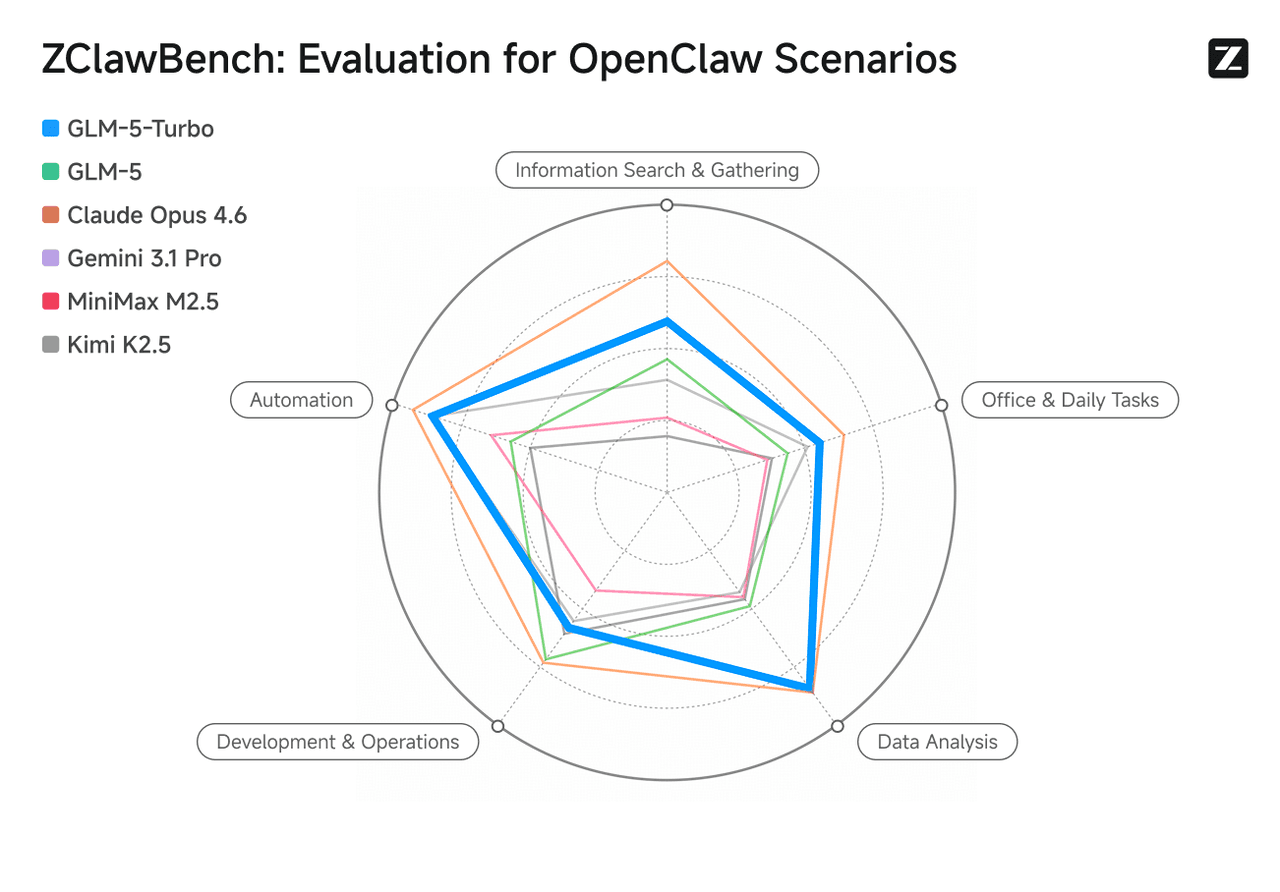

OpenClawシナリオに最適化されたGLM-5-Turboは、ツールの呼び出し、命令実行、複雑なタスクオーケストレーションの能力を大幅に強化しています。データ分析性能はClaude Opus 4.6と同等であり、自動化、情報検索、オフィス生産性、分析タスクにおいてGLM-5を上回ります。

画像出典:Zhipu AI (Z.ai) 公式サイト

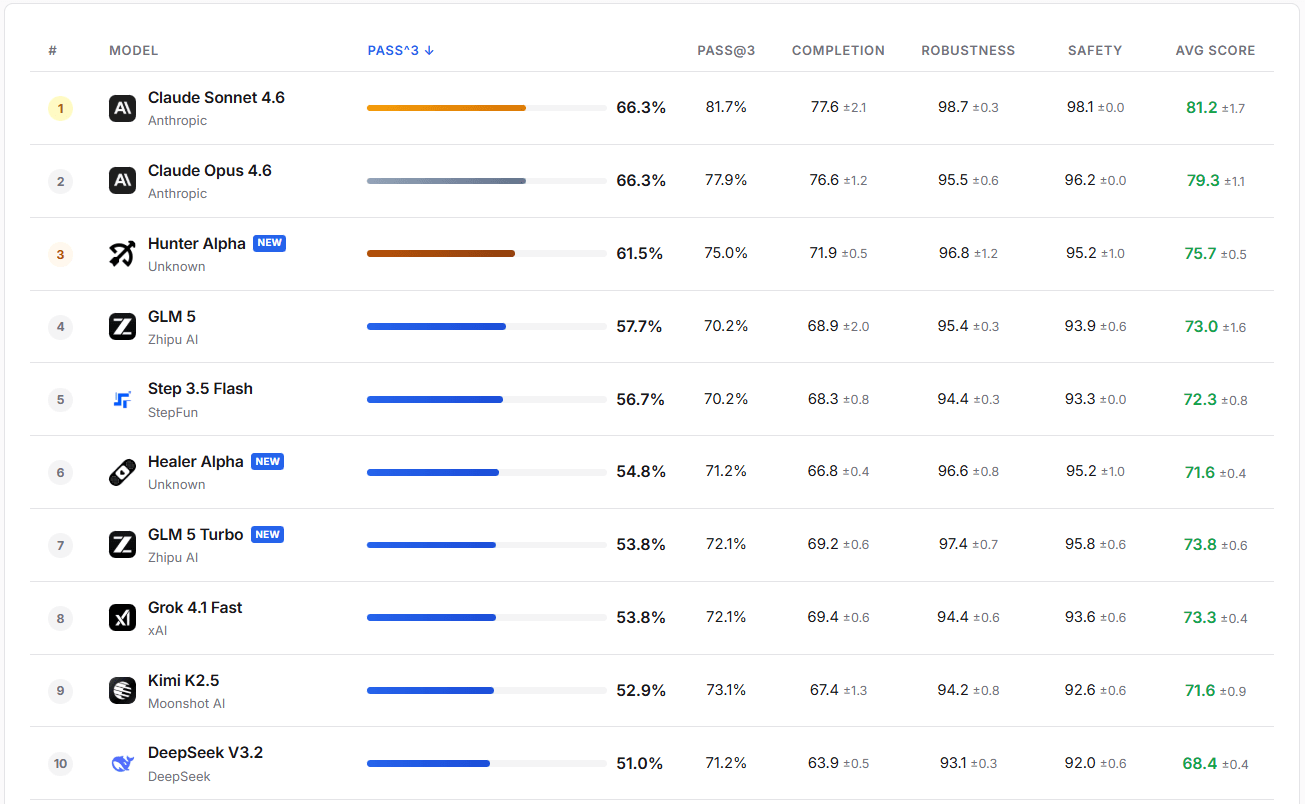

実評価において、GLM-5-Turboは高い堅牢性と安全性を示しています。そのPASS@3成功率は、GLM-5、Step 3.5 Flash、およびKimi K2.5を超えています。

画像出典:https://claw-eval.github.io/

ツール利用と外部連携の強化

Z.aiはトレーニング過程でGLM-5-Turboのエージェント機能を強化し、外部ツールとのシームレスな対話を実現しました。この実行優先の姿勢にはトレードオフもあり、ロールプレイングシナリオにおいてGLM-5と比較するとやや機械的な口調であるとの報告もあります。

各モデルの強みに対応するため、Atlas Cloudは統合インターフェースを提供しており、ユーザーは複数のモデルに同時にクエリを投げ、並行して比較・選択することができます。

さらに、ユーザーはカスタムスキルを定義したり、GLM-5-Turboに自律的にスキルを発見・インストールさせたりすることも可能です。

画像出典:Atlas Cloud

長期自律実行能力

GLM-5-Turboは、スケジュールトリガーや長時間の実行が必要なタスクに最適化されています。持続的なマルチステージのワークフローや、時間軸を跨ぐタスクにおいて優れた継続性を発揮します。

モデルはタスクの複雑性に応じて実行戦略を積極的に提案します。コード最適化の比較テストでは、GLM-5-Turboは他のモデルと比較して約10%のケースで優れた推奨結果を出しました。

200Kトークンのコンテキストウィンドウ

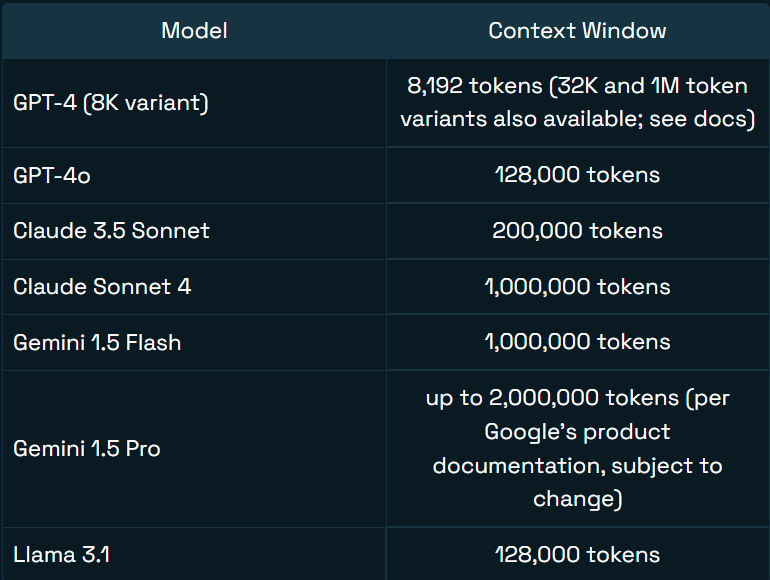

最大200Kトークン(約13万3000語の英語に相当)をサポートしており、単一のセッション内で広範囲のコンテキストを保持・活用できます。これにより、会話の後段であっても初期の情報に対して正確な参照が可能です。

画像出典:Jim Allen Wallace (Redis)

ユースケース

複雑なワークフローの自動化

強化されたOpenClaw能力により、GLM-5-Turboは複雑なビジネスプロセスを分解し、根本的なロジックを特定して、タスク実行に必要なスキルを自律的に検索または生成できます。

例えばショート動画制作において、ライティング、画像生成、動画生成ツールを検索・インストールし、全体的なワークフローを計画・実行まで完遂させることが可能です。

長文ドキュメントQAと詳細分析

単一セッション内で長文ドキュメント全体のコンテキストを保持できるため、精度の高いマルチターン形式の質疑応答が可能です。トークン効率が高く、計算コストを抑えつつ高速な応答を実現します。

大規模なコードベースにおいては、アーキテクチャ設計を分析し、コンポーネント間の依存関係をマッピングし、低レベルなコード変更が引き起こす可能性のある連鎖的な影響を警告することも可能です。

「バイブコーディング」

ソフトウェア開発ライフサイクルにおいて、GLM-5-Turboは複雑なワークフローに組み込まれたフルスタックエンジニアのように機能します。開発者が高レベルなロジックの概要を伝えれば、モデルがリアルタイムでアプリケーションのアーキテクチャを段階的に構築していきます。

マルチモーダルスキルと組み合わせることで、UI画像、画面録画、またはスケッチをアップロードすれば、モデルがそれを直接機能するフロントエンドコンポーネントに変換することも可能です。

なぜAtlas CloudでGLM-5-Turboを使うのか?

オールモーダルAIインフラプラットフォームであるAtlas Cloudは、ユーザーに統一されたAPIインターフェースを提供します。接続すれば、テキスト、画像、動画の生成やマルチモーダルモデルを含む300以上の高度なAIモデルを容易に利用できます。

ターゲット層

- 独立系開発者: さまざまなAIモデルを低コストかつシンプルな方法で呼び出したい方。

- 企業: 中核事業を支えるための安定性、セキュリティ、拡張性を備えたインフラを必要とする企業。

- 開発チーム: 複数のクロスモーダルモデルを効率的にプロジェクトに統合する必要があるチーム。

- ワークフローユーザー: ツールチェーンの互換性を重視し、ComfyUIやn8nを活用している方。

製品の特長

- 統合の大幅な簡素化: OpenAI互換のAPIを提供しており、開発者の作業負荷を即座に軽減します。複数のベンダーキーを管理したり、プラットフォームごとのメンテナンスコストに悩まされることはありません。

- コストメリット: 競合他社と比較してデプロイコストが抑えられています。Nano Banana 2は$0.056/画像(競合:$0.07/画像)、Veo 3.1は$0.09/秒(競合:$0.1/秒)です。さらに、プレイグラウンドのインターフェースでは価格の透明性が確保されており、「Run」ボタンを押す際に画像1枚または動画1秒あたりの控除額が直接表示されます。

- 企業レベルの安定性とサポート: Atlas Cloudは、データ保護が厳格なプライバシー基準を満たすことを保証し、機密情報を扱う業務にも対応可能です。

- プラグアンドプレイ対応: ComfyUIやn8nのようなツールと簡単に連携できる設計となっており、企業のスイッチングコストを削減し、迅速な導入を支援します。

競合サービスとの比較

- Fal.ai: 一部のモデルは提供されていますが、Atlas Cloudはより幅広い選択肢(300以上)とより競争力のある価格設定を提供しており、新規登録ユーザーには1ドルのトライアルクレジットが付与されます。

- Wavespeed: 価格が大幅に高くなります。Atlas Cloudは、Wavespeedが強調していない企業向けコンプライアンスサポートや専門的な技術ガイダンスを提供しています。

- Kie.ai: 不透明なクレジットシステムを採用しています。Atlas Cloudはすべての実行コストをインターフェース上に正確に表示します。モデル数もKie.aiより豊富です。

- Replicate: モデルのホスティングに重点を置いています。Atlas Cloudの利点は、APIの統一性、モデルデプロイの速度、および開発者に寄り添ったサポートポリシーにあります。

- OpenAI または Google: これらのベンダーは自社のモデルしか提供していません。クロスモーダルなニーズがあるユーザーは通常、複数のサービスを統合する必要があります。Atlas Cloudは自社開発モデルとオープンソースモデルを1つのAPIの下で統合し、システムの複雑さを低減します。

Atlas CloudでGLM-5-Turboを使うには?

方法1:プラットフォーム上で直接使用する

方法2:API連携経由で使用する

ステップ1: APIキーを取得します。コンソールでAPIキーを作成し、貼り付けてください。

ステップ2: APIドキュメントを確認します。リクエストパラメータ、認証方法などを参照してください。

ステップ3: 最初のリクエストを送る(Pythonの例)

GLM-5を例としています。

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

よくある質問

GLM-5-TurboとGLM-5の違いは何ですか? GLM-5-Turboの方が高速かつコスト効率が高く、トークン効率が大幅に向上しており、GLM-5と比較して最大3倍の性能があると言われています。また、OpenClawシナリオに特化して最適化されています。

GLM-5-TurboとMiniMax M2.7を比較するとどうですか? どちらのモデルもエージェント的なツール使用に最適化されており、GLM-5よりも高いトークン効率を備えています。どちらも約200Kトークンのコンテキストウィンドウをサポートしています(MiniMax M2.7は196,608トークンをサポート)。詳細な比較評価についてブログ記事を準備中です。お楽しみに!

OpenClawのデプロイにはどのGLMモデルが推奨されますか? GLM-5-Turboが推奨されます。OpenClawシナリオに特化して最適化されており、Claude Opus 4.6に匹敵するデータ分析性能を実現しているためです。