Seedream4 Models

Seedream v4, a cutting-edge image generation model by ByteDance, redefines creative workflows by combining lightning-fast inference speeds with breathtaking 4K high-definition output. Beyond its raw performance, the model leverages advanced knowledge and reasoning to interpret complex prompts with precision, enabling seamless prompt-based editing and a vast spectrum of versatile artistic styles that make it the ultimate solution for professional design, content creation, and digital marketing.

主要モデルを探索

Atlas Cloudは、業界をリードする最新のクリエイティブモデルを提供します。

Seedream4 Modelsの特徴

Atlas Cloudは、業界をリードする最新のクリエイティブモデルを提供します。

画像合成

Seedream v3–v4モデルを使用して、テキストプロンプトから画像を生成します。

直接編集

Seedream v4/edit エンドポイントを通じて画像を調整します。

シーケンシャル編集

Applies step-by-step changes with edit-sequential model.

順次出力

順次生成により、多段階の結果を出力します。

バージョンオプション

さまざまなニーズに合わせて、v3、v3.1、およびv4のバリアントを提供します。

画像入力

編集モデルは、既存の画像を入力として受け取り、プロンプトを使用してそれを修正することができます。

ピークスピード

最低コスト

| モダリティ | 説明 |

|---|---|

| Seedream v4 API(Text To Image) | Seedream v4 APIを使用することで、開発者はテキスト記述を魅力的で高忠実度なビジュアルに変換できます。高度な拡散アーキテクチャを活用し、複雑なディテールと芸術的な精度を特徴とする高解像度画像を1枚生成します。これは、迅速なコンセプトアート作成やプレミアムなデジタルアセットに最適です。 |

| Seedream v4 Edit API(Image To Image) | このAPIは、視覚的な変換に対するきめ細かな制御を提供し、開発者がテキストによるガイダンスを通じて既存の画像を修正または再構築することを可能にします。元の構造的整合性と新しい創造的な方向性のバランスを取りながら、単一の洗練された出力を生成し、プロフェッショナルなフォトレタッチや反復的なデザインワークフロー向けに最適化されています。 |

| Seedream v4 Sequential API(Text To Image) | Seedream v4 Sequential APIにより、クリエイターは単一のプロンプトまたはナラティブシーケンスから、1〜14枚の画像からなる一貫性のあるシリーズを生成できます。複数のフレーム間で厳密なスタイルとキャラクターの連続性を保証するため、迅速な絵コンテ作成、キャラクター設定画、テーマ別ビジュアルコレクションに最適なソリューションです。 |

| Seedream v4 Edit Sequential API(Image To Image) | 高度な反復ワークフロー向けに設計されたこのAPIは、参照画像を処理して、1〜14の異なるバリエーションまたは進化形のシーケンスを生成します。バッチ全体に漸進的な編集と文体的なシフトを適用することで、フレームごとのアニメーションキーや複雑なビジュアルストーリーテリングに最適化された多用途なアセットセットを提供します。 |

Seedream4 Models の新機能 + ショーケース

先進的なモデルと Atlas Cloud の GPU アクセラレーションプラットフォームを組み合わせ、画像・動画生成において比類のない速度、拡張性、クリエイティブコントロールを実現します。

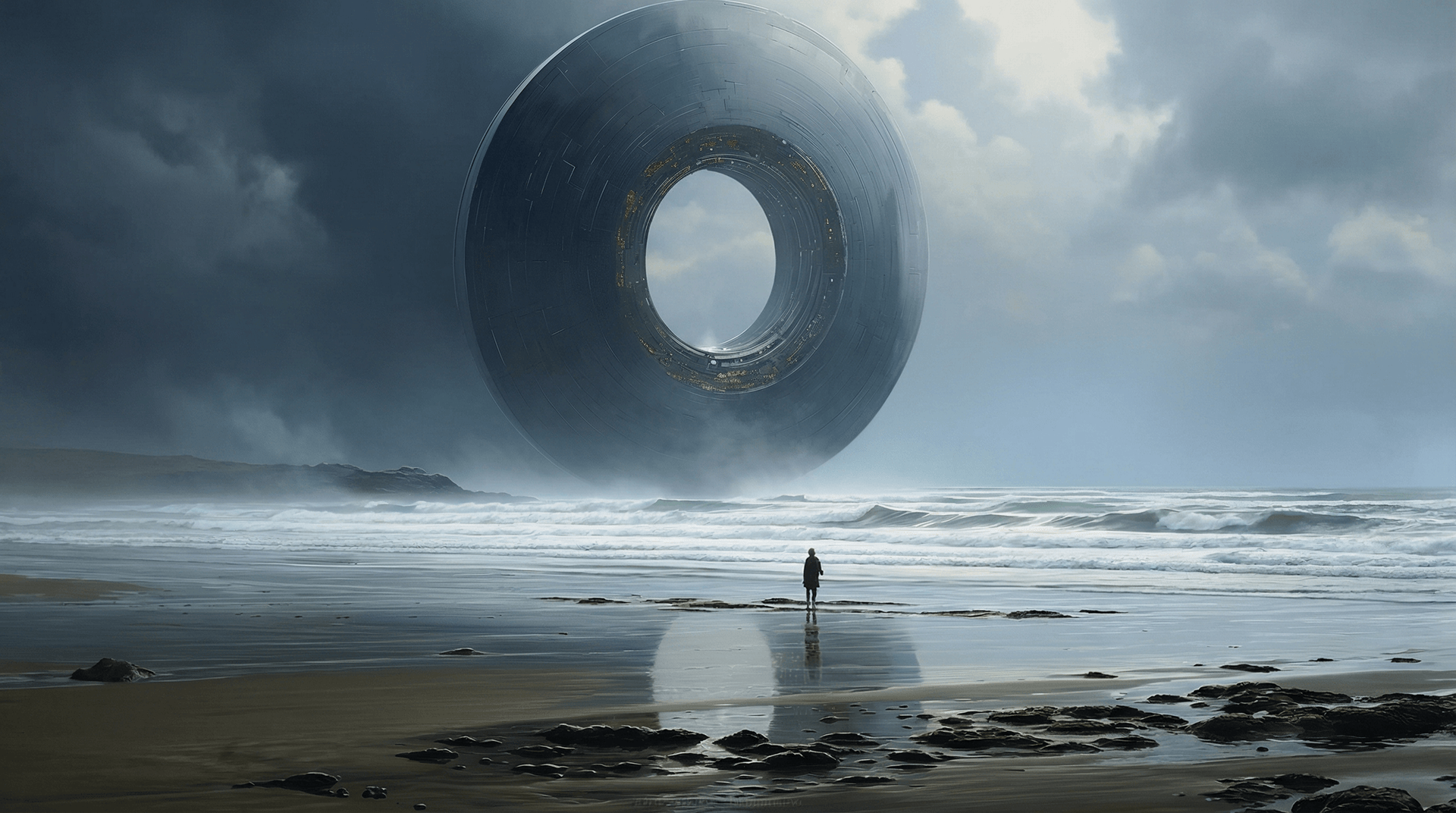

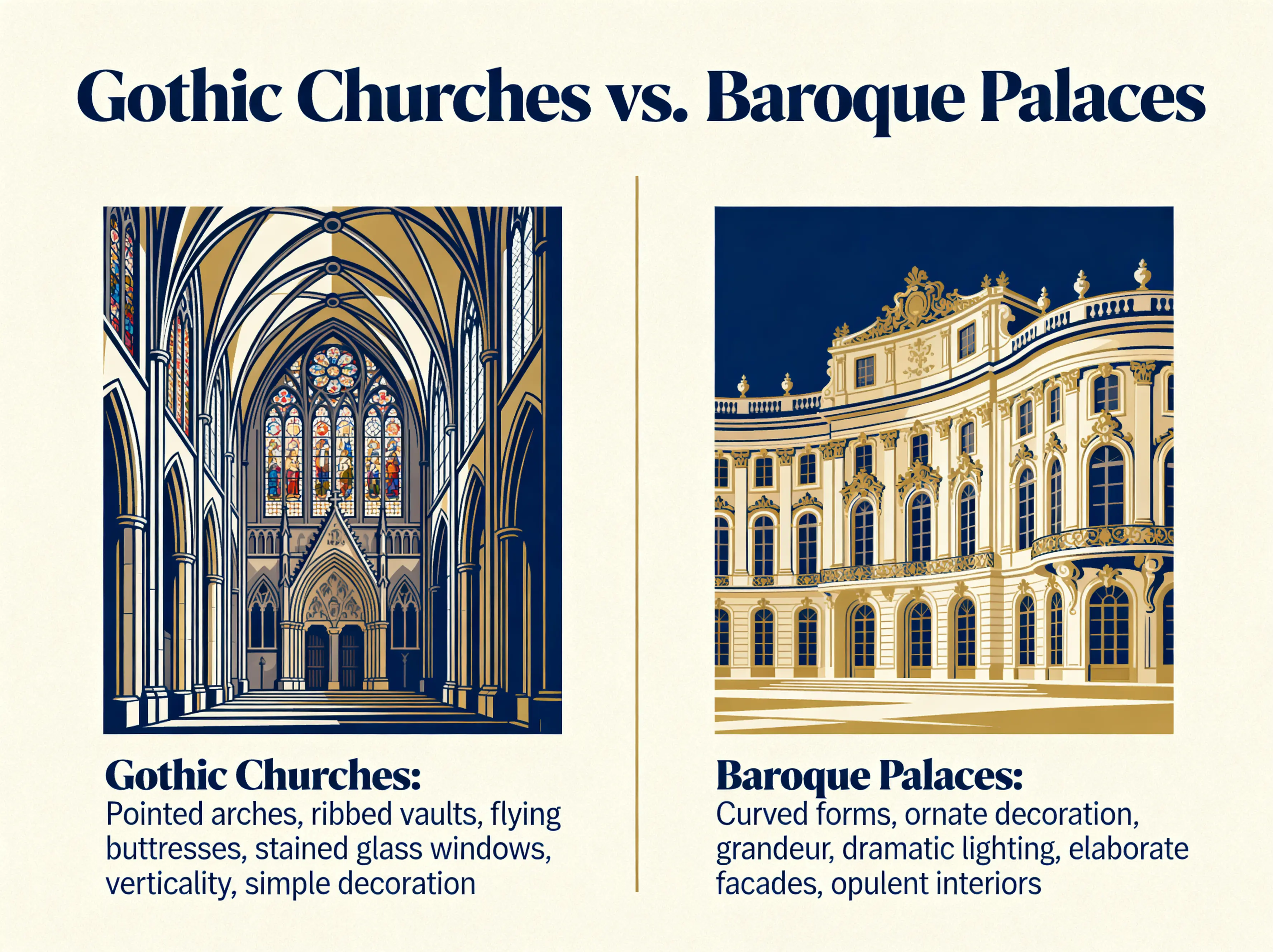

Seedream v4 API を活用した深い知識と論理的推論

Seedream v4は膨大な意味データセットを統合し、人間のような推論能力と空間認識力で複雑なプロンプトを解釈します。入り組んだ文化的ニュアンスや物理法則を理解することで、生成されるすべての要素が文脈的に正確かつ論理的に妥当であることを保証します。これは、ビジュアルストーリーテリング、歴史的再現、そして概念的に複雑なクリエイティブブリーフのための究極のソリューションです。

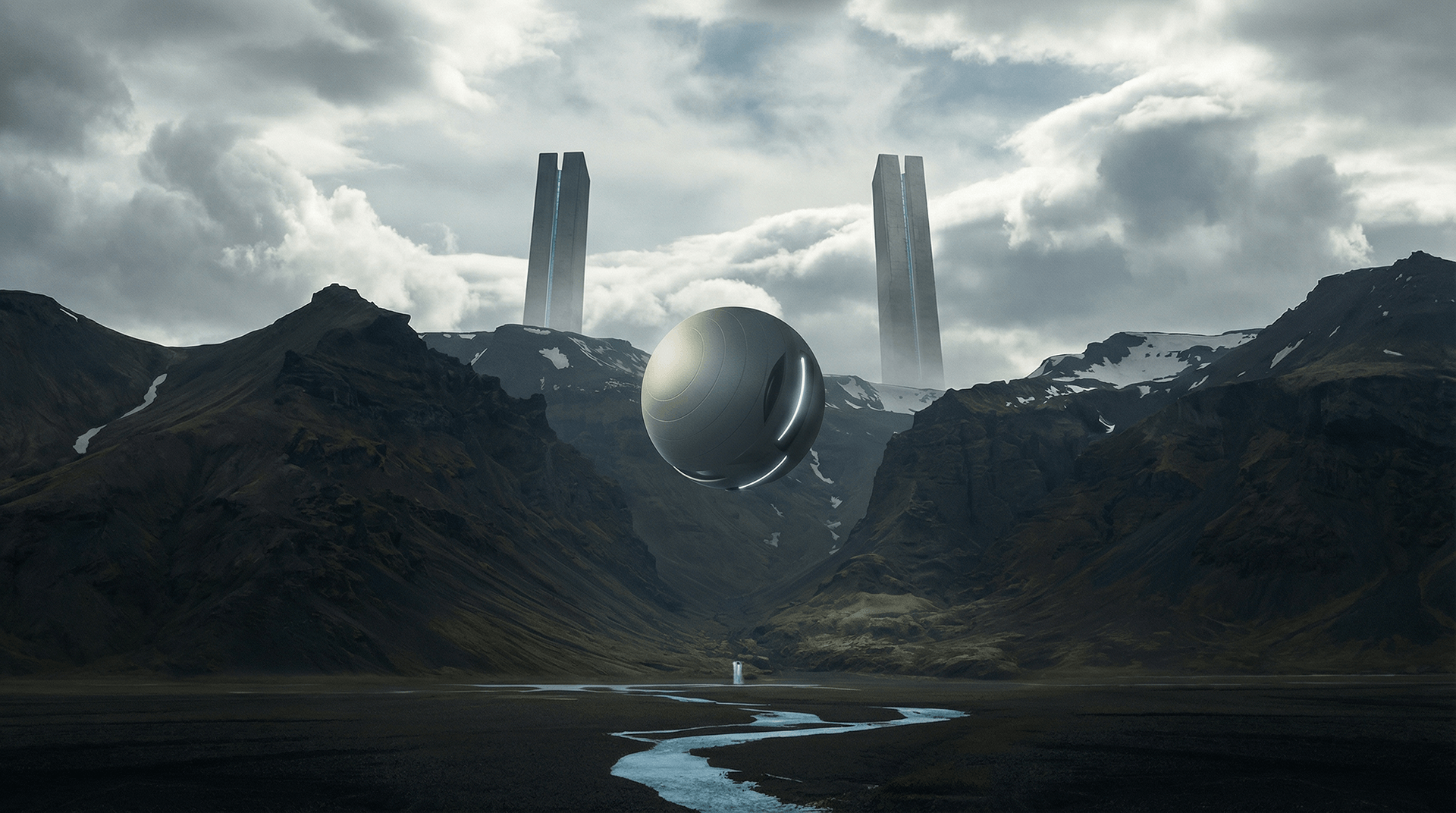

Seedream v4 APIを使用した高精度なプロンプトベースの編集

Seedream v4は、元の構図を損なうことなく、直感的なテキストベースのコマンドを通じて画像属性の詳細な制御を可能にします。ユーザーはテクスチャ、照明、または特定の被写体を正確に修正でき、複数のイテレーションにわたってピクセル単位の完全な一貫性を保証します。これは、迅速なビジュアルプロトタイピング、プロフェッショナルな商業レタッチ、および動的なデザイン探求のための究極のソリューションです。

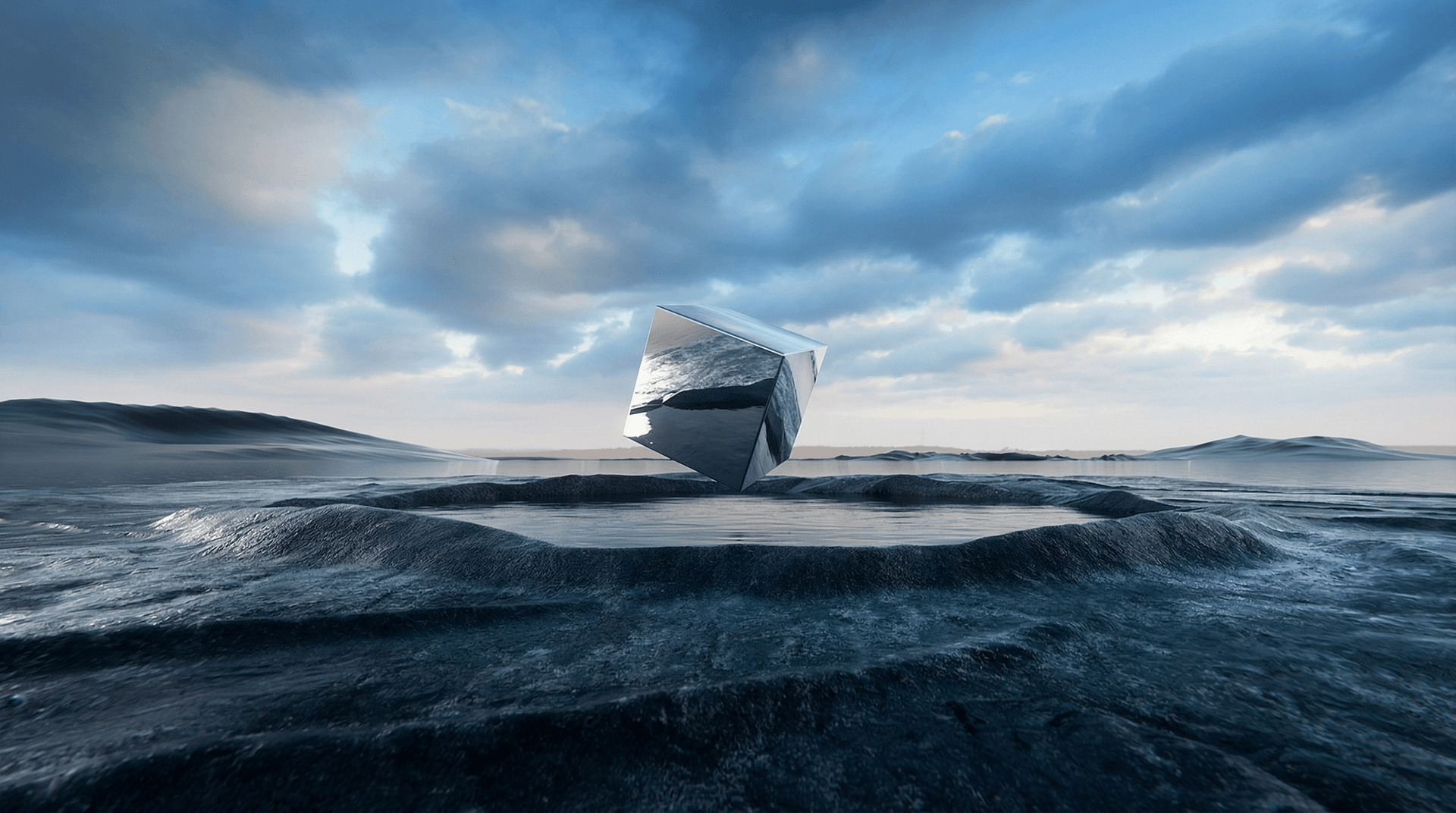

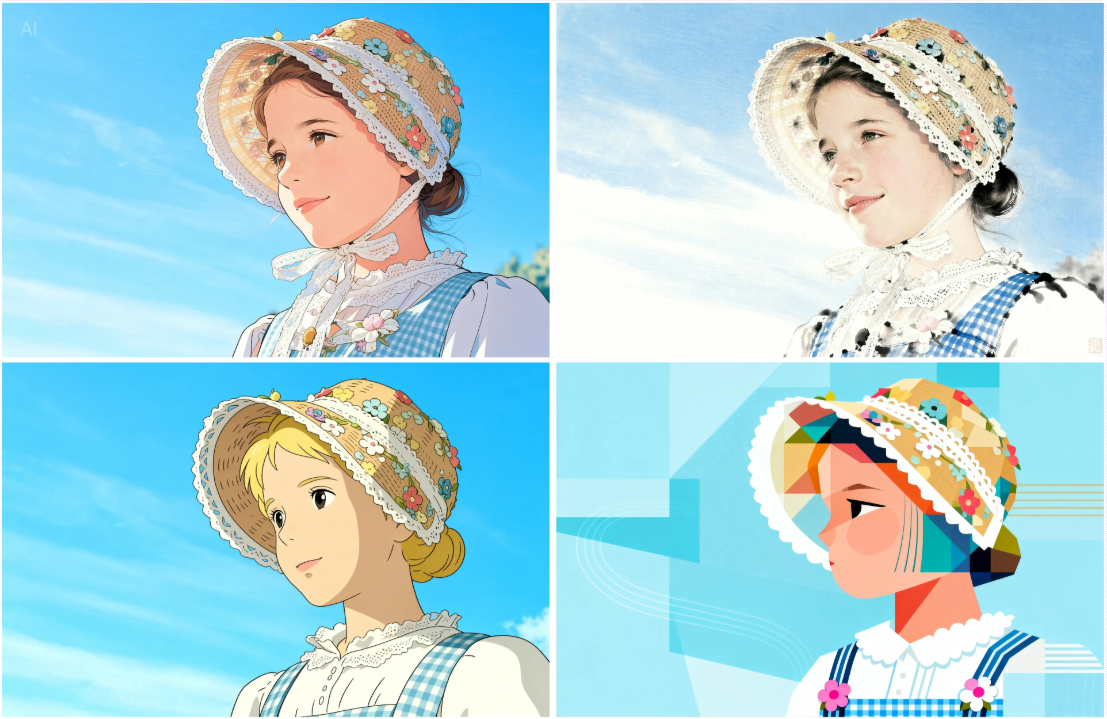

Seedream v4 APIによる無限の芸術的汎用性

Seedream v4は、超写実的な映画撮影から前衛的なデジタルイラストレーションに至るまで、広範な美的表現のライブラリを提供します。その適応型アーキテクチャはあらゆる芸術媒体の真髄を捉え、あらゆるビジョンに対して高忠実度のテクスチャと本格的なカラーグレーディングを実現します。これは、多様なブランドキャンペーン、没入型ゲームアセット、そしてハイエンドなクロスプラットフォームコンテンツ制作のための究極のソリューションです。

Seedream4 Models でできること

このモデルファミリーで構築できる実用的なユースケースとワークフローを発見 — コンテンツ作成や自動化から本番グレードのアプリケーションまで。

Seedream v4 APIによるハイエンドなEC画像

Seedream v4は、ブランドが高質感な製品ビジュアルを即座に生成できるようにし、ヘアライン加工された金属、グレインレザー、ダイナミックな液体の飛沫などの複雑な素材を緻密にレンダリングします。ネイティブ4K超高解像度出力を備えたこのモデルは、絶妙な光と影の遷移および被写界深度制御を維持します。これはラグジュアリーマーケティングやEコマースの詳細ページに最適なソリューションであり、物理的な照明セットアップなしでスタジオ品質の結果を実現します。

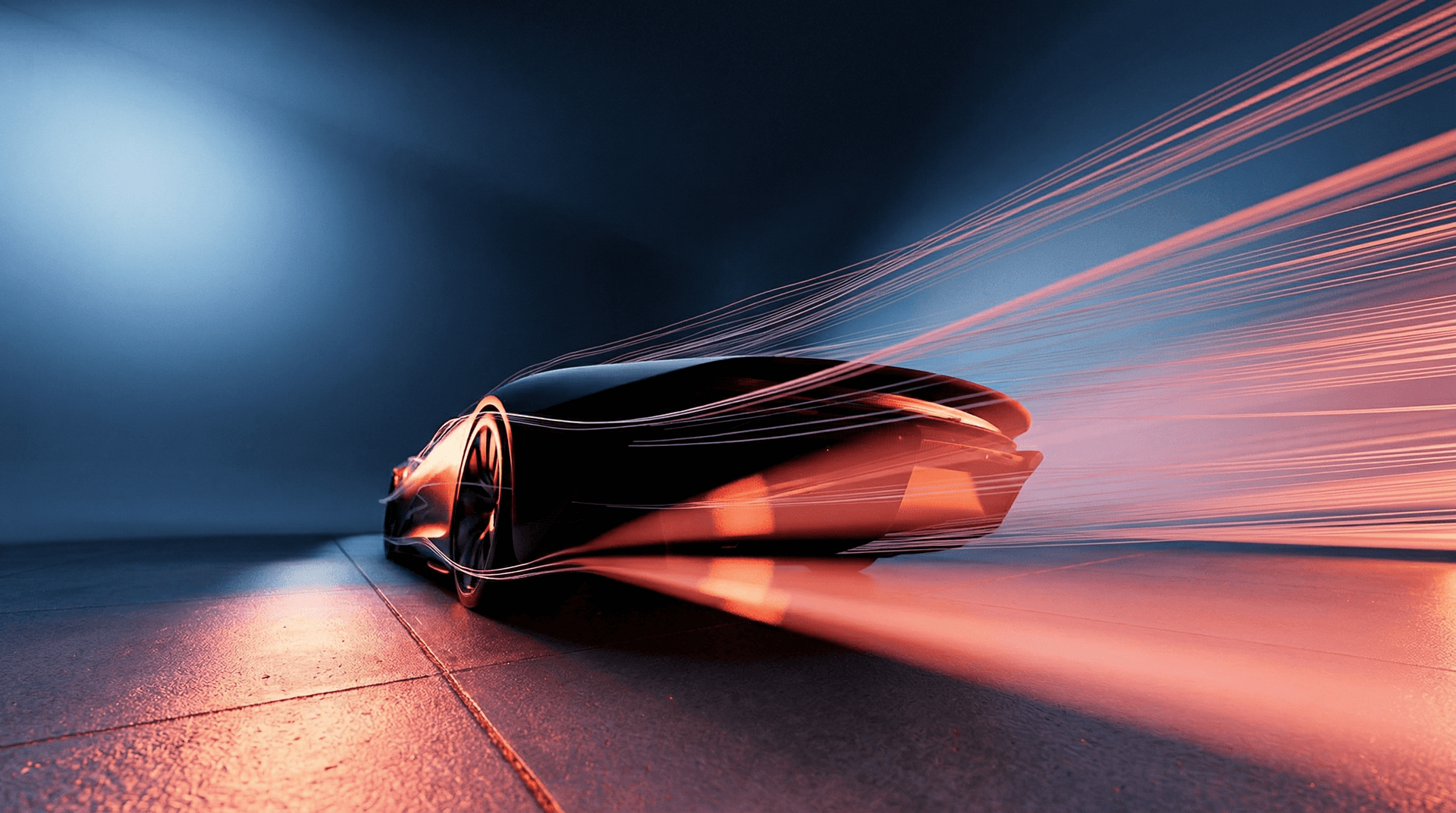

Seedream v4 APIを使用した迅速なクリエイティブコンセプティング

ペースの速いクリエイティブエージェンシー向けに、Seedream v4は業界最高水準の推論速度を活用し、ブレインストーミングで出たアイデアを数秒で高忠実度のビジュアルドラフトに変換します。この高速生成により、スクリプトからコンセプトアートまでのフィードバックループが大幅に短縮されるため、広告ピッチ、ソーシャルメディアのトレンド、そして納期と視覚的インパクトの両方が重要となる緊急性の高いマーケティングキャンペーンに最適です。

Seedream v4 APIによる超高解像度の大判印刷ビジュアル

Seedream v4によって生成されたビジュアルは、屋外の看板、バス停の広告、または物理的なギャラリー展示用に拡大しても、驚くべきピクセルの鮮明さを維持します。複雑なタイポグラフィ要素から広大なパノラマの細部に至るまで、このモデルはすべてのテクスチャが綿密な検査に耐えうることを保証します。これは、プレミアムなオフラインのビジュアルメディア、大規模なポスター、および室内装飾のために妥協のない解像度を必要とするあらゆるシナリオに適しています。

モデル比較

異なるプロバイダーのモデルを比較 — パフォーマンス、料金、独自の強みを確認して最適な選択を。

| モデル | 参照画像の制限 | 出力数 | 解像度 | アスペクト比 |

|---|---|---|---|---|

| Seedream v4 | 10 | 1~14 | 1024P~4K+ | Width[1024, 4096]px; Height[1024, 4096]px |

| Seedream 4.5 | 10 | 1~15 | 1080P~4K+ | Width[1440, 4096]px; Height[1440, 4096]px |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Wan 2.6 I2I(Image To Image) | 4 | 1 | 580P~1080P+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 9:21 |

Atlas Cloud で Seedream4 Models を使う方法

数分で始められます — 以下の簡単なステップに従って、Atlas Cloud プラットフォームでモデルを統合・デプロイしましょう。

Atlas Cloud アカウントを作成

atlascloud.ai でサインアップし、認証を完了します。新規ユーザーには無料クレジットが付与され、プラットフォームの探索やモデルのテストに使用できます。

Atlas CloudでSeedream4 Modelsを使用する理由

高度なSeedream4 ModelsモデルとAtlas CloudのGPU加速プラットフォームを組み合わせることで、比類のないパフォーマンス、スケーラビリティ、開発者エクスペリエンスを提供。

パフォーマンスと柔軟性

低レイテンシ:

リアルタイム推論のためのGPU最適化推論。

統合API:

1つの統合でSeedream4 Models、GPT、Gemini、DeepSeekを実行。

透明な料金:

サーバーレスオプション付きの予測可能なtoken単位の課金。

エンタープライズとスケール

開発者エクスペリエンス:

SDK、分析、ファインチューニングツール、テンプレート。

信頼性:

99.99%の稼働率、RBAC、コンプライアンス対応ロギング。

セキュリティとコンプライアンス:

SOC 2 Type II、HIPAA準拠、米国内のデータ主権。

Seedream4 Models に関するよくある質問

最大4K Ultra-HD(4096*4096)出力をサポートし、大判印刷や高精度のデザインタスクにおいて驚くほど詳細なディテールを保証します。

Seedream v4は、推論速度の大幅な高速化と論理的推論力の強化を実現し、複雑なプロンプトにおける空間的関係のより正確な解釈を可能にします。

はい。Seedream v4は強力なプロンプトベースの編集機能を搭載しており、ユーザーは簡単なテキストコマンドでテクスチャ、照明、または特定の被写体を調整できます。

さらにファミリーを探索

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

Grok-Imagine Models

Grok Imagine Image Quality is xAI's latest AI image generation model, delivering studio-grade visuals with up to 2K resolution and razor-sharp detail. It offers best-in-class text rendering across multiple languages, photorealistic outputs with natural lighting, rich textures, and believable physics, plus tighter prompt following and image editing with reference inputs for precise creative control. Ideal for hero images, ad creatives, product renders, and brand-grade visuals.

Gemini Omni

Gemini Omni (by Google DeepMind) is a video generation and editing model launched on May 20, 2026 at Google I/O that redefines the standard for "reasoning-driven creation," built specifically to solve the core challenge of AI video: making output that actually understands what you mean, not just what you type. It fuses Gemini's reasoning engine with generative capability, accepting any mix of images, text, video, and audio to produce consistent, knowledge-grounded output. Unlike models that start from scratch each time, Omni lets you edit through natural conversation — swapping objects, rewriting scenes, shifting styles — while keeping physics, characters, and continuity intact across every turn.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Google Models on Atlas Cloud | Gemini, Nano Bananas & Veo

{"en":"Google's most powerful creative models are all available on Atlas Cloud. Veo 3.1 delivers cinematic video generation, Nano Banana 2 powers high-fidelity image creation, and Gemini brings multimodal intelligence to every workflow. Access the full Google model suite through one API key with Day-0 availability and pay-as-you-go pricing.","zh":"Google最强大的创意模型现已在Atlas Cloud上全面可用。Veo 3.1提供电影级别的视频生成,Nano Banana 2支持高保真图像创建,而Gemini为每个工作流带来多模态智能。通过单一API key即可访问完整的Google模型套件,提供Day-0可用性和按需付费(pay-as-you-go)定价。","zh-TW":"Google最強大的創意模型現已在Atlas Cloud上全面可用。Veo 3.1提供電影等級的影片生成,Nano Banana 2支援高保真圖像建立,而Gemini為每個工作流程帶來多模態智慧。透過單一API key即可存取完整的Google模型套件,提供Day-0可用性和隨用隨付(pay-as-you-go)定價。","es":"Los modelos creativos más potentes de Google están todos disponibles en Atlas Cloud. Veo 3.1 ofrece generación de video cinematográfico, Nano Banana 2 impulsa la creación de imágenes de alta fidelidad y Gemini aporta inteligencia multimodal a cada flujo de trabajo. Acceda a la suite completa de modelos de Google a través de una sola API key con disponibilidad Day-0 y precios de pago por uso (pay-as-you-go).","pt":"Os modelos criativos mais poderosos do Google estão todos disponíveis na Atlas Cloud. O Veo 3.1 oferece geração de vídeo cinematográfico, o Nano Banana 2 impulsiona a criação de imagens de alta fidelidade e o Gemini traz inteligência multimodal para cada fluxo de trabalho. Acesse o pacote completo de modelos do Google por meio de uma única API key com disponibilidade Day-0 e preços de pagamento conforme o uso (pay-as-you-go).","hi":"Google के सबसे शक्तिशाली क्रिएटिव मॉडल अब Atlas Cloud पर उपलब्ध हैं। Veo 3.1 सिनेमैटिक वीडियो जनरेशन प्रदान करता है, Nano Banana 2 हाई-फिडेलिटी इमेज क्रिएशन को शक्ति देता है, और Gemini हर वर्कफ़्लो में मल्टीमॉडल इंटेलिजेंस लाता है। Day-0 उपलब्धता और पे-एज़-यू-गो (pay-as-you-go) प्राइसिंग के साथ एक ही API key के माध्यम से संपूर्ण Google मॉडल सूट तक पहुंचें।","ja":"Googleの最も強力なクリエイティブモデルはすべてAtlas Cloudで利用可能です。Veo 3.1はシネマティックな動画生成を実現し、Nano Banana 2は高忠実度な画像作成を強化し、Geminiはあらゆるワークフローにマルチモーダルなインテリジェンスをもたらします。Day-0の可用性と従量課金制(pay-as-you-go)の料金体系を備えた単一のAPI keyを通じて、Googleモデルスイート全体にアクセスできます。","ko":"Google의 가장 강력한 크리에이티브 모델은 모두 Atlas Cloud에서 사용할 수 있습니다. Veo 3.1은 영화 수준의 비디오 생성을 제공하고, Nano Banana 2는 고충실도 이미지 생성을 지원하며, Gemini는 모든 워크플로우에 멀티모달 인텔리전스를 제공합니다. Day-0 가용성과 종량제(pay-as-you-go) 요금제로 단일 API key를 통해 전체 Google 모델 제품군에 액세스하세요.","fr":"Les modèles créatifs les plus puissants de Google sont tous disponibles sur Atlas Cloud. Veo 3.1 offre une génération de vidéos cinématographiques, Nano Banana 2 permet de créer des images haute fidélité, et Gemini apporte une intelligence multimodale à chaque flux de travail. Accédez à la suite complète de modèles Google via une seule API key avec une disponibilité Day-0 et une tarification à l'usage (pay-as-you-go).","de":"Die leistungsstärksten kreativen Modelle von Google sind alle auf Atlas Cloud verfügbar. Veo 3.1 liefert kinoreife Videogenerierung, Nano Banana 2 ermöglicht die Erstellung von High-Fidelity-Bildern und Gemini bringt multimodale Intelligenz in jeden Workflow. Greifen Sie über einen einzigen API key mit Day-0-Verfügbarkeit und Pay-as-you-go-Preisen auf die vollständige Google-Modellsuite zu.","ar":"تتوفر أقوى النماذج الإبداعية من Google بالكامل على Atlas Cloud. يقدم Veo 3.1 توليد فيديو سينمائي، ويدعم Nano Banana 2 إنشاء صور عالية الدقة، ويجلب Gemini ذكاءً متعدد الوسائط لكل سير عمل. يمكنك الوصول إلى مجموعة نماذج Google الكاملة من خلال مفتاح API key واحد مع توفر Day-0 وتسعير الدفع حسب الاستخدام (pay-as-you-go).","it":"I modelli creativi più potenti di Google sono tutti disponibili su Atlas Cloud. Veo 3.1 offre la generazione di video cinematografici, Nano Banana 2 alimenta la creazione di immagini ad alta fedeltà e Gemini porta l'intelligenza multimodale in ogni flusso di lavoro. Accedi alla suite completa di modelli Google tramite una singola API key con disponibilità Day-0 e prezzi a consumo (pay-as-you-go).","nl":"De krachtigste creatieve modellen van Google zijn allemaal beschikbaar op Atlas Cloud. Veo 3.1 levert cinematografische videogeneratie, Nano Banana 2 drijft high-fidelity beeldcreatie aan en Gemini brengt multimodale intelligentie naar elke workflow. Krijg toegang tot de volledige Google-modelsuite via één API key met Day-0 beschikbaarheid en pay-as-you-go prijzen.","pl":"Najpotężniejsze modele kreatywne Google są w pełni dostępne na platformie Atlas Cloud. Veo 3.1 zapewnia kinową generację wideo, Nano Banana 2 umożliwia tworzenie obrazów o wysokiej wierności, a Gemini wprowadza wielomodalną inteligencję do każdego przepływu pracy. Uzyskaj dostęp do pełnego pakietu modeli Google za pomocą jednego klucza API key z dostępnością Day-0 i cennikiem pay-as-you-go.","tr":"Google'ın en güçlü yaratıcı modellerinin tümü Atlas Cloud'da mevcuttur. Veo 3.1 sinematik video üretimi sunar, Nano Banana 2 yüksek sadakatli görüntü oluşturmaya güç katar ve Gemini her iş akışına çok modlu zeka getirir. Day-0 kullanılabilirliği ve kullandıkça öde (pay-as-you-go) fiyatlandırmasıyla tek bir API key üzerinden tüm Google model paketine erişin.","vi":"Các mô hình sáng tạo mạnh mẽ nhất của Google hiện đều có sẵn trên Atlas Cloud. Veo 3.1 cung cấp khả năng tạo video đậm chất điện ảnh, Nano Banana 2 hỗ trợ tạo hình ảnh có độ chân thực cao, và Gemini mang trí tuệ đa phương thức vào mọi quy trình làm việc. Truy cập toàn bộ bộ mô hình Google thông qua một API key duy nhất với tính khả dụng Day-0 và mức giá dùng bao nhiêu trả bấy nhiêu (pay-as-you-go).","th":"โมเดลเชิงสร้างสรรค์ที่ทรงพลังที่สุดของ Google พร้อมใช้งานแล้วบน Atlas Cloud โดย Veo 3.1 นำเสนอการสร้างวิดีโอระดับภาพยนตร์ Nano Banana 2 ขับเคลื่อนการสร้างภาพที่มีความเที่ยงตรงสูง และ Gemini นำความชาญฉลาดแบบมัลติโมดัลมาสู่ทุกเวิร์กโฟลว์ เข้าถึงชุดโมเดลของ Google เต็มรูปแบบผ่าน API key เดียวพร้อมความพร้อมใช้งานระดับ Day-0 และการกำหนดราคาแบบจ่ายตามการใช้งาน (pay-as-you-go)","id":"Model kreatif paling kuat dari Google semuanya tersedia di Atlas Cloud. Veo 3.1 menghadirkan pembuatan video sinematik, Nano Banana 2 memberdayakan pembuatan gambar dengan fidelitas tinggi, dan Gemini membawa kecerdasan multimodal ke setiap alur kerja. Akses rangkaian lengkap model Google melalui satu API key dengan ketersediaan Day-0 dan harga bayar sesuai pemakaian (pay-as-you-go).","sv":"Googles mest kraftfulla kreativa modeller är alla tillgängliga på Atlas Cloud. Veo 3.1 levererar filmisk videogenerering, Nano Banana 2 driver skapandet av högupplösta bilder, och Gemini tillför multimodal intelligens till varje arbetsflöde. Få tillgång till hela Googles modellsvit via en enda API key med Day-0-tillgänglighet och pay-as-you-go-prissättning.","ru":"Самые мощные креативные модели Google теперь доступны в Atlas Cloud. Veo 3.1 обеспечивает генерацию кинематографического видео, Nano Banana 2 позволяет создавать изображения высокой точности, а Gemini привносит мультимодальный интеллект в каждый рабочий процесс. Получите доступ к полному пакету моделей Google с помощью одного API key с доступностью Day-0 и ценообразованием по мере использования (pay-as-you-go)."}

ByteDance Models on Atlas Cloud | Seedance & Seedream

{"en":"From cinematic video generation to high-fidelity image creation, ByteDance's most powerful models are live on Atlas Cloud. Run Seedance and Seedream at scale with the lowest inference pricing and zero infrastructure overhead.","zh":"从电影级视频生成到高保真图像创建,ByteDance 最强大的模型现已在 Atlas Cloud 上线。以最低的推理定价和零基础设施开销,大规模运行 Seedance 和 Seedream。","zh-TW":"從電影級影片生成到高保真影像建立,ByteDance 最強大的模型現已在 Atlas Cloud 上線。以最低的推論定價和零基礎設施開銷,大規模執行 Seedance 和 Seedream。","es":"Desde la generación de video cinematográfico hasta la creación de imágenes de alta fidelidad, los modelos más potentes de ByteDance están disponibles en Atlas Cloud. Ejecute Seedance y Seedream a gran escala con los precios de inferencia más bajos y cero gastos generales de infraestructura.","pt":"Da geração de vídeo cinematográfico à criação de imagens de alta fidelidade, os modelos mais poderosos da ByteDance estão disponíveis no Atlas Cloud. Execute o Seedance e o Seedream em grande escala com os preços de inferência mais baixos e zero custos indiretos de infraestrutura.","hi":"सिनेमैटिक वीडियो जनरेशन से लेकर हाई-फिडेलिटी इमेज क्रिएशन तक, ByteDance के सबसे शक्तिशाली मॉडल Atlas Cloud पर लाइव हैं। सबसे कम इन्फ्रेंस प्राइसिंग और शून्य इन्फ्रास्ट्रक्चर ओवरहेड के साथ बड़े पैमाने पर Seedance और Seedream को रन करें।","ja":"シネマティックな動画生成から高忠実度の画像作成まで、ByteDanceの最も強力なモデルがAtlas Cloudで利用可能になりました。最低水準の推論価格とゼロのインフラストラクチャオーバーヘッドで、SeedanceとSeedreamを大規模に実行できます。","ko":"시네마틱 비디오 생성부터 고해상도 이미지 제작까지, ByteDance의 가장 강력한 모델들이 현재 Atlas Cloud에 라이브로 제공됩니다. 가장 낮은 추론 가격과 인프라 오버헤드 없이 대규모로 Seedance와 Seedream을 실행해 보세요.","fr":"De la génération de vidéos cinématiques à la création d'images haute fidélité, les modèles les plus puissants de ByteDance sont disponibles sur Atlas Cloud. Exécutez Seedance et Seedream à grande échelle avec les prix d'inférence les plus bas et aucune surcharge d'infrastructure.","de":"Von der Generierung kinoreifer Videos bis zur Erstellung von High-Fidelity-Bildern sind die leistungsstärksten Modelle von ByteDance jetzt auf der Atlas Cloud verfügbar. Führen Sie Seedance und Seedream in großem Maßstab zu den niedrigsten Inferenzpreisen und ohne Infrastruktur-Overhead aus.","ar":"من إنشاء مقاطع الفيديو السينمائية إلى توليد الصور عالية الدقة، أصبحت أقوى نماذج ByteDance متاحة الآن على Atlas Cloud. يمكنك تشغيل Seedance و Seedream على نطاق واسع بأقل أسعار للاستدلال وبدون أي أعباء إضافية للبنية التحتية.","it":"Dalla generazione di video cinematografici alla creazione di immagini ad alta fedeltà, i modelli più potenti di ByteDance sono disponibili su Atlas Cloud. Esegui Seedance e Seedream su larga scala con i prezzi di inferenza più bassi e zero costi generali di infrastruttura.","nl":"Van het genereren van cinematografische video's tot het creëren van high-fidelity beelden, de krachtigste modellen van ByteDance zijn nu live op Atlas Cloud. Draai Seedance en Seedream op grote schaal met de laagste inferentieprijzen en nul infrastructuuroverhead.","pl":"Od generowania kinowych filmów po tworzenie obrazów o wysokiej wierności, najpotężniejsze modele ByteDance są dostępne w Atlas Cloud. Uruchamiaj Seedance i Seedream na dużą skalę z najniższymi cenami wnioskowania i zerowymi kosztami ogólnymi infrastruktury.","tr":"Sinematik video üretiminden yüksek sadakatli görüntü oluşturmaya kadar, ByteDance'in en güçlü modelleri Atlas Cloud'da yayında. En düşük çıkarım fiyatlandırması ve sıfır altyapı yükü ile Seedance ve Seedream'i geniş ölçekte çalıştırın.","vi":"Từ tạo video điện ảnh đến kiến tạo hình ảnh có độ trung thực cao, các mô hình mạnh mẽ nhất của ByteDance hiện đã có mặt trên Atlas Cloud. Chạy Seedance và Seedream ở quy mô lớn với mức giá suy luận thấp nhất và không có chi phí quản lý cơ sở hạ tầng.","th":"ตั้งแต่การสร้างวิดีโอระดับภาพยนตร์ไปจนถึงการสร้างภาพที่มีความละเอียดสูง โมเดลที่ทรงพลังที่สุดของ ByteDance พร้อมใช้งานแล้วบน Atlas Cloud รัน Seedance และ Seedream ในสเกลขนาดใหญ่ด้วยราคาการอนุมานที่ต่ำที่สุด และไม่มีค่าใช้จ่ายแฝงด้านโครงสร้างพื้นฐาน","id":"Dari pembuatan video sinematik hingga penciptaan gambar dengan fidelitas tinggi, model paling kuat dari ByteDance kini tersedia di Atlas Cloud. Jalankan Seedance dan Seedream dalam skala besar dengan harga inferensi terendah dan tanpa biaya overhead infrastruktur.","sv":"Från filmisk videogenerering till skapande av högupplösta bilder, ByteDances kraftfullaste modeller är live på Atlas Cloud. Kör Seedance och Seedream i stor skala med de lägsta inferenspriserna och noll infrastrukturkostnader.","ru":"От создания кинематографичных видео до генерации высокоточных изображений — самые мощные модели ByteDance теперь доступны в Atlas Cloud. Запускайте Seedance и Seedream в любом масштабе с самыми низкими ценами на инференс и нулевыми накладными расходами на инфраструктуру."}

Alibaba Models on Atlas Cloud | Wan & Qwen

{"en":"Atlas Cloud brings together Alibaba's full model lineup under one API: Qwen for language and image tasks, Wan for video generation up to 1080p. Access every model pay-as-you-go with no subscriptions. The Alibaba API is available via a single base URL using your existing OpenAI-compatible client.","zh":"Atlas Cloud 将 Alibaba 的全系模型阵容整合至同一个 API 中:Qwen 用于语言和图像任务,Wan 用于高达 1080p 的视频生成。所有模型均采用按需付费模式,无需订阅。您可以使用现有的 OpenAI 兼容客户端,通过单一的 base URL 访问 Alibaba API。","zh-TW":"Atlas Cloud 將 Alibaba 的全系模型陣容整合至同一個 API 中:Qwen 適用於語言和圖像任務,Wan 適用於高達 1080p 的影片生成。所有模型均採用按需付費模式,無需訂閱。您可以使用現有的 OpenAI 兼容客戶端,透過單一的 base URL 存取 Alibaba API。","es":"Atlas Cloud reúne toda la línea de modelos de Alibaba bajo una sola API: Qwen para tareas de lenguaje e imagen, y Wan para la generación de video hasta 1080p. Acceda a cada modelo con pago por uso sin suscripciones. La API de Alibaba está disponible a través de una única URL base utilizando su cliente compatible con OpenAI existente.","pt":"O Atlas Cloud reúne toda a linha de modelos da Alibaba sob uma única API: Qwen para tarefas de linguagem e imagem, e Wan para geração de vídeo em até 1080p. Acesse cada modelo no formato pré-pago (pay-as-you-go) sem necessidade de assinaturas. A API da Alibaba está disponível por meio de uma única URL base usando seu cliente compatível com OpenAI existente.","hi":"Atlas Cloud एक ही API के तहत Alibaba के पूरे मॉडल लाइनअप को एक साथ लाता है: भाषा और छवि कार्यों के लिए Qwen, और 1080p तक के वीडियो निर्माण के लिए Wan। बिना किसी सब्सक्रिप्शन के पे-एज़-यू-गो (pay-as-you-go) के आधार पर प्रत्येक मॉडल तक पहुँच प्राप्त करें। Alibaba API आपके मौजूदा OpenAI-संगत क्लाइंट का उपयोग करके एकल बेस URL के माध्यम से उपलब्ध है।","ja":"Atlas Cloudは、Alibabaの全モデルラインナップを単一のAPIに統合します。言語および画像タスク用のQwen、最大1080pの動画生成用のWanが利用可能です。すべてのモデルはサブスクリプション不要の従量課金制(pay-as-you-go)でアクセスできます。Alibaba APIは、既存のOpenAI互換クライアントを使用し、単一のベースURLを介して利用可能です。","ko":"Atlas Cloud는 Alibaba의 전체 모델 라인업을 단일 API로 통합합니다. 언어 및 이미지 작업을 위한 Qwen, 최대 1080p 비디오 생성을 위한 Wan을 제공합니다. 구독 없이 사용한 만큼만 지불하는(pay-as-you-go) 방식으로 모든 모델에 액세스하세요. Alibaba API는 기존의 OpenAI 호환 클라이언트를 사용하여 단일 기본 URL(base URL)을 통해 사용할 수 있습니다.","fr":"Atlas Cloud rassemble l'ensemble de la gamme de modèles d'Alibaba sous une seule API : Qwen pour les tâches linguistiques et d'imagerie, et Wan pour la génération de vidéos jusqu'en 1080p. Accédez à chaque modèle avec une tarification à l'usage (pay-as-you-go) sans abonnement. L'API Alibaba est disponible via une URL de base unique en utilisant votre client existant compatible avec OpenAI.","de":"Atlas Cloud vereint das gesamte Modell-Lineup von Alibaba unter einer einzigen API: Qwen für Sprach- und Bildaufgaben sowie Wan für die Videogenerierung mit bis zu 1080p. Greifen Sie auf jedes Modell im Pay-as-you-go-Verfahren ohne Abonnements zu. Die Alibaba API ist über eine einzige Base-URL mit Ihrem bestehenden OpenAI-kompatiblen Client verfügbar.","ar":"تجمع Atlas Cloud مجموعة نماذج Alibaba الكاملة ضمن API واحد: Qwen لمهام اللغة والصورة، و Wan لإنشاء مقاطع الفيديو بدقة تصل إلى 1080p. يمكنك الوصول إلى كل نموذج بنظام الدفع حسب الاستخدام (pay-as-you-go) دون أي اشتراكات. تتوفر Alibaba API عبر عنوان URL أساسي واحد باستخدام عميلك الحالي المتوافق مع OpenAI.","it":"Atlas Cloud riunisce l'intera linea di modelli di Alibaba in un'unica API: Qwen per attività linguistiche e di immagine, Wan per la generazione di video fino a 1080p. Accedi a ogni modello in modalità pay-as-you-go senza abbonamenti. L'API di Alibaba è disponibile tramite una singola base URL utilizzando il tuo attuale client compatibile con OpenAI.","nl":"Atlas Cloud brengt de volledige modellenreeks van Alibaba samen onder één API: Qwen voor taal- en beeldtaken, en Wan voor videogeneratie tot 1080p. Krijg toegang tot elk model op basis van pay-as-you-go zonder abonnementen. De Alibaba API is beschikbaar via één enkele base URL met behulp van uw bestaande OpenAI-compatibele client.","pl":"Atlas Cloud łączy pełną gamę modeli Alibaba w ramach jednego API: Qwen do zadań związanych z językiem i obrazem oraz Wan do generowania wideo w rozdzielczości do 1080p. Uzyskaj dostęp do każdego modelu w modelu płatności zgodnie z rzeczywistym użyciem (pay-as-you-go) bez subskrypcji. Alibaba API jest dostępne poprzez pojedynczy bazowy adres URL (base URL) przy użyciu istniejącego klienta kompatybilnego z OpenAI.","tr":"Atlas Cloud, Alibaba'nın tüm model serisini tek bir API altında birleştiriyor: Dil ve görüntü görevleri için Qwen, 1080p'ye kadar video üretimi için Wan. Abonelik gerektirmeden kullandıkça öde (pay-as-you-go) modeliyle her modele erişin. Alibaba API, mevcut OpenAI uyumlu istemcinizi kullanarak tek bir temel URL (base URL) üzerinden kullanılabilir.","vi":"Atlas Cloud tập hợp toàn bộ dòng mô hình của Alibaba dưới một API duy nhất: Qwen cho các tác vụ ngôn ngữ và hình ảnh, Wan để tạo video với độ phân giải lên đến 1080p. Truy cập mọi mô hình theo hình thức dùng đến đâu trả tiền đến đó (pay-as-you-go) mà không cần đăng ký gói. Alibaba API có sẵn thông qua một URL cơ sở (base URL) duy nhất bằng cách sử dụng ứng dụng khách tương thích với OpenAI hiện có của bạn.","th":"Atlas Cloud รวบรวมโมเดลทั้งหมดของ Alibaba ไว้ใน API เดียว: Qwen สำหรับงานด้านภาษาและรูปภาพ และ Wan สำหรับการสร้างวิดีโอความละเอียดสูงสุด 1080p เข้าถึงทุกโมเดลในรูปแบบจ่ายตามการใช้งานจริง (pay-as-you-go) โดยไม่ต้องสมัครสมาชิก Alibaba API พร้อมใช้งานผ่าน base URL เดียวโดยใช้ไคลเอนต์ที่รองรับ OpenAI ที่คุณมีอยู่แล้ว","id":"Atlas Cloud menyatukan seluruh jajaran model Alibaba di bawah satu API: Qwen untuk tugas bahasa dan gambar, Wan untuk pembuatan video hingga 1080p. Akses setiap model dengan sistem bayar sesuai pemakaian (pay-as-you-go) tanpa berlangganan. Alibaba API tersedia melalui satu URL dasar (base URL) menggunakan klien yang kompatibel dengan OpenAI Anda saat ini.","sv":"Atlas Cloud samlar Alibabas hela modellutbud under ett enda API: Qwen för språk- och bilduppgifter, Wan för videogenerering upp till 1080p. Få tillgång till varje modell med betala-för-användning (pay-as-you-go) helt utan abonnemang. Alibaba API är tillgängligt via en enda bas-URL (base URL) med din befintliga OpenAI-kompatibla klient.","ru":"Atlas Cloud объединяет всю линейку моделей Alibaba в одном API: Qwen для языковых задач и работы с изображениями, Wan для генерации видео с разрешением до 1080p. Получите доступ к каждой модели с оплатой по мере использования (pay-as-you-go) без подписок. Alibaba API доступен через единый базовый URL (base URL) с использованием вашего текущего OpenAI-совместимого клиента."}

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

xAI Models on Atlas Cloud | Grok Imagine Models

{"en":"Build complete image and video pipelines using the xAI API on Atlas Cloud. Generate at 2K, edit with reference images, and animate images into audio-synced clips.","zh":"在 Atlas Cloud 上使用 xAI API 构建完整的图像和视频处理工作流。以 2K 分辨率生成、使用参考图像进行编辑,并将图像动画化为音画同步的视频片段。","zh-TW":"在 Atlas Cloud 上使用 xAI API 建構完整的影像與影片處理管線。以 2K 解析度生成、使用參考影像進行編輯,並將影像動畫化為音訊同步的影片片段。","es":"Construya pipelines completos de imágenes y video utilizando la xAI API en Atlas Cloud. Genere en 2K, edite con imágenes de referencia y anime imágenes en clips sincronizados con audio.","pt":"Construa pipelines completos de imagem e vídeo usando a xAI API no Atlas Cloud. Gere em 2K, edite com imagens de referência e anime imagens em clipes sincronizados com áudio.","hi":"Atlas Cloud पर xAI API का उपयोग करके संपूर्ण इमेज और वीडियो पाइपलाइन बनाएं। 2K रिज़ॉल्यूशन पर जनरेट करें, संदर्भ छवियों के साथ संपादित करें, और छवियों को ऑडियो-सिंक किए गए क्लिप में एनिमेट करें।","ja":"Atlas Cloud 上で xAI API を使用して、完全な画像および動画パイプラインを構築します。2K解像度での生成、参照画像を使用した編集、そして画像を音声同期クリップへとアニメーション化することが可能です。","ko":"Atlas Cloud에서 xAI API를 사용하여 완벽한 이미지 및 비디오 파이프라인을 구축하십시오. 2K 해상도로 생성하고, 참조 이미지로 편집하며, 이미지를 오디오와 동기화된 클립으로 애니메이션화할 수 있습니다.","fr":"Créez des pipelines complets d'images et de vidéos en utilisant la xAI API sur Atlas Cloud. Générez en 2K, éditez avec des images de référence et animez des images en clips synchronisés avec l'audio.","de":"Erstellen Sie vollständige Bild- und Videopipelines unter Verwendung der xAI API auf Atlas Cloud. Generieren Sie in 2K, bearbeiten Sie mit Referenzbildern und animieren Sie Bilder zu audiosynchronen Clips.","ar":"قم ببناء مسارات عمل كاملة للصور والفيديو باستخدام xAI API على Atlas Cloud. قم بالتوليد بدقة 2K، والتحرير باستخدام صور مرجعية، وتحريك الصور إلى مقاطع متزامنة مع الصوت.","it":"Costruisci pipeline complete di immagini e video utilizzando la xAI API su Atlas Cloud. Genera in 2K, modifica con immagini di riferimento e anima le immagini in clip sincronizzate con l'audio.","nl":"Bouw volledige beeld- en videopipelines met behulp van de xAI API op Atlas Cloud. Genereer in 2K, bewerk met referentiebeelden en animeer beelden in audiogesynchroniseerde clips.","pl":"Zbuduj kompletne potoki przetwarzania obrazów i wideo za pomocą xAI API w Atlas Cloud. Generuj w rozdzielczości 2K, edytuj za pomocą obrazów referencyjnych i animuj obrazy w klipy zsynchronizowane z dźwiękiem.","tr":"Atlas Cloud üzerinde xAI API kullanarak eksiksiz görüntü ve video işlem hatları oluşturun. 2K çözünürlükte üretim yapın, referans görüntülerle düzenleyin ve görüntüleri sesle senkronize edilmiş kliplere dönüştürerek canlandırın.","vi":"Xây dựng các pipeline hình ảnh và video hoàn chỉnh bằng xAI API trên Atlas Cloud. Tạo ở độ phân giải 2K, chỉnh sửa bằng hình ảnh tham chiếu và tạo hoạt ảnh từ hình ảnh thành các clip đồng bộ với âm thanh.","th":"สร้างไปป์ไลน์ภาพและวิดีโอที่สมบูรณ์โดยใช้ xAI API บน Atlas Cloud สร้างที่ความละเอียด 2K แก้ไขด้วยภาพอ้างอิง และทำให้ภาพเคลื่อนไหวเป็นคลิปที่ซิงค์กับเสียง","id":"Bangun pipeline gambar dan video yang lengkap menggunakan xAI API di Atlas Cloud. Hasilkan pada resolusi 2K, edit dengan gambar referensi, dan animasikan gambar menjadi klip yang disinkronkan dengan audio.","sv":"Bygg kompletta bild- och videopipelines med hjälp av xAI API på Atlas Cloud. Generera i 2K, redigera med referensbilder och animera bilder till ljudsynkroniserade klipp.","ru":"Создавайте полные конвейеры обработки изображений и видео с использованием xAI API в Atlas Cloud. Генерируйте в разрешении 2K, редактируйте с помощью эталонных изображений и анимируйте изображения в синхронизированные со звуком клипы."}

Kwaivgi Models on Atlas Cloud | Kling Models

{"en":"The Kwaivgi API at 15% off standard rates. Day-0 access to every new Kling release, pay-as-you-go, no seat limits. One account covers the full Kling lineup.","zh":"Kwaivgi API 价格低于标准定价 15%。Atlas Cloud 提供对最新 Kling 版本的零日(Day-0)访问权限,采用按需付费定价且无席位限制。一个账户,一个密钥,畅享从标准版到大师版的所有 Kling 模型。","zh-TW":"Kwaivgi API 價格低於標準定價 15%。Atlas Cloud 提供對最新 Kling 版本的零日(Day-0)存取權限,採用按需付費定價且無席位限制。一個帳戶,一個金鑰,暢享從標準版到大師版的所有 Kling 模型。","es":"La API de Kwaivgi a un 15% por debajo del precio estándar. Atlas Cloud ofrece acceso Day-0 a los nuevos lanzamientos de Kling con precios de pago por uso y sin límites de puestos. Una cuenta, una clave, todos los modelos de Kling desde el nivel estándar hasta el nivel maestro.","pt":"A API da Kwaivgi com preço 15% abaixo do padrão. A Atlas Cloud oferece acesso Day-0 a novos lançamentos da Kling com preços de pagamento conforme o uso e sem limite de assentos. Uma conta, uma chave, todos os modelos da Kling do nível padrão ao nível master.","hi":"Kwaivgi API मानक मूल्य निर्धारण से 15% कम पर। Atlas Cloud नए Kling रिलीज़ के लिए पे-एज़-यू-गो (उपयोग के अनुसार भुगतान) मूल्य निर्धारण और बिना किसी सीट सीमा के डे-0 (Day-0) एक्सेस प्रदान करता है। एक खाता, एक कुंजी, मानक से लेकर मास्टर टियर तक हर Kling मॉडल।","ja":"Kwaivgi APIを標準価格より15%オフで提供。Atlas Cloudは、新しいKlingリリースへのDay-0アクセスを、従量課金制(Pay-as-you-go)およびシート数無制限で提供します。1つのアカウント、1つのキーで、スタンダードからマスター階層まで、すべてのKlingモデルをご利用いただけます。","ko":"표준 가격보다 15% 저렴한 Kwaivgi API. Atlas Cloud는 종량제 요금과 사용자 수 제한 없이 새로운 Kling 릴리스에 대한 Day-0 액세스를 제공합니다. 단일 계정, 단일 키로 표준에서 마스터 티어에 이르는 모든 Kling 모델을 이용하세요.","fr":"L'API Kwaivgi à 15 % en dessous du tarif standard. Atlas Cloud offre un accès Day-0 aux nouvelles versions de Kling avec une tarification à l'usage et sans limite de postes. Un seul compte, une seule clé, tous les modèles Kling du niveau standard au niveau master.","de":"Die Kwaivgi API 15 % unter dem Standardpreis. Atlas Cloud bietet Day-0-Zugriff auf neue Kling-Releases mit nutzungsbasierter Preisgestaltung (Pay-as-you-go) und ohne Platzbeschränkungen. Ein Konto, ein Schlüssel, jedes Kling-Modell von der Standard- bis zur Master-Stufe.","ar":"واجهة برمجة تطبيقات Kwaivgi (API) بسعر أقل بنسبة 15% من السعر القياسي. توفر Atlas Cloud وصولاً من اليوم الأول (Day-0) إلى إصدارات Kling الجديدة مع تسعير الدفع حسب الاستخدام وبدون حدود لعدد المقاعد. حساب واحد، مفتاح واحد، وكل نماذج Kling من المستوى القياسي إلى المستوى الرئيسي (master).","it":"L'API Kwaivgi al 15% in meno rispetto al prezzo standard. Atlas Cloud offre accesso Day-0 alle nuove versioni di Kling con prezzi a consumo e senza limiti di postazioni. Un solo account, una sola chiave, tutti i modelli Kling dal livello standard a quello master.","nl":"De Kwaivgi API tegen 15% onder de standaardprijs. Atlas Cloud biedt Day-0 toegang tot nieuwe Kling-releases met pay-as-you-go prijzen en zonder limiet op het aantal gebruikers. Eén account, één sleutel, elk Kling-model van standaard- tot masterniveau.","pl":"API Kwaivgi o 15% poniżej standardowej ceny. Atlas Cloud zapewnia dostęp od pierwszego dnia (Day-0) do nowych wydań Kling z modelem płatności zgodnie z użyciem (pay-as-you-go) i bez limitów stanowisk. Jedno konto, jeden klucz, każdy model Kling od poziomu standardowego po poziom master.","tr":"Standart fiyatlandırmanın %15 altında Kwaivgi API. Atlas Cloud, kullandıkça öde fiyatlandırması ve koltuk sınırı olmaksızın yeni Kling sürümlerine 0. Gün (Day-0) erişimi sunar. Tek hesap, tek anahtar, standarttan master seviyeye kadar her Kling modeli.","vi":"Kwaivgi API với mức giá thấp hơn 15% so với giá tiêu chuẩn. Atlas Cloud cung cấp quyền truy cập Day-0 cho các bản phát hành Kling mới với mức giá dùng trả theo mức sử dụng (pay-as-you-go) và không giới hạn số lượng người dùng. Một tài khoản, một khóa, mọi mô hình Kling từ cấp tiêu chuẩn đến cấp master.","th":"Kwaivgi API ในราคาที่ถูกกว่าราคามาตรฐาน 15% Atlas Cloud มอบการเข้าถึง Day-0 สำหรับการเปิดตัว Kling ใหม่ด้วยการกำหนดราคาแบบจ่ายตามการใช้งานจริง (pay-as-you-go) และไม่จำกัดจำนวนผู้ใช้ บัญชีเดียว คีย์เดียว สำหรับโมเดล Kling ทุกรุ่นตั้งแต่ระดับมาตรฐานไปจนถึงระดับมาสเตอร์","id":"Kwaivgi API dengan harga 15% di bawah harga standar. Atlas Cloud memberikan akses Day-0 ke rilis Kling terbaru dengan harga pay-as-you-go (bayar sesuai pemakaian) dan tanpa batasan pengguna (seat limits). Satu akun, satu kunci, setiap model Kling dari tingkat standar hingga master.","sv":"Kwaivgi API till 15 % under standardpriset. Atlas Cloud ger Day-0-åtkomst till nya Kling-versioner med pay-as-you-go-prissättning och utan platsbegränsningar. Ett konto, en nyckel, varje Kling-modell från standard- till masternivå.","ru":"Kwaivgi API на 15% ниже стандартной цены. Atlas Cloud предоставляет доступ в день релиза (Day-0) к новым версиям Kling с оплатой по мере использования (pay-as-you-go) и без ограничений по количеству рабочих мест. Один аккаунт, один ключ, все модели Kling от уровня standard до master."}