H1: Lançamento do DeepSeek-V4 Preview: Contexto de 1M de Tokens, Melhorias para Agentes e Pesos Open Source

Hoje (24 de abril), o DeepSeek lança oficialmente e disponibiliza em código aberto a versão de prévia do DeepSeek-V4, sua mais nova série de modelos.

O DeepSeek-V4 suporta até um milhão de tokens de contexto e alcança um desempenho líder entre modelos domésticos e open source em capacidades de agentes, conhecimento de mundo e raciocínio. A série chega em dois tamanhos:

- DeepSeek-V4-Pro — o modelo carro-chefe, um massivo modelo MoE (Mixture of Experts) com 1,6 trilhão de parâmetros totais, mas apenas 49B ativados por passagem — esta é a chave para sua eficiência.

- DeepSeek-V4-Flash — a opção mais rápida e econômica. Segue o mesmo design MoE em uma escala muito menor (284B total / 13B ativos), permitindo uma inferência mais rápida e barata.

- Ambos os modelos compartilham a mesma janela de contexto de 1M de tokens e são totalmente open source com acesso via API.

| Modelo | Parâmetros | Ativação | Dados de Pré-treino | Tamanho Contexto | Open Source | Serviço API | Modo Acesso Web/App |

| deepseek-v4-pro | 1.6T | 49B | 33T | 1M | ✓ | ✓ | Modo Expert |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | Modo Rápido |

A partir de hoje, você pode conversar com o DeepSeek-V4 em chat.deepseek.com ou via aplicativo oficial. A API também está ativa — basta definir

1model_name1deepseek-v4-pro1deepseek-v4-flashJá havíamos reportado as especulações e análises pré-lançamento anteriormente (veja nosso guia de expectativas para o DeepSeek V4 e nossa análise técnica detalhada); agora confirmamos os detalhes oficiais direto da fonte. O conteúdo a seguir cobre exatamente o que foi lançado, o que há de novo e o que isso significa para quem está desenvolvendo ou avaliando modelos de IA hoje.

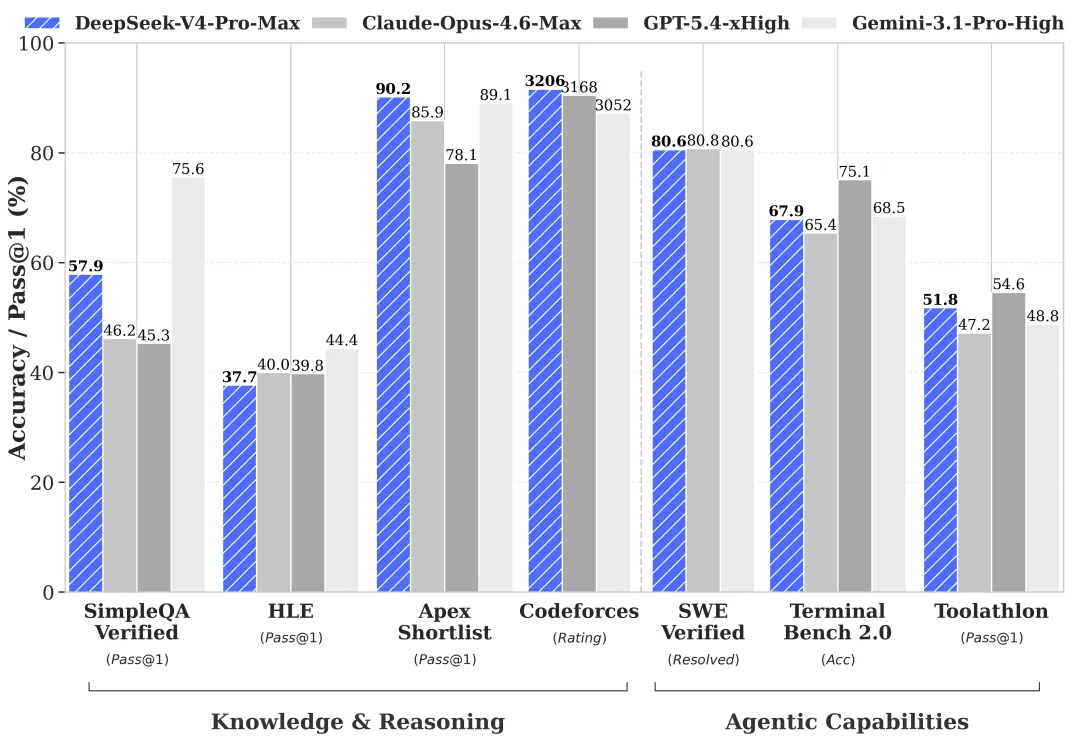

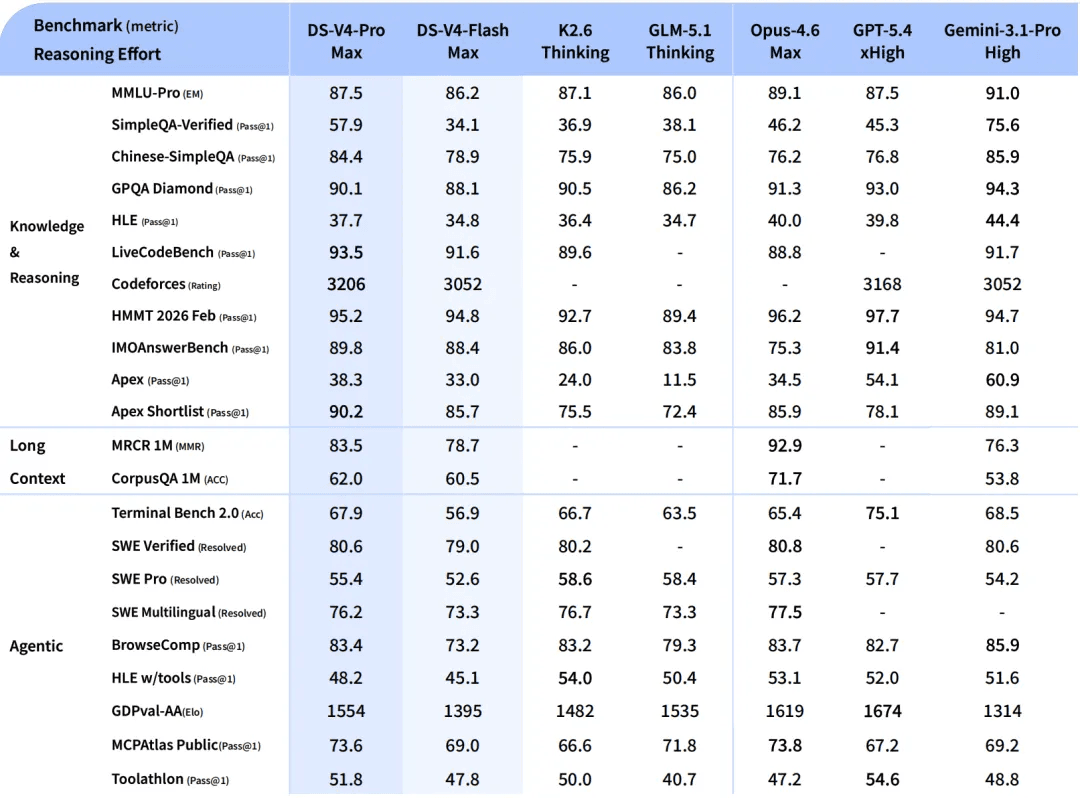

DeepSeek-V4-Pro: Rivalizando com os Principais Modelos Fechados

Capacidades de agentes significativamente aprimoradas. Comparado ao seu antecessor, o DeepSeek-V4-Pro mostra uma melhoria drástica em tarefas de agentes. Em benchmarks de codificação por agentes, o V4-Pro agora lidera entre todos os modelos open source. O DeepSeek também implementou o V4-Pro internamente como o agente de codificação preferido da empresa — o feedback dos funcionários indica que a experiência supera o Claude Sonnet 4.5, com qualidade de saída aproximando-se do Claude Opus 4.6 no modo sem "thinking", embora ainda esteja atrás do modo de "thinking" do Opus 4.6.

Rico conhecimento de mundo. O DeepSeek-V4-Pro supera significativamente outros modelos open source em benchmarks de conhecimento de mundo, ficando apenas ligeiramente atrás do principal modelo fechado, o Gemini Pro 3.1.

Raciocínio de classe mundial. Em avaliações de matemática, STEM e programação competitiva, o DeepSeek-V4-Pro supera todos os modelos open source avaliados anteriormente e iguala o desempenho dos principais modelos fechados do mundo.

DeepSeek-V4-Flash: A Escolha Rápida e Acessível

Comparado ao V4-Pro, o DeepSeek-V4-Flash fica um pouco atrás em conhecimento de mundo, mas entrega um desempenho de raciocínio comparável. Graças ao seu menor número de parâmetros e menores custos de ativação, o V4-Flash oferece tempos de resposta mais rápidos e preços de API mais econômicos.

Em benchmarks de agentes, o V4-Flash iguala o V4-Pro em tarefas mais simples, embora ainda exista uma lacuna em tarefas mais complexas.

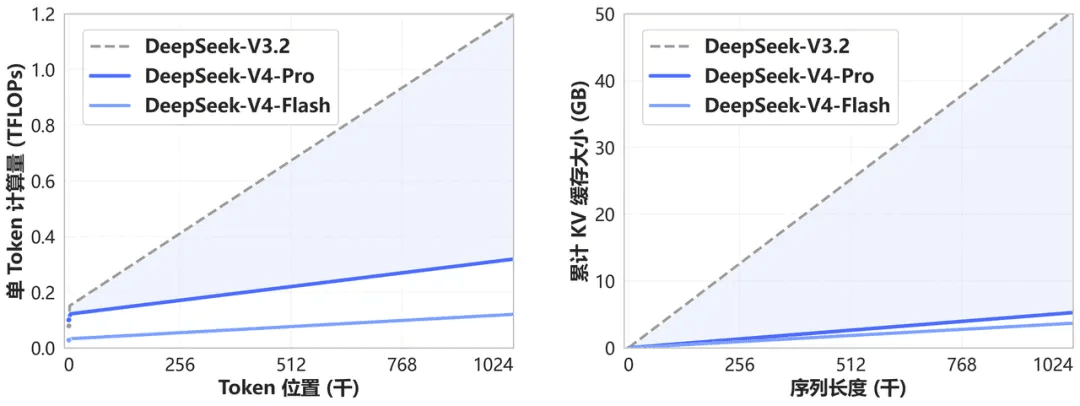

Inovação Arquitetônica e Eficiência Extrema de Contexto

O DeepSeek-V4 introduz um novo mecanismo de atenção que realiza compressão na dimensão dos tokens. Combinado com o DSA (DeepSeek Sparse Attention), este design alcança um desempenho de contexto longo líder mundial, reduzindo drasticamente os requisitos computacionais e de memória em comparação com abordagens convencionais.

Daqui em diante, o contexto de 1M (um milhão) de tokens é o padrão para todos os serviços oficiais do DeepSeek.

Otimização Especializada para Casos de Uso de Agentes

O DeepSeek-V4 foi ajustado e otimizado para produtos de agentes populares, incluindo Claude Code, OpenClaw, OpenCode e CodeBuddy. Melhorias de desempenho foram observadas em geração de código, criação de documentos e outras tarefas orientadas por agentes.

Esse tipo de ajuste específico para frameworks é, na prática, mais importante do que parece. Um modelo que funciona bem isoladamente, mas se comporta de forma inconsistente dentro de um loop estruturado de agente, é difícil de implementar de forma confiável. A decisão de tratar os principais frameworks de agentes como alvos de otimização de primeira classe reflete como o uso de IA em produção evoluiu.

Acesso à API do DeepSeek-V4

Tanto o V4-Pro quanto o V4-Flash já estão disponíveis via API do DeepSeek, com suporte para as interfaces OpenAI ChatCompletions e Anthropic, o que significa que integrações existentes podem ser direcionadas aos modelos V4 com o mínimo de alterações no código. A

1base_url1model1deepseek-v4-pro1deepseek-v4-flashAmbos os modelos suportam um tamanho máximo de contexto de 1M de tokens e oferecem modos sem "thinking" e com "thinking". No modo de "thinking", o parâmetro

1reasoning_effort1high1max1max⚠️ Aviso de descontinuação: Os nomes de modelos legados

etext1deepseek-chatserão aposentados em três meses (24 de julho de 2026). Durante o período de transição, eles mapeiam para os modos sem e com "thinking" dotext1deepseek-reasoner, respectivamente. Se você estiver usando qualquer um dos nomes em produção, planeje sua migração agora.text1deepseek-v4-flash

Pesos Open Source e Implementação Local

- Pesos do modelo:Hugging Face | ModelScope

- Relatório técnico:DeepSeek-V4 PDF

Para equipes considerando a implementação local ou on-premise, vale notar que modelos nesta escala de parâmetros, particularmente o V4-Pro com 1,6T de parâmetros totais, exigem hardware substancial. A disponibilidade open source é uma vantagem significativa para conformidade empresarial e casos de uso personalizados, mas a maioria das equipes achará o acesso via API em nuvem o ponto de partida mais prático.

O que este lançamento do DeepSeek-V4 realmente significa

Três pontos se destacam neste lançamento quando analisados em conjunto.

Primeiro, o compromisso com 1M de contexto é mais significativo do que parece. O DeepSeek não está oferecendo isso como uma categoria premium — é a base para todos os serviços oficiais. Isso é um sinal sobre para onde a fronteira open source está indo e coloca uma pressão silenciosa sobre todos os outros provedores para seguirem o mesmo caminho.

Segundo, o trabalho de otimização voltado para agentes — especificamente adaptando o V4 para Claude Code, OpenCode e outros — reflete uma maturidade na forma como o DeepSeek pensa sobre implementação. Desempenho em benchmark é o básico; o que importa em produção é o comportamento dentro das ferramentas que os desenvolvedores realmente usam.

Terceiro, o posicionamento competitivo honesto em relação ao Claude Opus 4.6 é notável. Em vez de alegar superioridade em todos os aspectos, o DeepSeek oferece uma avaliação em camadas: melhor que o Sonnet 4.5, aproximando-se do Opus 4.6 sem "thinking", atrás do Opus 4.6 com "thinking". Essa especificidade torna as alegações mais, e não menos, críveis.

Para desenvolvedores avaliando modelos para fluxos de trabalho de agentes, processamento de documentos longos ou tarefas complexas de raciocínio, o DeepSeek-V4-Pro é agora um sério concorrente open source. Para pipelines otimizados por custo ou sensíveis à latência, o V4-Flash oferece uma alternativa leve e confiável.

Experimente o DeepSeek-V4 na Atlas Cloud

A Atlas Cloud é uma plataforma de IA de nível de produção projetada para desenvolvedores e equipes que desejam acesso confiável e econômico aos principais modelos de IA do mundo, sem gerenciar a infraestrutura. Com uma API unificada, preços transparentes e conformidade de nível empresarial (alinhada a SOC 2 e pronta para HIPAA), a Atlas Cloud permite que você foque em construir, não em operações.

DeepSeek na Atlas Cloud. Já oferecemos suporte à família de modelos DeepSeek, incluindo DeepSeek V3.2, V3.2 Fast, V3.2 Speciale e V3.2 Exp, disponíveis hoje via um único endpoint de API a preços competitivos. Os modelos DeepSeek na Atlas Cloud são otimizados para cargas de trabalho de contexto longo e pipelines de agentes, com suporte total à janela de contexto e sem perda por quantização. Além do DeepSeek, a Atlas Cloud oferece acesso a mais de 300 modelos em todo o cenário de LLMs.

O DeepSeek-V4 está chegando à Atlas Cloud. Estamos trabalhando ativamente na integração do DeepSeek-V4-Pro e V4-Flash. Fique atento ao anúncio de lançamento — e, enquanto isso, explore tudo o que já está disponível na plataforma.