No início de abril, um modelo chamado "HappyHorse-1.0" surgiu repentinamente. Ele liderou quatro categorias no ranking de vídeo da Artificial Analysis, superando com folga o Seedance 2.0 e o Kling por uma margem significativa.

Não houve comunicados de imprensa, nem posts em blogs, e o nome da empresa foi ocultado. A página do modelo dizia apenas "em breve".

No dia 10 de abril, a divisão ATH do Alibaba reconheceu o projeto. O HappyHorse é um projeto interno de P&D da unidade de inovação da ATH e encontra-se atualmente em versão beta privada. A API será lançada em 30 de abril.

Além disso, o HappyHorse-1.0 será totalmente de código aberto. Ele é apontado como o primeiro modelo de vídeo open-source capaz de gerar áudio e vídeo simultaneamente de forma nativa.

Este "lançamento silencioso" seguido de um "anúncio espetacular" está se tornando uma tendência entre as empresas de IA chinesas. A Xiaomi fez isso com o codinome "Hunter Alpha", e a Zhipu usou "Pony Alpha" para o seu novo modelo GLM.

Neste artigo, desvendamos os fatos conhecidos sobre o HappyHorse e o que eles significam.

A Posição do HappyHorse no Ranking

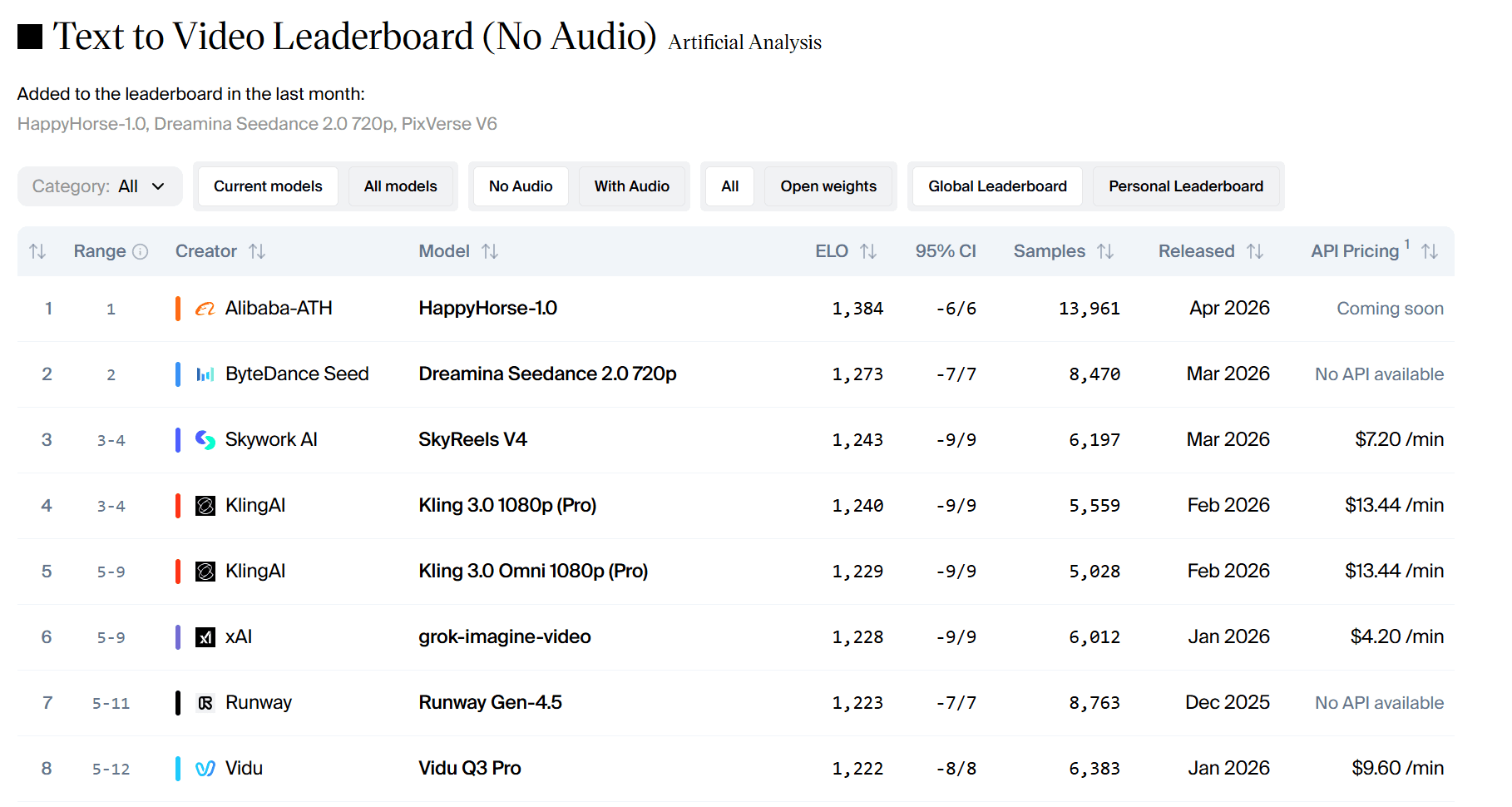

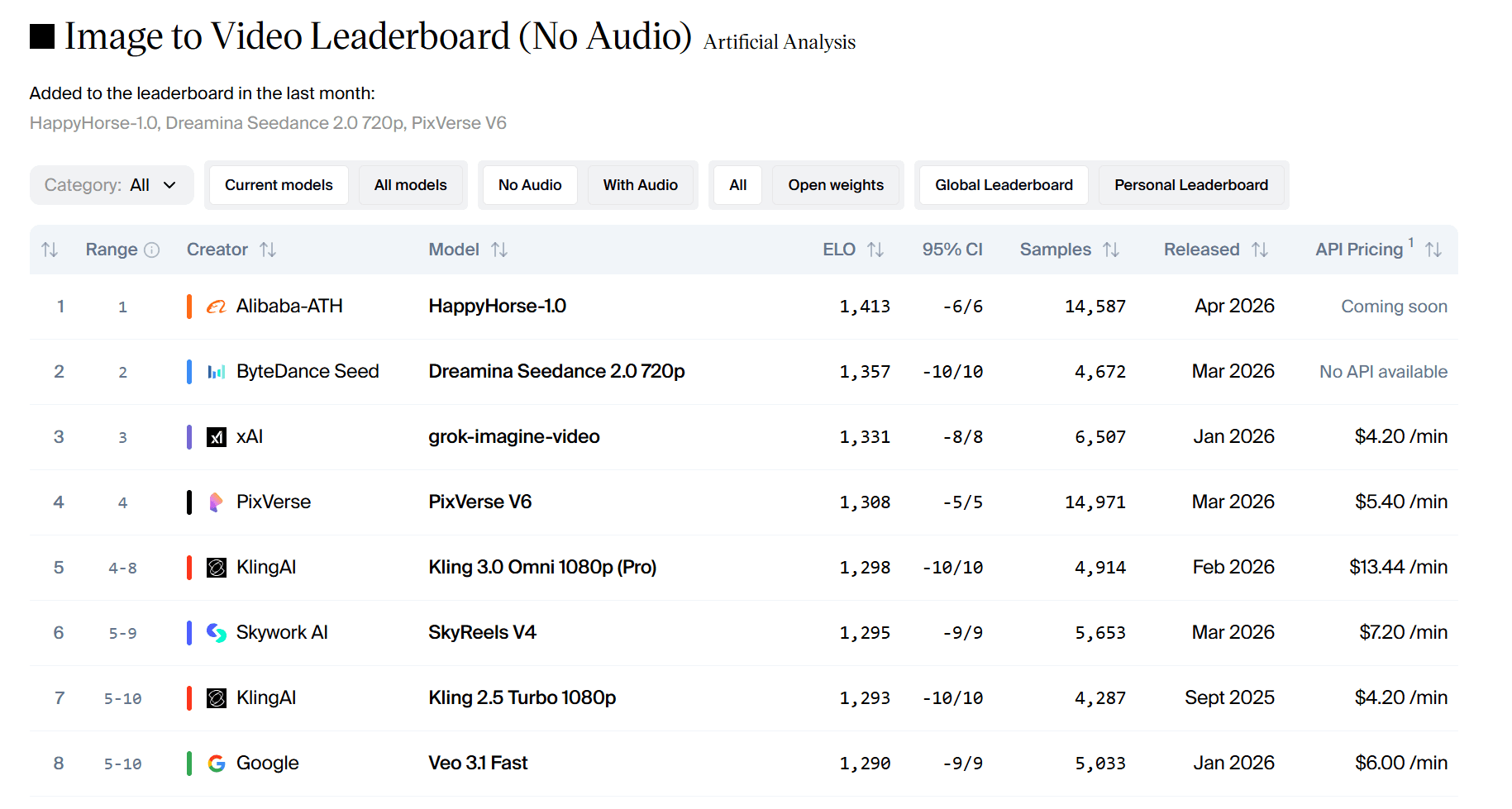

A Artificial Analysis opera quatro rankings: Texto-para-Vídeo sem áudio, Imagem-para-Vídeo sem áudio, Texto-para-Vídeo com áudio e Imagem-para-Vídeo com áudio.

Os dados do meio-dia de 13 de abril são os seguintes:

- Texto-para-Vídeo (sem áudio): 1384 Elo. Está 111 pontos à frente do Seedance 2.0.

- Imagem-para-Vídeo (sem áudio): 1413 Elo. Esta é a pontuação mais alta registrada na plataforma.

Em pontuações Elo, uma diferença de mais de 60 pontos indica uma preferência clara. Uma diferença de 111 pontos indica que os usuários escolheram o HappyHorse de forma esmagadora em testes cegos.

No entanto, a situação muda quando o áudio é incluído. A diferença diminui para apenas 1 a 2 pontos, configurando efetivamente um empate. Isso mostra que a sincronização audiovisual e a qualidade sonora do HappyHorse não são dramaticamente superiores. Nesse aspecto, ele está praticamente no mesmo patamar que o Seedance.

Comparação entre HappyHorse e Seedance 2.0

| Item | HappyHorse-1.0 | Seedance 2.0 |

| Natureza do Modelo | Código Aberto (Open Source) | Sistema Comercial Fechado |

| Arquitetura | Transformador Unificado | Transformador de Difusão Bidirecional (DB-DiT) |

| Capacidade Multimodal | Geração simultânea de Áudio/Vídeo (One-pass) | Entrada Multimodal (Texto, Imagem, Vídeo, Áudio) |

| Modo de Geração de Vídeo | Geração em uma única passagem (One-pass) | Geração baseada em pipeline |

| Duração da Geração | Aprox. 5–10 segundos (1080p) | Até aprox. 60 segundos (2K) |

Os dois representam filosofias diferentes.

HappyHorse‑1.0: Código aberto. Transformador Unificado. Geração simultânea de áudio/vídeo. Processamento em uma única passagem. Suporte nativo para sincronia labial em 7 idiomas. 15 bilhões de parâmetros. Leva 38 segundos para gerar um vídeo de 5 segundos em 1080p em um ambiente H100.

Seedance 2.0: Sistema comercial fechado. Transformador de Difusão Bidirecional (DB‑DiT). Entrada multimodal. Capaz de gerar vídeos de 60 segundos em 2K. Suporta sincronia labial para mais de 8 idiomas.

Em relação à qualidade visual pura, o HappyHorse é claramente preferido em testes cegos. Quanto à sincronização audiovisual e qualidade de som, ambos são praticamente equivalentes. Em termos de usabilidade, o Seedance já oferece uma API madura através de serviços como o Volcano Engine. A API do HappyHorse está agendada para lançamento em 30 de abril, e o desempenho na versão beta privada ainda está sendo verificado.

Comparação de exemplos de geração entre HappyHorse-1.0 e Dreamina Seedance 2.0 (Texto-para-Vídeo com áudio) pela Artificial Analysis:

Prompt: Uma curta animação no estilo Pixar sobre um tímido cone de trânsito que sonha em ser o cone na linha de chegada de uma grande corrida. Os outros cones riem de sua ambição. Um operário da construção civil o coloca acidentalmente na linha de chegada de uma maratona. À medida que os corredores passam, a expressão pintada no cone muda de medo para alegria. Confete chove sobre ele. Os outros cones assistem a isso na TV e se sentem inspirados. Áudio: Do barulho do trânsito aos aplausos da multidão e, em seguida, uma música edificante.

Sobre a Arquitetura

O HappyHorse adota uma abordagem incomum.

Ele possui 15 bilhões de parâmetros e usa um Transformer de autoatenção unificado de 40 camadas. Tokens de texto, vídeo e áudio são todos alimentados na mesma sequência e modelados conjuntamente. Isso é significativamente diferente do pipeline comum de "gerar o vídeo primeiro e depois adicionar áudio". Aqui, som e cena existem no mesmo espaço semântico desde o início.

Este modelo usa destilação DMD-2 e otimização total de grafo via MagiCompiler. Em uma única GPU H100, leva cerca de 38 segundos para gerar um vídeo de 5 segundos em 1080p.

Ele suporta sincronia labial nativa para 7 idiomas: Inglês, Mandarim, Cantonês, Japonês, Coreano, Alemão e Francês. Sua Taxa de Erro de Palavra (WER) está entre as mais baixas de qualquer modelo de código aberto.

Participantes do teste cego da Artificial Analysis afirmam que o HappyHorse se destaca particularmente na representação de personagens. A textura da pele e a suavidade dos movimentos são superiores. O fato de mais de 60% das amostras de teste serem retratos ou clipes de cabeças falantes foi um fator que impulsionou este modelo ao topo.

No entanto, há críticas. Vídeos vazados apontaram ondulações não naturais, artefatos de listras em assuntos em movimento rápido e degradação da qualidade da imagem em telas grandes.

Plano de Código Aberto e Acesso

Em 9 de abril, o HappyHorse‑1.0 anunciou que seria totalmente de código aberto. O repositório do GitHub está ativo, os pesos são completamente abertos e não há restrições comerciais.

O site oficial oferece demos online para texto-para-vídeo e imagem-para-vídeo. De acordo com o ATH do Alibaba, a API está programada para ser lançada ao público em 30 de abril.

No entanto, um aviso: de acordo com a equipe oficial, a maioria dos "sites oficiais" que circulam online são falsos. O verdadeiro ainda não está totalmente operacional.

Impacto no Mercado e Significado

O HappyHorse apareceu duas semanas depois que a OpenAI interrompeu o desenvolvimento do Sora. Seu movimento foi visto como um sinal de estagnação no campo de vídeo por IA, mas um modelo chinês assumiu o bastão.

O mercado reagiu rapidamente. O preço das ações do Alibaba subiu mais de 7% após a confirmação e continuou a subir. No fechamento do mercado em 10 de abril, estava em alta de mais de 3%, para HK$ 126,6.

Em um nível estratégico, o HappyHorse mostra que a ATH possui uma segunda equipe capaz de construir modelos multimodais de alto nível. Essa equipe tem experiência de negócios e entende as necessidades dos usuários e os cenários comerciais. Isso criou uma estrutura de motor duplo: Tongyi Lab (focado em pesquisa básica) e a Unidade de Inovação (construindo aplicações a partir de desafios reais de negócios).

Vamos olhar para a linha do tempo. Lin Junyang renunciou no início de março, e a ATH foi estabelecida em 16 de março. Em 2 de abril, o Qwen 3.6 Plus assumiu o primeiro lugar no volume de chamadas globais do OpenRouter, e em 8 de abril, o HappyHorse liderou a lista da Artificial Analysis. Em apenas um mês, o Alibaba produziu resultados poderosos tanto em modelos de linguagem quanto de vídeo.

Histórico da Equipe: Zhang Di e Alibaba ATH

Por trás do HappyHorse está o peso-pesado Zhang Di.

Ele era originalmente vice-presidente da Kuaishou e atuou como líder técnico do Kling AI. Ele é conhecido como o "pai do Kling". Ele deixou a Kuaishou em novembro de 2025 e assumiu como chefe do "Laboratório de Futuro da Vida" do Alibaba, reportando-se diretamente ao cientista-chefe Zheng Bo.

Cinco meses depois, sua equipe construiu o HappyHorse‑1.0 e superou o Kling e o Seedance 2.0 da ByteDance.

Essa equipe fazia parte inicialmente do Laboratório de Futuro da Vida do Taobao, mas foi transferida para a Unidade de Inovação em IA do grupo de negócios ATH após a última reorganização do Alibaba.

ATH significa "Alibaba Token Hub", estabelecido pelo CEO Wu Yongming em 16 de março, que o lidera pessoalmente. Sua missão é "criação, fornecimento e aplicação de tokens", e integra o Tongyi Lab, a linha de negócios MaaS, o departamento Qianwen, o departamento Wukong e a Unidade de Inovação em IA.

FAQ

Que tipo de GPU é necessária para executar o HappyHorse localmente?

Este modelo tem 15 bilhões de parâmetros e não é nada pequeno. Em um ambiente H100 único, leva cerca de 38 segundos para gerar um vídeo de 5 segundos em 1080p. GPUs de consumo como a RTX 4090 (24GB de VRAM) exigirão quantização ou descarga. É provável que exceda 24GB para inferência FP16. Alguns usuários relataram sucesso com quantização de 4 bits, mas a qualidade é reduzida. Para uso sério, recomenda-se uma GPU em nuvem com 40GB+ de VRAM. Alternativamente, é sensato esperar pelo lançamento da API em 30 de abril.

Posso fazer o fine-tuning (ajuste fino) do HappyHorse com meus próprios dados?

Sim, sob a licença. Não há restrições de uso comercial. No entanto, fazer o ajuste fino de um modelo de vídeo de 15 bilhões de parâmetros não é fácil. Requer um cluster H100 ou A100, um grande conjunto de dados de pares vídeo-áudio e recursos de engenharia significativos. O repositório do GitHub atualmente não contém scripts de ajuste fino e suporta apenas inferência. A equipe sugeriu lançar o código de treinamento no futuro, mas nenhuma data foi definida.

Existem grupos comunitários no Discord ou WeChat?

Existem, mas são não oficiais. Várias comunidades de IA iniciaram tópicos no Discord e WeChat. A equipe oficial ainda não abriu canais comunitários formais. Se você entrar em um grupo, cuidado com links falsos e golpes de phishing. É melhor verificar o repositório do GitHub e os anúncios oficiais do Alibaba ATH para obter as informações mais recentes.

Este modelo está disponível no Hugging Face?

Não até o momento desta escrita. A equipe declarou que está trabalhando em um lançamento no Hugging Face, mas ainda não está concluído. Atualmente, os pesos estão apenas no GitHub. Membros da comunidade começaram a fazer o upload de checkpoints convertidos para o Hugging Face, mas estes não são oficiais. Para segurança, utilize a fonte do GitHub até que a página oficial do Hugging Face apareça.