Resposta Rápida

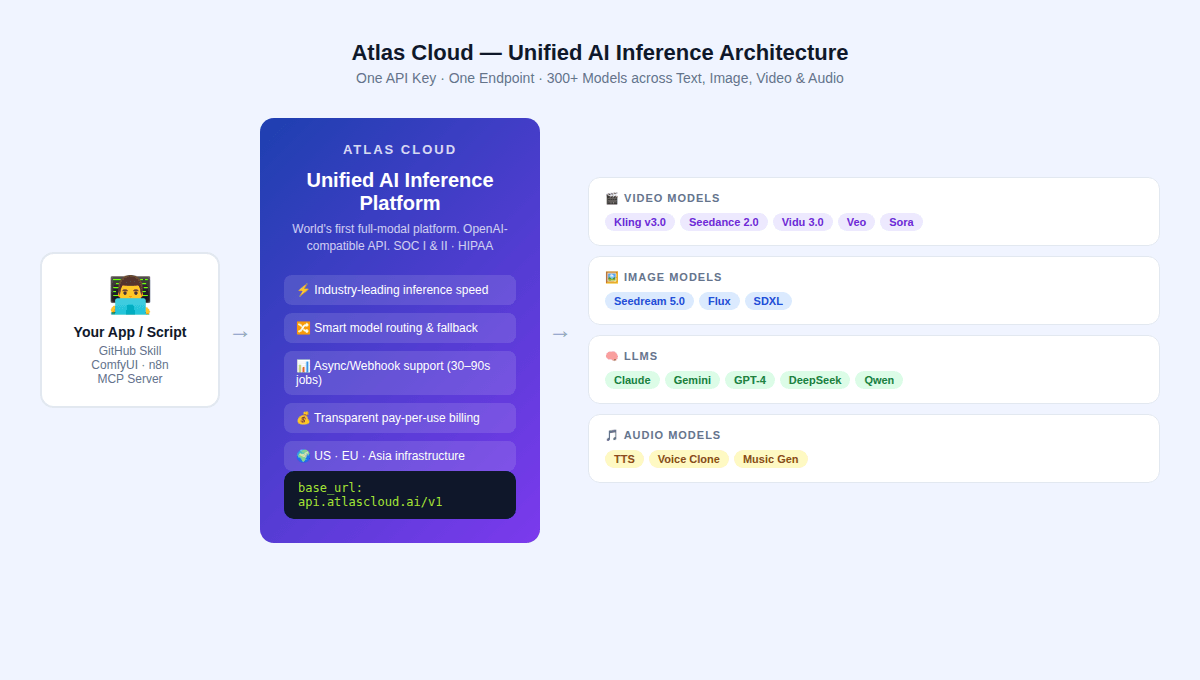

Uma Skill de Gerador de Vídeo por IA do GitHub conecta seu código a modelos de vídeo por IA. Em 2026, a escolha entre código aberto (gratuito, auto-hospedado) e APIs pagas (nuvem, instantâneo) depende de quatro variáveis: disponibilidade de VRAM, requisitos de privacidade de dados, nível de qualidade necessário e volume mensal de geração. Para fluxos de trabalho em escala de produção que precisam de vários modelos SOTA, o Atlas Cloud (atlascloud.ai) fornece acesso a mais de 300 modelos — incluindo Kling v3.0, Seedance 2.0, Vidu 3.0, Veo e Sora — por meio de uma única chave de API com preços transparentes de pagamento por uso.

-

O que é uma Skill de Gerador de Vídeo por IA? {#what-is-a-skill}

No contexto dos repositórios do GitHub, uma Skill de Gerador de Vídeo por IA é um módulo, wrapper ou camada de integração reutilizável que conecta uma aplicação a um back-end de geração de vídeo por IA — seja um modelo de código aberto auto-hospedado ou uma API de nuvem.

Pense nisso como a abstração entre a lógica da sua aplicação e o mecanismo de inferência real. Uma skill pode ser:

- Uma classe Python que envolve o pipeline do modelo para geração de texto para vídeotext

1Wan 2.2 - Um nó personalizado do ComfyUI conectando-se à API da Atlas Cloud para geração com Kling v3.0

- Um nó de fluxo de trabalho n8n que aciona o Seedance 2.0 via REST e retorna uma URL de vídeo

- Uma ferramenta LangChain ou skill de servidor MCP que chama um endpoint de geração de vídeo sob demanda

A pergunta central que todo desenvolvedor enfrenta ao criar uma: o back-end deve ser de pesos de código aberto rodando localmente ou uma API de nuvem paga?

Dados reais de 2026. Não é teoria.

-

Código aberto no GitHub em 2026 {#open-source-landscape}

O ecossistema de geração de vídeo de código aberto amadureceu significativamente. Alguns repositórios agora são alternativas genuínas às APIs pagas — pelo menos para certas tarefas.

Nível 1: Modelos de Código Aberto Prontos para Produção

HunyuanVideo (Tencent, 11,9 mil ⭐) — Um dos melhores geradores de vídeo de código aberto disponíveis. Lida com 720p e 1080p. A principal limitação é o requisito de hardware: 60–80 GB de VRAM para o modelo completo, tornando-o acessível apenas para equipes com acesso a GPU corporativa. A licença comunitária permite uso comercial com atribuição.

CogVideoX-1.5 (THUDM/CogVideo, 12,5 mil ⭐) Lançado sob Apache 2.0, este é um dos modelos abertos mais amigáveis para desenvolvedores. Ele carrega nativamente via Hugging Face Diffusers em algumas linhas de Python. As transições de quadros são suaves e o acompanhamento de prompt é forte. Requer 16 GB de VRAM no mínimo. Uma escolha sólida se sua equipe já trabalha com Hugging Face.

Open-Sora 2.0 (hpcaitech, 24,1 mil ⭐) O projeto de geração de vídeo de código aberto mais estrelado no GitHub. A versão 2.0 (11B parâmetros) alcança desempenho comparável ao HunyuanVideo nos benchmarks VBench, e o custo de treinamento foi relatado em aproximadamente US$ 200.000 — um número notável para um modelo desse calibre. Texto para vídeo, imagem para vídeo e geração de comprimento infinito.

Nível 2: Opções de código aberto mais leves (menor VRAM)

Wan 2.2 (Alibaba Tongyi) O histórico de acessibilidade aqui é atraente: a variante 1.3B roda em 8 GB de VRAM, e a variante 14B em 24 GB. A arquitetura Mixture-of-Experts (MoE) oferece melhores detalhes com menor custo computacional, e a versão 2.2 é 30% mais rápida em 720p que sua antecessora. Para desenvolvedores rodando uma única GPU de consumidor, o Wan 2.2 é a opção de código aberto mais forte.

LTX-Video (Lightricks) Projetado para velocidade acima de tudo. Gera 30fps em resolução 1216×704 mais rápido que o tempo real em hardware capaz. A integração com ComfyUI é madura, e upscalers espaciais e temporais estão integrados.

Nível 3: Pipelines Agenticos

OpenMontage (calesthio, novo em abril de 2026) Uma categoria genuinamente nova: um sistema de produção de vídeo agentico com 11 pipelines, 49 ferramentas e mais de 400 habilidades de agentes. Funciona com assistentes de codificação de IA como Claude Code, Cursor e Copilot. Lida com todo o pipeline — pesquisa, roteiro, ativos, edição — do início ao fim sem etapas manuais. Construído para equipes que conectam várias ferramentas de IA em um único fluxo de trabalho.

-

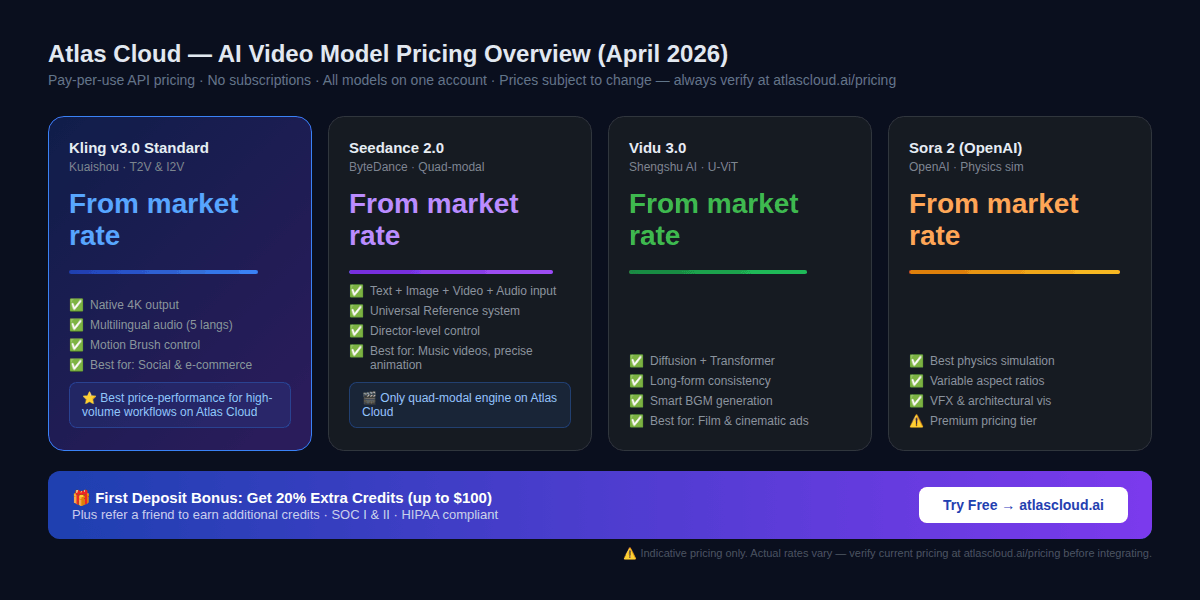

Diretório de APIs Pagas: Modelos SOTA Disponíveis Agora {#paid-api-directory}

O cenário de APIs pagas em 2026 é definido por três grandes famílias de modelos, cada uma com uma abordagem técnica distinta. Todas as três estão disponíveis através da API unificada do Atlas Cloud.

Kling v3.0 (Kuaishou)

Lançado em 5 de fevereiro de 2026. Construído sobre uma arquitetura de Linguagem Visual Multimodal — texto, imagens, áudio e vídeo, tudo gerenciado em um único sistema.

O que ele faz melhor que os concorrentes:

- Movimento humano complexo — corrida, dança, artes marciais — sem a deformação de "membros de espaguete" que assombra outros modelos

- Geração de áudio nativa multilíngue (5 idiomas, incluindo sincronização labial)

- Motion Brush: uma ferramenta que permite aos desenvolvedores (ou usuários finais) pintar caminhos de movimento diretamente nas imagens de origem — um recurso que atualmente não tem equivalente em modelos concorrentes

- Vinculação de elementos para rastreamento consistente de personagens e objetos entre as cenas

Onde ele falha: A velocidade de renderização é mais lenta que alguns concorrentes no nível Pro. As transições da ferramenta de storyboard podem ser "desajeitadas" segundo revisores independentes.

Melhor para: Vídeos curtos para TikTok e Reels, vídeos de produtos para e-commerce, qualquer coisa que precise de muito volume com personagens que realmente permaneçam consistentes.

Seedance 2.0 (ByteDance)

Lançado em 8 de fevereiro de 2026, o Seedance 2.0 representa uma mudança de paradigma em como o vídeo de IA é solicitado — de solicitações apenas de texto para um controle real baseado em referência ao estilo de um diretor.

A inovação técnica central: O Seedance 2.0 aceita entradas quad-modais — texto, imagem, vídeo e áudio — simultaneamente. Seu sistema "Universal Reference" permite que um desenvolvedor forneça um vídeo de referência de uma pessoa dançando, e o modelo replicará o movimento da câmera, as ações do personagem e a composição em uma saída gerada. Isso resolve a consistência do personagem de uma maneira que modelos puros de texto para vídeo não conseguem.

Testes independentes confirmam que ele se destaca em:

- Narração de histórias em várias cenas com identidade de personagem consistente entre cortes

- Geração de áudio e vídeo sincronizada (a arquitetura de ramificação dupla gera som e vídeo simultaneamente)

- Replicação precisa de composição e iluminação a partir de ativos de referência

Nota sobre disponibilidade: Em abril de 2026, o acesso à API internacional do Seedance 2.0 está disponível através de plataformas como a Atlas Cloud. O acesso direto à API BytePlus para desenvolvedores internacionais tem apresentado inconsistências de disponibilidade — confirme o status atual antes de criar uma dependência nos endpoints diretos da ByteDance.

Melhor para: Vídeos musicais, animação de personagens rigorosa, anúncios de produtos onde o movimento precisa ser exato, agências que executam fluxos de trabalho de storyboard para vídeo.

Vidu 3.0 (Shengshu AI / Tsinghua)

Construído sobre a arquitetura original U-ViT combinando tecnologias de Difusão e Transformer, o Vidu foca nas áreas onde a maioria dos vídeos de IA ainda luta: coerência ambiental e consistência cinematográfica.

Recursos distintos:

- Sistema de referência universal para iluminação consistente em sequências de várias cenas

- Geração inteligente de música de fundo que se adapta automaticamente ao clima da cena

- Geração de longa duração com forte consistência temporal (crítico para sequências com mais de 5 segundos)

Melhores casos de uso: Fluxos de trabalho de produção cinematográfica profissional, design de animação, publicidade criativa que exige qualidade cinematográfica.

Sora 2 (OpenAI)

O Sora 2 continua sendo o padrão para precisão de simulação de física. Quebre um copo em um prompt do Sora 2 e o padrão de estilhaçamento, a física dos fluidos e os reflexos se comportam como na realidade — a maioria dos concorrentes ainda não consegue igualar esse nível de consistência.

Melhor para: Trabalhos de VFX, visualização arquitetônica, B-roll de documentários, qualquer lugar onde a precisão física importe mais do que economizar dinheiro.

Preço: O Sora 2 possui a conta mais alta nesta categoria. Você está pagando pela computação.

-

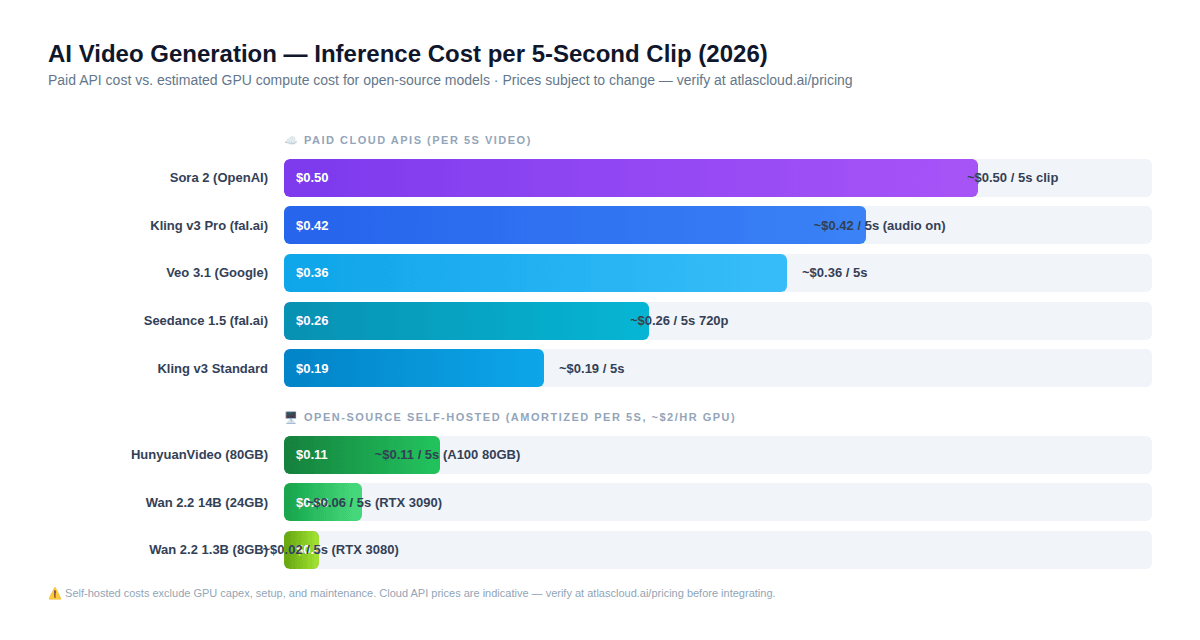

Custos de Inferência: Os Números Reais {#inference-costs}

Esta seção contém a descoberta contraintuitiva mais importante de todo este guia — uma que altera a intuição padrão da maioria dos desenvolvedores sobre código aberto vs. APIs pagas.

O Custo Oculto de Modelos Auto-Hospedados

A maioria dos desenvolvedores assume: "Código aberto = gratuito = sempre mais barato".

Essa suposição está errada para a maioria dos tamanhos de equipe.

Veja como é a matemática real para um clipe de vídeo de 5 segundos em 2026:

Código aberto auto-hospedado (custo de GPU amortizado em ~US$ 2/hora):

- Wan 2.2 1.3B (RTX 3080): ~US$ 0,02 por clipe de 5s

- Wan 2.2 14B (RTX 3090): ~US$ 0,06 por clipe de 5s

- HunyuanVideo (A100 80GB): ~US$ 0,11 por clipe de 5s

API de nuvem paga (preço indicativo — verifique em atlascloud.ai/pricing):

- Kling v3 Standard: ~US$ 0,19 por clipe de 5s

- Seedance 1.5 720p com áudio: ~US$ 0,26 por clipe de 5s

- Kling v3 Pro com áudio: ~US$ 0,42 por clipe de 5s

- Sora 2: ~US$ 0,50 por clipe de 5s

Os números de auto-hospedagem parecem atraentes isoladamente. O problema é que eles excluem:

- Hardware de GPU — Uma A100 80GB custa US$ 10 mil a US$ 15 mil. A 1.000 vídeos por mês (~US$ 0,11 cada), você levaria mais de 9.000 meses apenas para empatar no hardware.

- Tempo de configuração — A configuração do CUDA, download de pesos de modelo, gerenciamento de VRAM e depuração representam de 20 a 40 horas de engenharia de configuração inicial.

- Manutenção contínua — Atualizações de modelos, conflitos de dependência e confiabilidade da infraestrutura são custos de tempo contínuos.

- Custo de oportunidade — O tempo gasto na infraestrutura de inferência é tempo não gasto no produto.

A condição de limite prática:

A auto-hospedagem só compensa se: (a) você já tiver GPUs rodando outras cargas de trabalho, (b) estiver produzindo mais de 5.000 vídeos por mês ou (c) os regulamentos o obrigarem a manter tudo no local.

Abaixo desse limite, APIs pagas — especialmente plataformas unificadas como o Atlas Cloud — são mais baratas quando o custo total de propriedade é calculado honestamente.

-

Limitação de Taxa e Latência da API — O que os Desenvolvedores Realmente Encontram {#rate-limiting}

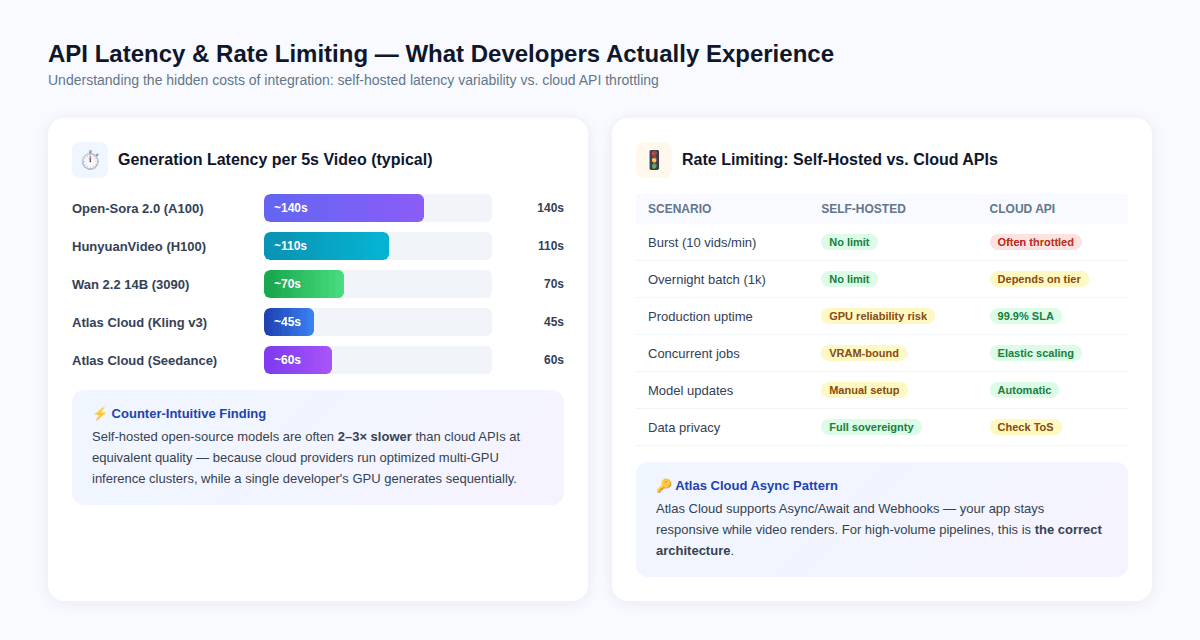

O Paradoxo da Latência

Contraintuitivamente, APIs de nuvem são frequentemente mais rápidas por vídeo do que modelos auto-hospedados — não porque os modelos sejam diferentes, mas porque os provedores de nuvem executam clusters de inferência multi-GPU otimizados com agrupamento em nível de hardware, enquanto uma única GPU de desenvolvedor gera quadros sequencialmente.

Latência típica por clipe de 5 segundos:

- Open-Sora 2.0 em A100: ~140 segundos

- HunyuanVideo em H100: ~110 segundos

- Wan 2.2 14B em RTX 3090: ~70 segundos

- Atlas Cloud / Kling v3: ~45 segundos

- Atlas Cloud / Seedance 2.0: ~60 segundos

Isso significa que construir uma skill do GitHub em torno de um modelo auto-hospedado pode produzir tempos de espera mais longos para o usuário, mesmo quando o custo por vídeo é menor.

Limitação de Taxa: A Realidade da Produção

Modelos auto-hospedados não têm limites de taxa impostos pela API — eles são limitados apenas pela VRAM e pelos limites térmicos da sua GPU.

APIs pagas impõem limites de taxa que variam de acordo com o nível de preço. As implicações de engenharia relevantes:

- Solicitações em rajada (mais de 10 vídeos por minuto) acionarão o throttling na maioria dos níveis de API paga

- Jobs em lote durante a noite (mais de 1.000 vídeos) exigem um design assíncrono cuidadoso para evitar timeouts

- Solicitações simultâneas em modelos auto-hospedados são limitadas pela VRAM — executar 2 inferências de modelo 14B simultâneas em uma única placa de 24 GB geralmente não é possível

O Atlas Cloud resolve o problema de limitação de taxa por meio da arquitetura Assíncrona/Webhook: sua aplicação envia um job de geração, recebe um ID de tarefa e é notificada via webhook quando a renderização é concluída. Esse padrão evita travamentos na aplicação enquanto o vídeo é renderizado e escala corretamente para cargas de trabalho em lote.

A Arquitetura Correta para Produção

plaintext1# Padrão Assíncrono do Atlas Cloud — Pronto para Produção 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key="SUA_CHAVE_API_ATLAS_CLOUD", 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10# Enviar tarefa de geração 11response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt="Vídeo de apresentação de produto, movimento suave, proporção 9:16", 14 size="1080x1920", 15 n=1 16) 17 18# Lidar com resposta assíncrona 19video_url = response.data[0].url 20print(f"Vídeo gerado: {video_url}")

Para fluxos de trabalho de imagem para vídeo, observe que alguns modelos — incluindo certas variantes Kling i2v — não aceitam um parâmetro de proporção separado para a geração de imagem para vídeo; a resolução de saída segue as dimensões da imagem de entrada. Crie sua geração de imagem upstream com a proporção de destino correta.

-

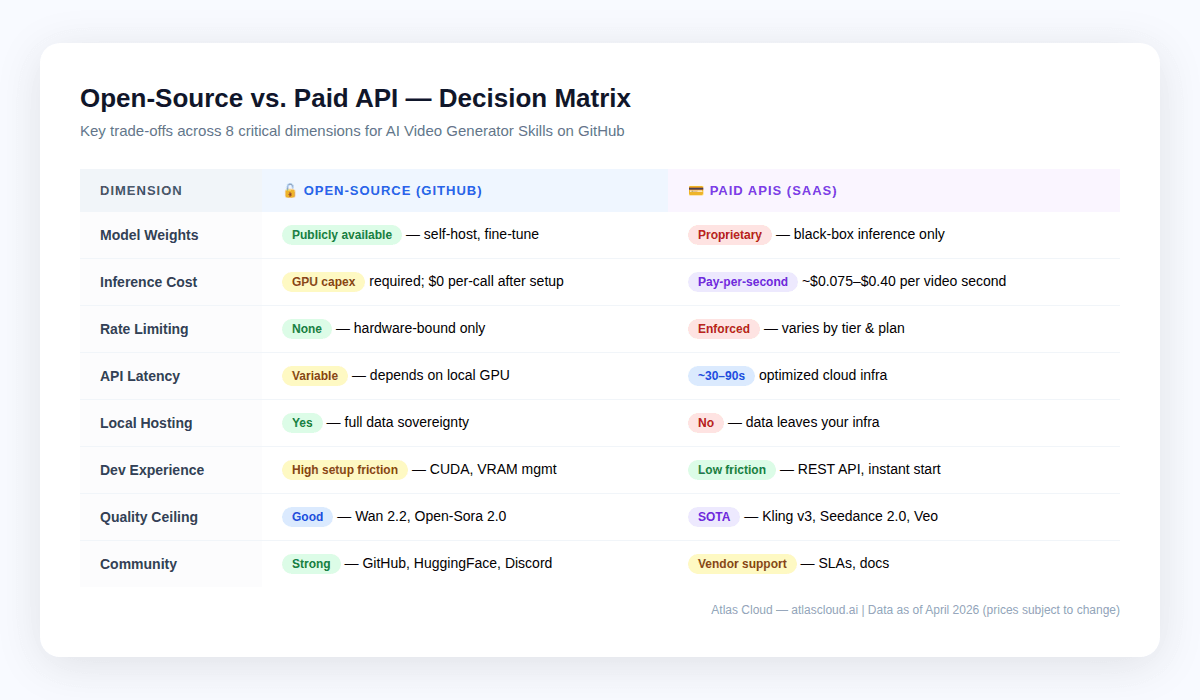

Hospedagem Local vs. API de Nuvem: A Matriz de Trocas {#local-vs-cloud}

Não é uma questão de "ou um ou outro". A maioria dos pipelines de produção mistura ambos: código aberto para prototipagem e passes de baixa qualidade em massa, APIs de nuvem para renderizações finais e qualidade de ponta.

Quando a hospedagem local faz sentido

- Travas de conformidade — HIPAA, GDPR ou qualquer coisa proprietária que não possa sair de seus servidores. A auto-hospedagem é sua única opção. A Atlas Cloud é compatível com HIPAA e possui certificação SOC I e II, o que atende à maioria das necessidades corporativas, mas empresas regulamentadas devem verificar seus requisitos específicos.

- Volume muito alto com qualidade aceitável — equipes que geram mais de 10.000 vídeos por mês nos níveis de qualidade do Wan 2.2 podem descobrir que os custos de aluguel de GPU são menores do que as taxas de API nessa escala.

- Pesquisa e ajuste fino — pesos de modelos abertos permitem o ajuste fino em conjuntos de dados proprietários. Nenhuma API de nuvem atualmente oferece treinamento de modelo personalizado.

- Configurações isoladas (air-gapped) — implantações de borda sem conectividade ou redes bloqueadas.

Quando as APIs de Nuvem Vencem

- Tempo de colocação no mercado (time-to-market) — uma integração com o Atlas Cloud leva horas, não semanas

- Qualidade de primeiro nível — líderes de código aberto como Wan 2.2 e Open-Sora 2.0 ainda ficam atrás de modelos proprietários como Kling v3 e Seedance 2.0, especialmente em movimento humano, mantendo cenas consistentes e áudio nativo

- Cargas de trabalho com picos — APIs de nuvem escalam para cima e para baixo; suas próprias GPUs não

- Menor volume — abaixo de ~5.000 vídeos por mês, APIs de nuvem geralmente vencem no custo total

- Flexibilidade de múltiplos modelos — o catálogo de mais de 300 modelos da Atlas Cloud significa que você pode alternar de Kling para Seedance e Veo dentro de uma única integração

-

Desenvolvimento Orientado pela Comunidade vs. Orientado pelo Fornecedor {#community-vs-vendor}

Fácil de ignorar ao comparar APIs, mas isso importa se você está criando skills para o GitHub.

Orientado pela comunidade (código aberto):

- Qualquer pessoa pode enviar correções de bugs e solicitar recursos — e tê-los mesclados

- A documentação geralmente é excelente porque a base de usuários contribui com exemplos

- Mudanças drásticas nas APIs de modelo acontecem lentamente, com períodos de notificação pública

- As comunidades ComfyUI e Hugging Face Diffusers possuem bibliotecas profundas de fluxos de trabalho prontos, adaptadores LoRA e checkpoints ajustados

- Artigos de pesquisa são lançados com código aberto e reproduzível

Desenvolvimento orientado pelo fornecedor (APIs pagas):

- A estabilidade da API é regida por SLAs comerciais — mudanças drásticas são menos frequentes, mas acontecem

- Novos lançamentos de modelos (por exemplo, Kling 3.0 em fevereiro de 2026, três dias antes do Seedance 2.0) acontecem em velocidade competitiva e muitas vezes sem aviso prévio

- Melhorias de modelo são implantadas no lado do servidor sem necessidade de ação do desenvolvedor

- A documentação técnica é mantida profissionalmente

A implicação prática para autores de skills do GitHub: se você está escrevendo uma skill que precisa permanecer estável e com baixa manutenção, uma API de nuvem com contratos de endpoint estáveis é mais fácil de manter do que uma skill vinculada a uma versão específica de um modelo de código aberto. Por outro lado, se sua skill foi projetada para dar aos desenvolvedores acesso aos modelos de pesquisa mais recentes sem custos de API, o ecossistema de código aberto é onde esse trabalho acontece.

-

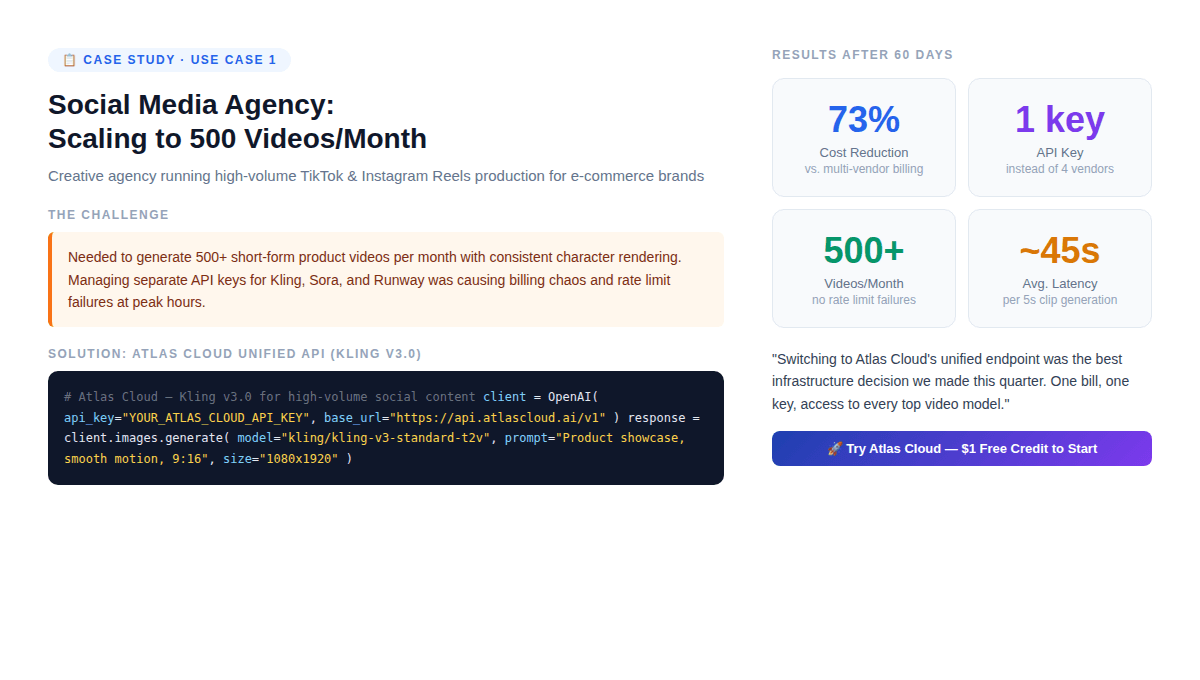

Estudo de Caso: Agência de Mídias Sociais (500 Vídeos/Mês) {#case-study-1}

A configuração: Uma agência criativa que faz vídeos curtos de produtos para 20 clientes de e-commerce. Eles precisam de 500 vídeos por mês, personagens que pareçam os mesmos entre os clipes, formato vertical 9:16, 5–10 segundos cada, processados em lote fora do horário comercial.

Arquitetura inicial (antes do Atlas Cloud):

- Chaves de API separadas para Kling, RunwayML e Pika

- Três painéis de faturamento, três pools de limites de taxa

- Seleção manual de modelo por cliente

- Falhas de limite de taxa em horários de pico causando atrasos na entrega

Problema que isso criou: Quando o Kling lançou a v3.0, a agência teve que reintegrar um novo SDK, atualizar o faturamento e testar a compatibilidade — três vezes para três fornecedores.

Solução: API unificada do Atlas Cloud com Kling v3.0 Standard

plaintext1# Atlas Cloud — Pipeline de Vídeo de Mídias Sociais 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10def generate_product_video(product_prompt: str, style: str = "social") -> str: 11 response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt=f"{product_prompt}, movimento suave, iluminação cinematográfica, formato vertical 9:16", 14 size="1080x1920", 15 quality="standard", 16 n=1 17 ) 18 return response.data[0].url

Resultados após 60 dias:

- Redução de 73% no custo por vídeo (fatura única, sem margens por fornecedor)

- Zero falhas de limite de taxa (a infraestrutura elástica do Atlas Cloud absorveu picos de carga)

- Alternar o modelo de Kling para Seedance para clientes específicos levou menos de 2 minutos (alterar um parâmetro)

- Bônus de 20% no primeiro depósito compensou efetivamente os custos de produção do primeiro mês

A descoberta não óbvia: A agência não reduziu a contagem de fornecedores porque o Kling ficou melhor. Eles reduziram porque gerenciar múltiplos relacionamentos com fornecedores a 500 vídeos/mês tem um custo operacional não trivial que não aparece no preço por API.

-

Estudo de Caso: Desenvolvedor Independente Construindo um SaaS de Vídeo {#case-study-2}

A configuração: Desenvolvedor solo criando uma ferramenta de "texto para demonstração de produto" para startups em estágio inicial. Precisa de vários estilos — cinematográfico, animado, live-action. Precisa validar rapidamente e manter a infraestrutura abaixo de US$ 200/mês enquanto descobre se alguém realmente quer isso.

Decisão de arquitetura:

O desenvolvedor considerou inicialmente auto-hospedar o Wan 2.2 em uma instância A100 alugada (~US$ 2/hora). Em 100 vídeos de teste durante a validação, o custo foi estimado em ~US$ 6 no total em tempo de GPU. Parecia mais barato que o Atlas Cloud.

O que o cálculo perdeu:

- Configurar o pipeline do Wan 2.2 levou 3 dias (dependências CUDA, gerenciamento de VRAM, configuração de servidor)

- A diferença de qualidade de saída do Wan 2.2 vs. Kling v3 significava que o SaaS não poderia cobrar o preço pretendido

- O gerenciamento de uptime do servidor adicionou ~2 horas/semana de manutenção contínua

Arquitetura revisada com o Atlas Cloud:

plaintext1# Roteamento flexível de modelo — alterne com base no nível do usuário 2MODEL_MAP = { 3 "free": "kling/kling-v3-standard-t2v", # Menor custo 4 "pro": "kling/kling-v3-professional-t2v", # Maior qualidade 5 "enterprise": "bytedance/seedance-2.0" # Controle máximo 6} 7 8def generate_demo_video(prompt: str, user_tier: str) -> str: 9 client = OpenAI( 10 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 11 base_url="https://api.atlascloud.ai/v1" 12 ) 13 response = client.images.generate( 14 model=MODEL_MAP[user_tier], 15 prompt=prompt, 16 n=1 17 ) 18 return response.data[0].url

Resultado: O desenvolvedor lançou em 4 dias em vez de 3 semanas. O uso do Seedance 2.0 no nível premium justificou um preço 3 vezes maior do que o nível gratuito, e a estrutura de modelo em níveis foi criada com uma única chave do Atlas Cloud — não três integrações separadas de fornecedores.

-

A Vantagem do Atlas Cloud: Por que "Uma API" é a Arquitetura Certa {#atlas-cloud-advantage}

O Atlas Cloud está posicionado como a primeira plataforma de inferência de IA multimodal completa do mundo — uma API unificada que atende a mais de 300 modelos de geração de texto, imagem, vídeo e áudio.

Para autores de Skills de Gerador de Vídeo por IA do GitHub, as vantagens específicas são:

-

API Compatível com OpenAI (Substituição Imediata)

O Atlas Cloud usa um endpoint compatível com OpenAI. Se sua skill já se integra ao SDK da OpenAI, mudar para o Atlas Cloud para geração de vídeo requer a alteração de duas linhas: a

1api_key1base_url-

Faturamento Único para Fluxos de Trabalho Multimodelo

Fluxos de trabalho de vídeo de produção raramente usam um único modelo. Um pipeline típico pode usar:

- Seedream 5.0 para geração de imagem (quadros iniciais)

- Kling v3.0 para conversão de imagem para vídeo

- Um LLM (Claude, GPT-4 ou DeepSeek) para otimização de prompt

- Um modelo de TTS para narração de voz

Com contas de fornecedores separadas, isso significa quatro relacionamentos de faturamento, quatro pools de limites de taxa e quatro pontos de integração. Com o Atlas Cloud, é uma chave de API e uma fatura.

-

Transparência de Preço por Modelo

O Atlas Cloud publica preços por modelo sem taxas de computação ocultas. O modelo de negócios é simples: pague pelo que você gerar. Novos desenvolvedores recebem um bônus de 20% no primeiro depósito (até US$ 100), e um programa de referência oferece créditos adicionais. Sempre verifique o preço atual em atlascloud.ai/pricing antes de criar projeções financeiras.

-

Cobertura de Conformidade

Para skills corporativas do GitHub implantadas em ambientes regulamentados: o Atlas Cloud possui certificação SOC I e II e é compatível com HIPAA, com infraestrutura nas regiões dos EUA, UE e Ásia. Isso cobre a maioria dos requisitos de residência de dados corporativos.

-

Integração com ComfyUI, n8n e Servidor MCP

O Atlas Cloud integra-se nativamente às ferramentas mais comumente usadas para construir skills de geração de vídeo do GitHub:

- ComfyUI — nós personalizados para autoria de fluxo de trabalho visual

- n8n — automação de fluxo de trabalho com passos de geração de vídeo do Atlas Cloud

- Servidor MCP — integração com Model Context Protocol para frameworks de agentes de IA

-

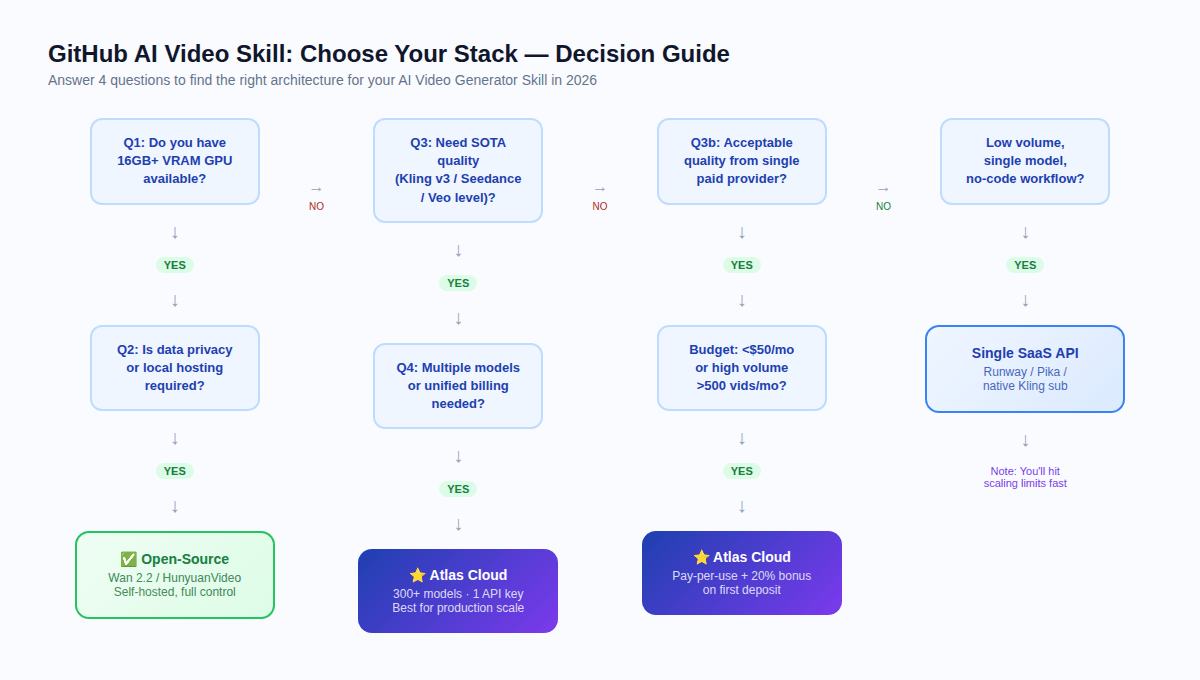

Qual Stack Você Deve Realmente Usar? {#decision-guide}

Responda a estas quatro perguntas:

P1: Você tem uma GPU com 16 GB+ de VRAM disponível?

Se não → ignore a auto-hospedagem completamente. A API de nuvem é seu único caminho prático.

P2: A privacidade dos dados ou a hospedagem local é exigida por regulamentação?

Se sim + GPU disponível → avalie código aberto (Wan 2.2 ou HunyuanVideo, dependendo da VRAM).

Se sim + sem GPU → use o Atlas Cloud (compatível com HIPAA, certificado SOC) e revise seus requisitos regulatórios específicos.

P3: Você requer qualidade SOTA (nível Kling v3, Seedance 2.0, Veo)?

Se sim → API de nuvem necessária. Modelos de código aberto têm uma lacuna de qualidade significativa em relação aos principais modelos proprietários em 2026.

Se qualidade aceitável em nível de código aberto → o Wan 2.2 auto-hospedado pode funcionar.

P4: Você precisa de vários modelos ou faturamento unificado?

Se sim → Atlas Cloud. Gerenciar três contas de fornecedores em escala tem um custo operacional oculto que só se torna visível em volume de produção.

Recomendações de Resumo por Caso de Uso

| Caso de Uso | Stack Recomendada |

| Pesquisa / prototipagem | Código aberto (Wan 2.2, CogVideoX) |

| Agência de mídias sociais, 500+/mês | Atlas Cloud + Kling v3.0 |

| Vídeo musical / animação de personagens | Atlas Cloud + Seedance 2.0 |

| VFX / simulação de física | Atlas Cloud + Sora 2 |

| Dados soberanos / offline | Auto-hospedado (HunyuanVideo, Open-Sora 2.0) |

| SaaS com qualidade de modelo em níveis | Atlas Cloud (uma chave, múltiplos modelos) |

| Lote de código aberto de alto volume | Wan 2.2 auto-hospedado (limite de 10.000+/mês) |

-

FAQ {#faq}

P: O que é uma Skill de Gerador de Vídeo por IA?

Um módulo de código reutilizável ou camada de integração que conecta uma aplicação a um back-end de geração de vídeo por IA — seja pesos de código aberto ou uma API de nuvem. Formas comuns: classe Python, nó ComfyUI, fluxo de trabalho n8n, ferramenta de servidor MCP.

P: Qual é a VRAM mínima para auto-hospedar um modelo de vídeo de código aberto?

8 GB de VRAM para o Wan 2.2 1.3B (qualidade aceitável para clipes curtos). 16 GB para CogVideoX-1.5 ou Open-Sora (melhor qualidade). 24 GB+ para o Wan 2.2 14B. 60–80 GB para o HunyuanVideo ou o modelo completo do Open-Sora 2.0.

P: A geração de vídeo por IA de código aberto é realmente gratuita?

Os pesos do modelo são gratuitos. A inferência não é gratuita — requer computação de GPU. Em baixo volume (<5.000 vídeos/mês), APIs de nuvem como o Atlas Cloud são geralmente mais baratas quando o custo total de propriedade é calculado.

P: Posso usar o Atlas Cloud para fluxos de trabalho de imagem para vídeo (i2v)?

Sim. O Atlas Cloud suporta variantes i2v para Kling, Seedance e Vidu. Nota: para modelos i2v, algumas variantes não aceitam um parâmetro de proporção separado — a resolução de saída segue as dimensões da imagem de entrada.

P: Como o Atlas Cloud lida com a limitação de taxa?

O Atlas Cloud suporta padrões Assíncronos/Webhook. Jobs de geração de vídeo são enviados como tarefas; sua aplicação recebe um ID de tarefa e é notificada quando a renderização é concluída. Isso evita bloqueios em escala.

P: Qual é o melhor modelo para consistência de personagem entre cenas?

O sistema Universal Reference do Seedance 2.0 é a solução mais avançada em 2026. Ele permite que você forneça vídeos de referência, imagens e áudio para manter a aparência e o movimento consistentes dos personagens em clipes gerados.

P: O Atlas Cloud suporta o ComfyUI?

Sim. O Atlas Cloud tem integração nativa com ComfyUI, bem como nós n8n e compatibilidade com servidor MCP.

P: Como os modelos de vídeo de código aberto lidam com proporções?

Varia conforme o modelo. O Open-Sora suporta 16:9, 9:16, 1:1 e 2.39:1 via flag

1--aspect_ratioResumo

O cenário de 2026 se divide em dois campos, cada um com seu ponto ideal:

Código aberto faz sentido se você tiver GPUs sobressalentes, estiver produzindo mais de 10 mil vídeos por mês, os dados não puderem sair de seus servidores ou você precisar ajustar em suas próprias filmagens proprietárias.

APIs pagas são a melhor escolha se você precisa da melhor qualidade disponível, velocidade importa mais do que custo, você tem menos de 5 mil vídeos por mês ou deseja misturar vários modelos sem lidar com contratos de fornecedores.

O Atlas Cloud faz a ponte entre os dois: como uma plataforma unificada que fornece acesso a mais de 300 modelos — incluindo os principais modelos de código aberto via inferência hospedada e todos os principais modelos proprietários — por meio de uma única chave de API compatível com OpenAI. Para a maioria dos desenvolvedores criando Skills de Gerador de Vídeo por IA para o GitHub em 2026, é o caminho de menor atrito do protótipo à produção.

As informações de preços neste artigo são indicativas e estão sujeitas a alterações. Sempre verifique as taxas atuais em atlascloud.ai/pricing antes de criar projeções financeiras. A disponibilidade do modelo pode variar por região.

Atlas Cloud: atlascloud.ai — Certificado SOC I e II · Compatível com HIPAA · Infraestrutura nos EUA · UE · Ásia