Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Explorar Modelos Líderes

O Atlas Cloud oferece os modelos criativos mais avançados e inovadores do setor.

O Que Faz Seedream5.0 Models Se Destacar

Atlas Cloud fornece os modelos criativos líderes da indústria mais recentes.

Captura de Tendências em Tempo Real

Equipado com capacidades de prospeção na web para integrar tendências globais em tempo real e tópicos atuais nas criações, quebrando as barreiras da atualidade do conhecimento.

Raciocínio Lógico Profundo

Transcende a geração tradicional de imagens com pensamento espacial e capacidades de raciocínio em múltiplas etapas, apto a lidar com composições complexas e leis do mundo físico.

Edição precisa e controlável

Suporta modificações exigentes e adesão estrita às instruções, alcançando uma repintura local perfeita enquanto mantém a consistência absoluta do sujeito.

Qualidade cinematográfica Ultra-HD

Oferece detalhes requintados e iluminação e texturas de nível profissional, atendendo às rigorosas exigências de produção comercial de alta fidelidade.

Texto e Layout Profissionais

Possui capacidades estéticas superiores na renderização de texto e layout, capaz de gerar materiais de design complexos, como pôsteres e gráficos com texto denso.

Velocidade máxima

Menor custo

| Modalidade | Descrição |

|---|---|

| Seedream v5.0 T2I Lite API(Text To Image) | A API Seedream v5.0 T2I Lite permite que criadores convertam instantaneamente descrições de texto em visuais de alta fidelidade. Com saída PNG e um modo rápido de otimização de prompts, ela agiliza o processo de design para prototipagem rápida, conceituação de UI/UX e iteração criativa de alta velocidade, onde velocidade e clareza são fundamentais. |

| Seedream v5.0 I2I Lite Edit API(Image To Image) | A API Seedream v5.0 I2I Lite Edit fornece aos desenvolvedores ferramentas para transformar imagens existentes por meio de prompts de texto e imagens de referência. Ela permite transferências de estilo contínuas e edição precisa de conteúdo, perfeita para design iterativo e personalização de ativos de marca. |

| Seedream v5.0 T2I Lite Sequential API(Text To Image) | A API Seedream v5.0 T2I Lite Sequential revoluciona a criação de conteúdo em massa ao gerar até 15 imagens relacionadas em uma única solicitação. Ela é otimizada para produção de ativos em grande volume, expansão de storyboards e construção abrangente de mundos visuais. |

| Seedream v5.0 I2I Lite Edit Sequential API(Image To Image) | A Seedream v5.0 I2I Lite Edit Sequential API capacita os usuários a aplicar edições consistentes em uma série de imagens simultaneamente. Ao processar até 15 visuais relacionados em um único lote, garante harmonia visual e continuidade de estilo, tornando-se a solução ideal para variações de design de personagens, edição de sequências e narrativa visual complexa. |

Novos recursos de Seedream5.0 Models + Showcase

A combinação de modelos avançados com a plataforma acelerada por GPU do Atlas Cloud oferece velocidade, escalabilidade e controle criativo incomparáveis para geração de imagens e vídeos.

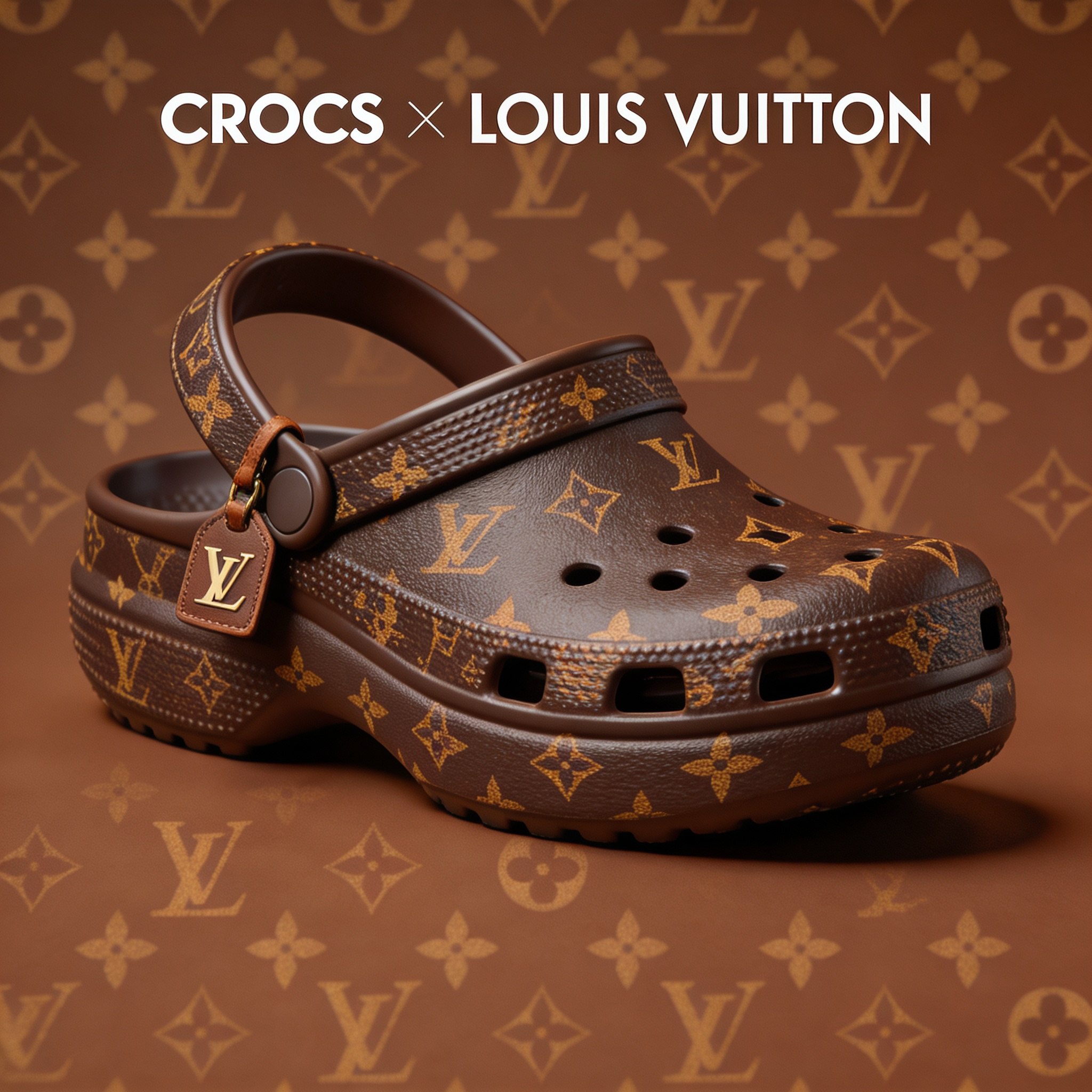

Recursos de pesquisa na web em tempo real utilizando a API Seedream 5.0

O Seedream 5.0 apresenta um fluxo de trabalho de "pesquisa e geração" inédito no setor, que preenche a lacuna entre informações ao vivo e síntese visual. Ao capturar notícias em alta, eventos globais e dados em tempo real, ele infunde no modelo uma ampla base de "Conhecimento Geral". É a ferramenta definitiva para criar conteúdo editorial oportuno, visualizações baseadas em dados e ativos de marketing culturalmente relevantes.

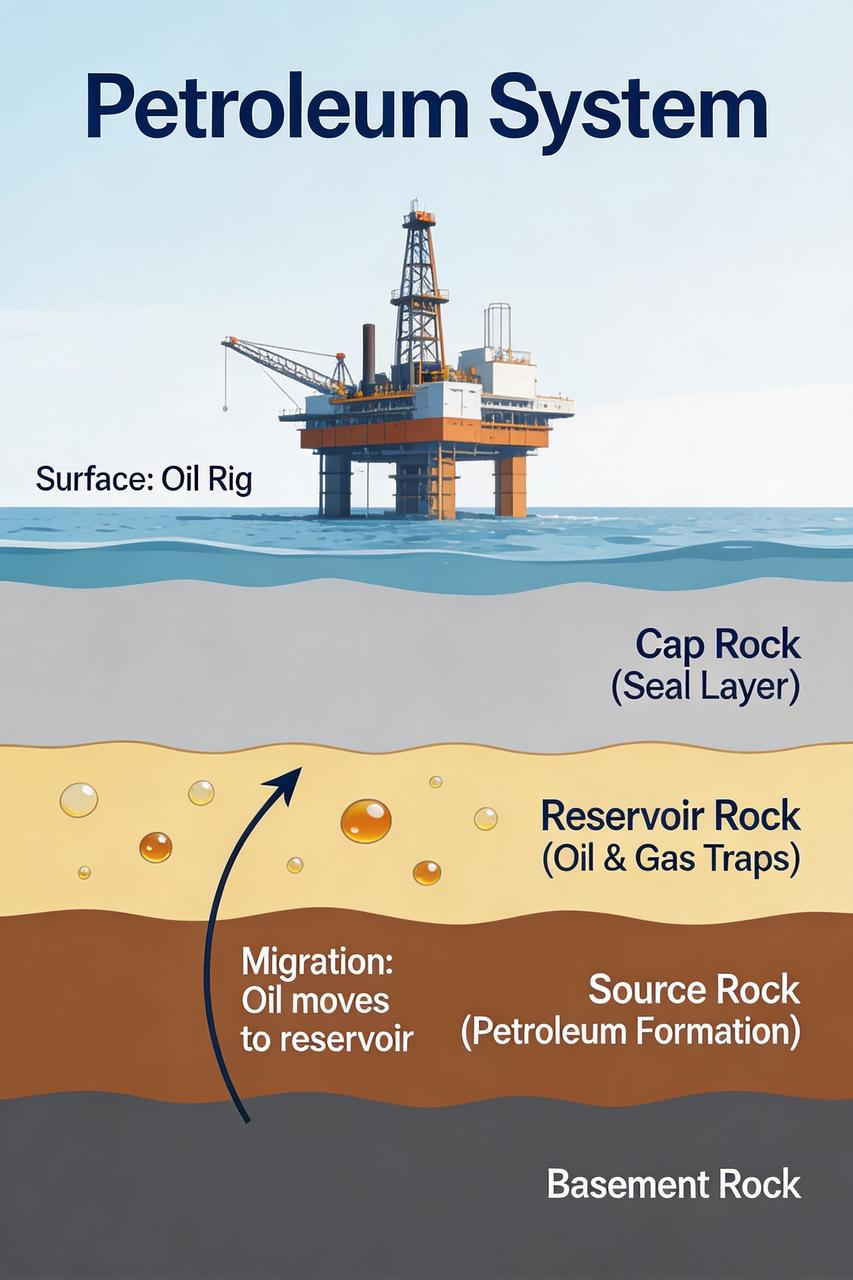

Raciocínio Lógico Inteligente e Conformidade Física usando a API Seedream 5.0

Esta versão integra um profundo conhecimento vertical da indústria — das ciências biológicas ao design arquitetônico — para garantir uma rigorosa integridade estrutural. Ela interpreta com precisão relações lógicas complexas enquanto adere estritamente às leis físicas do mundo real, incluindo layouts espaciais e consistência de iluminação. Fornece uma solução fundamental para visualização científica, prototipagem industrial e renderização ambiental hiper-realista.

Controle preciso e editabilidade com Seedream 5.0 API

A API Seedream 5.0 possui recursos avançados de seguimento de instruções e referência multimodal para um controle sem precedentes sobre a saída visual. Ao alavancar algoritmos de aprendizado sofisticados, ela pode reutilizar automaticamente elementos visuais específicos e manter a persistência de identidade em diversos contextos. Serve como um motor poderoso para a criação de ativos alinhados à marca, consistência de personagens e refinamento criativo iterativo.

O Que Você Pode Fazer com Seedream5.0 Models

Descubra casos de uso práticos e fluxos de trabalho que você pode construir com esta família de modelos — da criação de conteúdo e automação a aplicações de nível produção.

Marketing Dinâmico Sensível ao Contexto com Seedream 5.0

A API Seedream 5.0 capacita as marcas a gerar visuais que pulsam com o mundo real. Ao integrar a primeira Pesquisa Web em Tempo Real do setor, ela captura estéticas em alta e dados ao vivo para produzir imagens culturalmente relevantes. É a solução definitiva para campanhas sociais responsivas a notícias, conteúdo editorial baseado em dados e qualquer projeto que exija contexto global atualizado e narrativa visual.

Prototipagem Industrial e Científica de Alta Precisão com Seedream 5.0

Para projetos que exigem integridade estrutural, o Seedream 5.0 oferece imagens com lógica vertical incorporada e rigorosa conformidade física. Ele domina layouts espaciais complexos, iluminação consistente e precisão de materiais. Este caso de uso é ideal para visualização arquitetônica, design de produtos industriais e ilustrações científicas, onde a precisão e as leis físicas do mundo real são tão críticas quanto a qualidade estética.

Narrativa de marca unificada e consistência de personagens com Seedream 5.0

O Seedream 5.0 oferece controle incomparável sobre a persistência visual através de sua Geração Sequencial e recursos avançados de referência. Ao aprender e reutilizar elementos visuais específicos, os criadores podem manter a consistência de identidade perfeita em vários quadros. Ideal para construção de mundos de personagens, lookbooks de moda de alta qualidade e conjuntos de ativos de marca coesos que exigem uma voz estilística unificada em cada solicitação.

Comparação de Modelos

Veja como os modelos de diferentes provedores se comparam — compare desempenho, preços e pontos fortes exclusivos para tomar uma decisão informada.

| Modelo | Limite de imagens de referência | Número de saídas | Resolução | Proporção de aspecto |

|---|---|---|---|---|

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 4.5 | 10 | 1~15 | 1080P~4K+ | Width[1440, 4096]px; Height[1440, 4096]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Wan 2.6 I2I(Image To Image) | 4 | 1 | 580P~1080P+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 9:21 |

How to Use Seedream5.0 Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Por Que Usar Seedream5.0 Models no Atlas Cloud

Combine modelos avançados de Seedream5.0 Models com a plataforma acelerada por GPU do Atlas Cloud, fornecendo desempenho, escalabilidade e experiência de desenvolvimento incomparáveis.

Desempenho e Flexibilidade

Baixa Latência:

Inferência otimizada por GPU para respostas em tempo real.

API Unificada:

Uma única integração para acessar Seedream5.0 Models, GPT, Gemini e DeepSeek.

Preços Transparentes:

Faturamento por Token, suporta modo Serverless.

Empresa e Escala

Experiência do Desenvolvedor:

SDK, análise de dados, ferramentas de ajuste fino e modelos tudo em um.

Confiabilidade:

99.99% de disponibilidade, controle de permissões RBAC, logs de conformidade.

Segurança e Conformidade:

Certificação SOC 2 Type II, conformidade HIPAA, soberania de dados nos EUA.

Perguntas Frequentes sobre Seedream5.0 Models

A Sequential API do Seedream v5.0 permite a geração de até 15 imagens relacionadas em uma única solicitação, garantindo rigorosa consistência temática e estilística em todo o lote.

Sim. O modelo possui bases de conhecimento de indústrias verticais incorporadas, permitindo-lhe aderir às leis físicas do mundo real, à lógica espacial e à consistência de iluminação exigidas para o design profissional.

Através de capacidades avançadas de Seguimento de Instruções e Referência, o Seedream 5.0 pode reutilizar automaticamente elementos visuais específicos e manter a persistência de identidade em diferentes gerações.

Explorar Mais Séries

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.