OpenAI LLM Models

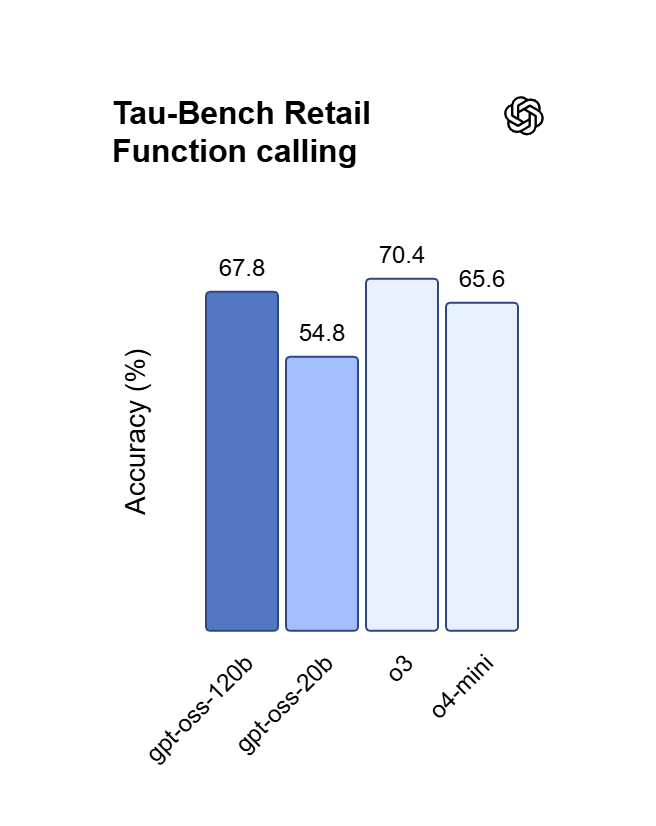

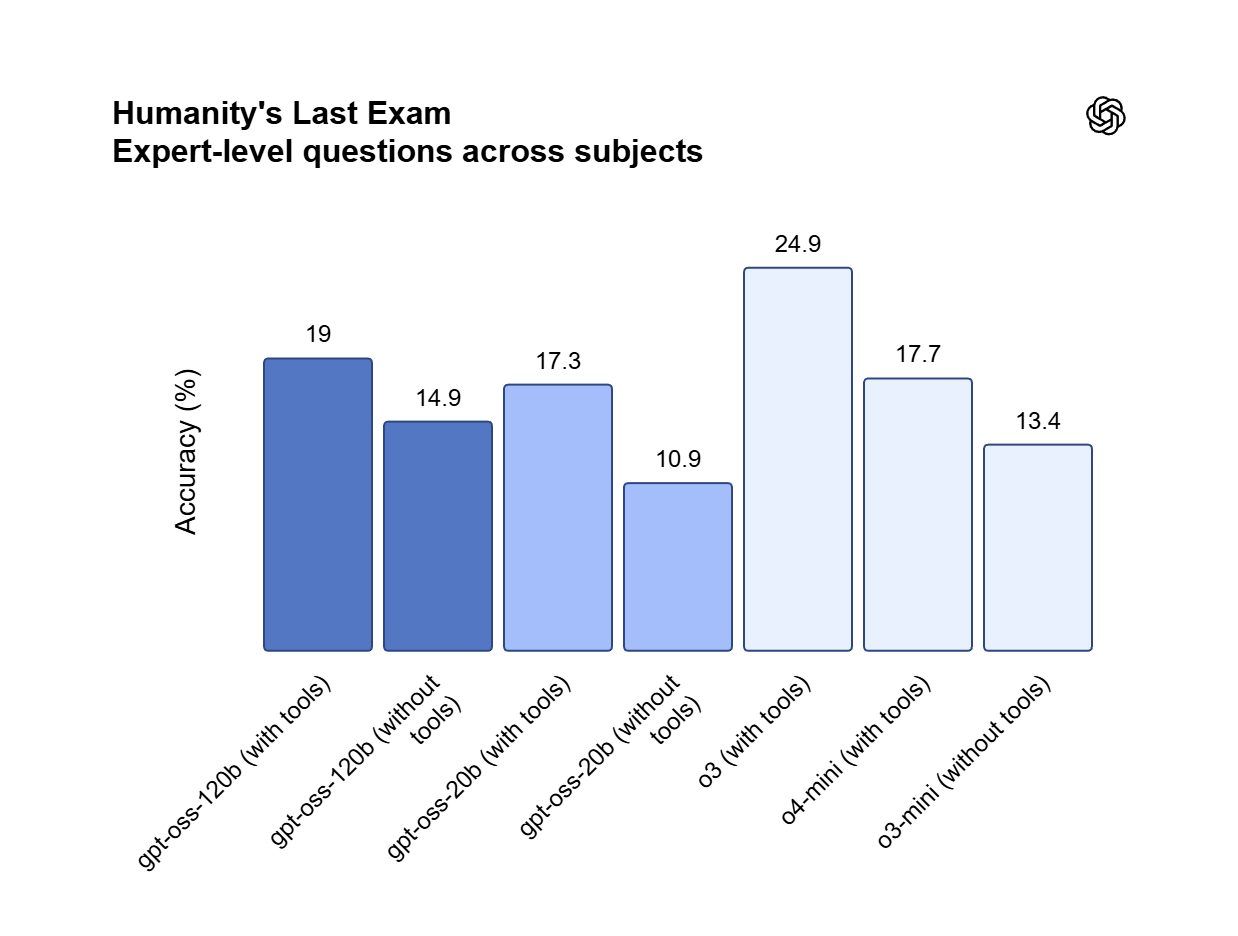

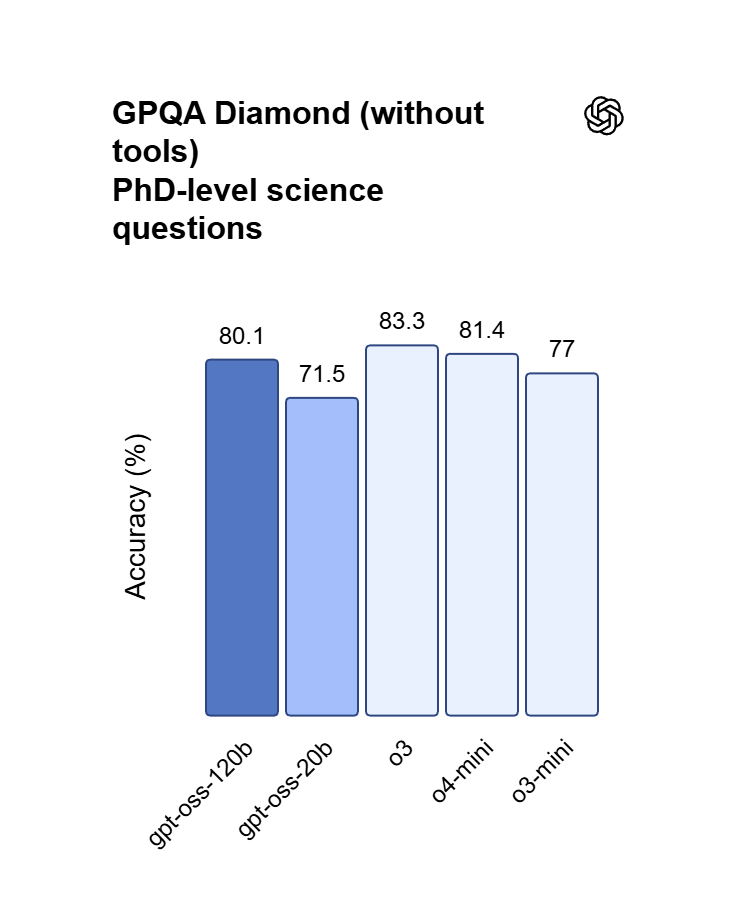

OpenAI’s premier GPT model family leads the industry, highlighted by the GPT OSS 120B which achieves near-parity with OpenAI o4-mini on core reasoning benchmarks while running efficiently on a single 80GB GPU. Perfectly optimized for vibecoding and complex logic operations, this model balances top-tier intelligence with hardware accessibility for modern developers and AI-driven web development.

โมเดลกำลังจะเปิดตัว

เรากำลังเก็บรายละเอียดสุดท้ายของคอลเลกชันนี้ — ในระหว่างนี้ ลองสำรวจคอลเลกชันที่คล้ายกันด้านล่าง

สำรวจกลุ่มเพิ่มเติม

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.

สิ่งที่ทำให้ OpenAI LLM Models โดดเด่น

Atlas Cloud มอบโมเดลสร้างสรรค์ล้ำสมัยชั้นนำของอุตสาหกรรมให้กับคุณ

Frontier Research

Cutting-edge models that set global benchmarks in reasoning, multimodality, and AI safety.

Cost-Efficient Performance

Optimized families like GPT-4.1 mini and GPT-5 nano balance accuracy, speed, and cost.

Developer Ecosystem

APIs powering millions of daily requests across diverse platforms and industries.

Flexible Model Sizes

Choice of flagship, mini, and nano models for every workload and budget.

Enterprise Reliability

SLAs, monitoring, and compliance-ready logging trusted by Fortune 500 companies.

Open Model Options

Access to open-source models (gpt-oss-20b, gpt-oss-120b) for transparency and customization.

ความเร็วสูงสุด

ต้นทุนต่ำที่สุด

| โมเดล | คำอธิบาย |

|---|---|

| GPT OSS 120B | GPT OSS 120B คือ LLM ประสิทธิภาพสูงที่เน้นการใช้เหตุผล ผสานรวมสถาปัตยกรรมที่ได้รับการปรับปรุงเข้ากับความสามารถในการประมวลผลบริบทขนาด 131.07K ที่แข็งแกร่ง สามารถทำงานได้ใกล้เคียงกับ OpenAI o4-mini บน GPU ขนาด 80 GB เพียงตัวเดียว โดยทำหน้าที่เป็นเครื่องมือสำหรับการพัฒนาแบบวนซ้ำอย่างรวดเร็ว ซึ่งรวมถึง vibecoding และการดำเนินการเวิร์กโฟลว์ที่ขับเคลื่อนด้วยตรรกะที่ซับซ้อน |

ฟีเจอร์ใหม่ของ OpenAI LLM Models + โชว์เคส

การผสมผสานโมเดลขั้นสูงกับแพลตฟอร์มเร่งความเร็ว GPU ของ Atlas Cloud มอบความเร็ว ความสามารถในการปรับขนาด และการควบคุมเชิงสร้างสรรค์ที่ไม่มีใครเทียบได้สำหรับการสร้างภาพและวิดีโอ

การปฏิบัติตามคำสั่งอย่างแม่นยำผ่าน GPT OSS 120B

GPT OSS 120B แสดงให้เห็นถึงความสามารถในการควบคุมทิศทางที่ยอดเยี่ยม โดยปฏิบัติตาม System Prompts ที่ซับซ้อนอย่างเคร่งครัดเพื่อรับประกันความน่าเชื่อถือของผลลัพธ์อย่างสมบูรณ์ ด้วยการใช้สถาปัตยกรรม Alignment ที่ได้รับการปรับแต่งมาอย่างละเอียด ผู้ใช้จึงสามารถบังคับใช้รูปแบบ ข้อจำกัด และความแตกต่างทางสไตล์ที่เฉพาะเจาะจงได้โดยไม่มีความคลาดเคลื่อนของตัวอักษร (Zero Character Drift) นี่คือตัวเลือกที่ชัดเจนสำหรับ Autonomous Agents, การดึงข้อมูลแบบมีโครงสร้าง และสภาพแวดล้อมการผลิตที่มีความสำคัญต่อภารกิจ

อธิปไตยทางการค้าภายใต้สัญญาอนุญาต Apache 2.0

GPT OSS 120B เผยแพร่ภายใต้ใบอนุญาต Apache 2.0 ซึ่งอนุญาตให้ใช้งานเชิงพาณิชย์ได้อย่างไม่จำกัดและสามารถปรับแต่ง (fine-tuning) แบบส่วนตัวได้โดยไม่มีค่าธรรมเนียมต่อโทเค็น ซึ่งต่างจาก API แบบปิดซอร์ส ตรงที่ช่วยให้สามารถโฮสต์ภายในเครื่องบน GPU ขนาด 80 GB ตัวเดียว เพื่อเก็บรักษาข้อมูลกรรมสิทธิ์ที่ละเอียดอ่อนไว้ภายในองค์กร (on-premises) ได้อย่างสมบูรณ์ กรอบการทำงานนี้มอบอิสระทางกฎหมายและทางเทคนิคในการสร้าง แก้ไข และขยายซอฟต์แวร์สแต็กที่ขับเคลื่อนด้วย AI

ตรรกะประสิทธิภาพสูงและ Vibecoding ด้วย GPT OSS 120B

ด้วยความสามารถที่เกือบเทียบเท่ากับ OpenAI o4-mini โมเดลขนาด 120B พารามิเตอร์นี้มีความโดดเด่นในการจัดการกับการสังเคราะห์โค้ดที่ซับซ้อนและการพิสูจน์ทางคณิตศาสตร์ นักพัฒนาสามารถใช้ประโยชน์จากระบบการให้เหตุผล (reasoning engine) สำหรับ "vibe coding" ซึ่งคือการแปลแนวคิดจากภาษาธรรมชาติให้กลายเป็นเว็บแอปพลิเคชันที่ใช้งานได้จริงโดยตรงผ่านการใช้คำสั่ง (prompting) แบบวนซ้ำ นี่คือโซลูชันความเร็วสูงสำหรับการแก้ไขจุดบกพร่อง (debug) ของตรรกะที่ซ้อนทับกันและการจัดการเวิร์กโฟลว์การจัดตารางงานที่ซับซ้อน

สิ่งที่คุณทำได้กับ OpenAI LLM Models

ค้นพบกรณีการใช้งานจริงและเวิร์กโฟลว์ที่คุณสามารถสร้างด้วยตระกูลโมเดลนี้ — ตั้งแต่การสร้างเนื้อหาและระบบอัตโนมัติไปจนถึงแอปพลิเคชันระดับโปรดักชัน

การแก้ไขจุดบกพร่องของตรรกะเชิงลึกและการสร้างต้นแบบด้วย GPT OSS 120B

GPT OSS 120B ช่วยให้วิศวกรสามารถแก้ปัญหาความท้าทายด้าน "vibecoding" ได้โดยการแปลงแนวคิดทางสถาปัตยกรรมระดับสูงให้เป็นส่วนประกอบ Python หรือ React ที่พร้อมใช้งานในระดับโปรดักชัน เครื่องมือให้เหตุผล (Reasoning engine) ของโมเดลสามารถจัดการกับการขึ้นต่อกันที่ซ้อนทับกัน (nested dependencies) และกรณีขอบเขต (edge cases) ที่มักทำให้โมเดลขนาดเล็กสะดุด เพื่อให้มั่นใจว่าการสังเคราะห์โค้ดแบบหลายขั้นตอนยังคงทำงานได้ดี ด้วยการรองรับการพิสูจน์อัลกอริทึมและการจัดตารางงานที่ซับซ้อน นี่จึงเป็นเครื่องมือที่สมบูรณ์แบบสำหรับการสร้าง MVP ทางเทคนิค, สคริปต์ QA อัตโนมัติ, และเว็บแอปพลิเคชันที่ใช้ข้อมูลจำนวนมาก

เครื่องมือเฉพาะแบบออฟไลน์ที่ใช้ GPT OSS 120B

ภายใต้ใบอนุญาต Apache 2.0 ทีมงานสามารถโฮสต์ GPT OSS 120B บน GPU ขนาด 80 GB ตัวเดียวเพื่อประมวลผลข้อมูลภายในที่ละเอียดอ่อนโดยไม่มีความเสี่ยงจากการรั่วไหลบนคลาวด์ การตั้งค่านี้ช่วยให้สามารถทำ Fine-tuning ภายในเครื่องแบบถาวรบนฐานโค้ดภายในเฉพาะกลุ่มหรือบันทึกทางการแพทย์ได้โดยไม่ต้องเสียค่าใช้จ่าย API ต่อโทเค็นซ้ำๆ โมเดลนี้เหมาะอย่างยิ่งสำหรับเครื่องมือภายในที่มีความปลอดภัยสูงและความช่วยเหลือด้าน AI แบบออฟไลน์ โดยมอบอำนาจธิปไตยเหนือค่าน้ำหนัก (Weight) อย่างเต็มที่ รองรับระบบ RAG ส่วนตัวและสแต็กซอฟต์แวร์ที่เป็นกรรมสิทธิ์แบบกำหนดเอง

การดึงข้อมูลแบบสกีมาสมบูรณ์ด้วย GPT OSS 120B

GPT OSS 120B ช่วยให้นักพัฒนาสามารถแปลงเอกสารที่ยุ่งเหยิงและไม่มีโครงสร้างให้เป็น JSON หรือ Markdown ที่มีการจัดรูปแบบอย่างเคร่งครัดโดยปราศจาก "ความคลาดเคลื่อนของคำสั่ง" (instruction drift) ด้วยการยึดหน้าต่างบริบทขนาด 131.07K ไว้อย่างแน่นหนาด้วยกฎระบบที่เข้มงวด โมเดลจึงรับประกันว่าฟิลด์ต่างๆ จะไม่ถูกสร้างขึ้นมาเอง (hallucinated) หรือถูกข้ามไปในระหว่างการประมวลผลรูปแบบยาว เหมาะอย่างยิ่งสำหรับการทำงานอัตโนมัติของ CRM และการแท็กเนื้อหาอัตโนมัติ โดยยังคงรักษาขอบเขตตรรกะที่ปลอดภัยในชุดข้อมูลขนาดใหญ่ ซึ่งสนับสนุนการรวม API และการป้อนข้อมูลลงในฐานข้อมูลที่เชื่อถือได้

เปรียบเทียบโมเดล

ดูว่าโมเดลจากผู้ให้บริการต่างๆ เปรียบเทียบกันอย่างไร — เปรียบเทียบประสิทธิภาพ ราคา และจุดแข็งเฉพาะตัวเพื่อตัดสินใจอย่างมีข้อมูล

| โมเดล | บริบท | เอาต์พุตสูงสุด | ข้อมูลนำเข้า | การวางตำแหน่ง |

|---|---|---|---|---|

| GPT OSS 120B | 131.07K | 131.07K | ข้อความ | LLM ด้านการใช้เหตุผลประสิทธิภาพสูง |

| GLM-5 | 202.75K | 202.75K | ข้อความ | โมเดลพื้นฐานเรือธง |

| DeepSeek V3.2 | 163.84K | 163.84K | ข้อความ | เรือธงทั่วไป |

| MiniMax-M2.5 | 204.8K | 196.6K | ข้อความ | การเขียนโค้ดแบบ Agentic ระดับ SOTA |

How to Use OpenAI LLM Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

ทำไมต้องใช้ OpenAI LLM Models บน Atlas Cloud

การรวมโมเดล OpenAI LLM Models ขั้นสูงเข้ากับแพลตฟอร์มที่เร่งด้วย GPU ของ Atlas Cloud ให้ประสิทธิภาพ ความสามารถในการขยาย และประสบการณ์นักพัฒนาที่ไม่มีใครเทียบได้

ประสิทธิภาพและความยืดหยุ่น

เวลาแฝงต่ำ:

inference ที่ปรับแต่ง GPU เพื่อการตอบสนองแบบเรียลไทม์

API แบบรวมศูนย์:

รัน OpenAI LLM Models, GPT, Gemini และ DeepSeek ด้วยการเชื่อมต่อเดียว

ราคาโปร่งใส:

ชำระเงินต่อโทเค็นที่คาดเดาได้พร้อมตัวเลือก serverless

องค์กรและขนาด

ประสบการณ์นักพัฒนา:

SDK, การวิเคราะห์, เครื่องมือปรับแต่ง และเทมเพลต

ความน่าเชื่อถือ:

ความพร้อมใช้งาน 99.99%, RBAC และการบันทึกที่พร้อมสำหรับการปฏิบัติตาม

ความปลอดภัยและการปฏิบัติตาม:

SOC 2 Type II, สอดคล้อง HIPAA, อธิปไตยข้อมูลในสหรัฐอเมริกา

คำถามที่พบบ่อยเกี่ยวกับ OpenAI LLM Models

โมเดลนี้มีความสามารถเกือบเทียบเท่ากับ OpenAI o4-mini ในเกณฑ์มาตรฐานการให้เหตุผลหลักและคณิตศาสตร์ ในขณะที่ o4-mini เป็น API แบบปิด OSS 120B มอบความลึกซึ้งทางตรรกะที่เทียบเคียงได้ พร้อมประโยชน์เพิ่มเติมในการเข้าถึงน้ำหนักโมเดล (model weights) ได้อย่างสมบูรณ์

โมเดลนี้ได้รับการปรับให้เหมาะสมสำหรับ GPU 80 GB ตัวเดียว โดยหลีกเลี่ยงความซับซ้อนของระบบหลายโหนด (multi-node) อย่างไรก็ตาม เพื่อความสามารถในการปรับขยายได้ทันทีและการบำรุงรักษาเป็นศูนย์ เราขอแนะนำให้เข้าถึงผ่าน API บน Atlas Cloud

ใช่ โดยเปิดตัวภายใต้สัญญาอนุญาต Apache 2.0 ซึ่งอนุญาตให้ใช้งานเชิงพาณิชย์ ดัดแปลง และเผยแพร่ได้อย่างไม่จำกัด โดยไม่มีค่าธรรมเนียมใบอนุญาตต่อโทเคน หรือการผูกขาดกับผู้ให้บริการ (vendor lock-in)

หน้าต่างบริบท (Context Window) ขนาด 131.07K ได้รับการออกแบบมาเพื่อความแม่นยำในการค้นคืนข้อมูลแบบ "งมเข็มในมหาสมุทร" สามารถประมวลผลไดเรกทอรีโปรเจกต์ทั้งหมดหรือคู่มือทางเทคนิคที่มีความยาวกว่า 100 หน้าได้ โดยยังคงรักษาความสอดคล้องทางตรรกะตลอดทั้งอินพุต

อย่างยิ่ง เอ็นจิ้นการให้เหตุผลได้รับการปรับแต่งมาอย่างละเอียดสำหรับการสังเคราะห์โค้ดแบบวนซ้ำ สามารถจัดการกับคอมโพเนนต์ React ที่ซ้อนกันและแบ็กเอนด์ Python ที่ซับซ้อนได้อย่างน่าเชื่อถือมากกว่าโมเดลระดับ 70B ทั่วไป ทำให้เหมาะอย่างยิ่งสำหรับเวิร์กโฟลว์การสร้างแอปจากภาษาธรรมชาติ