Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

สำรวจโมเดลชั้นนำ

Atlas Cloud มอบโมเดลสร้างสรรค์ล่าสุดที่นำหน้าในอุตสาหกรรมให้กับคุณ

สิ่งที่ทำให้ Seedream5.0 Models โดดเด่น

Atlas Cloud มอบโมเดลสร้างสรรค์ล้ำสมัยชั้นนำของอุตสาหกรรมให้กับคุณ

การจับเทรนด์แบบเรียลไทม์

มาพร้อมกับความสามารถในการตรวจจับเว็บเพื่อผสานเทรนด์ระดับโลกแบบเรียลไทม์และหัวข้อที่กำลังเป็นกระแสเข้ากับการสร้างสรรค์ ทำลายกำแพงเรื่องความทันสมัยขององค์ความรู้

การใช้เหตุผลทางตรรกะเชิงลึก

ก้าวข้ามการสร้างภาพแบบดั้งเดิมด้วยการคิดเชิงพื้นที่และความสามารถในการใช้เหตุผลหลายขั้นตอน เชี่ยวชาญในการจัดการองค์ประกอบที่ซับซ้อนและกฎของโลกทางกายภาพ

การแก้ไขที่แม่นยำและควบคุมได้

รองรับการแก้ไขที่ละเอียดและการปฏิบัติตามคำสั่งอย่างเคร่งครัด บรรลุการวาดภาพใหม่เฉพาะจุดที่สมบูรณ์แบบในขณะที่ยังคงความสม่ำเสมอของตัวแบบไว้อย่างสมบูรณ์

คุณภาพระดับภาพยนตร์ Ultra-HD

มอบรายละเอียดที่วิจิตรบรรจง พร้อมการจัดแสงและพื้นผิวระดับมืออาชีพ ตอบโจทย์ความต้องการที่เข้มงวดของผลงานเชิงพาณิชย์ที่มีความคมชัดสูง

ข้อความและเลย์เอาต์ระดับมืออาชีพ

มีความสามารถด้านสุนทรียศาสตร์ที่ยอดเยี่ยมในการเรนเดอร์ข้อความและการจัดวางองค์ประกอบ สามารถสร้างสื่อการออกแบบที่ซับซ้อน เช่น โปสเตอร์และแผนภูมิที่มีข้อความหนาแน่นได้

ความเร็วสูงสุด

ต้นทุนต่ำที่สุด

| รูปแบบ | คำอธิบาย |

|---|---|

| Seedream v5.0 T2I Lite API(Text To Image) | API Seedream v5.0 T2I Lite ช่วยให้ครีเอเตอร์สามารถแปลงคำอธิบายข้อความให้เป็นภาพที่มีความเที่ยงตรงสูงได้ทันที ด้วยเอาต์พุต PNG และโหมดปรับแต่งพรอมต์ (prompt) ที่รวดเร็ว ช่วยปรับปรุงกระบวนการออกแบบสำหรับการสร้างต้นแบบอย่างรวดเร็ว (rapid prototyping), การสร้างแนวคิด UI/UX และการทำซ้ำเชิงสร้างสรรค์ความเร็วสูง ซึ่งความเร็วและความชัดเจนเป็นสิ่งสำคัญยิ่ง |

| Seedream v5.0 I2I Lite Edit API(Image To Image) | Seedream v5.0 I2I Lite Edit API มอบเครื่องมือแก่นักพัฒนาเพื่อแปลงรูปภาพที่มีอยู่ผ่านคำสั่งข้อความ (prompt) และรูปภาพอ้างอิง รองรับการถ่ายโอนสไตล์ที่ราบรื่นและการแก้ไขเนื้อหาที่แม่นยำ เหมาะสำหรับการออกแบบซ้ำและการปรับแต่งสินทรัพย์ของแบรนด์ |

| Seedream v5.0 T2I Lite Sequential API(Text To Image) | Seedream v5.0 T2I Lite Sequential API ปฏิวัติการสร้างเนื้อหาจำนวนมากด้วยการสร้างภาพที่เกี่ยวข้องได้สูงสุดถึง 15 ภาพในคำขอเดียว มันถูกปรับให้เหมาะสมสำหรับการผลิตสินทรัพย์ในปริมาณมาก การขยายสตอรี่บอร์ด และการสร้างโลกทัศน์ทางภาพที่ครอบคลุม |

| Seedream v5.0 I2I Lite Edit Sequential API(Image To Image) | Seedream v5.0 I2I Lite Edit Sequential API ช่วยให้ผู้ใช้สามารถใช้การแก้ไขที่สอดคล้องกันกับชุดรูปภาพพร้อมกันได้ ด้วยการประมวลผลภาพที่เกี่ยวข้องสูงสุด 15 ภาพในชุดเดียว จึงมั่นใจได้ถึงความกลมกลืนทางสายตาและความต่อเนื่องของสไตล์ ทำให้เป็นโซลูชันที่เหมาะสำหรับการออกแบบตัวละครที่หลากหลาย การแก้ไขลำดับภาพ และการเล่าเรื่องด้วยภาพที่ซับซ้อน |

ฟีเจอร์ใหม่ของ Seedream5.0 Models + โชว์เคส

การผสมผสานโมเดลขั้นสูงกับแพลตฟอร์มเร่งความเร็ว GPU ของ Atlas Cloud มอบความเร็ว ความสามารถในการปรับขนาด และการควบคุมเชิงสร้างสรรค์ที่ไม่มีใครเทียบได้สำหรับการสร้างภาพและวิดีโอ

ความสามารถในการค้นหาเว็บแบบเรียลไทม์โดยใช้ Seedream 5.0 API

Seedream 5.0 เปิดตัวเวิร์กโฟลว์ "ค้นหาและสร้าง" (search-and-generate) เป็นครั้งแรกในอุตสาหกรรม ซึ่งเชื่อมช่องว่างระหว่างข้อมูลสดและการสังเคราะห์ภาพ ด้วยการจับกระแสข่าวเหตุการณ์ทั่วโลก และข้อมูลแบบเรียลไทม์ ทำให้โมเดลมีฐาน "ความรู้ทั่วไป" ที่กว้างขวาง นี่คือเครื่องมือที่สมบูรณ์แบบสำหรับการสร้างเนื้อหาบรรณาธิการที่ทันเหตุการณ์ การแสดงข้อมูลเป็นภาพ และสินทรัพย์ทางการตลาดที่เกี่ยวข้องกับวัฒนธรรม

การใช้เหตุผลเชิงตรรกะอัจฉริยะและการปฏิบัติตามหลักฟิสิกส์ด้วย Seedream 5.0 API

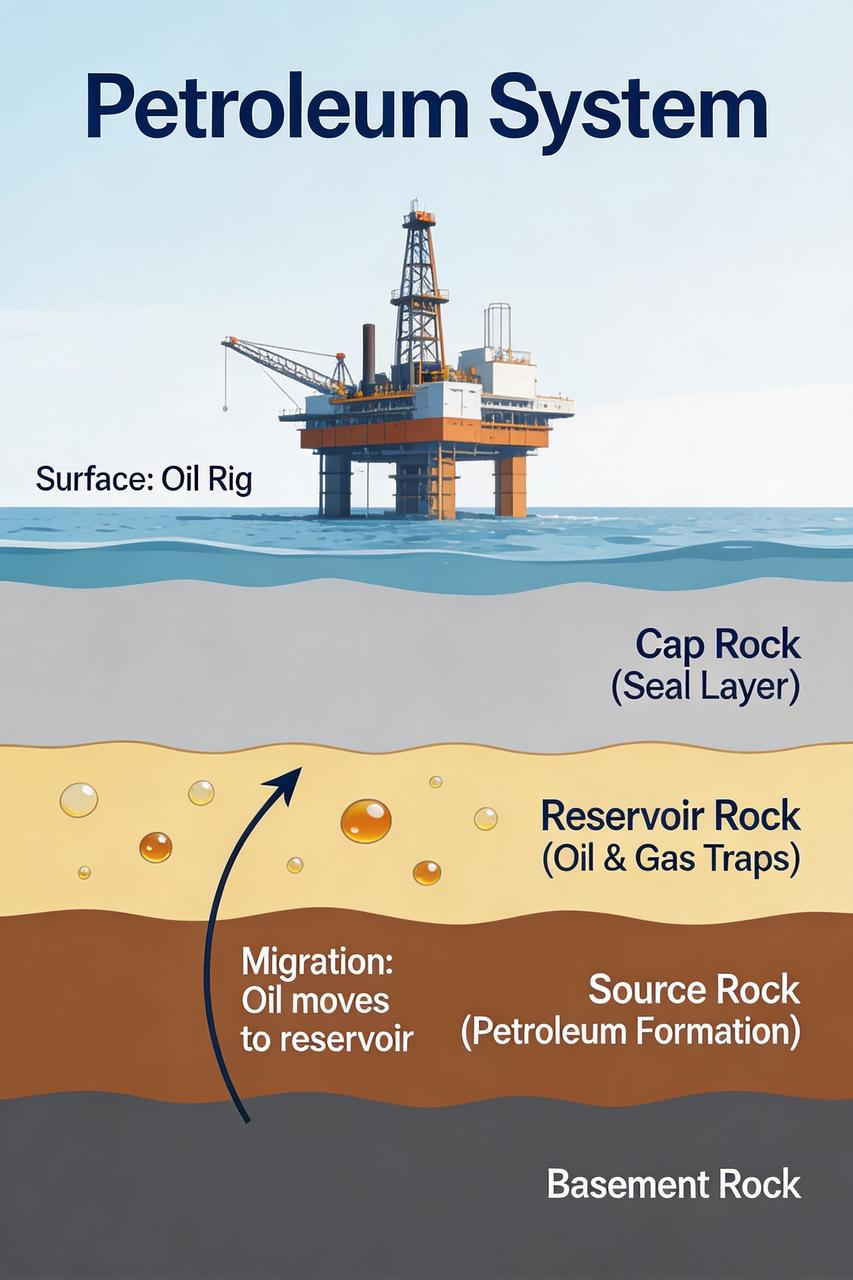

เวอร์ชันนี้ผสานรวมความรู้เชิงลึกในอุตสาหกรรมเฉพาะทาง ตั้งแต่วิทยาศาสตร์ชีวภาพไปจนถึงการออกแบบสถาปัตยกรรม เพื่อรับรองความสมบูรณ์ของโครงสร้างที่เข้มงวด โดยสามารถตีความความสัมพันธ์ทางตรรกะที่ซับซ้อนได้อย่างแม่นยำ พร้อมทั้งปฏิบัติตามกฎฟิสิกส์ในโลกแห่งความเป็นจริงอย่างเคร่งครัด รวมถึงการจัดวางพื้นที่และความสม่ำเสมอของแสง นำเสนอโซลูชันพื้นฐานสำหรับการแสดงภาพทางวิทยาศาสตร์ การสร้างต้นแบบทางอุตสาหกรรม และการเรนเดอร์สภาพแวดล้อมที่สมจริงเหนือจินตนาการ

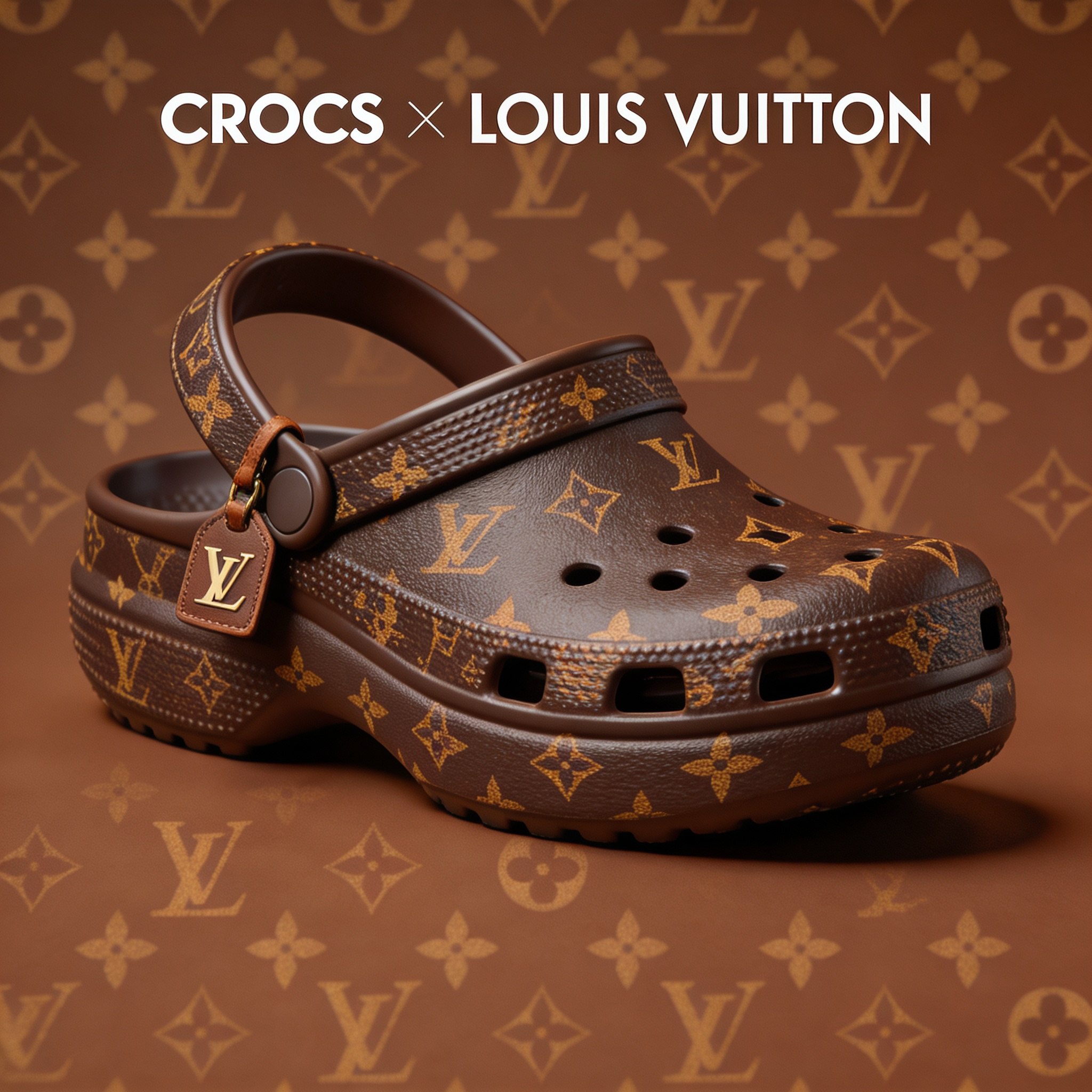

การควบคุมที่แม่นยำและความสามารถในการแก้ไขด้วย Seedream 5.0 API

Seedream 5.0 API โดดเด่นด้วยความสามารถขั้นสูงในการปฏิบัติตามคำสั่งและการอ้างอิงแบบมัลติโมดัล เพื่อการควบคุมผลลัพธ์ทางภาพที่ไม่เคยมีมาก่อน ด้วยการใช้ประโยชน์จากอัลกอริธึมการเรียนรู้ที่ซับซ้อน มันสามารถนำองค์ประกอบทางภาพที่เฉพาะเจาะจงกลับมาใช้ใหม่โดยอัตโนมัติ และรักษาความคงที่ของอัตลักษณ์ในบริบทที่หลากหลาย มันทำหน้าที่เป็นเครื่องยนต์อันทรงพลังสำหรับการสร้างสินทรัพย์ที่สอดคล้องกับแบรนด์ ความสม่ำเสมอของตัวละคร และการปรับแต่งความคิดสร้างสรรค์แบบวนซ้ำ

สิ่งที่คุณทำได้กับ Seedream5.0 Models

ค้นพบกรณีการใช้งานจริงและเวิร์กโฟลว์ที่คุณสามารถสร้างด้วยตระกูลโมเดลนี้ — ตั้งแต่การสร้างเนื้อหาและระบบอัตโนมัติไปจนถึงแอปพลิเคชันระดับโปรดักชัน

การตลาดแบบรับรู้บริบทเชิงพลวัตด้วย Seedream 5.0

Seedream 5.0 API ช่วยให้แบรนด์ต่างๆ สามารถสร้างภาพที่เคลื่อนไหวไปพร้อมกับโลกแห่งความเป็นจริงได้ ด้วยการบูรณาการระบบค้นหาเว็บแบบเรียลไทม์ (Real-Time Web Search) รายแรกของอุตสาหกรรม จึงสามารถจับกระแสความงามและข้อมูลสดเพื่อสร้างภาพที่สอดคล้องกับบริบททางวัฒนธรรม นี่คือโซลูชันที่ดีที่สุดสำหรับแคมเปญโซเชียลที่ตอบสนองต่อข่าวสาร เนื้อหาบรรณาธิการที่ขับเคลื่อนด้วยข้อมูล และโครงการใดๆ ที่ต้องการบริบทระดับโลกที่ทันสมัยที่สุดและการเล่าเรื่องด้วยภาพ

การสร้างต้นแบบทางอุตสาหกรรมและวิทยาศาสตร์ที่มีความแม่นยำสูงด้วย Seedream 5.0

สำหรับโครงการที่ต้องการความสมบูรณ์ของโครงสร้าง Seedream 5.0 มอบภาพที่มีตรรกะแนวตั้งแบบฝังและการปฏิบัติตามหลักฟิสิกส์อย่างเคร่งครัด โมเดลนี้เชี่ยวชาญด้านการจัดวางพื้นที่ที่ซับซ้อน การจัดแสงที่สม่ำเสมอ และความแม่นยำของวัสดุ กรณีการใช้งานนี้เหมาะสำหรับการแสดงภาพสถาปัตยกรรม การออกแบบผลิตภัณฑ์อุตสาหกรรม และภาพประกอบทางวิทยาศาสตร์ ซึ่งความแม่นยำและกฎฟิสิกส์ในโลกแห่งความเป็นจริงมีความสำคัญพอๆ กับคุณภาพความสวยงาม

การเล่าเรื่องแบรนด์ที่เป็นหนึ่งเดียวและความสม่ำเสมอของตัวละครด้วย Seedream 5.0

Seedream 5.0 มอบการควบคุมความคงทนทางสายตาที่เหนือชั้นผ่าน Sequential Generation และความสามารถในการอ้างอิงขั้นสูง ด้วยการเรียนรู้และนำองค์ประกอบภาพที่เฉพาะเจาะจงกลับมาใช้ใหม่ ผู้สร้างสรรค์สามารถรักษาความสม่ำเสมอของอัตลักษณ์ที่สมบูรณ์แบบในหลายเฟรม เหมาะอย่างยิ่งสำหรับการสร้างโลกของตัวละคร ลุคบุ๊กแฟชั่นระดับไฮเอนด์ และชุดสินทรัพย์แบรนด์ที่สอดคล้องกันซึ่งต้องการรูปแบบสไตล์ที่เป็นหนึ่งเดียวในทุกคำขอ

เปรียบเทียบโมเดล

ดูว่าโมเดลจากผู้ให้บริการต่างๆ เปรียบเทียบกันอย่างไร — เปรียบเทียบประสิทธิภาพ ราคา และจุดแข็งเฉพาะตัวเพื่อตัดสินใจอย่างมีข้อมูล

| โมเดล | ขีดจำกัดรูปภาพอ้างอิง | จำนวนเอาต์พุต | ความละเอียด | อัตราส่วนภาพ |

|---|---|---|---|---|

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 4.5 | 10 | 1~15 | 1080P~4K+ | Width[1440, 4096]px; Height[1440, 4096]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Wan 2.6 I2I(Image To Image) | 4 | 1 | 580P~1080P+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 9:21 |

How to Use Seedream5.0 Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

ทำไมต้องใช้ Seedream5.0 Models บน Atlas Cloud

การรวมโมเดล Seedream5.0 Models ขั้นสูงเข้ากับแพลตฟอร์มที่เร่งด้วย GPU ของ Atlas Cloud ให้ประสิทธิภาพ ความสามารถในการขยาย และประสบการณ์นักพัฒนาที่ไม่มีใครเทียบได้

ประสิทธิภาพและความยืดหยุ่น

เวลาแฝงต่ำ:

inference ที่ปรับแต่ง GPU เพื่อการตอบสนองแบบเรียลไทม์

API แบบรวมศูนย์:

รัน Seedream5.0 Models, GPT, Gemini และ DeepSeek ด้วยการเชื่อมต่อเดียว

ราคาโปร่งใส:

ชำระเงินต่อโทเค็นที่คาดเดาได้พร้อมตัวเลือก serverless

องค์กรและขนาด

ประสบการณ์นักพัฒนา:

SDK, การวิเคราะห์, เครื่องมือปรับแต่ง และเทมเพลต

ความน่าเชื่อถือ:

ความพร้อมใช้งาน 99.99%, RBAC และการบันทึกที่พร้อมสำหรับการปฏิบัติตาม

ความปลอดภัยและการปฏิบัติตาม:

SOC 2 Type II, สอดคล้อง HIPAA, อธิปไตยข้อมูลในสหรัฐอเมริกา

คำถามที่พบบ่อยเกี่ยวกับ Seedream5.0 Models

Seedream v5.0 Sequential API ช่วยให้สามารถสร้างรูปภาพที่เกี่ยวข้องกันได้สูงสุด 15 รูปในคำขอเดียว โดยรับประกันความสอดคล้องทางธีมและสไตล์อย่างเคร่งครัดทั่วทั้งชุด

ใช่ โมเดลนี้ได้รับการฝังฐานความรู้ของอุตสาหกรรมเฉพาะทาง ซึ่งช่วยให้สามารถปฏิบัติตามกฎฟิสิกส์ในโลกแห่งความเป็นจริง ตรรกะเชิงพื้นที่ และความสม่ำเสมอของแสงที่จำเป็นสำหรับการออกแบบระดับมืออาชีพ

ด้วยความสามารถในการปฏิบัติตามคำสั่งและการอ้างอิงขั้นสูง Seedream 5.0 สามารถนำองค์ประกอบภาพเฉพาะกลับมาใช้ใหม่ได้โดยอัตโนมัติ และรักษาความคงที่ของอัตลักษณ์ผ่านการสร้างผลงานรุ่นต่างๆ

สำรวจกลุ่มเพิ่มเติม

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.