Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

สำรวจโมเดลชั้นนำ

Atlas Cloud มอบโมเดลสร้างสรรค์ล่าสุดที่นำหน้าในอุตสาหกรรมให้กับคุณ

ความเร็วสูงสุด

ต้นทุนต่ำที่สุด

| โมเดล | ชื่ออย่างเป็นทางการ |

|---|---|

| Nano Banana 2 T2I API(Text to Image) | API แปลงข้อความเป็นรูปภาพของ Nano Banana 2 ช่วยให้นักพัฒนาสามารถเปลี่ยนคำสั่งข้อความ (text prompts) ให้เป็นภาพที่สวยงามระดับภาพยนตร์ด้วยความละเอียด 4K แบบเนทีฟ ด้วยการใช้ตรรกะการควบคุมฉากขั้นสูง ระบบจึงสามารถสร้างรายละเอียดที่วิจิตรบรรจงและองค์ประกอบภาพหลายตัวละครที่ซับซ้อนสำหรับเวิร์กโฟลว์สร้างสรรค์ที่รองรับการทำงานพร้อมกันสูง (high-concurrency) |

| Nano Banana 2 Edit API(Image to Image) | Nano Banana 2 Edit API ช่วยให้นักพัฒนาสามารถเปลี่ยนภาพที่มีอยู่ให้เป็นผลงานชิ้นเอกที่ได้รับการขัดเกลาหรือจินตนาการใหม่ด้วยความสม่ำเสมอที่ราบรื่น ด้วยการใช้ guided diffusion ที่ล้ำสมัย จึงสามารถสร้างการถ่ายโอนรูปแบบและการปรับเปลี่ยนโครงสร้างที่แม่นยำสำหรับการทำซ้ำสินทรัพย์และการออกแบบการตลาดระดับมืออาชีพ |

| Nano Banana 2 T2I Developer API(Text to Image Developer) | API สำหรับนักพัฒนา Text to Image ของ Nano Banana 2 มอบความสามารถในการสร้างภาพระดับภาพยนตร์ 4K แบบเดียวกัน แม้ว่าจะยังคงตรรกะเชิงสร้างสรรค์ไว้อย่างครบถ้วนสำหรับองค์ประกอบที่ซับซ้อนในต้นทุนที่ต่ำกว่า แต่ก็มีความเสถียรน้อยกว่า |

| Nano Banana 2 Edit Developer API(Image to Image Developer) | Nano Banana 2 Edit Developer API นำเสนอการถ่ายโอนสไตล์ที่มีความคมชัดสูงและการปรับเปลี่ยนโครงสร้างในราคาที่ลดลง โดยให้การทำซ้ำสินทรัพย์ระดับมืออาชีพเช่นเดียวกับเวอร์ชันมาตรฐาน แม้ว่าผู้ใช้อาจพบกับความเสถียรของการตอบสนองที่ผันผวนในช่วงที่มีการใช้งานสูงสุด |

ฟีเจอร์ใหม่ของ Nano Banana2 Models + โชว์เคส

การผสมผสานโมเดลขั้นสูงกับแพลตฟอร์มเร่งความเร็ว GPU ของ Atlas Cloud มอบความเร็ว ความสามารถในการปรับขนาด และการควบคุมเชิงสร้างสรรค์ที่ไม่มีใครเทียบได้สำหรับการสร้างภาพและวิดีโอ

ความละเอียด 4K แบบเนทีฟพร้อมรายละเอียดสูงสุดโดยใช้ Nano Banana 2 API

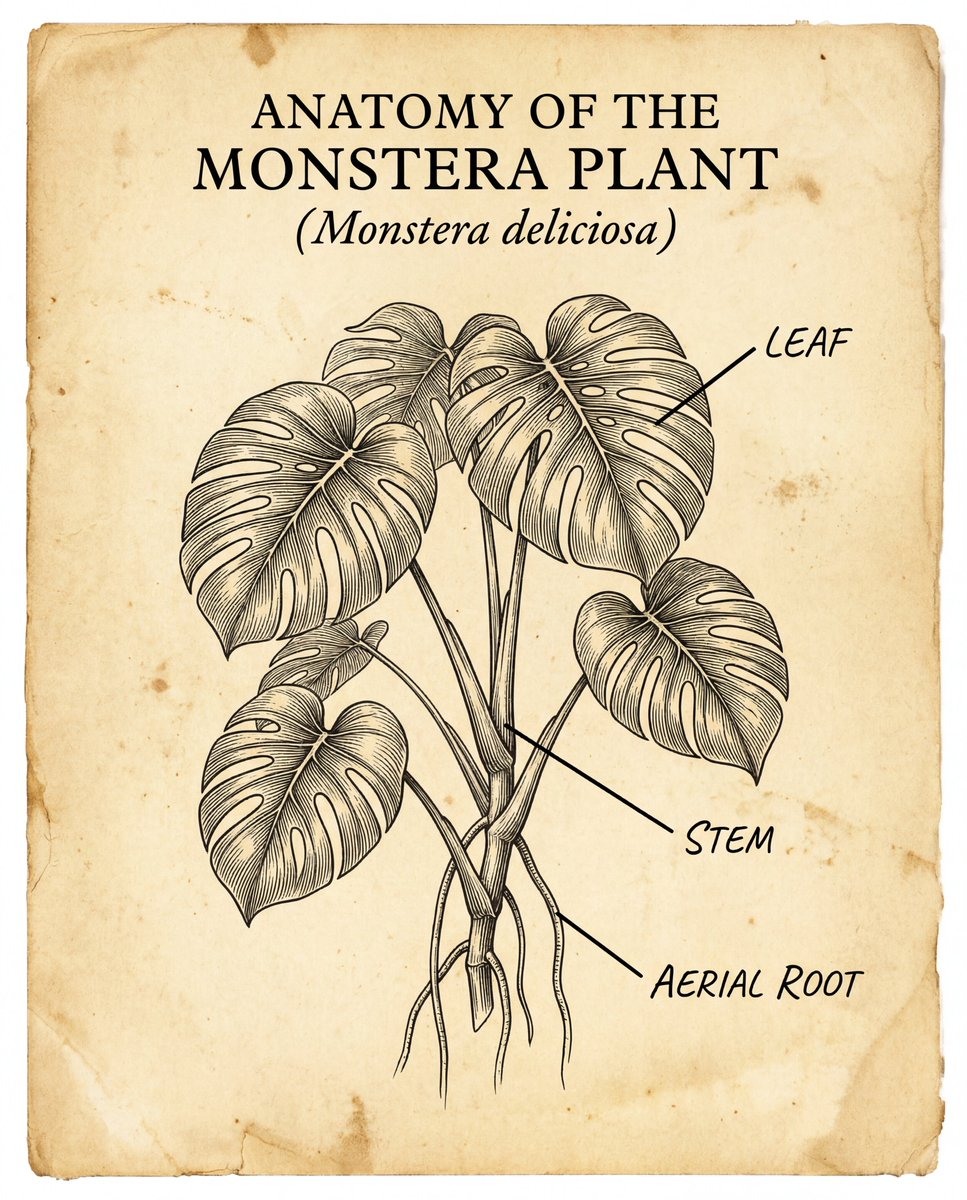

Nano Banana 2 สร้างภาพ 4K แบบเนทีฟโดยเน้นความแม่นยำของโครงสร้าง ด้วยการเก็บรายละเอียดที่ละเอียดอ่อน เช่น การสะท้อนแสงที่สมจริงและกายวิภาคของมนุษย์ที่ซับซ้อน จึงช่วยรับประกันความสม่ำเสมอของภาพทั่วทั้งเฟรม แม้แต่องค์ประกอบที่ท้าทาย เช่น การเรนเดอร์ข้อความที่แม่นยำภายในภาพ ก็ได้รับการจัดการอย่างชัดเจนและคมชัด

ความเร็วในการสร้างที่เร็วปานสายฟ้าด้วย Nano Banana 2 API

Nano Banana 2 ได้รับการออกแบบมาเพื่อประสิทธิภาพ โดยสร้างสมดุลระหว่างผลลัพธ์คุณภาพสูงกับเวลาในการเรนเดอร์ที่ลดลงอย่างมาก ประสิทธิภาพนี้ช่วยให้กระบวนการสร้างสรรค์มีความลื่นไหลมากขึ้น ทำให้มีประสิทธิภาพเป็นพิเศษสำหรับอุตสาหกรรมที่มีปริมาณงานมาก เช่น อีคอมเมิร์ซและการตลาดบนโซเชียลมีเดีย ซึ่งมีรอบการส่งมอบโครงการที่กระชั้นชิด เหมาะอย่างยิ่งสำหรับการโฆษณาอีคอมเมิร์ซและการดำเนินงานด้านโซเชียลมีเดียที่ต้องการการทำซ้ำอย่างรวดเร็ว

การควบคุมตัวละครหลายตัวและฉากที่ซับซ้อนอย่างเหนือชั้นโดยใช้ Nano Banana 2 API

Nano Banana 2 มอบการควบคุมที่เสถียรเหนือปฏิสัมพันธ์ระหว่างตัวแบบหลายตัวและฉากหลังที่ซับซ้อน โดยรักษาความสัมพันธ์เชิงพื้นที่ที่สมเหตุสมผลและความสม่ำเสมอของตัวละครภายในพรอมต์ (prompt) เดียว ช่วยให้ผู้ใช้สามารถสร้างองค์ประกอบภาพที่ซับซ้อนและมีหลายชั้นได้โดยไม่สูญเสียการเล่าเรื่องหลักของภาพ

สิ่งที่คุณทำได้กับ Nano Banana2 Models

ค้นพบกรณีการใช้งานจริงและเวิร์กโฟลว์ที่คุณสามารถสร้างด้วยตระกูลโมเดลนี้ — ตั้งแต่การสร้างเนื้อหาและระบบอัตโนมัติไปจนถึงแอปพลิเคชันระดับโปรดักชัน

ภาพสร้างสรรค์ระดับภาพยนตร์ 4K ด้วย Nano Banana 2 API

Nano Banana 2 API ช่วยให้ครีเอเตอร์สามารถสร้างภาพ 4K แบบเนทีฟที่มีความแม่นยำของแสงและเงาอย่างเหนือชั้น เหมาะอย่างยิ่งสำหรับการโฆษณาแบรนด์ระดับไฮเอนด์และคอนเซ็ปต์อาร์ต API นี้รับประกันความถูกต้องทางโครงสร้างในการเรนเดอร์กายวิภาคที่ซับซ้อนและการผสานรวมข้อความที่คมชัด ด้วยการรักษาพื้นผิวที่มีความเที่ยงตรงสูงทั่วทั้งเฟรม จึงเป็นรากฐานที่แข็งแกร่งสำหรับเวิร์กโฟลว์สร้างสรรค์ระดับมืออาชีพและสินทรัพย์ดิจิทัลขนาดใหญ่

การสร้างสินทรัพย์อีคอมเมิร์ซความเร็วสูงโดยใช้ Nano Banana 2 API

สำหรับวงจรการตลาดที่รวดเร็ว Nano Banana 2 API มอบความเร็วในการสร้างสรรค์ระดับแนวหน้าของอุตสาหกรรมโดยไม่ลดทอนคุณภาพของผลงาน เหมาะอย่างยิ่งสำหรับแคมเปญอีคอมเมิร์ซและการดำเนินงานบนโซเชียลมีเดีย ช่วยให้แบรนด์สามารถทำซ้ำภาพที่เน้นผลิตภัณฑ์ได้ทันที ประสิทธิภาพที่ปรับให้เหมาะสมนี้ช่วยลดรอบการส่งมอบโครงการลงอย่างมาก ทำให้เป็นเครื่องมือสำคัญสำหรับร้านค้าดิจิทัลที่มีปริมาณงานสูงซึ่งต้องการทั้งความเร็วและความเป็นเลิศทางสายตา

การจัดองค์ประกอบตัวละครหลายตัวขั้นสูงด้วย Nano Banana 2 API

Nano Banana 2 มีความโดดเด่นในการจัดการความสัมพันธ์เชิงพื้นที่ที่ซับซ้อนและการเล่าเรื่องที่มีหลายตัวละครภายในพรอมต์ (prompt) เดียว ด้วยการใช้ตรรกะการควบคุมฉากที่เหนือกว่า API จะรักษาความสอดคล้องทางสายตาและความคงที่ของตัวละครในสภาพแวดล้อมที่ซับซ้อน กรณีการใช้งานนี้เหมาะอย่างยิ่งสำหรับภาพประกอบการเล่าเรื่อง การสร้างโลก (world-building) และการออกแบบทางการตลาดที่ซับซ้อน ซึ่งต้องการการประสานงานที่แม่นยำขององค์ประกอบหลายอย่างภายในฉากเดียวที่มีความละเอียดสูง

เปรียบเทียบโมเดล

ดูว่าโมเดลจากผู้ให้บริการต่างๆ เปรียบเทียบกันอย่างไร — เปรียบเทียบประสิทธิภาพ ราคา และจุดแข็งเฉพาะตัวเพื่อตัดสินใจอย่างมีข้อมูล

| โมเดล | ขีดจำกัดรูปภาพอ้างอิง | จำนวนผลลัพธ์ | ความละเอียด | อัตราส่วนภาพ |

|---|---|---|---|---|

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Nano Banana Pro | 10 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Qwen-image | 3 | 1~6 | 512P~2K | Width[512, 2048]px;Height[512, 2048]px |

How to Use Nano Banana2 Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

ทำไมต้องใช้ Nano Banana2 Models บน Atlas Cloud

การรวมโมเดล Nano Banana2 Models ขั้นสูงเข้ากับแพลตฟอร์มที่เร่งด้วย GPU ของ Atlas Cloud ให้ประสิทธิภาพ ความสามารถในการขยาย และประสบการณ์นักพัฒนาที่ไม่มีใครเทียบได้

ประสิทธิภาพและความยืดหยุ่น

เวลาแฝงต่ำ:

inference ที่ปรับแต่ง GPU เพื่อการตอบสนองแบบเรียลไทม์

API แบบรวมศูนย์:

รัน Nano Banana2 Models, GPT, Gemini และ DeepSeek ด้วยการเชื่อมต่อเดียว

ราคาโปร่งใส:

ชำระเงินต่อโทเค็นที่คาดเดาได้พร้อมตัวเลือก serverless

องค์กรและขนาด

ประสบการณ์นักพัฒนา:

SDK, การวิเคราะห์, เครื่องมือปรับแต่ง และเทมเพลต

ความน่าเชื่อถือ:

ความพร้อมใช้งาน 99.99%, RBAC และการบันทึกที่พร้อมสำหรับการปฏิบัติตาม

ความปลอดภัยและการปฏิบัติตาม:

SOC 2 Type II, สอดคล้อง HIPAA, อธิปไตยข้อมูลในสหรัฐอเมริกา

คำถามที่พบบ่อยเกี่ยวกับ Nano Banana2 Models

4K แบบเนทีฟหมายถึงภาพที่สร้างขึ้นโดยตรงที่ความละเอียดสูงแทนที่จะเป็นการอัปสเกล โดยรองรับความละเอียดสูงสุดถึง 4096*2304 นอกจากนี้เรายังมีสเปกชีตระดับ 2K ซึ่งได้รับการปรับปรุงให้เหมาะสมสำหรับการแสดงตัวอย่างความเร็วสูงและการใช้งานบนโซเชียลมีเดีย

Atlas Cloud ให้ขนาดเอาต์พุตและอัตราส่วนภาพที่กำหนดค่าได้ผ่านคอนโซลและ API เพื่อให้คุณสามารถจับคู่กับรูปแบบทั่วไป เช่น 1:1, 16:9, 9:16 และอื่นๆ (ตัวเลือกที่แน่นอนจะขึ้นอยู่กับจุดสิ้นสุดและการตั้งค่าโมเดลที่เลือก)

Edit API ใช้เทคโนโลยี guided diffusion เพื่อการถ่ายโอนสไตล์ที่แม่นยำและการปรับเปลี่ยนโครงสร้าง ช่วยให้นักพัฒนาสามารถทำซ้ำ จินตนาการใหม่ หรือปรับแต่งสินทรัพย์ที่มีอยู่ให้ดียิ่งขึ้นในขณะที่ยังคงความสอดคล้องที่ราบรื่น ทำให้เหมาะอย่างยิ่งสำหรับการทำซ้ำสินทรัพย์ระดับมืออาชีพและการออกแบบการตลาด

เพราะการส่งมอบงานคืองานสำคัญ: API แบบรวมศูนย์สำหรับเวิร์กโฟลว์ text-to-image และ image-to-image / ราคาที่ชัดเจน + การติดตามการใช้งาน / เปลี่ยนโมเดลได้ง่ายขึ้นโดยไม่ต้องสร้างไปป์ไลน์ใหม่

สำรวจกลุ่มเพิ่มเติม

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

Happy Horse 1.0

HappyHorse-1.0 is a mysterious AI video generation model that recently claimed the #1 spot on the Artificial Analysis Video Arena leaderboard. Submitted pseudonymously without a verifiable team identity, this 15B parameter unified Transformer features a 40-layer architecture that jointly denoises text tokens, image latents, video tokens, and audio tokens in a single sequence. The model supports both text-to-video (T2V) and image-to-video (I2V) generation with native multilingual audio synthesis for Chinese, English, Japanese, Korean, German, and French—all produced in one unified forward pass without cross-attention mechanisms.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.

Seedream4.5 Models

Seedream 4.5, developed by ByteDance’s Jimeng AI, is a versatile, high-fidelity model that unifies creative generation with precise image editing. Engineered for professional consistency and intricate text rendering, it excels at multi-subject fusion, brand identity, and high-resolution marketing assets. By bridging spatial logic with artistic control, Seedream 4.5 empowers designers with a seamless, instruction-driven workflow that transforms complex concepts into polished, commercial-grade visuals.

Vidu Models

Vidu, a joint innovation by Shengshu AI and Tsinghua University, is a high-performance video model powered by the original U-ViT architecture that blends Diffusion and Transformer technologies. It delivers long-form, highly consistent, and dynamic video content tailored for professional filmmaking, animation design, and creative advertising. By streamlining high-end visual production, Vidu empowers creators to transform complex ideas into cinematic reality with unprecedented efficiency.