Flux.2 Image Models

Developed by Black Forest Labs, FLUX.2 is a powerhouse 32-billion parameter rectified flow Transformer model that redefines creative workflows by unifying AI image generation, editing, and composition. It transforms complex text prompts into high-fidelity visuals while offering integrated tools for professional-grade editing at resolutions up to 2K, providing a streamlined, all-in-one solution for digital artists and designers seeking unmatched precision and scalability in their visual content creation.

สำรวจโมเดลชั้นนำ

Atlas Cloud มอบโมเดลสร้างสรรค์ล่าสุดที่นำหน้าในอุตสาหกรรมให้กับคุณ

สิ่งที่ทำให้ Flux.2 Image Models โดดเด่น

Atlas Cloud มอบโมเดลสร้างสรรค์ล้ำสมัยชั้นนำของอุตสาหกรรมให้กับคุณ

Photorealistic Quality

Generates crisp, high-resolution images with accurate lighting, textures, and detail for production use.

Fast, Lightweight Inference

Optimized architecture delivers rapid image generation on modest GPUs and edge hardware.

Fine-Grained Control

Supports styles, presets, and prompt controls so designers can quickly dial in the exact look they want.

Seamless Workflow Integration

Simple APIs and plugins connect Nano Banana to design tools, apps, and pipelines with minimal setup.

Cost-Efficient Creativity

Efficient diffusion kernels and smart caching keep generation costs low, so teams can experiment freely at scale.

Flexible Deployment Options

Flexible Deployment Options Run in the cloud, on-prem, or in VPC environments.

ความเร็วสูงสุด

ต้นทุนต่ำที่สุด

| รูปแบบ | คำอธิบาย |

|---|---|

| Flux.2 Dev API(Text To Image, Image To Image) | Flux.2 Dev API ให้สิทธิ์การเข้าถึงโมเดล open-weights ขนาด 3.2 หมื่นล้านพารามิเตอร์ที่ทรงพลังที่สุดในโลก ซึ่งออกแบบมาเพื่อการสร้างภาพจากข้อความที่ซับซ้อนและการแก้ไขภาพแบบหลายอินพุต ด้วยการใช้ checkpoint แบบรวมศูนย์สำหรับการสร้างและการแก้ไข ช่วยเพิ่มประสิทธิภาพขั้นตอนการทำงานสร้างสรรค์ระดับมืออาชีพและมอบรากฐานที่ไม่มีใครเทียบได้สำหรับการสร้างแอปพลิเคชัน AI ด้านภาพขั้นสูงที่ปรับแต่งได้ภายใต้ใบอนุญาตเชิงพาณิชย์ |

| Flux.2 Pro API(Text To Image, Image To Image) | API Flux.2 Pro มอบคุณภาพของภาพระดับชั้นนำของอุตสาหกรรมและการปฏิบัติตามคำสั่ง (prompt adherence) ที่ทัดเทียมกับโมเดลแบบปิด (closed-source) ระดับแนวหน้า ในขณะที่ลดความหน่วงและต้นทุนการดำเนินงานลงอย่างมาก โดยนำเสนอโซลูชันประสิทธิภาพสูงสำหรับแอปพลิเคชันระดับองค์กรที่ต้องการความสมจริงของภาพระดับพรีเมียมโดยไม่ต้องจ่ายในราคาที่สูงลิ่ว |

| Flux.2 Flex API(Text To Image, Image To Image) | Flux.2 Flex API ช่วยให้นักพัฒนามีความสามารถในการควบคุมพารามิเตอร์การสร้างอย่างละเอียด ซึ่งรวมถึงระดับการชี้นำ (guidance scales) และขั้นตอนการอนุมาน (inference steps) เพื่อปรับสมดุลระหว่างความเร็วและความเที่ยงตรงต่อคำสั่ง (prompt fidelity) ได้อย่างสมบูรณ์แบบ ได้รับการปรับให้เหมาะสมเป็นพิเศษสำหรับรายละเอียดที่ซับซ้อนและการเรนเดอร์ตัวอักษรที่แม่นยำ โดยทำหน้าที่เป็นชุดเครื่องมืออเนกประสงค์สำหรับครีเอเตอร์ที่ต้องการการควบคุมที่มีความแม่นยำสูงเหนือองค์ประกอบภาพและข้อความที่ซับซ้อน |

| Flux.2 Klein API(Text To Image, Image To Image) | Flux.2 Klein API นำเสนอโซลูชันที่มีน้ำหนักเบาแต่แข็งแกร่งผ่านเทคนิคการกลั่นขนาด (size-distillation) ขั้นสูง โดยเผยแพร่ภายใต้ใบอนุญาต Apache 2.0 ที่เป็นมิตรกับนักพัฒนา โมเดลนี้มีประสิทธิภาพเหนือกว่าโมเดลขนาดใกล้เคียงกันที่ฝึกฝนจากศูนย์ (trained from scratch) โดยมอบเส้นทางที่มีประสิทธิภาพและเข้าถึงได้สำหรับการสร้างภาพคุณภาพสูงในสภาพแวดล้อมที่มีทรัพยากรจำกัด |

ฟีเจอร์ใหม่ของ Flux.2 Image Models + โชว์เคส

การผสมผสานโมเดลขั้นสูงกับแพลตฟอร์มเร่งความเร็ว GPU ของ Atlas Cloud มอบความเร็ว ความสามารถในการปรับขนาด และการควบคุมเชิงสร้างสรรค์ที่ไม่มีใครเทียบได้สำหรับการสร้างภาพและวิดีโอ

ความเที่ยงตรง của พื้นผิวที่ดียิ่งขึ้นและการจัดแสงที่สมจริงโดยใช้ FLUX.2 API

โมเดล FLUX.2 ใช้ประโยชน์จากสถาปัตยกรรม 3.2 หมื่นล้านพารามิเตอร์เพื่อมอบพื้นผิวที่คมชัดยิ่งขึ้นและการจัดแสงที่เสถียรในผลลัพธ์ภาพทั้งหมด ด้วยการปรับการปฏิสัมพันธ์ระหว่างแสงและวัตถุใน Latent Space ให้เหมาะสม ผู้ใช้สามารถสร้างผลลัพธ์ที่สมจริงเหมือนภาพถ่ายสำหรับการแสดงภาพผลิตภัณฑ์ระดับไฮเอนด์และการถ่ายภาพระดับมืออาชีพ นี่คือโซลูชันที่ดีที่สุดสำหรับการเรนเดอร์ที่สมจริงเหนือระดับ ความสม่ำเสมอของวัสดุ และสินทรัพย์ดิจิทัลเกรดสตูดิโอ

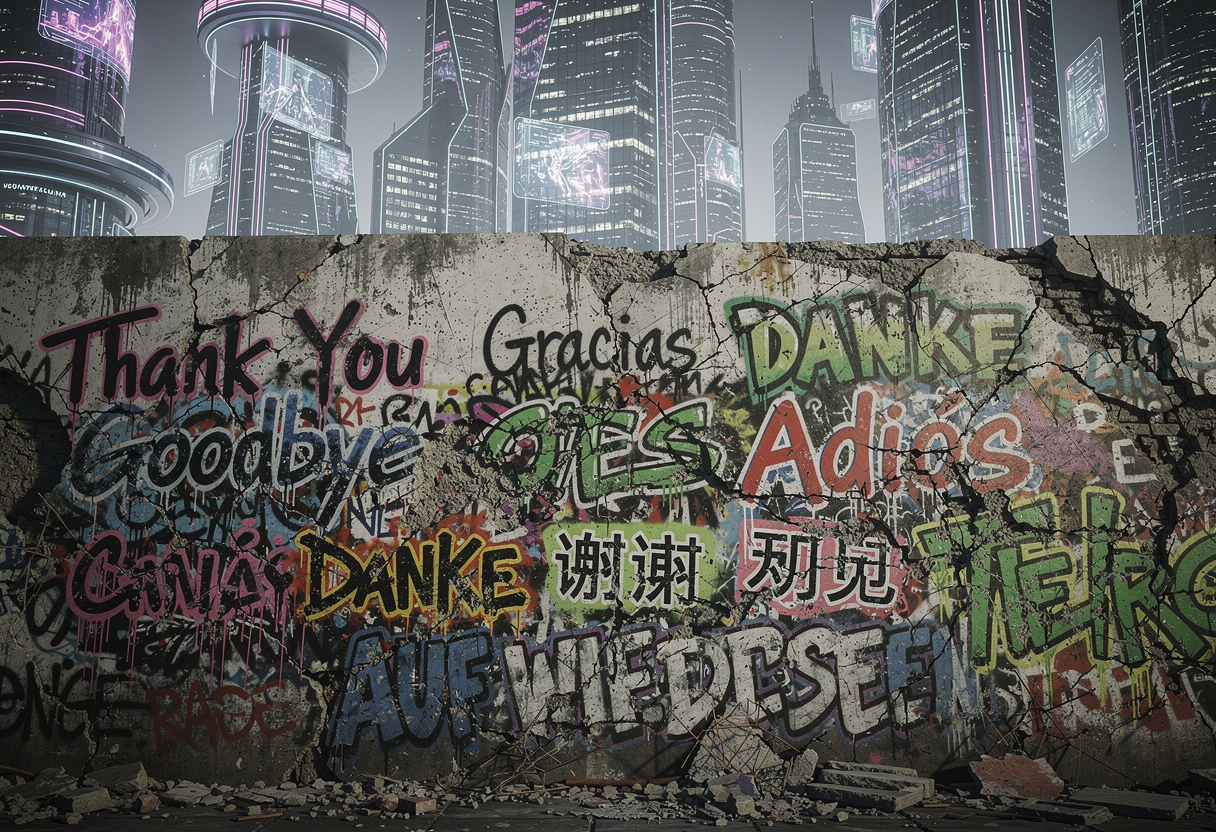

การจัดตัวอักษรขั้นสูงและการเรนเดอร์กราฟิกโดยใช้ FLUX.2 API

FLUX.2 รองรับการจัดวางตัวอักษรที่ซับซ้อนและการจำลอง UI ที่ละเอียดประณีต เพื่อให้มั่นใจว่าแม้แต่ข้อความขนาดเล็กมากยังคงอ่านง่ายและคมชัด ด้วยการรวมการเข้ารหัสระดับตัวอักษรที่ซับซ้อน ผู้ใช้จึงสามารถเรนเดอร์อินโฟกราฟิก มีม และเนื้อหาของแบรนด์ได้อย่างแม่นยำโดยไม่มีการบิดเบือนของตัวอักษร เป็นโซลูชันที่ดีที่สุดสำหรับการออกแบบกราฟิกมืออาชีพ การสร้างต้นแบบอินเทอร์เฟซ และองค์ประกอบสร้างสรรค์ที่มีข้อความจำนวนมาก

ความเข้าใจพรอมต์แบบมีโครงสร้างและการควบคุมองค์ประกอบโดยใช้ FLUX.2 API

เครื่องมือ FLUX.2 มอบตรรกะที่เหนือชั้นในการตีความพรอมต์ (prompt) ที่มีความยาวหลายย่อหน้าและข้อจำกัดทางพื้นที่ที่ซับซ้อนด้วยความแม่นยำสูง ด้วยการถอดรหัสคำสั่งเชิงสัมพันธ์ที่ละเอียดอ่อน ผู้ใช้สามารถจัดองค์ประกอบฉากที่มีวัตถุหลายอย่างได้อย่างถูกต้องและรักษาเจตนาในการจัดองค์ประกอบภาพอย่างเคร่งครัด นี่คือโซลูชันที่ดีที่สุดสำหรับการเล่าเรื่องที่ซับซ้อน ศิลปะดิจิทัลแบบมีเลเยอร์ และการเล่าเรื่องด้วยภาพที่เน้นความแม่นยำ

การยกระดับตรรกะของโลกและการรับรู้เชิงพื้นที่โดยใช้ FLUX.2 API

FLUX.2 รวบรวมความรู้เกี่ยวกับโลกไว้อย่างมหาศาลเพื่อทำความเข้าใจความสัมพันธ์ทางกายภาพระหว่างแสง พื้นที่ และพฤติกรรมของวัตถุอย่างลึกซึ้ง การวางรากฐานการสร้างสรรค์ทุกครั้งบนตรรกะของสภาพแวดล้อมที่สมจริง ช่วยให้ผู้ใช้มั่นใจได้ว่าฉากที่ซับซ้อนจะแสดงผลได้ตรงตามที่คาดหวังในโลกความเป็นจริง นี่คือโซลูชันที่ดีที่สุดสำหรับการแสดงภาพสถาปัตยกรรม การสร้างโลกที่สมจริง และการสังเคราะห์ฉากที่มีความสอดคล้องทางตรรกะ

สิ่งที่คุณทำได้กับ Flux.2 Image Models

ค้นพบกรณีการใช้งานจริงและเวิร์กโฟลว์ที่คุณสามารถสร้างด้วยตระกูลโมเดลนี้ — ตั้งแต่การสร้างเนื้อหาและระบบอัตโนมัติไปจนถึงแอปพลิเคชันระดับโปรดักชัน

การเรนเดอร์ความเที่ยงตรงสูงที่สมจริงเหมือนภาพถ่ายด้วย FLUX.2 API

โมเดล FLUX.2 ช่วยให้ครีเอเตอร์และนักพัฒนาสามารถสร้างเนื้อหาภาพที่สมจริงเป็นพิเศษ ซึ่งยังคงไว้ซึ่งพื้นผิวที่เหมือนจริง แสงที่เสถียร และความแม่นยำทางกายภาพ สถาปัตยกรรมพารามิเตอร์ 32B นี้เหมาะอย่างยิ่งสำหรับการถ่ายภาพสินค้าแบบมืออาชีพและการจำลองภาพสถาปัตยกรรม โดยรับประกันการสะท้อนของพื้นผิวและความลึกของวัสดุที่สม่ำเสมอ รองรับสินทรัพย์ทางการตลาดระดับไฮเอนด์ แบบจำลองแบรนด์หรู และการถ่ายภาพดิจิทัลระดับสตูดิโอ

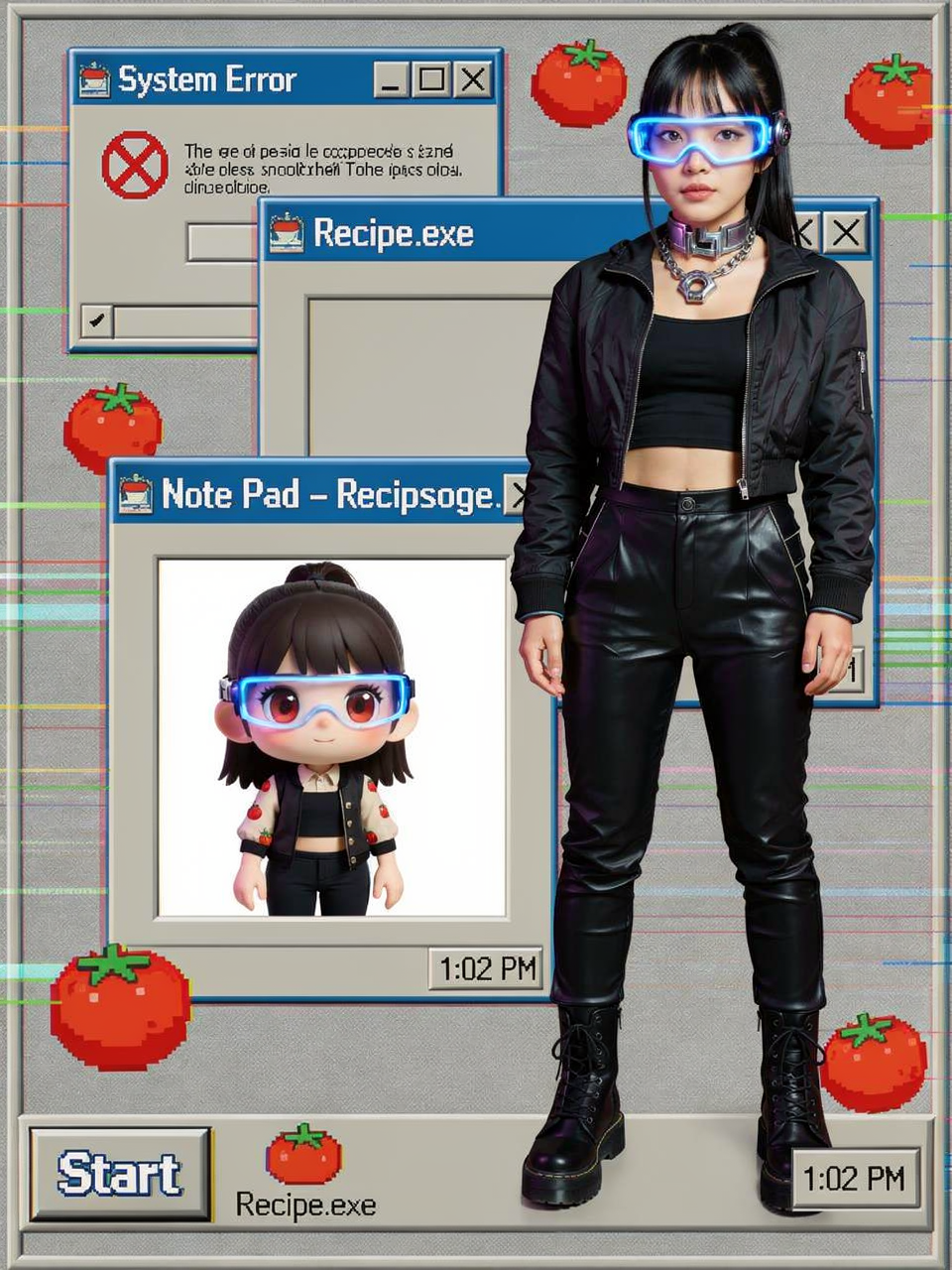

การออกแบบตัวอักษรและการจัดวางที่แม่นยำด้วย FLUX.2 API

For information-dense graphics, FLUX.2 renders complex typography, UI simulations, and intricate layouts with absolute clarity and zero character distortion. This use case fits graphic designers, branding experts, and social media creators requiring precise text integration in posters, infographics, and interface prototypes—ensuring even micro-fonts remain legible and perfectly aligned, powered by advanced Transformer-based semantic understanding.

การจัดองค์ประกอบฉากอย่างสมเหตุสมผลและการแก้ไขความละเอียดสูง 4MP

FLUX.2 นำเสนอการตีความคำสั่ง (prompt) ที่มีโครงสร้างและหลายส่วนได้อย่างเหนือชั้น ช่วยให้สามารถสร้างฉากที่มีหลายตัวแบบและมีความซับซ้อนรวมถึงการจัดวางพื้นที่ที่ละเอียดอ่อน ด้วยการรองรับการแก้ไขความละเอียดสูงถึง 4 ล้านพิกเซล API นี้ช่วยอำนวยความสะดวกในการแปลงรูปภาพเป็นรูปภาพได้อย่างราบรื่นและการปรับแต่งเฉพาะจุดอย่างแม่นยำ มอบโซลูชันครบวงจรที่มีประสิทธิภาพสำหรับศิลปินดิจิทัลมืออาชีพและผู้มีวิสัยทัศน์ที่ต้องการความสอดคล้องทางตรรกะในโครงการสร้างสรรค์ขนาดใหญ่

เปรียบเทียบโมเดล

ดูว่าโมเดลจากผู้ให้บริการต่างๆ เปรียบเทียบกันอย่างไร — เปรียบเทียบประสิทธิภาพ ราคา และจุดแข็งเฉพาะตัวเพื่อตัดสินใจอย่างมีข้อมูล

| โมเดล | ขีดจำกัดรูปภาพอ้างอิง | จำนวนเอาต์พุต | ความละเอียด | โมเดล |

|---|---|---|---|---|

| Flux.2 | 10 | 1 | 2K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Flux.1 | 1 | 1 | 256P~4K | Width[256, 4096]px; Height[256, 4096]px |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

How to Use Flux.2 Image Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

ทำไมต้องใช้ Flux.2 Image Models บน Atlas Cloud

การรวมโมเดล Flux.2 Image Models ขั้นสูงเข้ากับแพลตฟอร์มที่เร่งด้วย GPU ของ Atlas Cloud ให้ประสิทธิภาพ ความสามารถในการขยาย และประสบการณ์นักพัฒนาที่ไม่มีใครเทียบได้

ประสิทธิภาพและความยืดหยุ่น

เวลาแฝงต่ำ:

inference ที่ปรับแต่ง GPU เพื่อการตอบสนองแบบเรียลไทม์

API แบบรวมศูนย์:

รัน Flux.2 Image Models, GPT, Gemini และ DeepSeek ด้วยการเชื่อมต่อเดียว

ราคาโปร่งใส:

ชำระเงินต่อโทเค็นที่คาดเดาได้พร้อมตัวเลือก serverless

องค์กรและขนาด

ประสบการณ์นักพัฒนา:

SDK, การวิเคราะห์, เครื่องมือปรับแต่ง และเทมเพลต

ความน่าเชื่อถือ:

ความพร้อมใช้งาน 99.99%, RBAC และการบันทึกที่พร้อมสำหรับการปฏิบัติตาม

ความปลอดภัยและการปฏิบัติตาม:

SOC 2 Type II, สอดคล้อง HIPAA, อธิปไตยข้อมูลในสหรัฐอเมริกา

คำถามที่พบบ่อยเกี่ยวกับ Flux.2 Image Models

โดยรวมการสร้างภาพ การแก้ไขเฉพาะจุด และการจัดองค์ประกอบภาพหลายภาพไว้ด้วยกัน FLUX.2 เร็วกว่ารุ่นก่อนหน้า 30%-50% และรองรับเอาต์พุตความละเอียดสูง 4MP โดยกำเนิด ทำให้ได้ความสมจริงระดับภาพถ่ายที่เป็นเลิศทั้งในด้านตรรกะทางฟิสิกส์ แสง และพื้นผิว

FLUX.2 เรนเดอร์ข้อความที่คมชัดและแม่นยำแม้ในฉากที่ซับซ้อน รองรับย่อหน้ายาวและตัวอักษรขนาดเล็กมาก (micro-fonts) ด้วยการผสานรวมโมเดลภาษาและการมองเห็น Mistral-3 24B จึงทำให้มีความโดดเด่นในการสร้างอินโฟกราฟิก, UI Mockup และสินทรัพย์แบรนด์ที่เน้นข้อความ

FLUX.2 ได้รับการพัฒนาโดย Black Forest Labs (BFL) ซึ่งก่อตั้งโดยผู้สร้างดั้งเดิมของ Stable Diffusion (SDXL) ทีมงานนี้เป็นผู้บุกเบิกเทคโนโลยี Latent Diffusion และในขณะนี้กำลังนิยามความฉลาดทางภาพใหม่ผ่านสถาปัตยกรรม Rectified Flow ขนาด 32B พารามิเตอร์

สำรวจกลุ่มเพิ่มเติม

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.