H1: Startschuss für die DeepSeek-V4-Preview: 1 Mio. Token Kontext, Agenten-Upgrades & Open-Source-Weights

Heute (24. April) veröffentlicht DeepSeek offiziell die Preview-Version seiner brandneuen Modellreihe DeepSeek-V4 und stellt diese als Open Source zur Verfügung.

DeepSeek-V4 unterstützt bis zu eine Million Token Kontext und erreicht eine führende Performance bei Agentenfähigkeiten, Weltwissen und Schlussfolgerungen (Reasoning) unter den heimischen und Open-Source-Modellen. Die Serie ist in zwei Größen erhältlich:

- DeepSeek-V4-Pro — das Flaggschiff-Modell: ein massives MoE-Modell (Mixture of Experts) mit 1,6 Billionen Parametern insgesamt, von denen jedoch nur 49 Mrd. pro Forward Pass aktiviert werden – dies ist der Schlüssel zu seiner Effizienz.

- DeepSeek-V4-Flash — die schnellere und kosteneffizientere Option. Sie folgt demselben MoE-Design in deutlich kleinerem Maßstab (284 Mrd. Parameter gesamt / 13 Mrd. aktiv), was eine schnellere und günstigere Inferenz ermöglicht.

- Beide Modelle teilen sich das 1 Mio. Token Kontextfenster und sind vollständig Open Source mit API-Zugriff.

| Modell | Parameter | Aktivierung | Pre-training Daten | Kontextlänge | Open Source | API-Service | Web/App Zugriffsmodus |

| deepseek-v4-pro | 1,6T | 49B | 33T | 1M | ✓ | ✓ | Expertenmodus |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | Fast-Modus |

Ab heute können Sie DeepSeek-V4 unter chat.deepseek.com oder über die offizielle App nutzen. Die API ist ebenfalls live – setzen Sie einfach

1model_name1deepseek-v4-pro1deepseek-v4-flashWir haben bereits über die Spekulationen und Vorab-Analysen berichtet (siehe unseren DeepSeek V4 Erwartungs-Guide und unsere technische Analyse), nun liegen uns bestätigte, offizielle Details direkt aus der Quelle vor. Im Folgenden erfahren Sie genau, was veröffentlicht wurde, was neu ist und was dies für Sie bedeutet, wenn Sie heute mit KI-Modellen entwickeln oder diese evaluieren.

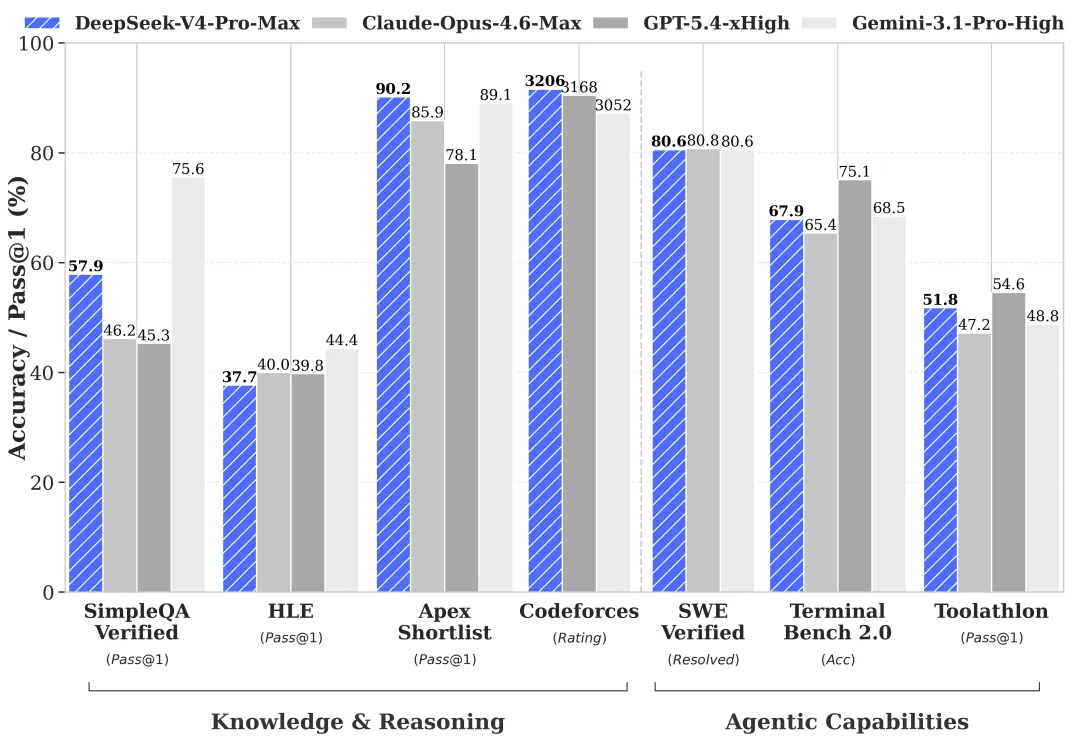

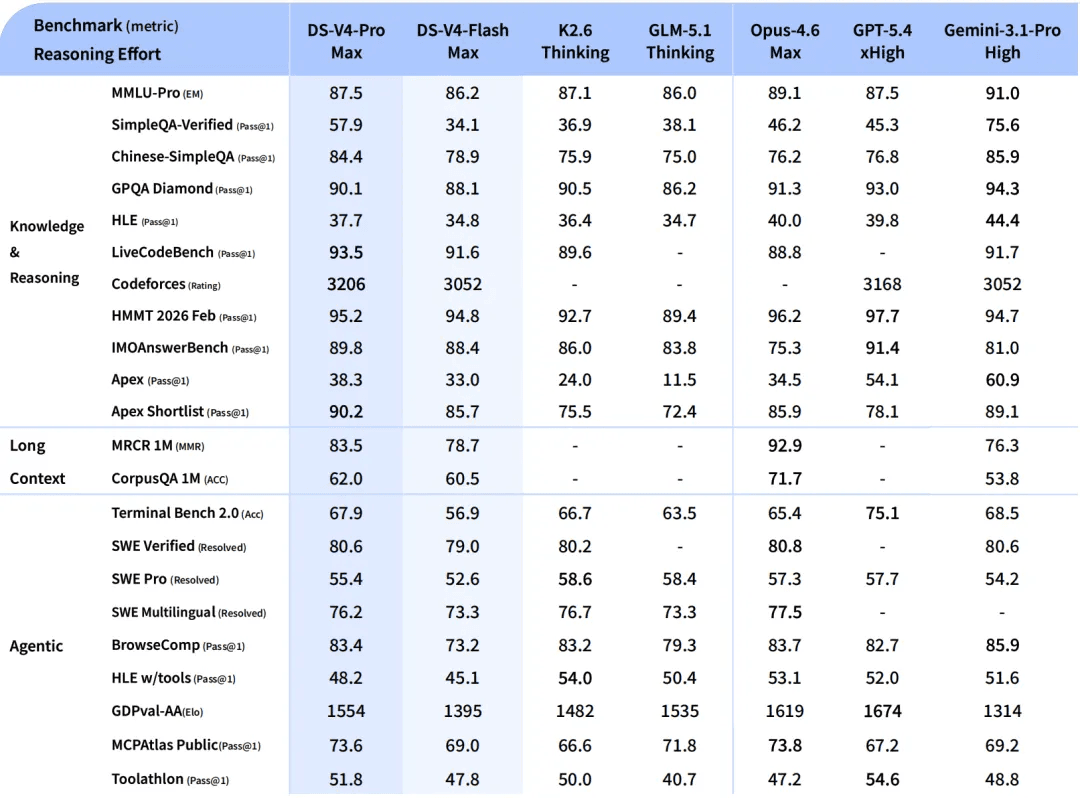

DeepSeek-V4-Pro: Konkurrenz für Top-Modelle mit geschlossenem Quellcode

Deutlich verbesserte Agentenfähigkeiten. Im Vergleich zum Vorgänger zeigt DeepSeek-V4-Pro eine drastische Verbesserung bei Agentenaufgaben. Bei Agentic-Coding-Benchmarks führt V4-Pro nun unter allen Open-Source-Modellen. DeepSeek setzt V4-Pro intern bereits als bevorzugten Coding-Agenten des Unternehmens ein – Mitarbeiter-Feedback zeigt, dass die Erfahrung die von Claude Sonnet 4.5 übertrifft und die Ausgabequalität im Non-Thinking-Modus an Claude Opus 4.6 heranreicht, wenngleich es im Thinking-Modus noch leicht hinter Opus 4.6 zurückbleibt.

Umfassendes Weltwissen. DeepSeek-V4-Pro übertrifft andere Open-Source-Modelle bei Benchmarks zum Weltwissen deutlich und liegt nur geringfügig hinter dem führenden Closed-Source-Modell Gemini Pro 3.1.

Erstklassige Reasoning-Fähigkeiten. Bei Evaluierungen in Mathematik, MINT und Competitive Programming übertrifft DeepSeek-V4-Pro jedes bisher gebenchmarkte Open-Source-Modell und erreicht die Performance der weltweit führenden Closed-Source-Modelle.

DeepSeek-V4-Flash: Die schnelle und erschwingliche Wahl

Im Vergleich zu V4-Pro fällt DeepSeek-V4-Flash beim Weltwissen leicht ab, liefert aber eine vergleichbare Reasoning-Performance. Dank der geringeren Parameterzahl und niedrigerer Aktivierungskosten bietet V4-Flash schnellere Antwortzeiten und eine wirtschaftlichere API-Preisgestaltung.

Bei Agenten-Benchmarks erreicht V4-Flash bei einfacheren Aufgaben das Niveau von V4-Pro, auch wenn bei komplexeren Aufgaben noch ein Abstand besteht.

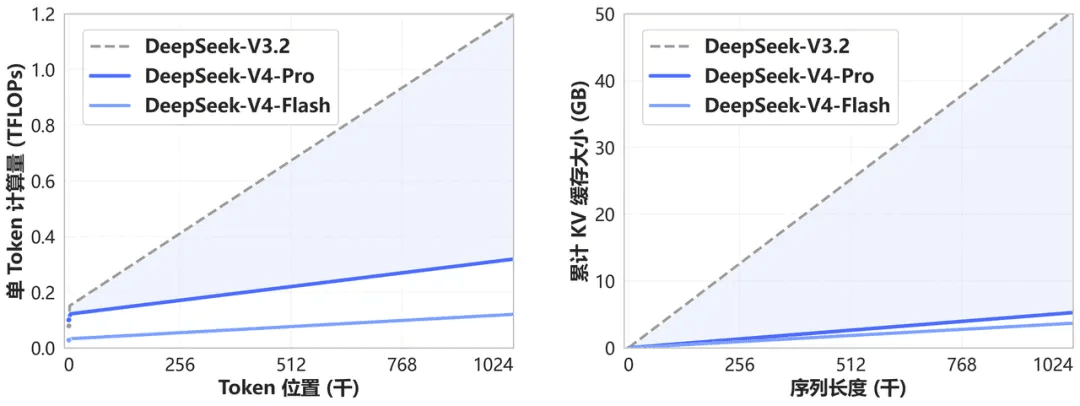

Architektonische Innovation und extreme Kontexteffizienz

DeepSeek-V4 führt einen neuartigen Attention-Mechanismus ein, der eine Kompression entlang der Token-Dimension durchführt. In Kombination mit DSA (DeepSeek Sparse Attention) erreicht dieses Design eine weltweit führende Langkontext-Performance bei gleichzeitig drastischer Reduzierung der Rechen- und Speicheranforderungen im Vergleich zu herkömmlichen Ansätzen.

Zukünftig ist 1M (eine Million) Token Kontext der Standard für alle offiziellen DeepSeek-Dienste.

Spezielle Optimierung für Agenten-Use-Cases

DeepSeek-V4 wurde für populäre Agenten-Produkte, darunter Claude Code, OpenClaw, OpenCode und CodeBuddy, feinabgestimmt und optimiert. Leistungsverbesserungen konnten bei der Code-Generierung, Dokumentenerstellung und anderen agentengesteuerten Aufgaben beobachtet werden.

Diese Art der Framework-spezifischen Optimierung ist in der Praxis wichtiger, als es zunächst klingen mag. Ein Modell, das isoliert gut funktioniert, sich aber in einer strukturierten Agenten-Schleife inkonsistent verhält, lässt sich nur schwer zuverlässig einsetzen. Die Entscheidung, große Agenten-Frameworks als Ziel erster Klasse für Optimierungen zu betrachten, spiegelt wider, wie sich die produktive KI-Nutzung entwickelt hat.

DeepSeek-V4 API-Zugriff

Sowohl V4-Pro als auch V4-Flash sind jetzt über die DeepSeek-API verfügbar, mit Unterstützung für die Interfaces OpenAI ChatCompletions und Anthropic. Das bedeutet, dass bestehende Integrationen mit minimalen Code-Anpassungen auf V4-Modelle umgestellt werden können. Die

1base_url1model1deepseek-v4-pro1deepseek-v4-flashBeide Modelle unterstützen eine maximale Kontextlänge von 1M Token und bieten sowohl einen Non-Thinking- als auch einen Thinking-Modus. Im Thinking-Modus kann der Parameter

1reasoning_effort1high1max1max⚠️ Deprecation-Hinweis: Die alten Modellnamen

undtext1deepseek-chatwerden in drei Monaten (24. Juli 2026) eingestellt. Während der Übergangsphase werden sie auf den Non-Thinking- bzw. Thinking-Modus vontext1deepseek-reasonergemappt. Wenn Sie einen dieser Namen in der Produktion verwenden, planen Sie Ihre Migration jetzt.text1deepseek-v4-flash

Open-Source Weights & Lokales Deployment

- Modell-Weights:Hugging Face | ModelScope

- Technischer Report:DeepSeek-V4 PDF

Für Teams, die ein lokales oder On-Premise-Deployment in Betracht ziehen, ist zu beachten, dass Modelle in dieser Größenordnung – insbesondere V4-Pro mit 1,6T Parametern – hohe Hardwareanforderungen stellen. Die Open-Source-Verfügbarkeit ist ein bedeutender Vorteil für Enterprise-Compliance und Anpassungszwecke, aber die meisten Teams werden den Cloud-API-Zugriff als praktischeren Einstiegspunkt empfinden.

Was bedeutet dieser DeepSeek-V4-Start eigentlich?

Drei Aspekte stechen bei dieser Veröffentlichung besonders hervor.

Erstens ist das Bekenntnis zu 1M Kontext bedeutsamer, als es den Anschein hat. DeepSeek bietet dies nicht als Premium-Stufe an – es ist der Standard für alle offiziellen Dienste. Das ist ein Signal dafür, wohin sich die Open-Source-Grenze bewegt, und setzt alle anderen Anbieter unter Zugzwang.

Zweitens spiegelt die Agent-First-Optimierungsarbeit – insbesondere die Anpassung von V4 für Claude Code, OpenCode und andere – eine Reife in der Herangehensweise von DeepSeek an das Deployment wider. Benchmark-Performance ist die Grundvoraussetzung; was für die Produktion zählt, ist das Verhalten innerhalb der Werkzeuge, die Entwickler tatsächlich nutzen.

Drittens ist die ehrlich kommunizierte Wettbewerbspositionierung gegenüber Claude Opus 4.6 bemerkenswert. Anstatt eine pauschale Überlegenheit zu behaupten, gibt DeepSeek eine differenzierte Einschätzung: besser als Sonnet 4.5, Annäherung an Opus 4.6 im Non-Thinking-Modus, hinter Opus 4.6 im Thinking-Modus. Diese Spezifität macht die Aussagen glaubwürdiger.

Für Entwickler, die Modelle für Agenten-Workflows, die Verarbeitung langer Dokumente oder komplexe Reasoning-Aufgaben evaluieren, ist DeepSeek-V4-Pro nun ein ernsthafter Open-Source-Anwärter. Für kostenoptimierte oder latenzempfindliche Pipelines bietet V4-Flash eine glaubwürdige, leichtere Alternative.

Probieren Sie DeepSeek-V4 auf Atlas Cloud

Atlas Cloud ist eine produktionsreife KI-Plattform für Entwickler und Teams, die zuverlässigen, kosteneffizienten Zugriff auf die führenden KI-Modelle der Welt wünschen, ohne die Infrastruktur selbst verwalten zu müssen. Mit einer einheitlichen API, transparenter Preisgestaltung und Compliance auf Unternehmensebene (SOC 2-konform, HIPAA-bereit) lässt Sie Atlas Cloud sich auf das Bauen konzentrieren, nicht auf den Betrieb.

DeepSeek auf Atlas Cloud. Wir unterstützen bereits die DeepSeek-Modellfamilie, einschließlich DeepSeek V3.2, V3.2 Fast, V3.2 Speciale und V3.2 Exp, die ab sofort über einen einzigen API-Endpunkt zu wettbewerbsfähigen Preisen verfügbar sind. DeepSeek-Modelle auf Atlas Cloud sind für Workloads mit langem Kontext und Agenten-Pipelines optimiert, mit voller Unterstützung des Kontextfensters und ohne Quantisierungsverluste. Jenseits von DeepSeek bietet Ihnen Atlas Cloud Zugriff auf über 300 Modelle aus der gesamten LLM-Landschaft.

DeepSeek-V4 kommt zu Atlas Cloud. Wir arbeiten aktiv an der Integration von DeepSeek-V4-Pro und V4-Flash. Bleiben Sie gespannt auf die Ankündigung – erkunden Sie in der Zwischenzeit alles, was bereits auf der Plattform verfügbar ist.