Zusammenfassung: GLM-5-Turbo, entwickelt von Zhipu AI (Z.ai), ist ein großes Sprachmodell, das für OpenClaw-Anwendungsfälle konzipiert wurde und die erste Closed-Source-Veröffentlichung des Unternehmens darstellt (zuvor unter dem Codenamen Pony-Alpha-2 getestet). Es wird demnächst auf Atlas Cloud verfügbar sein.

Das Modell bietet signifikante Verbesserungen bei der Werkzeugnutzung, der Befehlsausführung, mehrstufigen Workflows und der Handhabung langfristiger Aufgaben, während es ein Kontextfenster von bis zu 200K Token unterstützt. Seine Datenanalysefähigkeiten sind mit Claude Opus 4.6 vergleichbar, und es übertrifft GLM-5 bei Automatisierungs- und Informationsverarbeitungsaufgaben. Durch die Nutzung der einheitlichen API und des Multi-Modell-Ökosystems von Atlas Cloud ermöglicht GLM-5-Turbo eine effiziente Bereitstellung in komplexen Geschäftsautomatisierungen, bei der Analyse langer Dokumente sowie in der Softwareentwicklung und bietet Entwicklern und Unternehmen eine kosteneffiziente und leicht integrierbare KI-Lösung.

Wir freuen uns, bekannt zu geben, dass GLM-5-Turbo auf Atlas Cloud kommt!

- Was ist GLM-5-Turbo: GLM-5-Turbo wurde von Zhipu AI (Z.ai) entwickelt und ist ein großes Sprachmodell, das speziell für OpenClaw-Anwendungsfälle zugeschnitten ist. Es ist die erste Closed-Source-Veröffentlichung des Teams und bietet eine höhere Laufzeiteffizienz als GLM-5 bei niedrigeren Kosten pro Abfrage. Zuvor hatte Zhipu AI sein Modell der nächsten Generation informell unter dem Codenamen Pony-Alpha-2 getestet.

- Kernfunktionen: GLM-5-Turbo liefert erhebliche Verbesserungen bei der Werkzeugnutzung, der Befehlsausführung, mehrstufigen Workflows und der dauerhaften Aufgabenausführung. Es unterstützt dynamische Schlussfolgerungsmodi in verschiedenen Szenarien, Echtzeit-Streaming-Ausgabe, verbesserte Werkzeugintegration und die Handhabung langer Kontexte von bis zu 200K Token.

- Veröffentlichungsdatum: 24.03.2026.

GLM-5 erregte zuvor als leistungsfähigstes Open-Source-Modell im Artificial Analysis Intelligence Index Aufsehen, da es Gemini 3 Pro übertraf. Als Nachfolger führt GLM-5-Turbo eine Reihe iterativer Upgrades ein, die im Folgenden detailliert beschrieben werden.

Kernpositionierung: Ein für ClawBench optimiertes Modell

Starke Benchmark-Leistung

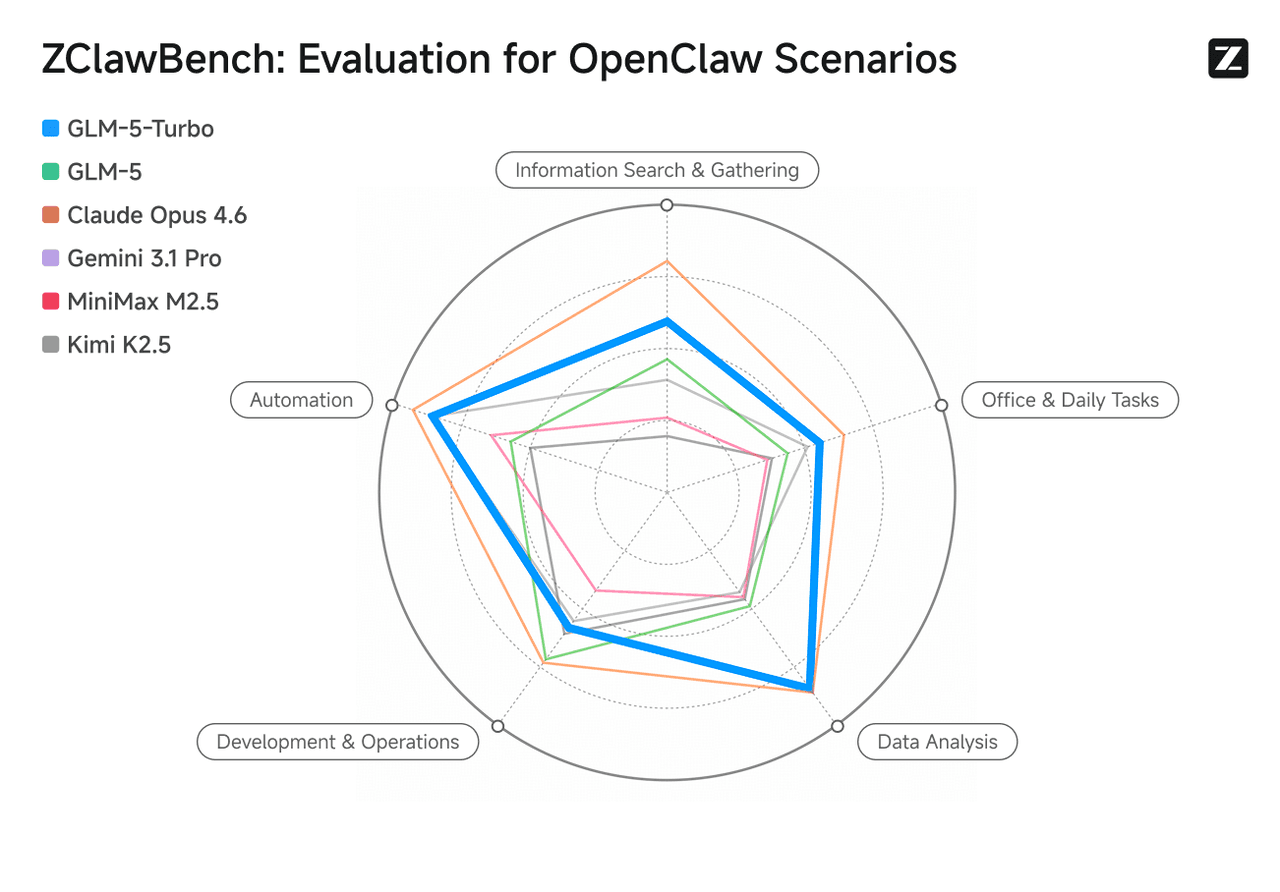

GLM-5-Turbo wurde für OpenClaw-Szenarien optimiert und verbessert die Fähigkeiten bei Werkzeugaufrufen, der Befehlsausführung und der Orchestrierung komplexer Aufgaben erheblich. Die Leistung bei der Datenanalyse ist mit Claude Opus 4.6 vergleichbar, während es GLM-5 in den Bereichen Automatisierung, Informationsbeschaffung, Büroproduktivität und Analyseaufgaben übertrifft.

Bildquelle: Offizielle Website von Zhipu AI (Z.ai).

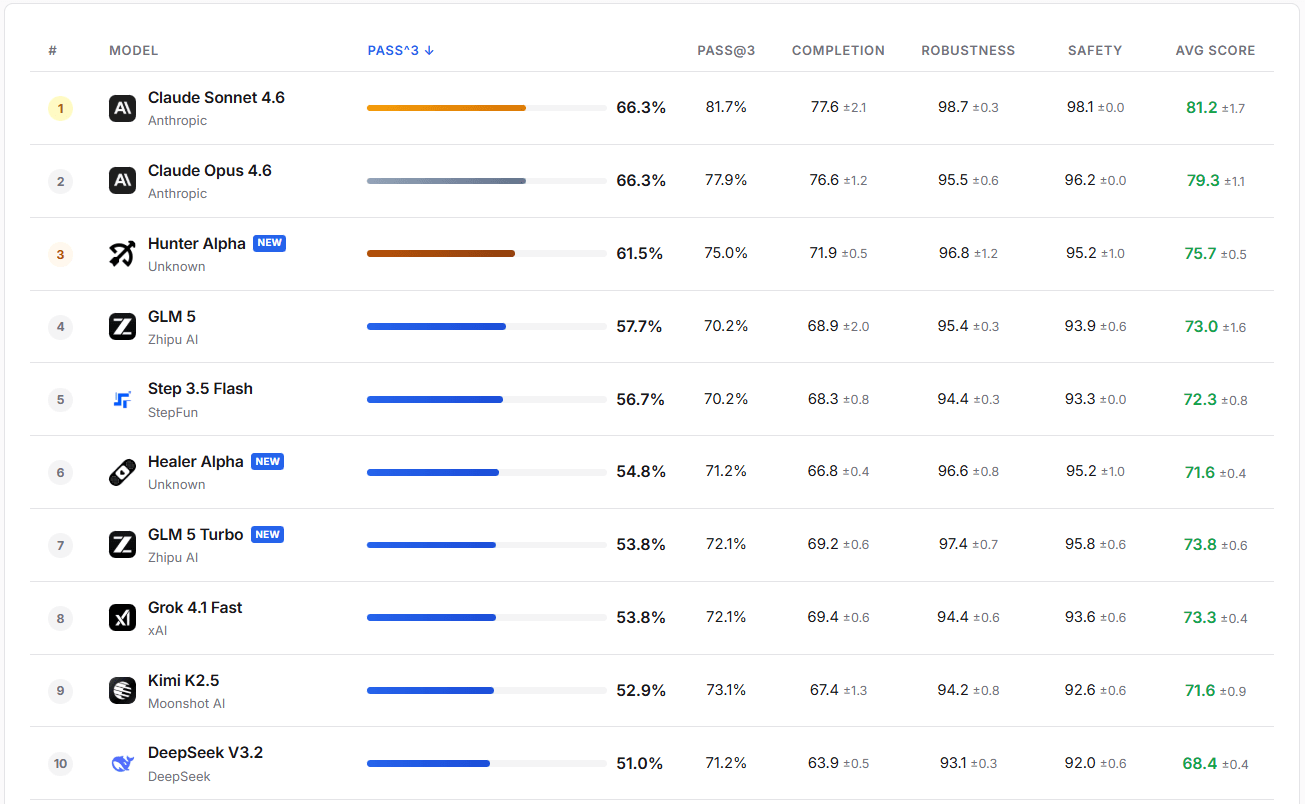

In praktischen Evaluierungen zeigt GLM-5-Turbo eine hohe Robustheit und Sicherheit. Die Erfolgsrate bei PASS@3 übersteigt die von GLM-5, Step 3.5 Flash und Kimi K2.5.

Bildquelle: https://claw-eval.github.io/

Verbesserte Werkzeugnutzung und externe Integration

Z.ai hat die agentischen Fähigkeiten von GLM-5-Turbo während des Trainings gestärkt, was eine nahtlose Interaktion mit externen Werkzeugen ermöglicht. Diese Ausrichtung auf die Ausführung bringt Kompromisse mit sich: Einige Benutzer berichten von einem etwas mechanischeren Ton im Vergleich zu GLM-5 in Rollenspielszenarien.

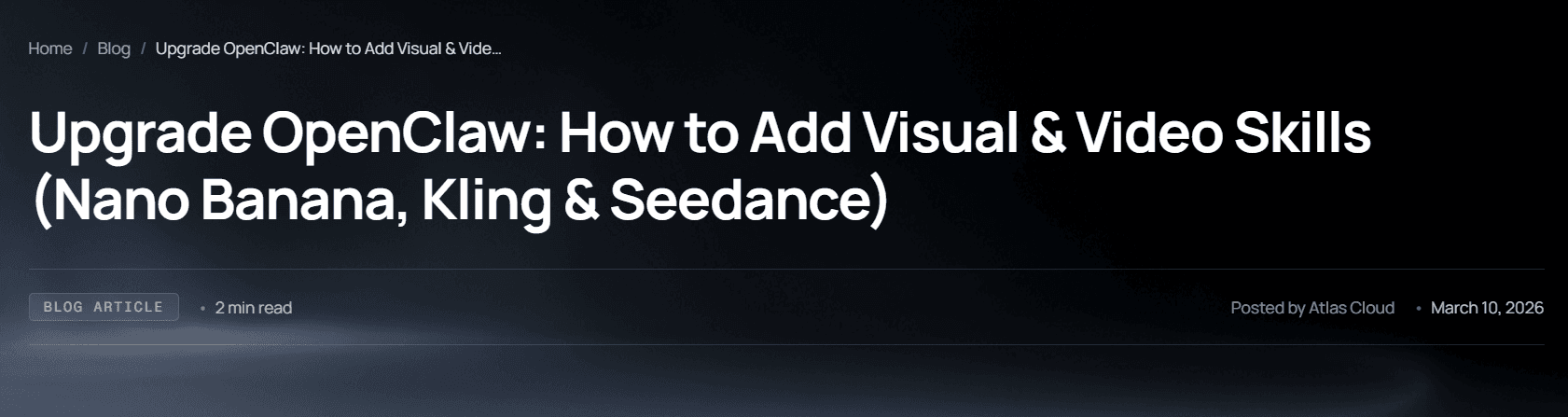

Um den unterschiedlichen Stärken der Modelle gerecht zu werden, bietet Atlas Cloud eine einheitliche Schnittstelle, die es Benutzern ermöglicht, mehrere Modelle gleichzeitig abzufragen, was einen direkten Vergleich und eine fundierte Auswahl erlaubt.

Zusätzlich können Benutzer eigene Fähigkeiten definieren oder GLM-5-Turbo erlauben, diese autonom zu entdecken und zu installieren.

Bildquelle: Atlas Cloud

Autonome Ausführung über lange Zeiträume

GLM-5-Turbo ist für Aufgaben optimiert, die geplante Auslöser oder längere Laufzeiten erfordern. Es bewältigt persistente, mehrstufige und zeitübergreifende Workflows mit starker Aufgabenkontinuität.

Das Modell schlägt proaktiv Ausführungsstrategien vor, die auf der Komplexität der Aufgabe basieren. In Vergleichstests zur Code-Optimierung lieferte GLM-5-Turbo in etwa 10 % der Fälle Empfehlungen, die konkurrierende Modelle übertrafen.

200K-Token-Kontextfenster

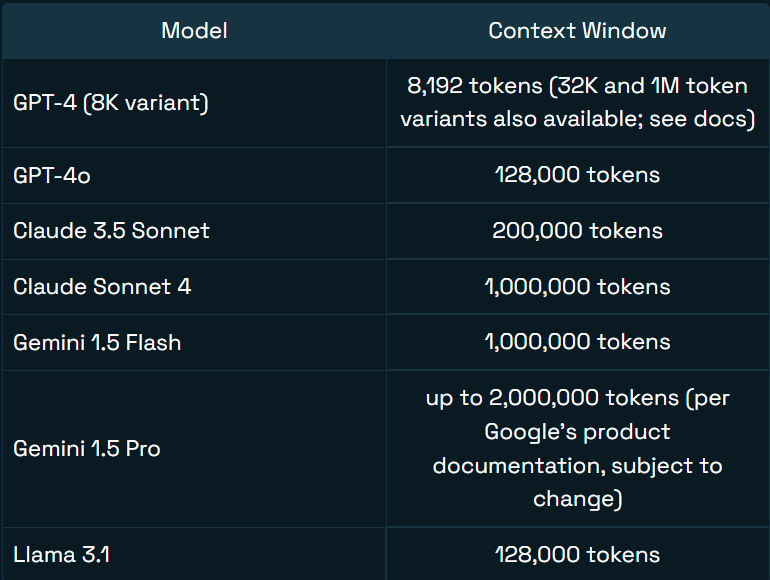

Mit der Unterstützung von bis zu 200K Token (ca. 133.000 englische Wörter) kann GLM-5-Turbo umfangreiche Kontexte innerhalb einer einzigen Sitzung speichern und nutzen. Dies ermöglicht einen genauen Abruf früherer Informationen, selbst in späteren Stadien eines Gesprächs.

Bildquelle: Jim Allen Wallace (Redis)

Anwendungsfälle

Automatisierung komplexer Workflows

Mit seinen verbesserten OpenClaw-Fähigkeiten kann GLM-5-Turbo komplexe Geschäftsprozesse dekomponieren, die zugrunde liegende Logik identifizieren und autonom die notwendigen Fähigkeiten zur Ausführung der Aufgaben finden oder generieren.

Beispielsweise kann das Modell bei der Produktion von Kurzvideos Schreib-, Bildgenerierungs- und Videoproduktionswerkzeuge suchen, installieren und orchestrieren – und so den gesamten Workflow von Anfang bis Ende planen und ausführen.

QA bei langen Dokumenten und tiefe Analyse

Das Modell behält innerhalb einer Sitzung den vollständigen Kontext über lange Dokumente hinweg bei und ermöglicht so präzise Frage-Antwort-Szenarien über mehrere Runden. Seine hohe Token-Effizienz sorgt für schnelle Antworten bei geringeren Rechenkosten.

Bei großen Codebasen kann GLM-5-Turbo die Architektur analysieren, Abhängigkeiten zwischen Komponenten abbilden und potenzielle Kaskadeneffekte durch Änderungen am Low-Level-Code aufzeigen.

"Vibe Coding"

Im Lebenszyklus der Softwareentwicklung fungiert GLM-5-Turbo eher wie ein Full-Stack-Entwickler, der in komplexe Workflows eingebettet ist. Entwickler können die übergeordnete Logik skizzieren, während das Modell die Anwendungsarchitektur in Echtzeit schrittweise aufbaut.

In Kombination mit multimodalen Fähigkeiten können Benutzer UI-Bilder, Bildschirmaufzeichnungen oder Skizzen hochladen, die das Modell direkt in funktionale Frontend-Komponenten umwandeln kann.

Warum GLM-5-Turbo auf Atlas Cloud nutzen?

Als KI-Infrastrukturplattform für alle Modalitäten bietet Atlas Cloud Benutzern eine einheitliche API-Schnittstelle. Einmal verbunden, können Benutzer problemlos auf über 300 fortschrittliche KI-Modelle zugreifen, einschließlich Text-, Bild-, Video- oder multimodaler Modelle.

Zielgruppe

- Unabhängige Entwickler, die kostengünstige, vereinfachte Lösungen für den Aufruf verschiedener KI-Modelle suchen.

- Unternehmen, die eine stabile, sichere und skalierbare Infrastruktur zur Unterstützung ihres Kerngeschäfts benötigen.

- Entwicklungsteams, die effizient mehrere crossmodale Modelle in Projekte integrieren müssen.

- Workflow-Benutzer, die Wert auf Werkzeugketten-Kompatibilität legen und ComfyUI oder n8n verwenden.

Produktmerkmale

- Stark vereinfachte Integration: Die Plattform bietet eine OpenAI-kompatible API, die den Arbeitsaufwand für Entwickler sofort vereinfacht. Kein Jonglieren mehr mit mehreren Anbieter-Keys oder Stress mit Wartungskosten über verschiedene Plattformen hinweg.

- Kostenvorteil: Im Vergleich zu Wettbewerbern bietet Atlas Cloud niedrigere Bereitstellungskosten. Nano Banana 2 kostet 0,056 $ pro Bild (Konkurrenz: 0,07 $ pro Bild); Veo 3.1 kostet 0,09 $ pro Sekunde (Konkurrenz: 0,1 $ pro Sekunde). Darüber hinaus bietet die Playground-Oberfläche volle Preistransparenz, wobei die Schaltfläche "Run" den Abzugsbetrag pro Bild oder Videosekunde direkt anzeigt.

- Stabilität & Support auf Enterprise-Niveau: Atlas Cloud stellt sicher, dass der Datenschutz strenge Sicherheitsstandards erfüllt und auch sensible Informationen verarbeiten kann.

- Plug-and-Play-freundlich: Entwickelt für eine mühelose Zusammenarbeit mit Werkzeugen wie ComfyUI und n8n, was Unternehmen hilft, Wechselkosten zu senken und direkt loszulegen.

Vergleich mit ähnlichen Produkten

- Fal.ai: Während sie einige Modelle anbieten, stellt Atlas Cloud eine größere Auswahl (über 300), wettbewerbsfähigere Preise zur Verfügung, und neue registrierte Benutzer erhalten ein Testguthaben von 1 $.

- Wavespeed: Die Preise sind deutlich höher. Atlas Cloud bietet zusätzlichen Support für Unternehmens-Compliance und fachkundige technische Beratung, was Wavespeed nicht hervorhebt.

- Kie.ai: Verwendet ein undurchsichtiges Guthabensystem. Atlas Cloud zeigt die genauen Kosten für jeden Lauf direkt auf der Oberfläche an. Die Anzahl der Modelle ist ebenfalls höher als bei Kie.ai.

- Replicate: Konzentriert sich auf das Hosten von Modellen. Die Vorteile von Atlas Cloud liegen in der API-Vereinheitlichung, der Geschwindigkeit der Modellbereitstellung und entwicklerfreundlicheren Support-Richtlinien.

- OpenAI oder Google: Diese Anbieter stellen nur ihre eigenen Modelle bereit. Benutzer mit crossmodalen Anforderungen müssen in der Regel mehrere Dienste integrieren. Atlas Cloud integriert proprietäre und Open-Source-Modelle unter einer API, was die Systemkomplexität reduziert.

Wie man GLM-5-Turbo auf Atlas Cloud nutzt?

Methode 1: Direkte Nutzung auf der Plattform

Methode 2: Nutzung via API-Integration

Schritt 1: Holen Sie sich Ihren API-Key. Erstellen und kopieren Sie Ihren API-Key in der Konsole:

Schritt 2: Konsultieren Sie die API-Dokumentation. Prüfen Sie Anfrageparameter, Authentifizierungsmethoden usw.

Schritt 3: Stellen Sie Ihre erste Anfrage (Python-Beispiel)

GLM-5 als Beispiel.

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

FAQ

Was ist der Unterschied zwischen GLM-5-Turbo und GLM-5? GLM-5-Turbo ist schneller und kosteneffizienter, mit einer deutlich verbesserten Token-Effizienz – Berichten zufolge bis zu dreimal so hoch wie bei GLM-5. Es ist zudem speziell für OpenClaw-Szenarien optimiert.

Wie schneidet GLM-5-Turbo im Vergleich zu MiniMax M2.7ab? Beide Modelle sind für agentische Werkzeugnutzung optimiert und weisen eine höhere Token-Effizienz als GLM-5 auf. Beide unterstützen Kontextfenster von etwa 200K Token (MiniMax M2.7 unterstützt 196.608 Token). Wir bereiten derzeit einen Blog-Beitrag für eine weiterführende vergleichende Evaluierung vor. Bleiben Sie dran!

Welches GLM-Modell wird für die OpenClaw-Bereitstellung empfohlen? GLM-5-Turbo, da es speziell für OpenClaw-Szenarien optimiert ist und eine Datenanalyseleistung erreicht, die mit Claude Opus 4.6 vergleichbar ist.