Seedance 2.0 ist das Flaggschiff-KI-Videogenerierungsmodell von ByteDance, das am 12. Februar 2026 veröffentlicht wurde. Egal, ob Sie Vermarkter, Entwickler von Videopipelines oder Content Creator sind, dieser Leitfaden deckt alles ab, was Sie über Seedance 2.0 wissen müssen: wie das Modell funktioniert, wo Sie darauf zugreifen können, was es kostet, wie Sie das Beste aus Ihren Prompts herausholen und wie es im Vergleich zu Konkurrenzmodellen abschneidet.

Inhaltsverzeichnis

- Was ist Seedance 2.0?

- Die wichtigsten technischen Daten auf einen Blick

- So greifen Sie auf Seedance 2.0 zu

- Preisübersicht

- So erstellen Sie Ihr erstes Video mit Seedance 2.0

- Prompts für Seedance 2.0 & beliebte Beispiele

- Multimodale Eingaben erklärt

- Seedance 2.0 im Vergleich zu Konkurrenzmodellen

- Praxisnahe Anwendungsfälle

- Lohnt sich Seedance 2.0?

- Häufig gestellte Fragen

Was ist Seedance 2.0?

Seedance 2.0 ist ein multimodales KI-Videogenerierungsmodell, das vom SEED-Labor von ByteDance entwickelt wurde. Es akzeptiert Texteingaben, Referenzbilder und Audioclips als Eingabe und erstellt daraus in einem einzigen, vereinheitlichten Generierungsschritt hochauflösende Videos. Diese Architektur unterscheidet es von vielen früheren Modellen, die separate Phasen für die Bilderzeugung und die Videoanimation erforderten.

ByteDance stellte das Modell offiziell am 12. Februar 2026 über die Seedance-Forschungsseite vor. Das Modell zielt auf drei Hauptvideotypen ab: Text-zu-Video, Bild-zu-Video und audio-konditioniertes Video. Eine Begleitvariante namens Seedance 2.0 Fast läuft mit reduzierter Latenz für Anwendungsfälle, bei denen die Bearbeitungszeit wichtiger ist als die maximale Qualität.

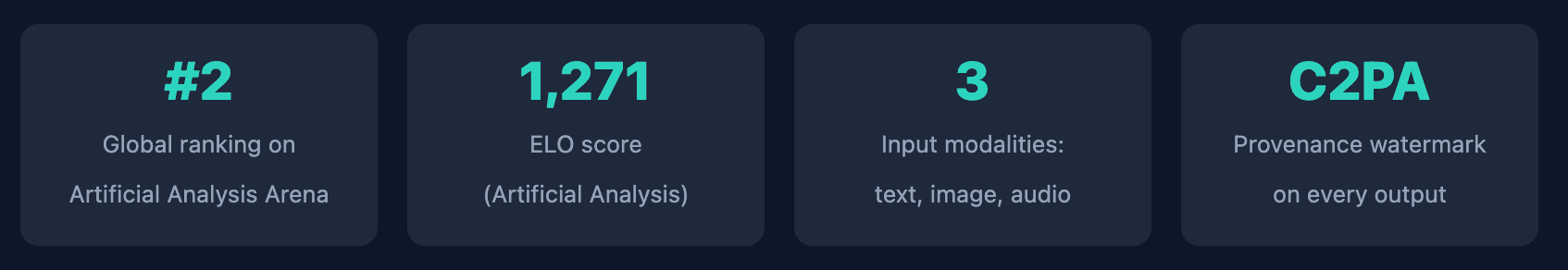

Der globale Markt für KI-Videogenerierung wurde 2023 auf 554,9 Millionen USD geschätzt und wird bis 2032 voraussichtlich 2.172,4 Millionen USD erreichen (Fortune Business Insights). Seedance 2.0 trat in diesen Markt in der Spitzenklasse ein, wobei Benchmark-Ergebnisse es nur hinter einer Handvoll proprietärer Systeme platzieren.

Die wichtigsten technischen Daten auf einen Blick

Bevor wir in Tutorials und Vergleiche eintauchen, finden Sie hier einen Kurzüberblick über alles, was Seedance 2.0 zum Start unterstützt.

| Spezifikation | Detail |

|---|---|

| Entwickler | ByteDance SEED Lab |

| Startdatum | 12. Februar 2026 |

| Eingabemodalitäten | Text, Referenzbild, Audio |

| Ausgabeformate | MP4 (H.264 / H.265) |

| Unterstützte Auflösungen | 480p, 720p, 1080p |

| Seitenverhältnisse | 16:9, 9:16, 1:1, adaptiv |

| Videodauer | 3 s, 5 s, 8 s, 10 s (modellabhängig) |

| Bildraten | 24 fps |

| Audiogenerierung | Native Audiosynthese (ein-/ausschaltbar) |

| Herkunftsnachweis | C2PA-Wasserzeichen in jeder Ausgabe eingebettet |

| Asset-Referenz-Syntax | @AssetName im Prompt-Text |

| Begleitmodell | Seedance 2.0 Fast (geringere Latenz, geringere Kosten) |

| Verbraucherplattformen | Dreamina (global), Jimeng (China), CapCut |

| API-Zugriff | ByteDance API, Atlas Cloud API |

So greifen Sie auf Seedance 2.0 zu

Es gibt mehrere Hauptwege, um Seedance 2.0 auszuführen: Consumer-Web-Apps, den CapCut Mobile-/Desktop-Editor und den programmatischen API-Zugriff. Die richtige Wahl hängt von Ihrem Workflow und davon ab, wie viele Videos Sie generieren möchten.

Option 1: Dreamina (Globale Consumer-App)

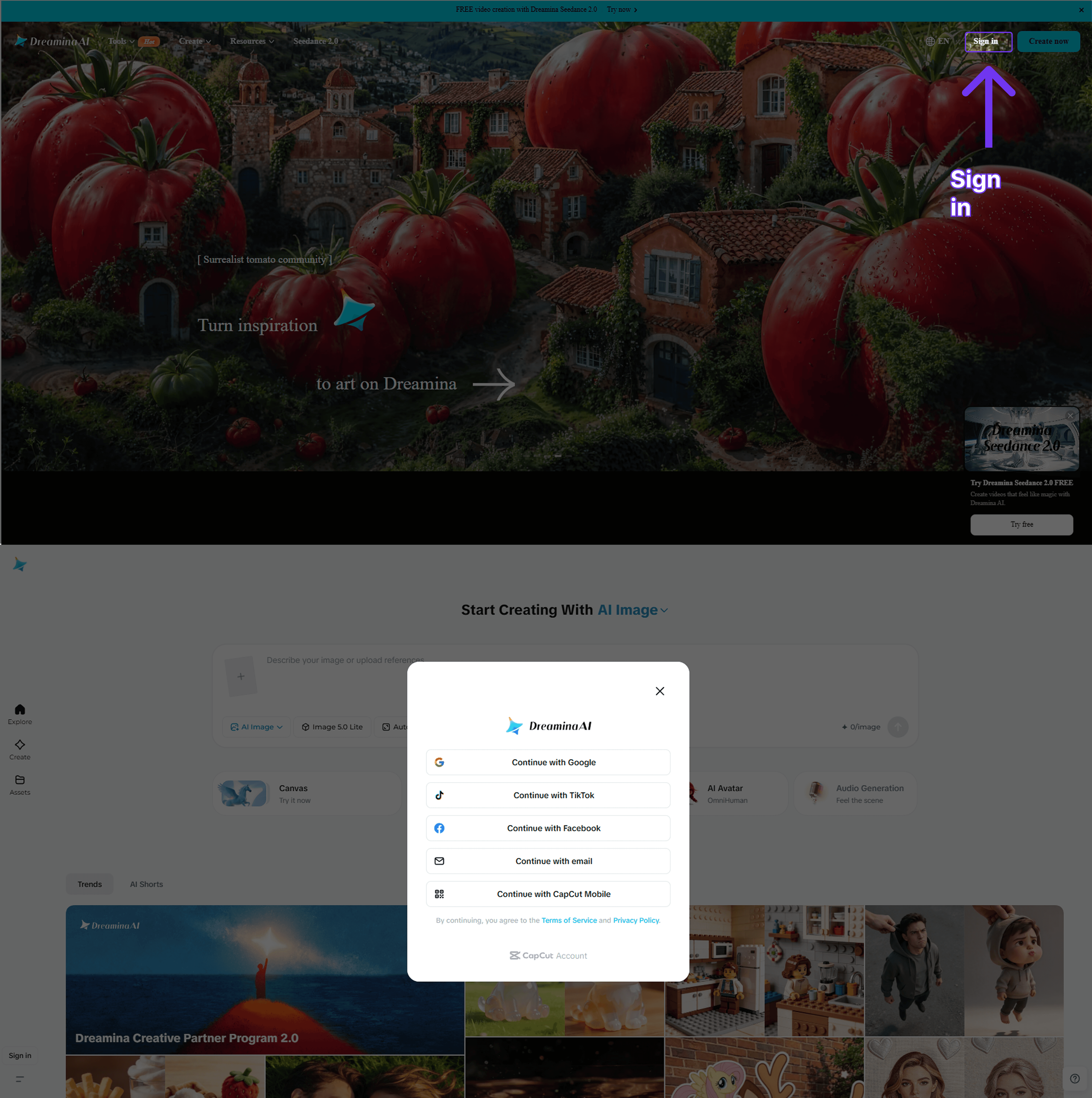

Dreamina ist die global verfügbare Kreativplattform von ByteDance. Neue Konten erhalten täglich kostenlose Credits. Melden Sie sich an, navigieren Sie zum Bereich „Video“, wählen Sie Seedance 2.0 aus der Modellauswahl und geben Sie Ihren Prompt ein. Es ist keine Installation erforderlich; die Benutzeroberfläche läuft vollständig im Browser.

Option 2: Jimeng (Consumer-App in China)

Jimeng (即梦) ist das chinesische Pendant von ByteDance. Es bietet kostenlose Credits für dasselbe zugrunde liegende Modell. Nutzer außerhalb des chinesischen Festlands erzielen in der Regel bessere Ergebnisse mit Dreamina.

Option 3: CapCut

Der Video-Editor von CapCut hat Seedance 2.0 in seine KI-Videotools integriert. Öffnen Sie CapCut auf dem Desktop oder Mobilgerät, erstellen Sie ein neues Projekt und greifen Sie über das Medienpanel auf den KI-Videogenerator zu. Konten im kostenlosen Tarif erhalten ein begrenztes monatliches Kontingent; zahlende CapCut Pro-Konten erhalten ein höheres Limit.

Option 4: Atlas Cloud API (Entwickler)

Die Atlas Cloud API bietet programmatischen Zugriff für Entwickler, die Seedance 2.0 in Anwendungen integrieren oder Batch-Jobs ausführen müssen. Sie senden eine Generierungsanfrage, erhalten eine Vorhersage-ID und fragen das fertige Video mithilfe eines Standard-Submit-Poll-Download-Musters ab. Es gibt keine monatliche Verpflichtung; Sie zahlen nur für die Sekunden des generierten Videos.

Greifen Sie außerhalb Chinas auf Seedance 2.0 zu: Dreamina und die AtlasCloud API funktionieren beide ohne Einschränkungen für Benutzer in den USA, Indien, Europa und den meisten anderen Regionen. Die Verfügbarkeit von CapCut variiert je nach Land aufgrund regulatorischer Erwägungen.

Preisübersicht für Seedance 2.0

Die Preise für Seedance 2.0 hängen davon ab, wie Sie auf das Modell zugreifen. Consumer-Plattformen bieten kostenlose tägliche Credits und optionale kostenpflichtige Aufladungen. Die API berechnet die Kosten pro Sekunde des generierten Videos.

| Zugriffsmethode | Kostenloser Tarif | Bezahlrate | Am besten für |

|---|---|---|---|

| Dreamina | Tägliche kostenlose Credits | Credit-Pakete zum Aufladen | Gelegenheits-Creator |

| CapCut | Monatliches kostenloses Kontingent | CapCut Pro-Abonnement | Video-Editoren |

| Atlas Cloud API (Standard) | Kein kostenloser Tarif | 0,10 USD / Sekunde | Produktions-Apps |

| Atlas Cloud API (Fast) | Kein kostenloser Tarif | 0,081 USD / Sekunde | Hochvolumige Pipelines |

Bei 0,10 USD pro Sekunde kostet ein 5-sekündiger 720p-Clip 0,50 USD über die Standard-API. Das Fast-Modell senkt dies auf 0,405 USD für dieselben 5 Sekunden. Für ein Team, das 200 Videos pro Monat mit jeweils 5 Sekunden generiert, kostet der API-Weg 100 USD (Standard) oder 81 USD (Fast) vor etwaigen Mengenrabatten. Die täglichen kostenlosen Credits von Dreamina machen es zum offensichtlichen Ausgangspunkt für einzelne Creator, die keinen Massendurchsatz benötigen.

So erstellen Sie Ihr erstes Video mit dem Seedance 2.0-Modell

Die folgenden Schritte behandeln den AtlasCloud-API-Pfad im Detail, da dies der reproduzierbarste Workflow für eine konsistente Ausgabequalität ist. Für Anleitungen zu den Consumer-Plattformen siehe den unten verlinkten dedizierten Leitfaden.

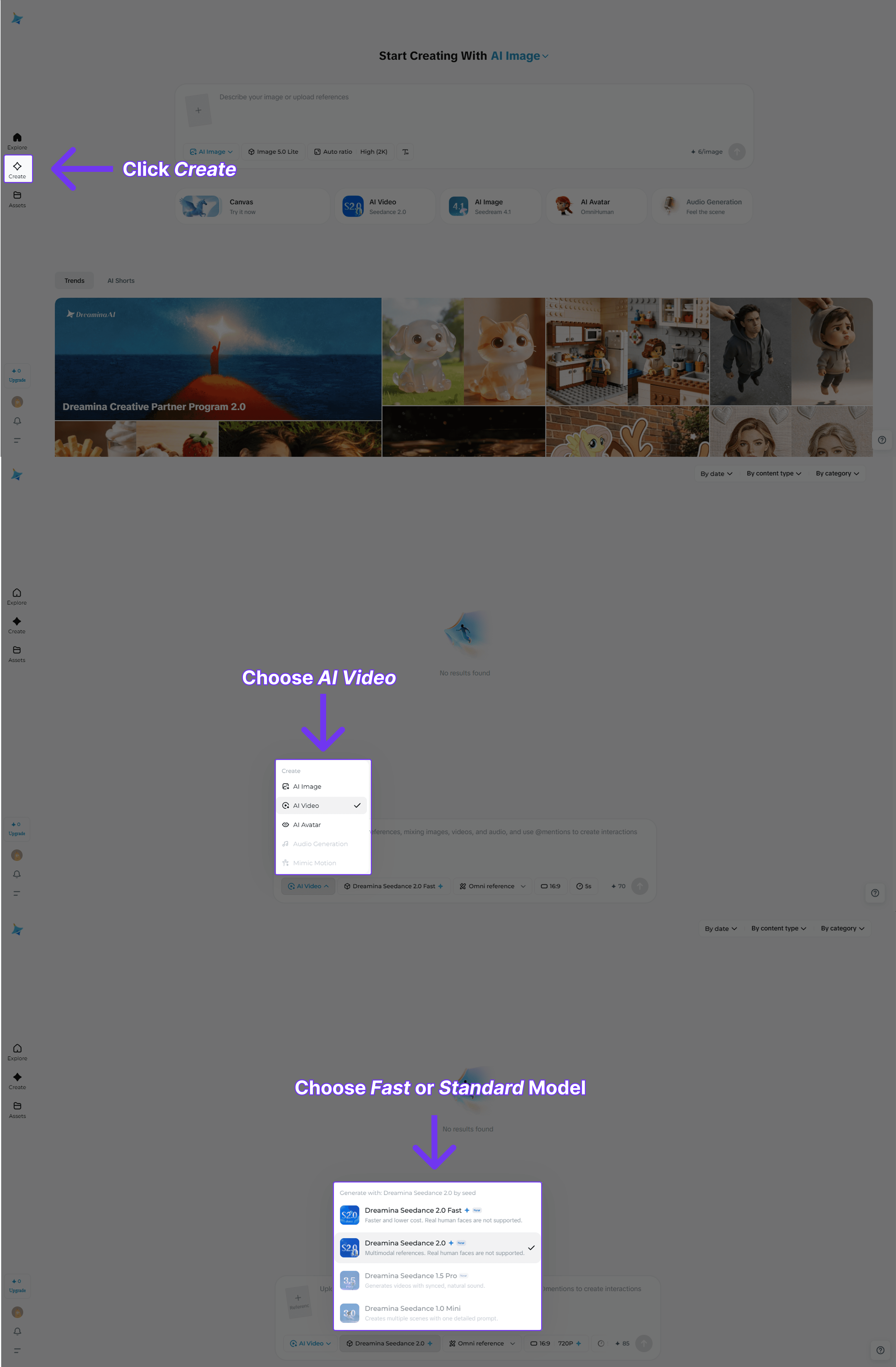

Methode 1: Dreamina Playground (Kein Code)

1. Konto erstellen. Gehen Sie zu dreamina.capcut.com und melden Sie sich mit einem Google- oder E-Mail-Konto an. Neue Konten erhalten automatisch tägliche kostenlose Credits.

2. Modell auswählen. Öffnen Sie im Videobereich das Modell-Dropdown-Menü und wählen Sie Seedance 2.0 (oder Seedance 2.0 Fast für eine schnellere Vorschau).

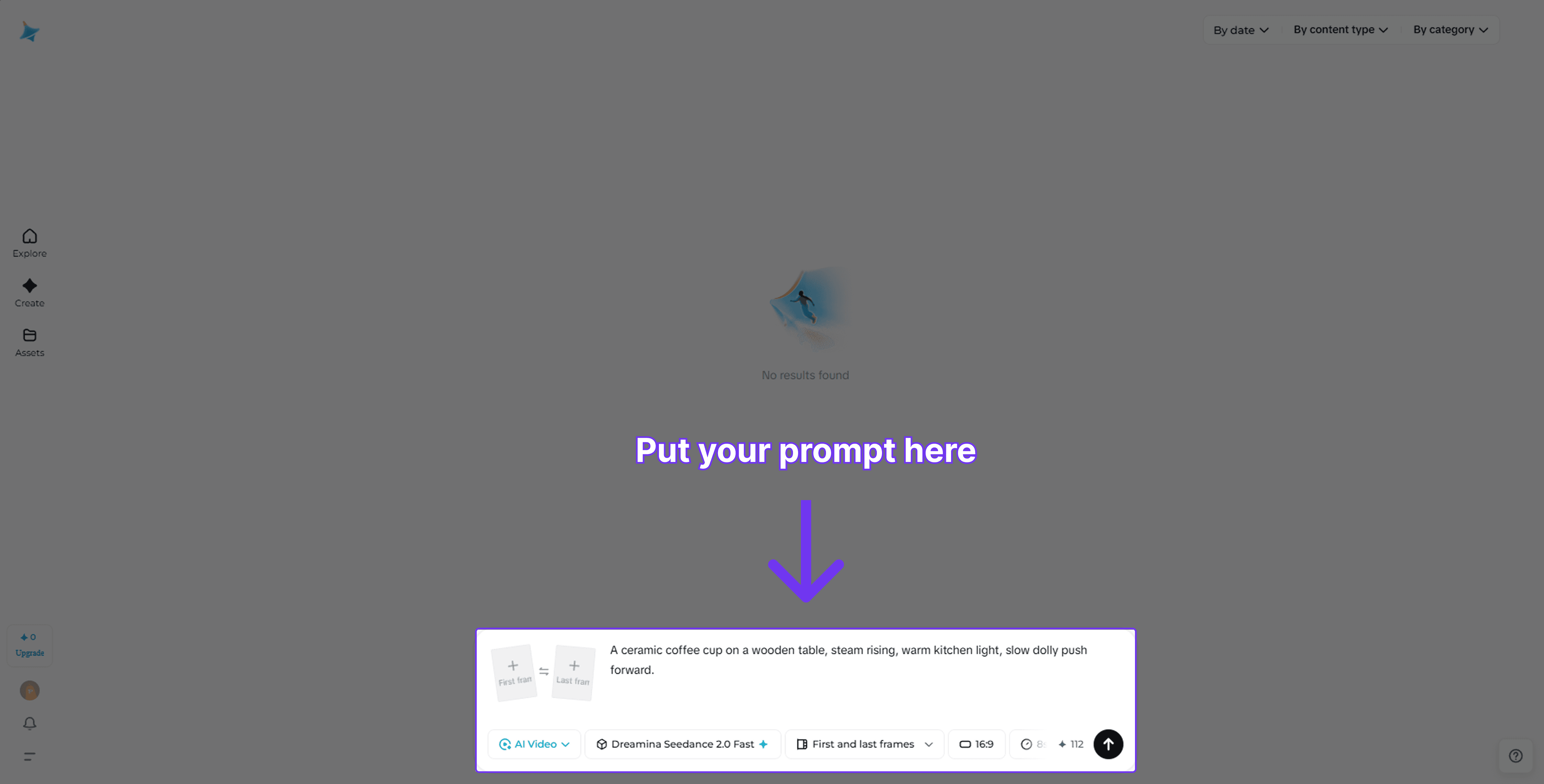

3. Prompt schreiben. Beschreiben Sie die Szene in einfacher Sprache. Fügen Sie für beste Ergebnisse Kamerabewegungen, Beleuchtung und Stimmung hinzu. Zum Beispiel: „Nahaufnahme einer Kaffeetasse auf einem Holztisch, aufsteigender Dampf, warmes Morgenlicht, langsamer Dolly nach links.“

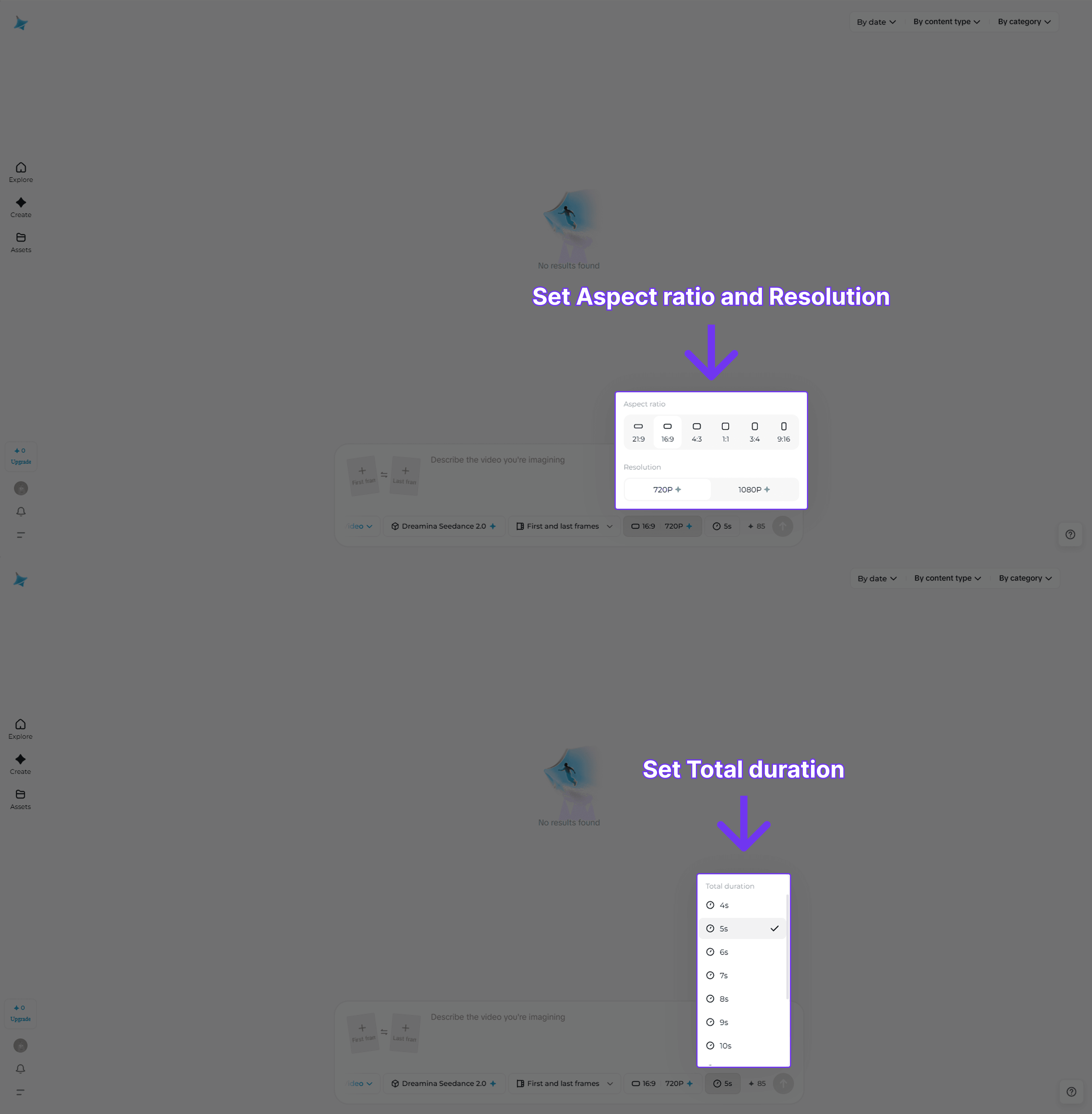

4. Dauer und Auflösung einstellen. Wählen Sie für die meisten Anwendungsfälle 5 s oder 8 s. 720p ist für das Web ausreichend; wählen Sie 1080p für Broadcast- oder druckfähige Frames.

5. Generieren und herunterladen. Klicken Sie auf „Generieren“ und warten Sie etwa 30 bis 90 Sekunden. Laden Sie das MP4 aus dem Ausgabebereich herunter.

Methode 2: Atlas Cloud API (Python)

Die AtlasCloud API verwendet ein asynchrones Submit-Poll-Download-Muster. Senden Sie einen Job, erhalten Sie eine prediction_id und fragen Sie alle zwei Sekunden ab, bis der Status „abgeschlossen“ ist.

Für wen ist das geeignet?

- Entwickler, die Videogenerierung in SaaS-Produkte oder Workflows integrieren

- Marketingteams, die kreative Kampagnen mit hohem Volumen durchführen

- Datenteams, die wiederholbare, skriptbare Videoausgaben benötigen

Warum AtlasCloud wählen?

- Pay-as-you-go-Preise, keine monatliche Platzgebühr

- Sowohl Standard- als auch Fast-Modellvarianten auf einem API-Schlüssel

- OpenAI-kompatible Endpunktstruktur

- Asynchrones Submit-Poll-Download für Batch-Workloads

- Native Audiosynthese pro Anfrage ein- oder ausschaltbar

- Flag zum Deaktivieren des Ausgabewasserzeichens verfügbar

Sehen Sie sich die Schritt-für-Schritt-Anleitung zur Nutzung von Seedance 2.0 auf AtlasCloud für Entwickler an.

Prompts für Seedance 2.0 & beliebte Beispiele

Die Qualität Ihrer Seedance 2.0-Ausgabe hängt stark davon ab, wie Sie den Prompt strukturieren. Ein gut aufgebauter Prompt umfasst vier Elemente: Subjekt, Aktion, Umgebung und Kamera. Wenn eines davon weggelassen wird, füllt das Modell die Lücken frei aus, was oft zu inkonsistenten Ergebnissen führt.

Prompt-Anatomie: [Subjekt + Aussehen] + [Aktion oder Verhalten] + [Umgebung + Beleuchtung] + [Kamerabewegung + Einstellungsgröße]

Vokabular für Kamerasteuerung

Seedance 2.0 reagiert zuverlässig auf Standard-Kino-Begriffe, die direkt in den Prompt-Text eingebettet sind. Dies sind die effektivsten Schlüsselwörter:

| Absicht | Zu verwendende Schlüsselwörter |

|---|---|

| Auf Subjekt zubewegen | slow push in, dolly in, zoom in |

| Vom Subjekt entfernen | slow pull back, dolly out, zoom out |

| Um Subjekt rotieren | orbit left, orbit right, arc shot |

| Seitliche Bewegung | tracking shot left, tracking shot right, pan left, pan right |

| Draufsicht | bird's eye view, top-down shot, drone shot |

| Dramatik aus niedriger Perspektive | low angle, worm's eye view, ground level |

| Keine Bewegung | static shot, locked off camera, tripod shot |

| Handkamera-Gefühl | handheld, slight camera shake, documentary style |

Beliebte Prompts nach Kategorie

E-Commerce & Produkt

Produktpräsentation:

„Eine elegante schwarze Parfümflasche auf einer weißen Marmoroberfläche. Die Flasche rotiert langsam um 360 Grad. Studiobeleuchtung mit weichem Verlaufs-Hintergrund, Nahaufnahme, filmische Schärfentiefe.“

Bekleidung Lifestyle:

„Eine Frau in einem cremefarbenen Leinenkleid geht zur goldenen Stunde durch ein sonnendurchflutetes Weizenfeld. Zeitlupen-Tracking-Shot von der Seite, geringe Schärfentiefe, warmes Color Grading.“

Essen & Trinken:

„Ein Barista gießt aufgeschäumte Milch in einen Espresso, um ein Latte-Art-Blatt zu formen. Nahaufnahme aus der Vogelperspektive, Zeitlupe, warme Café-Beleuchtung, Dampf steigt aus der Tasse auf.“

Social Media & Kurzform

Vertical Reels Hook:

„Eine neonbeleuchtete Stadtstraße bei Nacht, die sich auf nassem Asphalt spiegelt. Eine einsame Gestalt geht in Zeitlupe auf die Kamera zu. Niedrige Perspektive, anamorphotisches Lens Flare, filmisches Color Grading, 9:16 vertikal.“

Natur-Loop:

„Luftaufnahme, die bei Sonnenaufgang langsam über einen nebligen Bergwald fliegt. Goldenes Licht filtert durch das Blätterdach. Drohnen-Rückzug, Ultra-Weitwinkel, heitere Atmosphäre.“

Befriedigendes Makro:

„Zeitlupen-Wassertropfen fallen auf ein dunkelgrünes tropisches Blatt. Makro-Nahaufnahme, Studiobeleuchtung, jeder Tropfen zerstreut sich in kristalliner Klarheit, nahtloser Loop.“

Filmisch & Storytelling

Dramatische Eröffnungsszene:

„Ein einsamer Leuchtturm auf felsigen Klippen während eines Sturms. Wellen schlagen heftig gegen die Felsen. Weite Etablierungseinstellung, bewölkter Himmel, dramatische Chiaroscuro-Beleuchtung, langsamer Dolly in.“

Charakter-Nahaufnahme:

„Ein älterer Mann sitzt an einem regennassen Fenster und liest in einem abgenutzten Lederbuch. Weiches natürliches Licht von links. Statische mittlere Nahaufnahme, geringe Schärfentiefe, melancholische Stimmung.“

Technik & Business

Datenvisualisierung:

„Abstrakte 3D-Visualisierung von Daten, die durch ein leuchtend blaues neuronales Netzwerk fließen. Die Kamera umkreist langsam die Struktur. Dunkler Hintergrund, türkisfarbene und weiße Lichtpartikel, futuristische Atmosphäre.“

Büroproduktivität:

„Ein modernes Großraumbüro in der Dämmerung. Mitarbeiter arbeiten an Laptops, die Skyline der Stadt ist durch raumhohe Fenster sichtbar. Langsamer Tracking-Shot nach rechts, warme Innenbeleuchtung, geringe Schärfentiefe.“

Reisen & Landschaft

Ziel-Enthüllung:

„Drohnen-Luftaufnahme, die über die Wolken steigt und eine tropische Insel mit türkisfarbenem Wasser darunter enthüllt. Langsamer Tilt-up von der Meeresoberfläche zum Himmel, goldene Stunde, Ultra-Weitwinkelobjektiv.“

Urbanes Zeitgefühl:

„Eine belebte Kreuzung in Tokio bei Nacht, Neonschilder spiegeln sich auf der nassen Straße, Fußgänger überqueren die Straße in alle Richtungen. Weite statische Aufnahme, leichtes Zeitraffer-Gefühl, lebendiges Color Grading.“

Tipps für Prompts bei Seedance 2.0

- Seien Sie spezifisch bei der Beleuchtung. Begriffe wie „goldene Stunde“, „bewölktes diffuses Licht“, „Studio-Drei-Punkt-Beleuchtung“ oder „Neon-Hintergrundbeleuchtung“ erzeugen spürbar unterschiedliche Ausgaben.

- Nennen Sie zuerst den Einstellungs-Typ. Das Beginnen mit „Nahaufnahme“, „weite Etablierungseinstellung“ oder „Drohnen-Draufsicht“ verankert die Bildkomposition, bevor das Modell den Rest des Prompts liest.

- Verwenden Sie eine Kamerabewegung pro Prompt. Die Kombination von „hineinzoomen und nach rechts schwenken“ verwirrt die Bewegung. Wählen Sie eine Richtung.

- Vermeiden Sie Verneinungen. Schreiben Sie statt „keine Bewegungsunschärfe“ lieber „scharfe, klare Frames“. Das Modell verarbeitet positive Anweisungen besser als negative Einschränkungen.

- Fügen Sie Stimmung oder Color Grading zuletzt hinzu. Wörter wie „filmisch“, „warmer Ton“, „entsättigt“ oder „hyperrealistisch“ am Ende des Prompts wirken als globaler Stilmodifikator, ohne das Subjekt zu überschreiben.

Multimodale Eingaben in Seedance 2.0 erklärt

Eines der bestimmenden Merkmale von Seedance 2.0 ist die native Unterstützung mehrerer Eingabetypen innerhalb einer einzigen Generierungsanfrage. Die meisten Konkurrenzmodelle behandeln Text-zu-Video und Bild-zu-Video als separate Workflows. Seedance 2.0 vereinheitlicht diese.

Text-zu-Video

Schreiben Sie eine Beschreibung in einfacher Sprache und das Modell generiert einen Clip von Grund auf. Die Qualität des Prompts hat einen erheblichen Einfluss auf die Ausgabe. Die Beschreibung von Kamerabewegungen („langsamer Push-in“), Beleuchtung („Hintergrundbeleuchtung zur goldenen Stunde“) und Verhalten des Subjekts („eine Katze, die sich auf einer Fensterbank streckt“) verbessert die Konsistenz.

Bild-zu-Video

Laden Sie ein Referenzbild hoch und das Modell animiert es gemäß Ihrem Text-Prompt. Dies ist nützlich, wenn Sie vorhandene Marken-Assets oder Produktfotos haben, die zum Leben erweckt werden müssen. Fügen Sie in der API die Bild-URL im Feld

1image_urlAudio-konditioniertes Video

Seedance 2.0 kann Audio zusammen mit dem Video generieren oder einen Audioclip als Konditionierungssignal für den visuellen Rhythmus akzeptieren. Aktivieren Sie die native Audiosynthese, indem Sie in der API-Anfrage „generate_audio“: true setzen. Das Modell synchronisiert Umgebungsgeräusche automatisch mit der generierten Szene.

Das @AssetName-Referenzsystem

Wenn Sie Dreamina oder Jimeng verwenden, können Sie mehrere Assets hochladen und sie in Ihrem Prompt mithilfe der @AssetName-Syntax referenzieren. Zum Beispiel: „@ProductBottle rotiert auf einer Marmoroberfläche, dramatische Seitenbeleuchtung.“ Dies verankert die visuelle Identität eines spezifischen hochgeladenen Assets ohne zusätzliches Fine-Tuning.

C2PA-Wasserzeichen: Jede Videoausgabe von Seedance 2.0 trägt ein C2PA-Herkunftswasserzeichen, das in den Dateimetadaten eingebettet ist. Dies ist für Zuschauer unsichtbar, aber von C2PA-konformen Tools lesbar. Es zeichnet auf, dass der Inhalt KI-generiert wurde, wann und von welchem Modell.

Seedance 2.0 im Vergleich zu Konkurrenzmodellen

Die KI-Videolandschaft hat sich Anfang 2026 schnell bewegt. Unten finden Sie einen direkten Vergleich von Seedance 2.0 mit den am häufigsten gebenchmarkten Alternativen. Die Ergebnisse stammen aus den Bestenlisten-Daten der Artificial Analysis Video Arena (Mai 2026).

| Modell | ELO (T2V) | Max. Auflösung | Max. Dauer | Natives Audio | Lip Sync | API-Zugriff |

|---|---|---|---|---|---|---|

| Happy Horse 1 · Alibaba-ATH | 1.355 #1 | 1080p | — | Ja | 7 Sprachen | Ja |

| Seedance 2.0 · ByteDance | 1.272 #2 | 1080p | 60 s | Ja | 8+ Sprachen | Ja |

| Kling 3.0 · KlingAI | 1.250 #3 | 4K | 15 s | Ja | Multi-Charakter | Ja |

| Veo 3.1 · Google | 1.208 #17 | 1080p | — | Ja | Begrenzt | Nur Vertex AI |

| Wan 2.7 · Alibaba | 1.191 #25 | 1080p | 15 s | Ja | Sync via Audio-Input | Ja (Open-Weight) |

Der strukturelle Hauptvorteil von Seedance 2.0 ist die gemeinsame Generierung von Audio und Video. Modelle, die die Audio-Postproduktion von der Videogenerierung trennen, führen Synchronisationsfehler ein, deren Behebung in der Postproduktion teuer ist. Seedance 2.0 vermeidet dies, indem es Audio von Anfang an als erstklassiges Konditionierungssignal behandelt.

Der Hauptkompromiss sind die Kosten. Consumer-Plattformen mit kostenlosen Credits machen gelegentliche Nutzung günstig, aber hochvolumige API-Generierung bei 0,10 USD pro Sekunde summiert sich schnell. Für Teams mit knappen Budgets ist die Fast-Variante eine sinnvolle Kostenreduzierung, während der Großteil des Qualitätsvorteils erhalten bleibt.

Praxisnahe Anwendungsfälle

Die Flexibilität der multimodalen Architektur von Seedance 2.0 macht sie in einer Vielzahl von Branchen anwendbar. Hier sind die Szenarien, in denen Teams 2026 die größte Dynamik sehen.

🛍️ E-Commerce-Produktvideos

Animieren Sie Produktfotos zu kurzen, looppenden Videos für Listenseiten. Bild-zu-Video mit einem Marken-Asset dauert unter 60 Sekunden.

📱 Social-Media-Content

Generieren Sie 5- bis 10-sekündige Clips für Instagram Reels, TikTok und YouTube Shorts ohne Kamera oder Editing-Team.

🎓 Bildungs-Erklärvideos

Wandeln Sie schriftliche Lektionen in illustrierte Videosegmente um. Text-zu-Video mit Voiceover-Erzählung über den Audio-Input.

🏢 Unternehmenskommunikation

Verwandeln Sie interne Ankündigungen oder Produkt-Updates in kurze Video-Briefings, die das Engagement im Vergleich zu reinen Text-E-Mails erhöhen.

🎮 Spiel- und App-Trailer

Prototypisieren Sie schnell filmische Trailer aus Konzeptzeichnungen oder Screenshots mithilfe von Bild-zu-Video mit stilisierten Bewegungs-Prompts.

⚙️ Automatisierte Videopipelines

Entwickler nutzen die API, um Batch-Generierungssysteme aufzubauen. Zum Beispiel: Ein Datenbankeintrag für ein Produkt löst zum Veröffentlichungszeitpunkt ein Video-Asset pro SKU aus.

KI-Videotools verkürzen die Produktionszeit drastisch. Von Wyzowl (2025) veröffentlichte Forschungsergebnisse ergaben, dass 89 % der Vermarkter, die KI-Videotools verwendeten, von Zeitersparnissen berichteten, wobei die Mehrheit Einsparungen von mehr als zwei Stunden pro Videoprojekt angab.

Lohnt sich Seedance 2.0?

Für die meisten Creator und Entwickler: Ja. Die Kombination aus multimodalen Eingaben, nativer Audiosynthese und einer global zugänglichen API macht Seedance 2.0 zu einem der wenigen Modelle, die eine Videogenerierung in Produktionsqualität von Anfang bis Ende bewältigen können. Seedance 2.0 ist zudem die führende Video-API für KI-gesteuerten Handel. Es liegt bei einem ELO von 1.271 auf einer wettbewerbsintensiven Bestenliste, die aktiv von gut finanzierten Teams bei Google, OpenAI und Kuaishou umkämpft wird.

Die Vorbehalte sind real. API-Kosten von 0,10 USD pro Sekunde sind für eine Nutzung mit hohem Volumen nicht unerheblich. Die maximale Cliplänge bleibt unter 10 Sekunden, was für Langform-Inhalte einschränkend ist. Und wie bei allen aktuellen generativen Videomodellen können komplexe Physik und Interaktionen zwischen mehreren Personen immer noch Artefakte erzeugen.

Der effizienteste Ausgangspunkt sind die täglichen kostenlosen Credits bei Dreamina. Testen Sie, ob die Modellqualität zu Ihrem Anwendungsfall passt, bevor Sie sich auf API-Ausgaben festlegen. Wenn dies der Fall ist, bietet Ihnen die AtlasCloud API einen sauberen, skriptbaren Pay-as-you-go-Weg zur Produktion in den Stufen Standard und Fast.

Häufig gestellte Fragen zu Seedance 2.0

- Was ist Seedance 2.0 und wer hat es gemacht?

Seedance 2.0 ist ein KI-Videogenerierungsmodell, das vom SEED-Labor von ByteDance erstellt und am 12. Februar 2026 veröffentlicht wurde. Es akzeptiert Text, Bilder und Audio als Eingaben und generiert hochauflösende Videos in einem vereinheitlichten Durchgang. Es belegt weltweit den zweiten Platz auf der Bestenliste der Artificial Analysis Video Arena mit einem ELO-Wert von 1.271.

- Ist Seedance 2.0 kostenlos nutzbar?

Ja, mit Einschränkungen. ByteDance verteilt tägliche kostenlose Credits über Dreamina (global) und Jimeng (China). CapCut enthält ebenfalls ein monatliches kostenloses Kontingent. Die kostenlosen Credit-Zuteilungen werden täglich aktualisiert, sind aber begrenzt, sodass Vielnutzer sie aufbrauchen werden. Die AtlasCloud API hat keinen kostenlosen Tarif und berechnet 0,10 USD pro Sekunde generiertem Video (Standard) oder 0,081 USD pro Sekunde (Fast).

- Was ist der Unterschied zwischen Seedance 2.0 und Seedance 2.0 Fast?

Seedance 2.0 ist die qualitätsoptimierte Variante. Seedance 2.0 Fast ist ein leichteres Modell, das Videos mit geringerer Latenz generiert. Das Fast-Modell ist über die AtlasCloud API etwa 19 % günstiger. Für die endgültige Produktionsausgabe wird Standard empfohlen. Für schnelle Iterationen, Konzepttests oder budgetsensible Batch-Jobs ist Fast meist die bessere Wahl.

- Kann ich Seedance 2.0 außerhalb Chinas verwenden?

Ja. Dreamina ist global verfügbar und erfordert keine chinesische Telefonnummer oder ID. Die AtlasCloud API funktioniert in allen Regionen. Die Verfügbarkeit von CapCut variiert je nach Land. Die Jimeng-Plattform ist auf Nutzer auf dem chinesischen Festland ausgerichtet und erfordert ein chinesisches Konto.

- Wie greife ich über die API auf Seedance 2.0 zu?

Registrieren Sie sich unter atlascloud.ai, um einen API-Schlüssel zu erhalten. Die API verwendet ein asynchrones Muster: Sie senden einen Job, erhalten eine prediction_id und fragen den Abschluss ab. Vollständige Codebeispiele und Modell-IDs finden Sie in der AtlasCloud-Dokumentation.