H1 : Lancement de l'aperçu de DeepSeek-V4 : 1M de tokens de contexte, améliorations pour les agents et poids open source

Aujourd'hui (24 avril), DeepSeek lance officiellement et rend open source la version préliminaire de DeepSeek-V4, sa toute nouvelle série de modèles.

DeepSeek-V4 prend en charge jusqu'à un million de tokens de contexte et atteint des performances de pointe parmi les modèles nationaux et open source en termes de capacités agentiques, de connaissances générales et de raisonnement. La série est disponible en deux tailles :

- DeepSeek-V4-Pro — le modèle phare, est un modèle MoE (Mixture of Experts) massif avec 1,6 billion de paramètres au total, mais seulement 49B activés par passe avant — c'est la clé de son efficacité.

- DeepSeek-V4-Flash — l'option plus rapide et plus rentable. Elle suit la même conception MoE à une échelle beaucoup plus petite (284B au total / 13B activés), permettant une inférence plus rapide et moins coûteuse.

- Les deux modèles partagent la même fenêtre de contexte de 1M de tokens et sont entièrement open source avec accès API.

| Modèle | Paramètres | Activation | Données de pré-entraînement | Longueur du contexte | Open Source | Service API | Mode d'accès Web/App |

| deepseek-v4-pro | 1.6T | 49B | 33T | 1M | ✓ | ✓ | Expert Mode |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | Fast Mode |

À partir d'aujourd'hui, vous pouvez discuter avec DeepSeek-V4 sur chat.deepseek.com ou via l'application officielle. L'API est également disponible — définissez simplement

1model_name1deepseek-v4-pro1deepseek-v4-flashNous avons rapporté les spéculations et les analyses de pré-lancement plus tôt (voir notre guide des attentes sur DeepSeek V4 et notre analyse technique approfondie), nous avons maintenant des détails confirmés et officiels directement à la source. Ce qui suit couvre exactement ce qui a été déployé, les nouveautés et ce que cela signifie si vous construisez ou évaluez des modèles d'IA aujourd'hui.

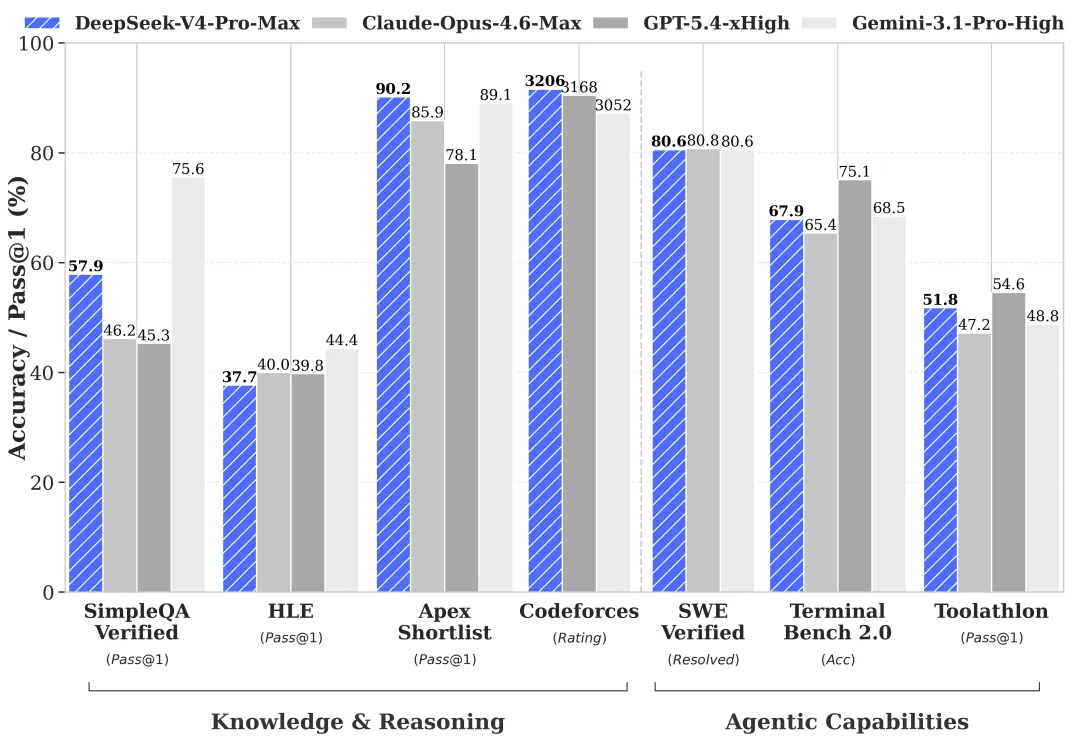

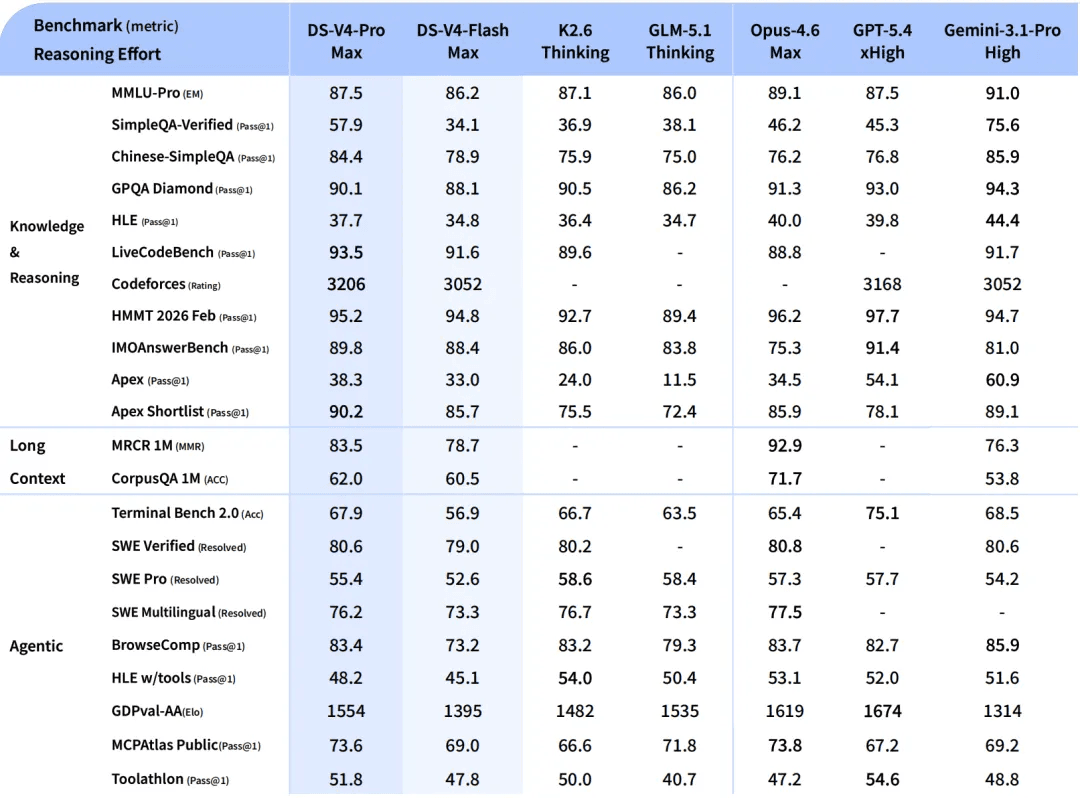

DeepSeek-V4-Pro : Rivaliser avec les meilleurs modèles propriétaires

Capacités agentiques considérablement améliorées. Par rapport à son prédécesseur, DeepSeek-V4-Pro montre une amélioration spectaculaire dans les tâches d'agent. Dans les benchmarks de codage agentique, V4-Pro est désormais en tête parmi tous les modèles open source. DeepSeek a également déployé V4-Pro en interne en tant qu'agent de codage de choix de l'entreprise — les retours des employés indiquent que l'expérience surpasse Claude Sonnet 4.5, avec une qualité de sortie approchant Claude Opus 4.6 en mode sans réflexion, bien qu'il soit toujours en retrait par rapport au mode réflexion d'Opus 4.6.

Richesse des connaissances générales. DeepSeek-V4-Pro surpasse considérablement les autres modèles open source sur les benchmarks de connaissances générales, ne tombant que légèrement derrière le meilleur modèle propriétaire, Gemini Pro 3.1.

Raisonnement de classe mondiale. Dans les évaluations en mathématiques, STEM et programmation compétitive, DeepSeek-V4-Pro surpasse tous les modèles open source évalués précédemment et égale les performances des meilleurs modèles propriétaires mondiaux.

DeepSeek-V4-Flash : Le choix rapide et abordable

Par rapport au V4-Pro, DeepSeek-V4-Flash est légèrement en retrait sur les connaissances générales, mais offre des performances de raisonnement comparables. Grâce à son nombre de paramètres plus faible et à ses coûts d'activation réduits, V4-Flash offre des temps de réponse plus rapides et une tarification API plus économique.

Sur les benchmarks d'agents, V4-Flash égale V4-Pro sur les tâches plus simples, bien qu'un écart subsiste sur les plus complexes.

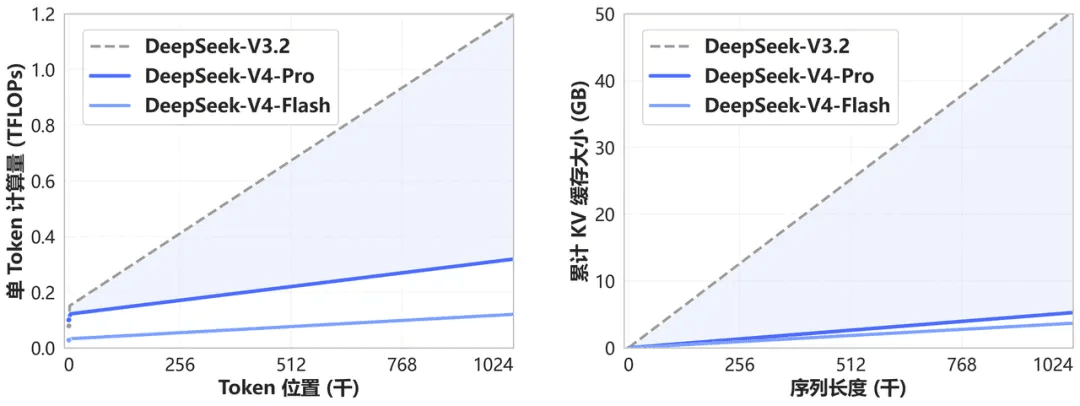

Innovation architecturale et efficacité extrême du contexte

DeepSeek-V4 introduit un nouveau mécanisme d'attention qui effectue une compression le long de la dimension des tokens. Combinée avec DSA (DeepSeek Sparse Attention), cette conception atteint des performances de contexte long de premier plan tout en réduisant considérablement les besoins en calcul et en mémoire par rapport aux approches conventionnelles.

À l'avenir, le contexte de 1M (un million) de tokens est la norme pour tous les services officiels DeepSeek.

Optimisation spécialisée pour les cas d'utilisation agentiques

DeepSeek-V4 a été affiné et optimisé pour des produits d'agent populaires, notamment Claude Code, OpenClaw, OpenCode et CodeBuddy. Des améliorations de performance ont été observées dans la génération de code, la création de documents et d'autres tâches pilotées par des agents.

Ce type d'optimisation spécifique au framework compte plus en pratique qu'il n'y paraît. Un modèle qui fonctionne bien de manière isolée mais se comporte de manière incohérente à l'intérieur d'une boucle d'agent structurée est difficile à déployer de manière fiable. La décision de traiter les principaux frameworks d'agents comme des cibles d'optimisation de premier ordre reflète l'évolution de l'utilisation de l'IA en production.

Accès à l'API DeepSeek-V4

V4-Pro et V4-Flash sont désormais disponibles via l'API DeepSeek, avec une prise en charge des interfaces OpenAI ChatCompletions et Anthropic, ce qui signifie que les intégrations existantes peuvent être redirigées vers les modèles V4 avec un minimum de changements de code. La

1base_url1model1deepseek-v4-pro1deepseek-v4-flashLes deux modèles prennent en charge une longueur de contexte maximale de 1M de tokens et proposent des modes sans réflexion et avec réflexion. En mode réflexion, un paramètre

1reasoning_effort1high1max1max⚠️ Avis de dépréciation : Les noms de modèles hérités

ettext1deepseek-chatseront retirés dans trois mois (24 juillet 2026). Pendant la période de transition, ils correspondent respectivement aux modes sans réflexion et avec réflexion detext1deepseek-reasoner. Si vous utilisez l'un ou l'autre de ces noms en production, planifiez votre migration dès maintenant.text1deepseek-v4-flash

Poids Open Source et déploiement local

- Poids du modèle :Hugging Face | ModelScope

- Rapport technique :DeepSeek-V4 PDF

Pour les équipes envisageant un déploiement local ou sur site, il convient de noter que les modèles à cette échelle de paramètres, en particulier V4-Pro avec 1,6T de paramètres au total, imposent des exigences substantielles sur le matériel. La disponibilité open source est un avantage significatif pour la conformité en entreprise et les cas d'utilisation personnalisés, mais la plupart des équipes trouveront que l'accès par API cloud est le point de départ le plus pratique.

Ce que signifie réellement ce lancement de DeepSeek-V4

Trois choses ressortent de ce lancement.

Premièrement, l'engagement sur le contexte de 1M est plus significatif qu'il n'y paraît. DeepSeek n'offre pas cela en tant que niveau premium — c'est le standard pour tous les services officiels. C'est un signal sur la direction que prend la frontière open source, et cela met une pression discrète sur tous les autres fournisseurs pour qu'ils suivent le mouvement.

Deuxièmement, le travail d'optimisation axé sur les agents — spécifiquement l'adaptation de V4 pour Claude Code, OpenCode et d'autres — reflète une maturité dans la manière dont DeepSeek envisage le déploiement. Les performances des benchmarks sont le prix d'entrée ; ce qui compte pour la production, c'est le comportement à l'intérieur des outils que les développeurs utilisent réellement.

Troisièmement, le positionnement concurrentiel honnête par rapport à Claude Opus 4.6 est notable. Plutôt que de revendiquer une supériorité totale, DeepSeek donne une évaluation nuancée : meilleur que Sonnet 4.5, approchant Claude Opus 4.6 sans réflexion, derrière le mode réflexion d'Opus 4.6. Cette précision rend les affirmations plus crédibles.

Pour les développeurs évaluant des modèles pour des flux de travail agentiques, le traitement de documents longs ou des tâches de raisonnement complexes, DeepSeek-V4-Pro est désormais un concurrent open source sérieux. Pour les pipelines optimisés en termes de coûts ou sensibles à la latence, V4-Flash offre une alternative légère crédible.

Essayez DeepSeek-V4 sur Atlas Cloud

Atlas Cloud est une plateforme d'IA de niveau production conçue pour les développeurs et les équipes qui souhaitent un accès fiable et rentable aux principaux modèles d'IA du monde sans gérer l'infrastructure. Avec une API unifiée, une tarification transparente et une conformité au niveau de l'entreprise (conforme SOC 2, compatible HIPAA), Atlas Cloud vous permet de vous concentrer sur la création, pas sur les opérations.

DeepSeek sur Atlas Cloud. Nous prenons déjà en charge la famille de modèles DeepSeek, y compris DeepSeek V3.2, V3.2 Fast, V3.2 Speciale et V3.2 Exp disponibles dès aujourd'hui via un point de terminaison API unique à des prix compétitifs. Les modèles DeepSeek sur Atlas Cloud sont optimisés pour les charges de travail à contexte long et les pipelines d'agents, avec une prise en charge complète de la fenêtre de contexte et aucune perte de quantification. Au-delà de DeepSeek, Atlas Cloud vous donne accès à plus de 300 modèles dans le paysage LLM.

DeepSeek-V4 arrive sur Atlas Cloud. Nous travaillons activement à l'intégration de DeepSeek-V4-Pro et V4-Flash. Restez à l'écoute pour l'annonce du lancement — et en attendant, explorez tout ce qui est déjà disponible sur la plateforme.