La plupart des gens pensent encore que de meilleurs mots équivalent à de meilleures images. C'était vrai il y a deux ans. Ce n'est plus le cas.

En 2026, le véritable fossé ne se situe pas entre les modèles. Il est entre les utilisateurs qui décrivent et ceux qui construisent. Un groupe tape « éclairage cinématographique, 4k, ultra détaillé ». L'autre groupe construit des scènes — direction de la lumière, couches de profondeur, angles de caméra.

Si vos images semblent encore plates, le problème n'est probablement pas le modèle. C'est ce que vous ne lui dites pas.

Pourquoi vos prompts ne suffisent plus (perspective 2026)

Les prompts génériques ne fonctionnent plus. Les modèles ont vu des phrases comme « meilleure qualité » et « haute définition » des millions de fois. Ces mots ne changent presque plus rien aujourd'hui.

Qu'est-ce qui compte vraiment ? Les entrées structurées. D'où vient la lumière ? Qu'y a-t-il au premier plan par rapport à l'arrière-plan ? Quel objectif utilisez-vous ? Les modèles modernes répondent à ces variables. Ils ignorent le superflu.

Voici un modèle courant. Quelqu'un écrit : « un beau portrait avec un éclairage doux ». Le modèle livre quelque chose de plat. Pourquoi ? Pas de direction de la lumière. Pas de séparation de profondeur. Pas d'angle de caméra. Le modèle doit deviner. Et deviner conduit à des résultats moyens.

Le changement que vous devez opérer est simple. Arrêtez de décrire le résultat. Commencez à construire la scène.

Les 7 conseils avancés

-

Indiquez la direction de la lumière

« Éclairage doux » est vague. Éclairage latéral, contre-jour, éclairage zénithal — cela donne au modèle quelque chose de concret. La direction crée des ombres. Les ombres créent de la profondeur. La profondeur rend une image réelle.

Essayez ceci au lieu de « éclairage de portrait doux » :

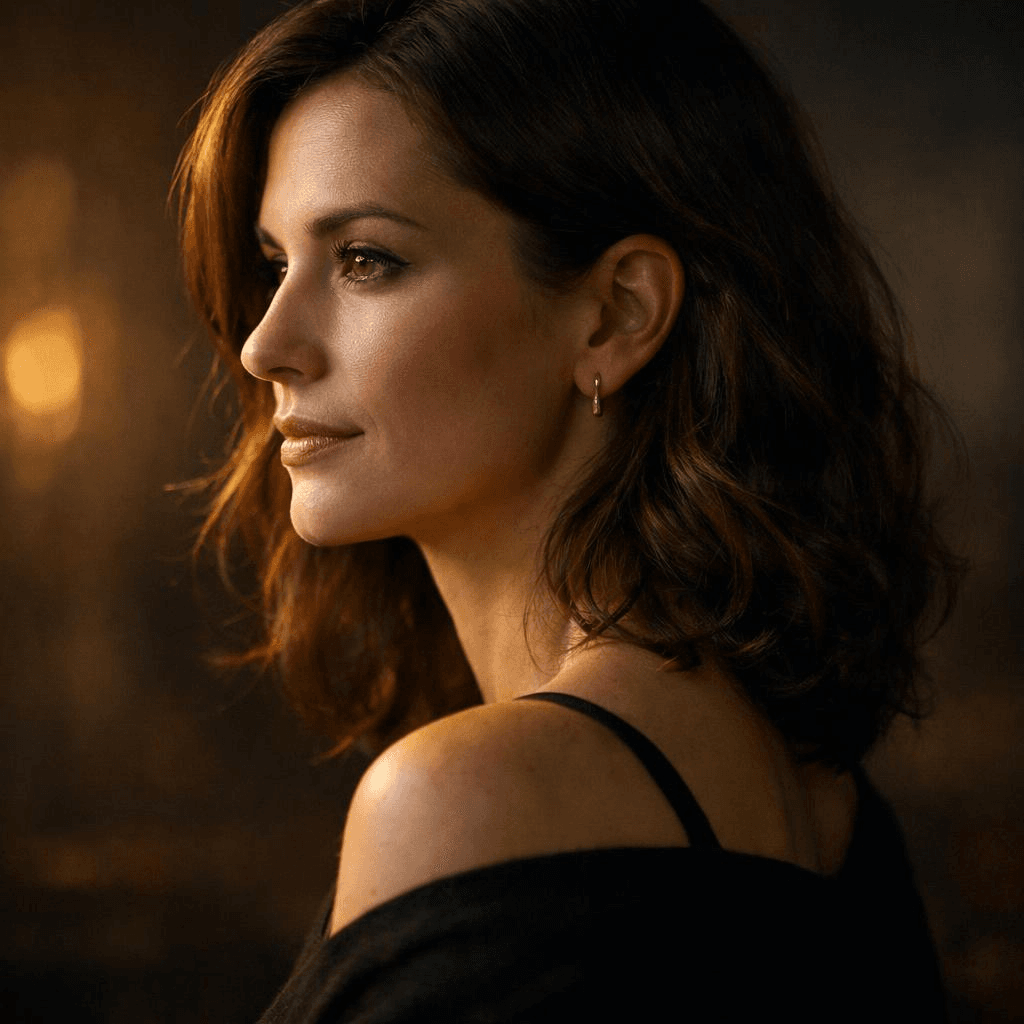

Un portrait de femme, éclairage latéral venant de la gauche, ombres douces sur le côté droit du visage, légère lumière ambiante provenant de l'arrière-plan

Vous pouvez voir la différence immédiatement. Le modèle sait exactement où se situe la lumière.

-

Utilisez de vrais réglages de photographie

Éclairage à trois points. Éclairage de contour (rim light). Éclairage Rembrandt. Ce ne sont pas juste des termes sophistiqués. Ce sont des modèles que le modèle a vus des milliers de fois pendant l'entraînement. Utilisez-les et vos résultats deviendront plus stables.

Exemple :

Prise de vue produit d'une basket, configuration d'éclairage à trois points, forte lumière principale, lumière de remplissage douce, subtil éclairage de contour séparant le produit d'un arrière-plan sombre

Cela fonctionne mieux que « éclairage dramatique » à chaque fois.

-

Construisez la profondeur couche par couche

Les images plates signifient généralement que tout est sur le même plan. Corrigez cela en nommant explicitement le premier plan, le plan moyen et l'arrière-plan.

Exemple :

Une tasse de café sur une table en bois (premier plan), une personne travaillant sur un ordinateur portable (plan moyen), un intérieur de café doucement flou avec des lumières chaudes (arrière-plan)

Maintenant, le modèle a des relations spatiales avec lesquelles travailler.

-

Utilisez le langage photographique, pas des étiquettes de style

« Style cyberpunk » est flou. « Objectif 35mm, contre-plongée, plan large » est précis. Les réglages de caméra correspondent directement à la façon dont les images sont construites.

Gardez ceci en tête :

- 35mm pour un aspect naturel et quotidien

- 85mm pour des portraits avec compression

- Grand-angle pour le drame et l'échelle

- Contre-plongée, niveau des yeux, vue de dessus pour la perspective

Exemple :

Un portrait en gros plan, objectif 85mm, faible profondeur de champ, angle au niveau des yeux, flou d'arrière-plan doux

Cela donne au modèle des instructions beaucoup plus claires que « portrait esthétique ».

-

Guidez l'attention par le contraste

Le but n'est pas d'avoir beaucoup de détails partout. Le but est le contraste. Lumière contre ombre. Chaud contre froid. Sujet net contre arrière-plan flou.

Trois types de contraste fonctionnent bien :

- Contraste de lumière : sujet brillant sur un arrière-plan sombre

- Contraste de couleur : spot chaud sur un arrière-plan aux tons froids

- Contraste de détail : sujet net, environnement flou

Exemple :

Un sujet illuminé par un spot chaud sur un arrière-plan sombre aux tons froids, éclairage à fort contraste, mise au point forte sur le sujet

L'œil du spectateur se porte exactement là où vous le voulez.

-

Ajoutez des contraintes pour nettoyer le chaos

Produisez des compositions plus propres et plus contrôlées.

Les prompts longs deviennent confus. Au lieu d'ajouter plus de détails, ajoutez des limites. Dites au modèle ce que vous ne voulez pas. Pas d'encombrement. Pas de distorsion. Pas d'objets inutiles.

Exemple :

Photo de produit minimaliste, composition centrée, fond blanc épuré, pas d'encombrement, pas de texte, pas de distorsion

Les contraintes font souvent plus que les descriptions supplémentaires.

-

Itérez comme un réalisateur, pas comme un joueur

Personne n'obtient l'image finale dès le premier essai. Les professionnels génèrent, ajustent, génèrent à nouveau.

Un flux de travail simple :

- Première étape : composition de base, sujet et environnement

- Deuxième étape : ajouter un éclairage directionnel et du contraste

- Troisième étape : affiner les détails, supprimer l'encombrement

Chaque passage améliore le résultat. C'est ainsi que l'on passe de la chance à la constance.

Synthèse — Un cadre de prompt professionnel

Arrêtez d'écrire des prompts sous forme de longues phrases. Écrivez-les comme des systèmes modulaires.

Voici une structure qui fonctionne :

plaintext1[Sujet] + [Environnement] + [Éclairage] + [Caméra] + [Composition] + [Couleur] + [Contraintes]

Regardez la différence entre un prompt de base et un prompt structuré.

Exemple : Du prompt de base au prompt professionnel

Prompt de base (Utilisateur typique) :

Une mannequin portant une robe d'été blanche, fond propre, éclairage de studio, haute définition, style e-commerce

Prompt professionnel (Structuré) :

Une mannequin portant une robe d'été blanche (sujet), debout dans un studio minimaliste avec un fond texturé beige doux (environnement), éclairage latéral venant de la droite créant des ombres douces sur le côté gauche du corps, léger éclairage de contour séparant la silhouette de l'arrière-plan (éclairage), prise de vue avec un objectif 85mm, angle au niveau des yeux (caméra), sujet légèrement décentré avec une faible profondeur de champ, flou de premier plan doux ajoutant de la profondeur (composition), tons naturels chauds, contraste doux (couleur), composition propre, pas d'encombrement, pas de distorsion, pas d'objets inutiles (contraintes)

Conclusion — Du prompting à la réalisation

Obtenir une seule super image, c'est bien. Mais les vrais projets nécessitent des centaines de visuels cohérents et de haute qualité. Le prompting manuel n'est pas scalable.

Vous rencontrez des problèmes pratiques. Latence. Coût par image. Maintenir le même style visuel sur plusieurs lots. La conception de prompts seule ne peut pas résoudre cela. Vous avez besoin d'un système.

C'est là que la génération d'images basée sur API devient essentielle. Au lieu de taper des prompts dans une interface de test à chaque fois, vous intégrez la génération dans votre flux de travail. Les prompts structurés sont réutilisés. Automatisés. Optimisés avec le temps.

Des plateformes comme Atlas Cloud fournissent une couche API unifiée pour cela.

Et si vous êtes :

• Des développeurs qui veulent un accès IA facile et abordable. • Des équipes gérant des projets qui nécessitent de l'IA dans plusieurs domaines. • Des entreprises ayant besoin d'une IA fiable pour un travail important. • Des personnes utilisant des outils comme ComfyUI et n8n.

Essayez AtlasCloud, et vous passerez de l'expérimentation à la production. Pas besoin de reconstruire l'infrastructure à partir de zéro.

L'avenir ne consiste pas à écrire de meilleurs prompts isolément. Il s'agit de construire des systèmes visuels contrôlables, répétables et prêts pour la production.

FAQ

Pourquoi mes images IA semblent-elles encore plates ?

Les images plates signifient généralement que vous avez omis les indices de profondeur. Pensez au fonctionnement de la photographie. La profondeur vient des ombres, des éléments qui se chevauchent et des différences de mise au point. Votre prompt doit explicitement les mentionner.

Prenez un prompt simple : "une personne assise à un bureau." Cela ne dit presque rien au modèle sur la profondeur. Essayez plutôt quelque chose comme : "une personne assise à un bureau (plan moyen), une fenêtre floue avec les lumières de la ville (arrière-plan), une tasse de café mise au point (premier plan)." Maintenant, le modèle a des couches avec lesquelles travailler.

L'éclairage est un autre point où les gens se trompent. Beaucoup de prompts ne mentionnent que la lumière ambiante. Cela vous donne un éclairage plat et uniforme sur toute l'image. Ajoutez une source directionnelle. Lumière latérale. Contre-jour. Éclairage de contour. Choisissez-en un. Le modèle commencera à projeter des ombres, et soudainement votre image aura du volume.

Encore une chose. N'essayez pas de remplir chaque recoin du cadre avec des détails. L'espace vide et le flou sont utiles. Ils disent au spectateur où regarder. Parfois, moins de détails donnent plus de profondeur.

L'IA peut-elle remplacer la photographie de produit ?

Oui, dans de nombreux cas. Mais soyons honnêtes sur les cas où cela fonctionne et ceux où cela ne fonctionne pas.

Si vous avez besoin d'une photo clé pour une montre de luxe — celle où chaque reflet sur le métal compte et où la texture du bracelet en cuir doit être exacte — la photographie traditionnelle gagne toujours. Vous ne pouvez pas battre un vrai studio pour cela.

Pour presque tout le reste, l'IA est plus rapide et moins chère. Images de catalogue. Scènes de style de vie. Variations saisonnières. Tests A/B pour les créatifs. Vous pouvez générer une photo de produit propre sur fond blanc en quelques secondes. Ensuite, prenez cette image et placez-la dans une scène de plage, un chalet d'hiver ou une cuisine moderne en utilisant un générateur de photographie de produit IA.

Pas de location de studio. Pas de matériel d'éclairage. Pas de retouche. Chaque image coûte quelques centimes.

Pour les petites marques et les startups en vente directe, cela change la donne. Ils peuvent désormais produire des visuels qui rivalisent avec les entreprises ayant de gros budgets. Ce n'était pas possible il y a deux ans.

En quoi le modèle de génération visuelle d'OpenAI diffère-t-il des versions précédentes ?

Le nouveau modèle, GPT‑image‑1.5, présente quelques changements architecturaux sous le capot. Il utilise un transformateur de diffusion. C'est une façon sophistiquée de dire qu'il gère mieux les relations spatiales.

Les anciennes versions divisaient souvent des scènes complexes en morceaux qui ne s'emboîtaient pas tout à fait. Une main pouvait flotter près d'une tasse au lieu de la tenir. Les ombres pouvaient pointer dans les mauvaises directions. La nouvelle version garde les choses connectées. Une main tient la tasse. L'ombre tombe là où elle doit.

Le rendu du texte est un autre grand bond en avant. Les modèles précédents produisaient des caractères brouillés qui ressemblaient à des symboles aléatoires. GPT‑image‑1.5 génère des mots lisibles dans plusieurs langues. Vous pouvez mélanger l'anglais et le chinois dans la même image. Cela fonctionne vraiment maintenant.

Le modèle prend également en charge des résolutions plus élevées nativement — jusqu'à 2K sans mise à l'échelle. Moins d'artefacts. Détails plus nets.

Il y a un inconvénient. Le modèle est moins indulgent avec les prompts vagues. Vous ne pouvez pas simplement dire « un beau portrait » et attendre de la magie. Vous devez être plus prudent. Mais lorsque vous lui donnez des instructions structurées — direction de la lumière, couches de profondeur, réglages de caméra — la qualité de sortie est meilleure que tout ce qui a été produit par les générations précédentes.