Flux.2 Image Models

Developed by Black Forest Labs, FLUX.2 is a powerhouse 32-billion parameter rectified flow Transformer model that redefines creative workflows by unifying AI image generation, editing, and composition. It transforms complex text prompts into high-fidelity visuals while offering integrated tools for professional-grade editing at resolutions up to 2K, providing a streamlined, all-in-one solution for digital artists and designers seeking unmatched precision and scalability in their visual content creation.

Explorez les Modèles Leaders

Atlas Cloud vous offre les derniers modèles créatifs de pointe de l'industrie.

Ce Qui Distingue Flux.2 Image Models

Atlas Cloud vous fournit les derniers modèles créatifs de pointe du secteur.

Photorealistic Quality

Generates crisp, high-resolution images with accurate lighting, textures, and detail for production use.

Fast, Lightweight Inference

Optimized architecture delivers rapid image generation on modest GPUs and edge hardware.

Fine-Grained Control

Supports styles, presets, and prompt controls so designers can quickly dial in the exact look they want.

Seamless Workflow Integration

Simple APIs and plugins connect Nano Banana to design tools, apps, and pipelines with minimal setup.

Cost-Efficient Creativity

Efficient diffusion kernels and smart caching keep generation costs low, so teams can experiment freely at scale.

Flexible Deployment Options

Flexible Deployment Options Run in the cloud, on-prem, or in VPC environments.

Vitesse de pointe

Coût le plus bas

| Modalité | Description |

|---|---|

| Flux.2 Dev API(Text To Image, Image To Image) | L'API Flux.2 Dev donne accès au modèle à poids ouverts de 32 milliards de paramètres le plus puissant au monde, conçu pour la génération sophistiquée de texte en image et l'édition d'images à entrées multiples. En utilisant un checkpoint unifié pour la création et la modification, elle rationalise les flux de travail créatifs professionnels et offre une base inégalée pour créer des applications d'IA visuelle avancées et personnalisables sous licence commerciale. |

| Flux.2 Pro API(Text To Image, Image To Image) | L'API Flux.2 Pro offre une qualité d'image de pointe et un respect des prompts qui rivalisent avec les meilleurs modèles à source fermée, tout en réduisant considérablement la latence et les coûts opérationnels. Elle fournit une solution haute performance pour les applications d'entreprise qui nécessitent une fidélité visuelle supérieure sans le prix élevé associé. |

| Flux.2 Flex API(Text To Image, Image To Image) | L'API Flux.2 Flex offre aux développeurs un contrôle granulaire sur les paramètres de génération, y compris les échelles de guidage et les étapes d'inférence, pour calibrar parfaitement le compromis entre vitesse et fidélité au prompt. Spécifiquement optimisée pour les détails complexes et le rendu typographique précis, elle sert de boîte à outils polyvalente pour les créateurs qui exigent un contrôle de haute précision sur des compositions visuelles et des éléments textuels complexes. |

| Flux.2 Klein API(Text To Image, Image To Image) | L'API Flux.2 Klein offre une solution légère mais robuste grâce à des techniques avancées de distillation de taille, publiée sous la licence Apache 2.0 conviviale pour les développeurs. Elle surpasse les modèles de taille similaire entraînés à partir de zéro, offrant une voie efficace et accessible pour la génération d'images de haute qualité dans des environnements à ressources limitées. |

Nouvelles fonctionnalités de Flux.2 Image Models + Showcase

La combinaison de modèles avancés avec la plateforme accélérée par GPU d'Atlas Cloud offre une vitesse, une évolutivité et un contrôle créatif inégalés pour la génération d'images et de vidéos.

Fidélité des textures améliorée et éclairage réaliste via l'API FLUX.2

Le modèle FLUX.2 exploite son architecture de 32 milliards de paramètres pour offrir des textures plus nettes et un éclairage stabilisé sur toutes les sorties visuelles. En optimisant l'interaction lumière-matière dans l'espace latent, les utilisateurs peuvent obtenir des résultats photoréalistes pour la visualisation de produits haut de gamme et la photographie professionnelle. C'est la solution ultime pour le rendu hyperréaliste, la cohérence des matériaux et les actifs numériques de qualité studio.

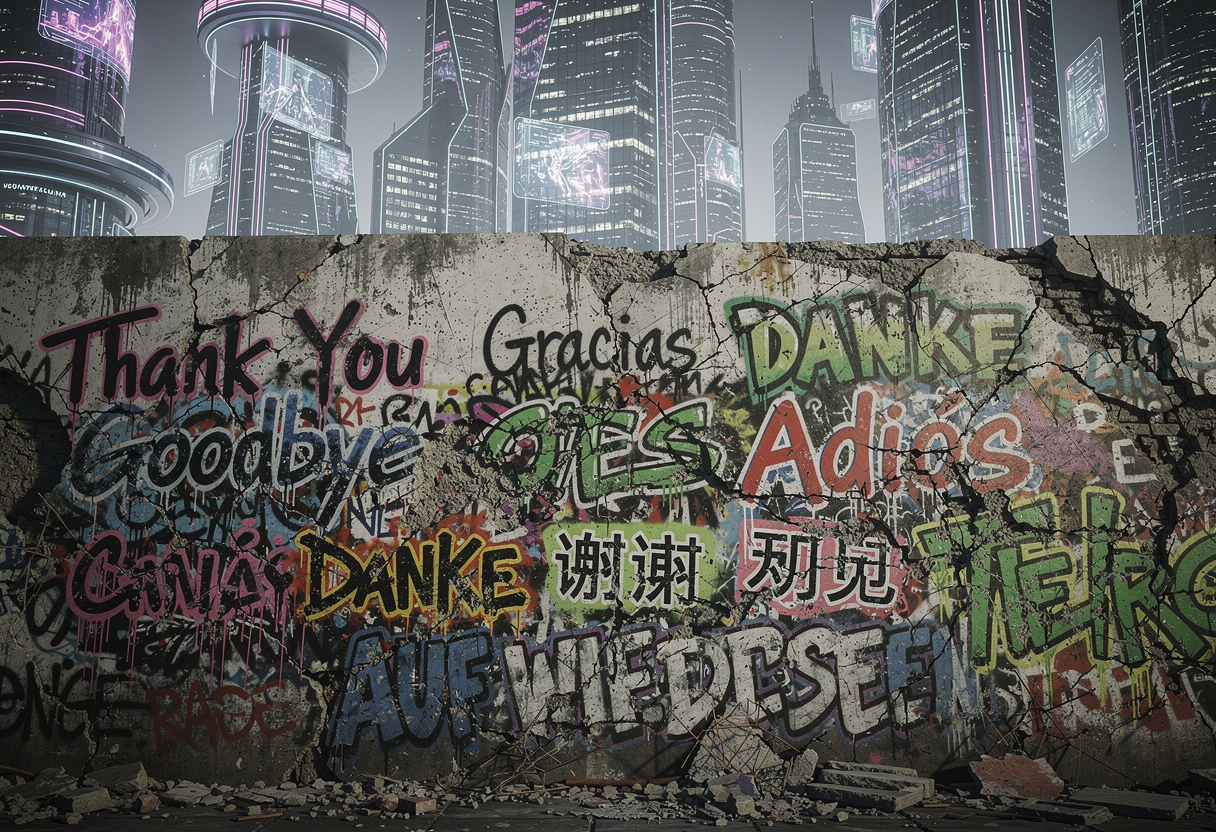

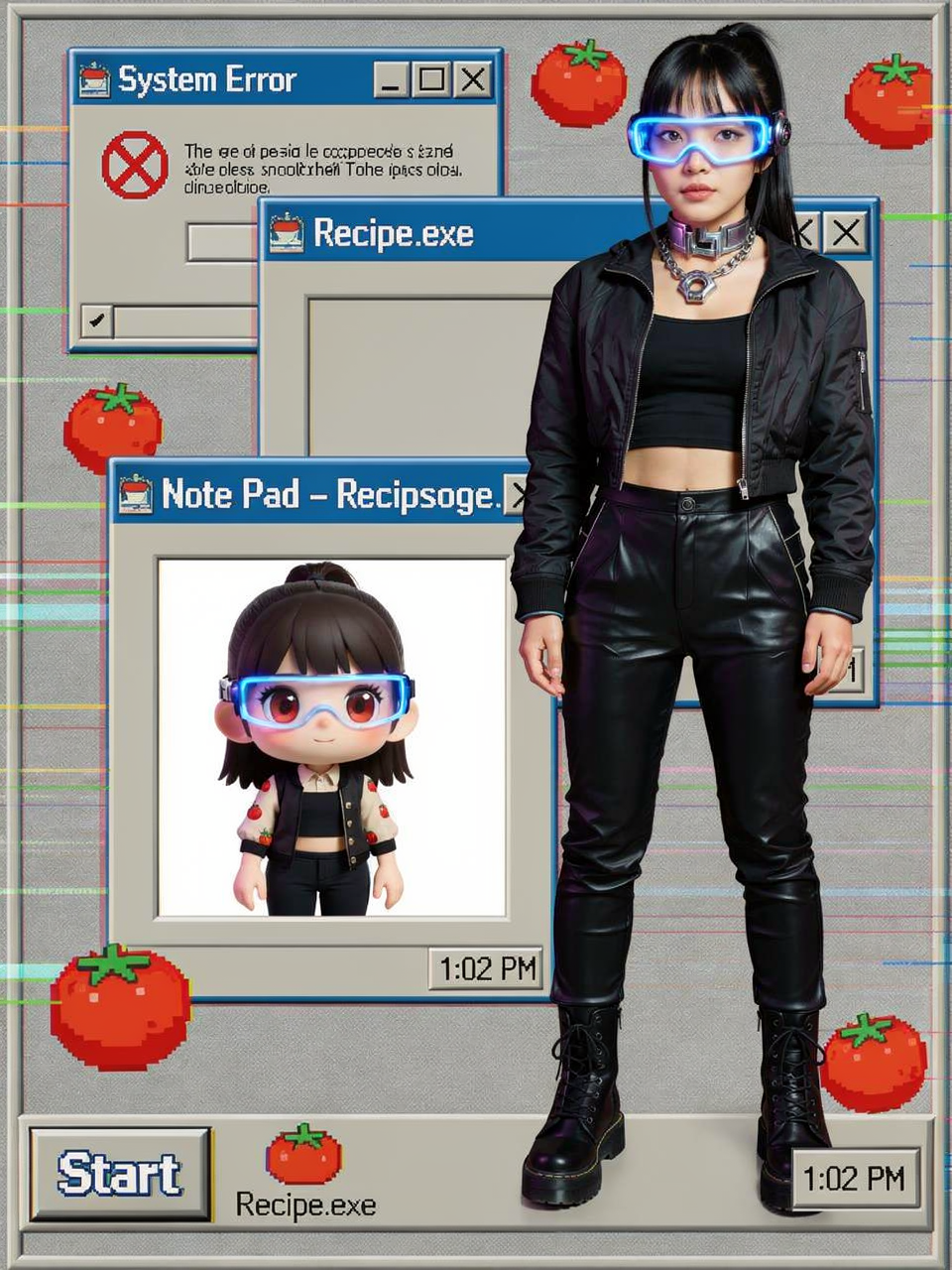

Typographie avancée et rendu graphique via l'API FLUX.2

FLUX.2 prend en charge des mises en page typographiques complexes et des simulations d'interface utilisateur (UI) élaborées, garantissant que même le micro-texte reste lisible et net. En intégrant un encodage sophistiqué au niveau des caractères, les utilisateurs peuvent rendre avec précision des infographies, des mèmes et du contenu de marque sans aucune distorsion de caractère. C'est la solution ultime pour la conception graphique professionnelle, le prototypage d'interface et les compositions créatives riches en texte.

Compréhension des prompts structurés et contrôle de la composition via l'API FLUX.2

Le moteur FLUX.2 offre une logique supérieure pour interpréter des prompts de plusieurs paragraphes et des contraintes spatiales complexes avec une haute fidélité. En décodant des directives relationnelles nuancées, les utilisateurs peuvent orchestrer avec précision des scènes à sujets multiples et maintenir une stricte adhésion à l'intention de composition. C'est la solution ultime pour une narration sophistiquée, l'art numérique en couches et les récits visuels axés sur la précision.

Amélioration de la logique du monde et de la conscience spatiale via l'API FLUX.2

FLUX.2 intègre une vaste connaissance du monde pour comprendre en profondeur les relations physiques entre la lumière, l'espace et le comportement des objets. En fondant chaque génération sur une logique environnementale réaliste, les utilisateurs peuvent s'assurer que les scènes complexes se comportent exactement comme prévu dans le monde physique. C'est la solution ultime pour la visualisation architecturale, la création de mondes immersifs et la synthèse de scènes logiquement cohérentes.

Ce Que Vous Pouvez Faire avec Flux.2 Image Models

Découvrez les cas d'usage pratiques et les workflows que vous pouvez créer avec cette famille de modèles — de la création de contenu et l'automatisation aux applications de niveau production.

Rendu photoréaliste haute fidélité avec l'API FLUX.2

Le modèle FLUX.2 permet aux créateurs et aux développeurs de concevoir un contenu visuel ultra-réaliste qui préserve des textures vivantes, un éclairage stabilisé et une précision physique. Idéale pour la photographie de produits professionnelle et la visualisation architecturale, l'architecture à 32 milliards de paramètres assure des reflets de surface cohérents et une profondeur de matériau, prenant en charge des actifs marketing haut de gamme, des maquettes de marques de luxe et la photographie numérique de qualité studio.

Conception typographique et mise en page de précision via l'API FLUX.2

For information-dense graphics, FLUX.2 renders complex typography, UI simulations, and intricate layouts with absolute clarity and zero character distortion. This use case fits graphic designers, branding experts, and social media creators requiring precise text integration in posters, infographics, and interface prototypes—ensuring even micro-fonts remain legible and perfectly aligned, powered by advanced Transformer-based semantic understanding.

Composition de scène logique et édition haute résolution 4 MP

FLUX.2 offre une interprétation inégalée des prompts structurés et multipartites, permettant des scènes sophistiquées à sujets multiples et des arrangements spatiaux complexes. Prenant en charge l'édition haute résolution jusqu'à 4 millions de pixels, l'API facilite les transformations image-à-image fluides et les ajustements locaux de précision, fournissant une solution tout-en-un efficace pour les artistes numériques professionnels et les visionnaires qui exigent une cohérence logique dans les projets créatifs à grande échelle.

Comparaison des Modèles

Découvrez comment les modèles de différents fournisseurs se comparent — performance, tarification et atouts uniques pour une décision éclairée.

| Modèle | Limite d'images de référence | Nombre de sorties | Résolution | Modèle |

|---|---|---|---|---|

| Flux.2 | 10 | 1 | 2K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Flux.1 | 1 | 1 | 256P~4K | Width[256, 4096]px; Height[256, 4096]px |

| Qwen-Image | 3 | 1~6 | 512P~2K | Width[512, 2048]px; Height[512, 2048]px |

| Nano Banana 2 | 14 | 1 | 4K, 2K, 1K | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

| Seedream 5.0 Lite | 14 | 1~15 | 2K~4K+ | 1:1 3:2 2:3 3:4 4:3 4:5 5:4 9:16 16:9 21:9 |

How to Use Flux.2 Image Models on Atlas Cloud

Get started in minutes — follow these simple steps to integrate and deploy models through Atlas Cloud’s platform.

Create an Atlas Cloud Account

Sign up at atlascloud.ai and complete verification. New users receive free credits to explore the platform and test models.

Pourquoi Utiliser Flux.2 Image Models sur Atlas Cloud

Combiner les modèles Flux.2 Image Models avancés avec la plateforme accélérée par GPU d'Atlas Cloud offre des performances, une évolutivité et une expérience développeur inégalées.

Performance et Flexibilité

Faible Latence :

Inférence optimisée par GPU pour un raisonnement en temps réel.

API Unifiée :

Exécutez Flux.2 Image Models, GPT, Gemini et DeepSeek avec une seule intégration.

Tarification Transparente :

Facturation prévisible par token avec options serverless.

Entreprise et Échelle

Expérience Développeur :

SDK, analytiques, outils de fine-tuning et modèles.

Fiabilité :

99,99% de disponibilité, RBAC et journalisation conforme.

Sécurité et Conformité :

SOC 2 Type II, alignement HIPAA, souveraineté des données aux États-Unis.

Questions Fréquentes sur Flux.2 Image Models

Il unifie la génération d'images, l'édition locale et la composition multi-images. FLUX.2 est 30 à 50 % plus rapide que son prédécesseur et prend en charge nativement une sortie haute résolution de 4MP, atteignant une excellence photoréaliste en matière de logique physique, d'éclairage et de textures.

FLUX.2 génère un texte net et précis même dans des scènes complexes, prenant en charge les longs paragraphes et les micro-polices. En intégrant le modèle vision-langage Mistral-3 24B, il excelle dans les infographies, les maquettes d'interface utilisateur (UI mockups) et les actifs de marque riches en texte.

FLUX.2 est développé par Black Forest Labs (BFL), fondé par les créateurs originaux de Stable Diffusion (SDXL). L'équipe a été pionnière de la technologie Latent Diffusion et redéfinit aujourd'hui l'intelligence visuelle grâce à une architecture Rectified Flow de 32 milliards de paramètres.

Explorer Plus de Familles

Happy Horse 1.0

HappyHorse-1.0 is a unified multimodal AI video generation model that climbed to the top of the Artificial Analysis Video Arena blind-test leaderboard for both text-to-video and image-to-video generation. CNBC Alibaba Group confirmed ownership of HappyHorse, developed under its Alibaba Token Hub (ATH) business unit, where it leads benchmarks outperforming ByteDance's Seedance 2.0 and others. Caixin Global Led by Zhang Di — the former VP of Kuaishou who architected Kling AI — the 15-billion parameter model generates 1080p video with synchronized audio in a single pass using a unified transformer architecture that bypasses the multi-stage pipelines used by every major competitor.

Seedance 2.0 Models

Seedance 2.0(by Bytedance) is a multimodal video generation model that redefines "controllable creation," moving beyond the limitations of text or start/end frames. It supports quad-modal inputs—text, image, video, and audio—and introduces an industry-leading "Universal Reference" system. By precisely replicating the composition, camera movement, and character actions from reference assets, Seedance 2.0 solves critical issues with character consistency and physical coherence, empowering creators to act as true "directors" with deep control over their output.

GPT Image 2 Models

GPT Image 2 is a state-of-the-art multimodal foundation model engineered for exceptional text-to-image generation with unprecedented photorealism and creative versatility. Developed by OpenAI as the evolution of the DALL-E lineage, it transforms detailed natural language descriptions into hyper-realistic imagery at up to 4K resolution. With proprietary "Neural Rendering Engine" technology for precise visual control, GPT Image 2 delivers studio-quality results with accurate anatomy, lighting, and composition—making it the premier AI tool for professional creators, enterprises, and developers demanding production-ready visual assets.

Wan2.7 Models

Launching this March, Wan2.7 is the latest powerhouse in the Qwen ecosystem, delivering a massive upgrade in visual fidelity, audio synchronization, and motion consistency over version 2.6. This all-in-one AI video generator supports advanced features like first-and-last frame control, 3x3 grid synthesis, and instruction-based video editing. Outperforming competitors like Jimeng, Wan2.7 offers superior flexibility with support for real-person image inputs, up to five video references, and 1080P high-definition outputs spanning 2 to 15 seconds, making it the premier choice for professional digital storytelling and high-end content marketing.

Veo3.1 Models

Google DeepMind’s Veo 3.1 represents a paradigm shift in AI video generation, empowering creators with director-level narrative control and cinematic-grade audio quality that seamlessly integrates with its enhanced visual realism. By bridging the gap between imaginative concepts and photorealistic execution, this advanced model offers a transformative solution for a wide range of application scenarios, from professional filmmaking and high-end advertising to immersive digital content creation.

ERNIE Image Models

ERNIE-Image is an open-weight text-to-image model developed by the ERNIE-Image Team at Baidu, built on a single-stream Diffusion Transformer (DiT) with 8B parameters and paired with a lightweight Prompt Enhancer that rewrites short prompts into richer, more structured descriptions before passing them to the diffusion backbone. NYU Shanghai RITS Released on April 15, 2026 under the Apache 2.0 license, it transforms natural language descriptions into detailed imagery with particular strength in text rendering and structured layout generation. ERNIE-Image is designed not only for strong visual quality, but for controllability in practical generation scenarios where accurate content realization matters as much as aesthetics — making it well-suited for commercial posters, comics, multi-panel layouts, and other content creation tasks that require both visual quality and precise control.

GPT Image Models

The GPT Image Family is OpenAI's latest suite of multimodal image generation and editing models, built on the powerful GPT architecture. This family includes three tiers — GPT Image-1, GPT Image-1.5, and GPT Image-1 Mini — each available in both Text-to-Image and Image-to-Image variants. Combining GPT's world-class language understanding with DALL·E-class visual synthesis, these models deliver exceptional prompt adherence, photorealistic rendering, and creative versatility across illustration, photography, design, and visualization tasks. The series offers flexible pricing and quality tiers to match any workflow — from rapid prototyping and high-volume content production to professional-grade final deliverables. Whether you need ultra-fast iterations at minimal cost or maximum quality for brand campaigns, the GPT Image Family has a solution tailored to your needs.

Nano Banana2 Models

Nano Banana 2 (by Google), is a generative image model that perfectly balances lightning-fast rendering with exceptional visual quality. With an improved price-performance ratio, it achieves breakthrough micro-detail depiction, accurate native text rendering, and complex physical structure reconstruction. It serves as a highly efficient, commercial-grade visual production tool for developers, marketing teams, and content creators.

Seedream5.0 Models

Seedream 5.0, developed by ByteDance’s Jimeng AI, is a high-performance AI image generation model that integrates real-time search with intelligent reasoning. Purpose-built for time-sensitive content and complex visual logic, it excels at professional infographics, architectural design, and UI assistance. By blending live web insights with creative precision, Seedream 5.0 empowers commercial branding and marketing with a seamless, logic-driven workflow that turns sophisticated data into stunning, high-fidelity visuals.

Kling3.0 Models

Kuaishou’s flagship video generation suite, Kling 3.0, features two powerhouse models—Kling 3.0 (Upgraded from Kling 2.6) and Kling 3.0 Omni (Kling O3, Upgraded from Kling O1)—both offering high-fidelity native audio integration. While Kling 3.0 excels in intelligent cinematic storytelling, multilingual lip-syncing, and precision text rendering, Kling O3 sets a new standard for professional-grade subject consistency by supporting custom subjects and voice clones derived from video or image inputs. Together, these models provide a comprehensive solution tailored for cinematic narratives, global marketing campaigns, social media content, and digital skit production.

GLM LLM Models

GLM is a cutting-edge LLM series by Z.ai (Zhipu AI) featuring GLM-5, GLM-4.7, and GLM-4.6. Engineered for complex systems and long-horizon agentic tasks, GLM-5 outperforms top-tier closed-source models in elite benchmarks like Humanity’s Last Exam and BrowseComp. While GLM-4.7 specializes in reasoning, coding, and real-world intelligent agents, the entire GLM suite is fast, smart, and reliable, making it the ultimate tool for building websites, analyzing data, and delivering instant, high-quality answers for any professional workflow.

Open AI Model Families

Explore OpenAI’s language and video models on Atlas Cloud: ChatGPT for advanced reasoning and interaction, and Sora-2 for physics-aware video generation.